实现一个微信录音功能过程

功能原型图

其实就是微信发送语音的功能。没有转文字的功能。

拆解需求

根据原型图可以很容易的得出我们需要做的内容包括下面三个部分:

接入微信的语音SDK

调用微信SDK的API逻辑

界面和交互的实现

其中第一点和第二点属于业务逻辑部分,第三点属于交互逻辑部分。对于业务逻辑和交互逻辑的关系在我的另外一篇文章描述过,我在vue中是这样拆分组件的 - 掘金 (juejin.cn)

从原型图可以分析出如下的流程图:

评估时间

第三事情是评估时间。在接到这个需求的时候,我们需要假设我们在此之前没有接入过微信相关的SDK,并以此为前提进行工期的评估。

可以将该用户故事拆分为如下任务:

微信语音SDK的技术调研(0.5天)

输出开发设计文档(0.5天)

接入微信语音SDK(0.5天)

编码(1天)

自测(0.5天)

随后将上面的时间都乘以2! 自此才可以将估算的工期上报给产品。多年的经验告诉自己,自己一开始估算的工期从来没够过。自行估算的时候,幻想的是在工作的时候能够一直保持专注。

就我自己而言,做不到,上班不可能不摸鱼!也是必须要摸鱼的。乘以2才是刚够而已。

代码实现

都说在实现代码之前要先设计,谋定而后动。我是这样做的,先想好文件夹创建,然后到文件的创建,再到具体文件中写出大体的框架。

需求并不复杂,只是一个界面中的一个模块。所以我只需要一个Record.vue来承载界面,一个use-record-layout.js来承载业务逻辑,以及一个use-record-interact.js来承接交互逻辑。

|__im-record

|__Record.vue

|__use-record-layout.js

|__use-record-interact.js为了便于说明,将这个聊天的界面简化如下:

<script setup>

import { useNamespace } from "@/use-namespace";

const ns = useNamespace('chat')

</script>

<template>

<header :class="ns.b('header')"></header>

<main :class="ns.b('main')">

<section :class="[ns.b('record'), ns.w('record', 'toast')]">

<div :class="ns.w('record', 'speak')"></div>

<div :class="ns.w('record', 'pause')"></div>

</section>

</main>

<footer :class="ns.w('button', 'wrap')">

<button :class="ns.b('button')">

<span>

按住 说话

</span>

</button>

</footer>

</template>通过上面的代码片段可知,我们的主要的界面在section标签的record部分。

use-record-layout.js的主题代码如下:

const recordStyle = {

default: { }, // 默认样式/确定发送录音

recording: { }, // 录音中

pause: { }, // 暂停录音

cancel: { } // 取消录音

}

const init = () => {

initEvent()

initStyle()

}

const initStyle = () => {

recordStyle.default.is = true

}

const initEvent = () => {

el.addEventListener('touchstart', handleTouchstart)

el.addEventListener('touchmove', handleTouchmove)

el.addEventListener('touchend', handleTouchend)

}

const axis = {

posStart: 0, // 初始化起点坐标

posMove: 0 // 初始化滑动坐标

}

const handleTouchstart = (event) => {

event.preventDefault()

axis.posStart = event.touches[0].pageY

recordStyle.recording.is = true

}

const handleTouchmove = (event) => {

event.preventDefault()

axis.posMove = event.targetTouches[0].pageY

const diffMove = axis.posMove - axis.posStart

if (diffMove > DEFAULT_AXIS) {

recordStyle.recording.is = true

}

}

const handleTouchend = (event) => {

event.preventDefault()

recordStyle.default.is = true

}

init()其中recordStyle是交互的结果,在这个需求当中,我们的界面的四种变化都对应其中一个的样式。

use-record-interact.js也很简单,注册微信录音功能 ➡️

const wx = 'wx'

const useRecordInteract = () => {

const isAuth = localStorage.getItem('allowWxRecord')

// 获取录音权限

const authRecord = () => {

if (!isAuth) {

wx.startRecord()

return

}

return isAuth

}

// 停止录音

const stopRecord = () => {}

// 上传录音

const uploadRecord = () => {}

}交互逻辑和业务逻辑的联动通过recordStyle对象的存取属性来实现,代码片段如下:

const interact = useRecordInteract()

const recordStyle = {

default: {

_is: false,

get is() {

return this._is

},

set is(value) {

this._is = value

if (value) {

this.recording.is = false

this.pause.is = false

this.cancel.is = false

interact.uploadRecord()

}

}

},

//...

}实现了业务逻辑和交互逻辑的分离。

作者:砂糖橘加盐

来源:juejin.cn/post/7201491839815745597

真的有必要用微前端框架么?

前言

最近公司项目在用qiankun构建微前端的应用,深深体会到微前端的魅力,无框架限制,主应用统一管理,弹窗的统一位置等。如果是刚开始就植入微前端还好,不过基本上都是后期老项目植入微前端,各种拆分模块,也是一件很头疼的事情。

基石

我们为什么要用微前端

大的应用体量维护成本是很高的,拆分成单独的模块,由主应用处理登录等通用逻辑,子应用来只负责模块的业务实现,这样不管资源加载、按需加载、人员维护成本降低、增量升级、独立部署都有很好的体检提升。当然前提是体量非常大的web应用可以这么做,但是开始做的时候你会很头疼各种拆解带来的不确定性,但是长痛不如短痛。

Why Not Iframe

下面是我从qiankun文档摘抄的:

iframe 最大的特性就是提供了浏览器原生的硬隔离方案,不论是样式隔离、js 隔离这类问题统统都能被完美解决。那么为什么不用iframe呢 ?

- url 不同步。浏览器刷新 iframe url 状态丢失等(本地缓存不就行了?)

- UI 不同步,DOM 结构不共享(主应用控制不就行了?子应用通过postMessage传递数据给父应用)

- 一次性加载,慢!(个人感觉就是项目体积小了!跟iframe有啥区别么?)

- 全局上下文完全隔离,内存变量不共享。(当然这里通过postMessage是可以实现通信的!)

所以其实用iframe就够了,微前端是不是有点kpi的味道呢?当然学习下源码还是对自己有提升的,万一iframe没有,是不是可以手撸一个呢?

源码入口

最核心的就是手动加载loadMicroApp、registerMicroApps注册微应用,start开始构建这3个api,但其实qiankun的核心是基于single-spa框架封装的, 我们看下single-spa做了些什么,以及single-spa内部核心api的registerApplication做了什么

single-spa

single-spa是一个框架,用于将多个JavaScript微前端组合在一个前端应用程序中。使用单一页面中心构建前端可以带来许多好处,例如:

- 在同一页面上使用多个框架而无需刷新页面(React,AngularJS,Angular,Ember或你正在使用的任何框架)

- 独立部署您的微前端

- 使用新框架编写代码,无需重写现有应用

- 延迟加载代码可缩短初始加载时间

registerApplication 注册应用

export function reroute (pendingPromises = [], eventArguments) {

//...

const {

appsToUnload,

appsToUnmount,

appsToLoad,

appsToMount,

} = getAppChanges(); //返回不同生命周期的队列

//记录基础的应用信息

let appsThatChanged,

navigationIsCanceled = false,

oldUrl = currentUrl,

newUrl = (currentUrl = window.location.href);

//这里根据是否已挂载做处理

if (isStarted()) {

//....

} else {

appsThatChanged = appsToLoad;

return loadApps();

}

//加载apps

function loadApps () {

return Promise.resolve().then(() => {

const loadPromises = appsToLoad.map(toLoadPromise);

return (

Promise.all(loadPromises)

.then(callAllEventListeners)

// there are no mounted apps, before start() is called, so we always return []

.then(() => [])

.catch((err) => {

callAllEventListeners();

throw err;

})

);

});

}

//根据app状态改变发布对应的事件

function performAppChanges () {

return Promise.resolve().then(() => {

// https://github.com/single-spa/single-spa/issues/545

window.dispatchEvent(

new CustomEvent(

appsThatChanged.length === 0

? "single-spa:before-no-app-change"

: "single-spa:before-app-change",

getCustomEventDetail(true)

)

);

//...做了大量的自定义事件以及卸载事件

}

//....

}

复制代码说实话这里的源码很绕,这里只摘取最关键的,在registerApplication内部,将qiankun的registerMicroApps的参数传入做些兼容判断,然后调用了一个核心的reroute方法, 这里删除了不必要的干扰信息,说白了single-spa做了spa的生命周期的管理,每个应用有单独的html做页面的加载,但是环境的隔绝是需要qiankun做的

getAppChanges 状态管理

export function getAppChanges () {

const appsToUnload = [],

appsToUnmount = [],

appsToLoad = [],

appsToMount = [];

// We re-attempt to download applications in LOAD_ERROR after a timeout of 200 milliseconds

const currentTime = new Date().getTime();

apps.forEach((app) => {

const appShouldBeActive =

app.status !== SKIP_BECAUSE_BROKEN && shouldBeActive(app);

switch (app.status) {

case LOAD_ERROR:

if (appShouldBeActive && currentTime - app.loadErrorTime >= 200) {

appsToLoad.push(app);

}

break;

case NOT_LOADED:

case LOADING_SOURCE_CODE:

if (appShouldBeActive) {

appsToLoad.push(app);

}

break;

case NOT_BOOTSTRAPPED:

case NOT_MOUNTED:

if (!appShouldBeActive && getAppUnloadInfo(toName(app))) {

appsToUnload.push(app);

} else if (appShouldBeActive) {

appsToMount.push(app);

}

break;

case MOUNTED:

if (!appShouldBeActive) {

appsToUnmount.push(app);

}

break;

// all other statuses are ignored

}

});

return { appsToUnload, appsToUnmount, appsToLoad, appsToMount };

}

复制代码getAppChange返回了应用一旦改变那么不同生命周期的队列会更新

registerMicroApps注册微应用

简单的看下用法,qiankun的核心api并不多

registerMicroApps注册微应用中,传入apps的信息,如name、路由匹配规则、container挂载dom等,和生命周期的钩子lifeCycles。核心的应用状态管理在single-spa中,而qiankun在外层又做了统一的上层的主应用封装。这里比较重要的是loadApp,里面统一处理解决了全局变量混入的问题也就是沙箱隔离,样式隔离等。下面是loadApp的一部分核心逻辑

环境隔离

1. 全局变量的隔离

createSandboxContainer 创建沙箱

这里核心就是createSandboxContainer的用法,这里简单讲下几个核心的参数,initialAppWarpperGetter用于处理检查是否有无包裹的dom元素,scpredCSS是代表样式是否已经被隔离状态, useLooseSandbox和speedySandbox处理不同状态的沙箱。

,在里面核心的方法是patchAtBootstrapping做了不同的沙箱隔离方式的隔绝处理

patchAtBootstrapping 启动器

patchAtBootstrapping中的策略者模式,我们可以看到有3种沙箱的处理方式,legacyProxy、Proxy、Snapshot,并分别对应了pathLooseSandbox、pathStrictSandbox、patchLooseSandbox,下面简单解析下原理,理解即可。

Snapshot沙箱隔离

先将主应用的window拷贝一份,一旦微应用切换到主应用做回退,如果微应用切换,那么会提前生成微应用的diff过程的对象,然后回退。而缺陷就是diff属性量一旦过大会性能不好

Legacy沙箱隔离

那么与Snapshot最大的不同是用了Proxy来处理,set做记录,一旦应用切换就回退,相对于我不断循环遍历diff,性能好了不少

Proxy沙箱隔离

前面两种应用场景在于都是一个路由对应一个微应用,那么如果是多个微应用同时出现在一个页面中,那么环境是不是不可控了呢。这种情况就不能在window直接操作,而是要每个应用都要有一个独立的fakeWindow,这样区分环境后,数据处理尽量在fakeWindow上处理,而不是原生window

Proxy模式的核心的我们看下pathStrictSandbox源码

pathStrictSandbox 严格模式

Proxy代理模式的沙箱,通过Object.defineProperty来拦截对象属性,但是不可枚举可写入, 这样每次切换应用我都重新获取新的nativeGlobal

nativeGlobal 全局对象

export const nativeGlobal = new Function('return this')();

复制代码通过new Function来更安全的返回全局对象

2. DOM的隔离

很明显这里是通过ShadowDOM来实现dom的隔离,我们常见的比如video、audio标签内部都是可以看到shadowDOM实现的,同时我们也可以看到做了兼容性的处理

3. 样式隔离

scopedCSS代表是否要隔离css,如果要隔离首先去判断将微应用的根元素挂载qiankun的属性标记,然后遍历所有style标签,css.process对每个内部的样式属性名做了模块化的处理,而appInstanceId就是做微应用样式隔离的id区分

通信

import-html-entry

qiankun用的是import-html-entry这个库的execSceipts方法来请求获得并解析脚本的,然后直接把html插入到容器里,所以应用间需要允许跨域才行,在importEntry你可以发现他使用了浏览器空闲的api,requestIdleCallback以及为基础实现预加载prefetch

initGlobalState 全局状态

我们主要看下initGlobalState,通过emitGlobal来触发更新全局状态,从上图可以看出核心通过deps发布订阅模式来管理每个微应用,然后更新状态。返回的onGlobalChange和setGlobalState来监听变化和触发通知。状态管理还是比较简单的。

总结

花了几天时间看了源码,收获还是挺大的,微前端其实主要有3个的核心点在于应用通信、应用的生命周期及状态管理、沙箱环境隔离。相对来说iframe足够满足我们业务需求了,微前端提供了一种思路还是不错的,但是真的有必要用qiankun么?

链接:https://juejin.cn/post/7201282972967944250

来源:稀土掘金

著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。

JavaScript 预编译

预编译发生在什么时候

预编译发生在函数执行的前一刻

一. 预编译的抽象理解

函数声明整体提升

变量,声明提升

举个例子

<script type="text/javascript">

test();

function test() {

console.log('我是test');

}

a = 10;

var a;

console.log(a);

</script>这里控制台能正常输出就是因为在预编译时将函数的声明整体和变量的声明提升到了代码的最顶部,所以代码中先调用函数或者是先给变量赋值再声明都没有问题,当然这是抽象的概念,记住这个已经能解决8-90%的变成问题了,如果你想了解具体的流程,可以接着往下看。

二. 局部函数预编译过程

创建AO(Activation Object)对象

找形参和变量声明,将变量和形参名作为AO对象的属性名,默认值为undefind

将实参值和形参相关联

找函数声明,值为其函数体

例子一

<script type="text/javascript">

function test(a) {

var b = 10;

function c() {

}

}

test(1);

</script>根据过程来我们可以得出右边的AO对象中的数值,a最终保存的是1,因为第三步需要把形参和实参相关联

例子二

<script type="text/javascript">

function test(a) {

var a = 10;

function a() {

}

}

test(1);

</script>对象中同名的属性会只保留一个,所以经过第二步寻找变量声明和形参的时候,AO对象中会有一个a,且默认值为undefind,经过第三步实参值和形参相关联后,a的值变为1,经过第四步找函数声明的时候发现有个名字为a的函数,AO中本身就有a的属性名了,所以这个时候会将a的函数体赋值给AO中的a。

如果上面的例子能够搞懂的话,咱们就可以接着玩一个题

例子三

<script type="text/javascript">

function test(a) {

console.log(a);

var a = 10;

console.log(a);

function a() {

consoel.log('这是函数a');

}

}

test(1);

</script>如果你心中的结果跟答案一致,说明已经清楚了局部函数预编译的四个步骤了

到test函数执行之前AO对象中a的值为a的函数体这个应该没有什么问题吧?所以第一个log打印出来的是a的函数体,第二个log之前由于有var a = 10;,这个经过变量的声明提升后可以看做是a = 10;,走到这里这里AO中的a被赋值为10,所以第二个log打印的就是10。

二. 全局函数预编译过程

创建GO(Global Object)对象

找变量声明,将变量名作为GO对象的属性名,默认值为undefind

找函数声明,值为其函数体

全局函数的过程跟局部函数差不多,由于全局函数没有形参和实参的传递,所以省略了一个步骤。

例子四

<script type="text/javascript">

console.log(a);

var a = 1111;

console.log(a);

function a() {

console.log('这里是a函数');

}

</script>这里例子四的输出和转化结果跟例子三差不多,只不过是AO对象变成了GO对象。

例子五

<script type="text/javascript">

console.log(a);

var a = 10;

function a(a) {

console.log(a);

}

a(1);

</script>这里可以看看第二个log打印的是什么,还是会报错?

第一个log打印a函数的函数体没有问题吧?第二个log为什么会报错呢?因为GO对象中保存的a属性在第一次log的时候保存的是a的函数体,但是下面有个a=10;*的赋值,这个时候GO中的a就被修改成10了,后面调用*a(1)*函数的时候,找到GO中的a,这个时候a是number数字而不是函数,所以会报错说*a is not a function。

例子六

<script type="text/javascript">

var a = 1;

var b = 2;

function test(a) {

var a;

console.log(a); // 输出10

a = 100;

console.log(a); // 输出100

console.log(b); // 输出2

}

test(10);

console.log(a); // 输出1

</script>看看例子六的输出结果是不是符合自己的心里预期。我们都知道函数内部有变量会优先使用自身内部的变量,其实也可以转化成AO和GO来理解。 第一个log输出的时候找到自身的AO中有属性a,且这个值是实参传递过来的,所以是10。 第二个log由于前面有a=100所以a被赋值成了100。 第三个log会找自己的AO,发现自己的AO里没有这个b属性,就会去找到父函数的AO,由于这里父函数是全局函数了,所以就去找GO里有没有b属性,有的话就输出了GO里的b的值,所以是2。(如果这里GO中也没有b属性的话,就会报b is not defined的错误了) 第四个log输出的就是自身AO也就是GO中的a属性的值了。

看完这几个例子相信你应该对预编译有个比较清晰的认识了,这里的面试题很多,但是万变不离其中,我们只需要把AO和GO分析出来,那么就可以清晰的了解到函数运行过程中每一步的每个属性值分别是什么了。

作者:Charlin丶

来源:juejin.cn/post/7200681438315642941

心血来潮,这次我用代码“敲”木鱼

技术栈

面对这种寿命短,后期也基本不需要维护的项目(更没有复杂的网络请求一说),本篇文章直接使用原生JavaScript进行开发。或者您也可以尝试一下低代码

关于低代码,您大可放心的阅读此篇干货文章《低代码都做了什么?(为什么?怎么实现Low-Code?)》

至于TypeScript,您可以通过《谈谈写TypeScript实践而来的心得体会》这篇文章快速上手或进阶TS

实现

页面布局

图中右侧标出了三个部分:

img标签用于指定木鱼的图片url地址,在木鱼进行缩放时,对该标签增加/删除css类名即可- 每次敲击时所产生的文字由

p标签生成,且所有的p标签都存在于div标签之下 audio标签会在敲击时播放声音

本篇文章不会涉及具体的Html、Css部分。如有疑问,请在此项目的GitHub中找到答案

逻辑部分

准备工作

通过JavaScript获取要操作的真实dom

const dom = {

// 木鱼

woodenFish: document.querySelector("img"),

// 文字浮层

text: document.querySelector(".w-f-c-text"),

// 音频

audio: document.querySelector("audio")

}

复制代码木鱼缩放

这里的思路是敲击时给img追加一个带有css animation的样式类,该animation的作用是让木鱼进行一次缩放,例如

.w-f-c-i-size {

/** 这里的animation只会执行一次缩放,所以后面会通过增加/删除该类名来达到可以进行n次缩放的效果 */

animation: wooden-fish-size 0.3s;

}

@keyframes wooden-fish-size {

0% {

transform: scale(1);

}

50% {

transform: scale(0.9);

}

100% {

transform: scale(1);

}

}

复制代码样式搞定之后,通过原生JavaScript提供的dom classList进行css样式类名的增加与删除。dom classList共有四个方法:

add:在指定节点上增加一个样式类名remove:在指定节点上删除一个样式类名toggle:在指定节点A上若已有样式类名a,则将a删除;若没有样式类名a,则添加类名areplace:将指定节点上的样式类名替换为另一个样式类名。效果同String##replace一致

const woodenFish = {

// 封装一个用于增加/删除类名的方法

className(type) {

dom.woodenFish.classList[type]("w-f-c-i-size")

},

size() {

this.className("add")

setTimeout(() => this.className("remove"), 300)

}

}

复制代码size方法用于进行一次木鱼的缩放。调用该方法时,首先为img标签增加类w-f-c-i-size,在300毫秒后,再将该类名移除

为什么是300毫秒?因为css animation的持续时间为300毫秒

需要注意的是,size方法中的this为woodenFish对象,所以this.className就相当于woodenFish.className

关于this或其它JavaScript的问题,您可以在《JavaScript每日一题》专栏中找到对应的题目进行练习

文字浮层

const woodenFish = {

className() {},

size() {},

createText() {

const p = document.createElement("p")

p.innerText = "功德+1"

dom.text.appendChild(p)

}

}

复制代码createText方法用于创建一个p标签,该标签的文字内容为“功德+1”,随后将该标签追加在div下即可

小tip:JSX(或react)中书写HTML类型的注释

博主在此刻书写document.createElement这个原生方法时,突然想到了最近用到的一个原生属性outerHTML,该属性与innerHTML的区别就不再赘述。在JSX中书写html类型的注释,使用大括号的形式({/** */})是不可以的,因为在编译时这些东西都会被扔掉,此时可以使用由React提供的dangerouslySetInnerHTML属性,但体验感不太好。所以可以使用ouertHTML配合ref来解决,vue同理,例如:

const HtmlComment: FC<HtmlCommentType> = ({ children }) => {

const virtual = useRef<HTMLSpanElement>(null)

useEffect(() => {

virtual.current!.outerHTML = `<!-- ${children} -->`

}, [])

return <span ref={virtual} />

}

复制代码H5控制手机震动

const vibrate = () => {

const navigator = window.navigator

if (!("vibrate" in navigator)) return

navigator.vibrate =

navigator.vibrate ||

navigator.webkitVibrate ||

navigator.mozVibrate ||

navigator.msVibrate

if (!navigator.vibrate) return

// 上面的代码全是进行兼容性判断,只有下面这一行是发起手机震动的API

navigator.vibrate(300)

}

复制代码像发起手机震动这类Api,首先就要进行兼容性判断,所以上面vibrate方法的90%部分都在进行兼容性判断。注意,window.navigator提供了一个用于发起设备震动的方法,即window.navigator.vibrate

window.navigator.vibrate方法的参数:

- 一个

number类型的值

这种方式表示震动持续多长时间,例如window.navigator.vibrate(300),则表示震动持续300毫秒

- 一个

number类型的数组

这种方式表示震动、暂停间隔的时间。例如window.navigator.vibrate([100, 30, 100]),则表示先震动100毫秒,随后暂停30毫秒,然后再震动100毫秒

window.navigator.vibrate方法在震动成功时返回true,否则返回false

vibrate兼容性

浏览器全屏操作

const toggleFullScreen = () => {

if (!document.fullscreenElement)

return document.documentElement.requestFullscreen()

if (!document.exitFullscreen) return

document.exitFullscreen()

}

document.addEventListener("keydown", (e) =>

e.keyCode == 13 ? toggleFullScreen() : false

)

复制代码toggleFullScreen方法会在全屏或非全屏之间来回切换,用到了以下属性/方法:

document.fullscreenElement返回当前正在以全屏模式显示的元素,如果没有,则返回nulldocument.documentElement.requestFullscreen用于发起全屏请求。若全屏请求成功,则该函数返回成功的Promise对象,否则返回失败的Promise对象。

在全屏成功时,全屏显示的元素会触发fullscreenchange事件;类似于输入框在输入时会触发onchange事件

document.exitFullscreen方法用于使当前元素退出全屏模式

随后为document绑定keydown事件,如果按下了回车键,则在全屏/非全屏之间切换,否则不做出任何操作

音频事件操作

之前博主在写播放器的时候就发现音频的属性、方法、事件很多很多,所以此处只列举两个本项目中用到的方法

play()使播放开始pause()使播放暂停

制作完成

通过以上几个步骤就已经完成了所有要用到的东西,最后只需为木鱼注册“敲击”事件即可

dom.woodenFish.addEventListener("click", () => {

// 木鱼缩放

woodenFish.size()

// 创建文字浮层

woodenFish.createText()

// 播放敲击木鱼的声音

dom.audio.play()

// 发起手机震动

vibrate()

})

复制代码文末

从一次心血来潮,到自己从0至1完成这个简单而有趣的小项目,无论是技术角度,还是个人收获角度来讲,都是收获满满!现在您可以通过以下两个地址来 “功德+1” :

由于时间匆忙,文中错误之处在所难免,敬请读者斧正。如果您觉得本篇文章还不错,欢迎点赞收藏和关注,我们下篇文章见!

链接:https://juejin.cn/post/7199660596735164475

来源:稀土掘金

著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。

z-index不生效?让我们来掀开它的面具

前言

hi大家好,我是小鱼,今天复习的是z-index。之前以为自己很了解它,可是在工作中总会遇到一些不思其解的问题,后来去深入学习了层叠上下文、层叠等级、层叠顺序,才发现z-index只是其中的一叶小舟,今天就一起来看看它背后到底隐藏着什么。

z-index

.container {

z-index: auto | <integer> ;

}

复制代码z-index属性是允许给一个负值的。z-index属性支持 CSS3animation动画。- 在 CSS 2.1 的时候,需要配合

position属性且值不为static时使用。

这个属性大家应该都很熟悉了,指定了元素及其子元素的 在 Z 轴上面的顺序,而 Z 轴上面的顺序 可以决定当元素发生覆盖的时候,哪个元素在上面。 z-index值大的元素会覆盖较低的。

不知道大家在工作中有没有遇到过这种情况,明明给其设置了z-index并且也设置了position不为static,但是样式并不是你所想的那样。可能这里大家对z-index不太了解,判断元素在Z轴上的顺序,不仅仅是z-index值的大小,接下来给大家解释层叠上下文、层叠等级和层叠顺序。

层叠上下文

层叠上下文(stacking context),是HTML中一个三维的概念。如果一个元素含有层叠上下文,我们可以理解为这个元素在Z轴上就“高人一等”。

大家应该都玩过王者荣耀,里面的段位就是一个层级概念。你可以把「层叠上下文」理解为上了最强王者的人,还有很多没上王者的人,我们可以看成是菜鸡。那王者选手和菜鸡之间就形成了一个差距,这个差距也就是在Z轴上的距离,王者选手离荣耀王者就更近了一步,这里的“荣耀王者”可以看成是我们的屏幕观察者。

这样抽象解释完大家应该明白了什么是层叠上下文。继续往下看↓

层叠等级

层叠等级(stacking level),决定了同一个层叠上下文中元素在Z轴上的显示顺序。这里又牵扯出一个level,那么这个等级指的又是什么呢?

所有的元素都有层叠等级,包括层叠上下文元素,层叠上下文元素的层叠等级可以理解为是什么普通王者,无双,荣耀传奇之类。然后,对于普通元素的层叠等级,我们的探讨仅仅局限在当前层叠上下文元素中。为什么呢?因为否则没有意义。

还是回到王者荣耀,元素具有层叠上下文就相当于是王者段位,但是王者里面又分为普通王者,无双王者和荣耀王者还有传奇王者,那我们如果拿普通王者的韩信和传奇王者的韩信相比较实际上是没有意义的,那不吊打吗,那他牛不牛逼是由段位决定的(排除一些意外情况哈哈哈)。

层叠上下文的创建

说白了就是一个元素如何才能变成层叠上下文元素?

层叠上下文是由一些特点的CSS属性创建的,分为三点:

- 页面根元素天生具有层叠上下文,称之为“根层叠上下文”。

- 普通元素设置

position属性为非static值并设置z-index属性为具体数值,产生层叠上下文。 - 其他CSS3中的新属性也可以

flex容器的子元素,且z-index值不为auto- grid 容器的子元素,且 z-index 值不为

auto opacity属性值小于 1 的元素transform属性值不为none的元素filter属性值不为none的元素isolation属性值为isolate的元素-webkit-overflow-scrolling属性值为touch的元素;

简单写两个例子

栗子一

.box1,.box2 {

position: relative;

width: 100px;

height: 100px;

}

.a,.c {

width: 100px;

height: 100px;

position: absolute;

font-size: 20px;

padding: 5px;

color: white;

border: 1px solid rgb(119, 119, 119);

}

.a {

background-color: rgb(0, 163, 168);

z-index: 1;

}

.c {

background-color: rgb(0, 168, 84);

z-index: 2;

left: 50px;

top: -50px;

}

<div class="box1">

<div class="a">A</div>

</div>

<div class="box2">

<div class="c">C</div>

</div>

复制代码

因为box1,box2都没有设置

z-index,所以没有创建层叠上下文,所以其子元素都处于‘根层叠上下文’中,在同一个层叠上下文领域,层叠水平值大的那一个覆盖小的那一个。

栗子2

只帖了修改部分

.box1 {

z-index: 2;

}

.box2 {

z-index: 1;

}

.a {

background-color: rgb(0, 163, 168);

z-index: 1;

}

.b {

background-color: rgb(21, 84, 180);

z-index: 2;

left: 50px;

top: 50px;

}

.c {

background-color: rgb(0, 168, 84);

z-index: 999;

left: 100px;

top: 50px;

}

复制代码

大家可以发现我们给C盒子设置的

z-index为999远大于A、B两个盒子,效果却出现在他俩下面。那是因为给两个父盒子分别设置了z-index,创建了两个不同的层叠上下文,而box1的z-index值大,所以排在上面,这里验证了层叠等级。

栗子3

有一个父元素绝对定位,它有一个子元素也是绝对定位,父元素z-index大于子元素z-index,为何子元素还是在父元素的上面?如何让这个子元素放在父元素的下面。

.parent {

width: 100%;

height: 500px;

background-color: rgb(243, 151, 45);

position: absolute;

z-index: 1;

}

.child {

width: 20%;

height: 150px;

background-color: rgb(211, 56, 56);

position: absolute;

z-index: 0;

}

<div class="parent">

<div class="child">C</div>

</div>

复制代码效果却是这样

解决方案

因为父元素和子元素之间,z-index是无法对比的,同级之间的z-index才能对比。可以考虑换一种方式,两个div做同级,外面包一层父元素,根据共同的父元素定位、做层级区分就可以。

父元素不指定 z-index, 而子元素 z-index 为 -1

结论

普通元素的层叠等级优先由层叠上下文决定,所以,层叠等级的比较只有在当前层叠上下文元素中才有意义。

层叠顺序

层叠顺序(stacking order),表示元素发生层叠时候有着特定的垂直显示顺序,注意,这里跟上面两个不一样,上面的层叠上下文和层叠等级是概念,而这里的层叠顺序是规则。

上图↓

在不考虑CSS3的情况下,当元素发生层叠时,层叠顺序遵循上面图中的规则。

这里稍微解释下为什么内联元素的层叠顺序要比浮动元素和块状元素都高?有些同学可能觉得浮动元素和块状元素要更屌一点,图中我标注了内联样式是内容,因为网页中最重要的是内容,文字和浮动图片的时候优先确保显示文字。

层叠准则

- 谁大谁上: 当具有明显层叠等级的时候,在同一个层叠上下文领域,

z-indx大的那一个覆盖小的那一个。 - 后来居上: 当元素的层叠等级一致、层叠顺序相同的时候,在DOM流中处于后面的元素会覆盖前面的元素。

栗子4

.box1,.box2 {

position: relative;

width: 100px;

height: 100px;

}

.box1 {

z-index: 0;

}

.box2 {

z-index: 0;

}

.a,.c {

width: 100px;

height: 100px;

position: absolute;

font-size: 20px;

padding: 5px;

color: white;

border: 1px solid rgb(119, 119, 119);

}

.a {

background-color: rgb(0, 163, 168);

z-index: 999;

}

.c {

background-color: rgb(0, 168, 84);

z-index: 1;

left: 50px;

top: -50px;

}

<div class="box1">

<div class="a">A</div>

</div>

<div class="box2">

<div class="c">C</div>

</div>

复制代码

上面给两个父盒子都设置了

z-index为0,这里要注意z-index一旦变成数值,哪怕是0,都会创建一个层叠上下文。当然层叠规则就发生了变化,子元素的层叠顺序比较变成了优先比较其父级的层叠上下文的层叠顺序,尽管a盒子的z-index为999。又由于两个父级都是z-index:0,层叠顺序这一块一样大,这个时候就遵循后来居上原则,根据DOM流中的位置决定谁在上面。也可以说子元素上面的z-index失效了!

end

回顾自己以前使用z-index都不太规范或者滥用,以后一定改正!

链接:https://juejin.cn/post/7158409848692932621

来源:稀土掘金

著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。

为什么有公司规定所有接口都用Post?

看到这个标题,你肯定觉得离谱。怎么会有公司规定所有接口都用Post,是架构菜还是开发菜。这可不是夸大其词,这样的公司不少。

在特定的情况下,规定使用Post可以减少不少的麻烦,一起看看。

Answer the question

我们都知道,get请求一半用来获取服务器信息,post一般用来更新信息。get请求能做的,post都能做,get请求不能做的,post也都能做。

如果你的团队都是大佬,或者有着良好的团队规范,所有人都在平均水平线之上,并且有良好的纠错机制,那基本不会制定这样的规则。

但如果团队成员水平参差不齐,尤其是小团队,创业团队,常常上来就开干,没什么规范,纯靠开发者个人素质决定代码质量,这样的团队就不得不制定这样的规范。

毕竟可以减少非常多的问题,Post不用担心URL长度限制,也不会误用缓存。通过一个规则减少了出错的可能,这个决策性价比极高。

造成的结果:公司有新人进来,什么lj公司,还有这种要求,回去就在群里讲段子。

实际上都是有原因的。

有些外包公司或者提供第三方接口的公司也会选择只用Post,就是图个方便。

最佳实践

可能各位大佬都懂了哈,我还是给大家科普下,GET、POST、PUT、DELETE,他们的区别和用法。

GET

GET 方法用于从服务器检索数据。这是一种只读方法,因此它没有改变或损坏数据的风险,使用 GET 的请求应该只被用于获取数据。

GET API 是幂等的。 每次发出多个相同的请求都必须产生相同的结果,直到另一个 API(POST 或 PUT)更改了服务器上资源的状态。

POST

POST 方法用于将实体提交到指定的资源,通常导致在服务器上的状态变化或创建新资源。POST既不安全也不幂等,调用两个相同的 POST 请求将导致两个不同的资源包含相同的信息(资源 ID 除外)。

PUT

主要使用 PUT API更新现有资源(如果资源不存在,则 API 可能决定是否创建新资源)。

DELETE

DELETE 方法删除指定的资源。DELETE 操作是幂等的。如果您删除一个资源,它会从资源集合中删除。

| GET | POST | PUT | DELETE | |

|---|---|---|---|---|

| 请求是否有主体 | 否 | 是 | 是 | 可以有 |

| 成功的响应是否有主体 | 是 | 是 | 否 | 可以有 |

| 安全 | 是 | 否 | 否 | 否 |

| 幂等 | 是 | 否 | 是 | 是 |

| 可缓存 | 是 | 否 | 否 | 否 |

| HTML表单是否支持 | 是 | 是 | 否 | 否 |

来源:https://juejin.cn/post/7129685508589879327

异步阻塞IO是什么鬼?

这篇文章我们来聊一个很简单,但是很多人往往分不清的一个问题,同步异步、阻塞非阻塞到底怎么区分?

开篇先问大家一个问题:IO多路复用是同步IO还是异步IO?

先思考一下,再继续往下读。

巨著《Unix网络编程》将IO模型划分为5种,分别是

- 阻塞IO

- 非阻塞IO

- IO复用

- 信号驱动IO

- 异步IO

个人认为这么分类并不是很好,因为从字面上理解阻塞IO和非阻塞IO就已经是数学意义上的全集了,怎么又冒出了后边3种模型,会给初学者带来一些困扰。

接下来进入正文。

文章首发于公众号:「蝉沐风的码场」

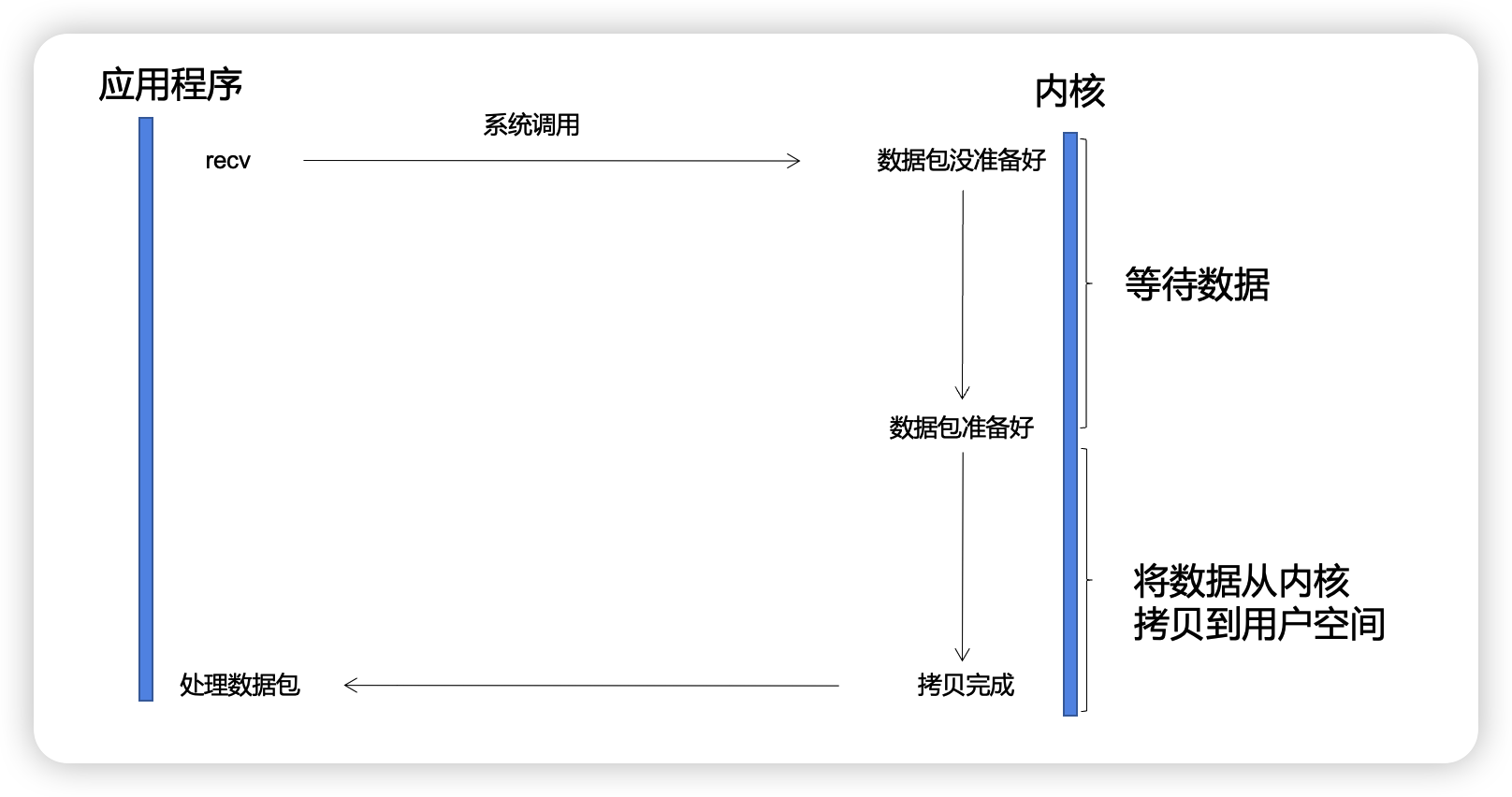

1. 一个简单的IO流程

让我们先摒弃我们原本熟知的各种IO模型流程图,先看一个非常简单的IO流程,不涉及任何阻塞非阻塞、同步异步概念的图。

客户端发起系统调用之后,内核的操作可以被分成两步:

等待数据

此阶段网络数据进入网卡,然后网卡将数据放到指定的内存位置,此过程CPU无感知。然后经过网卡发起硬中断,再经过软中断,内核线程将数据发送到socket的内核缓冲区中。

数据拷贝

数据从socket的内核缓冲区拷贝到用户空间。

2. 阻塞与非阻塞

阻塞与非阻塞在API上区别在于socket是否设置了SOCK_NONBLOCK这个参数,默认情况下是阻塞的,设置了该参数则为非阻塞。

2.1 阻塞

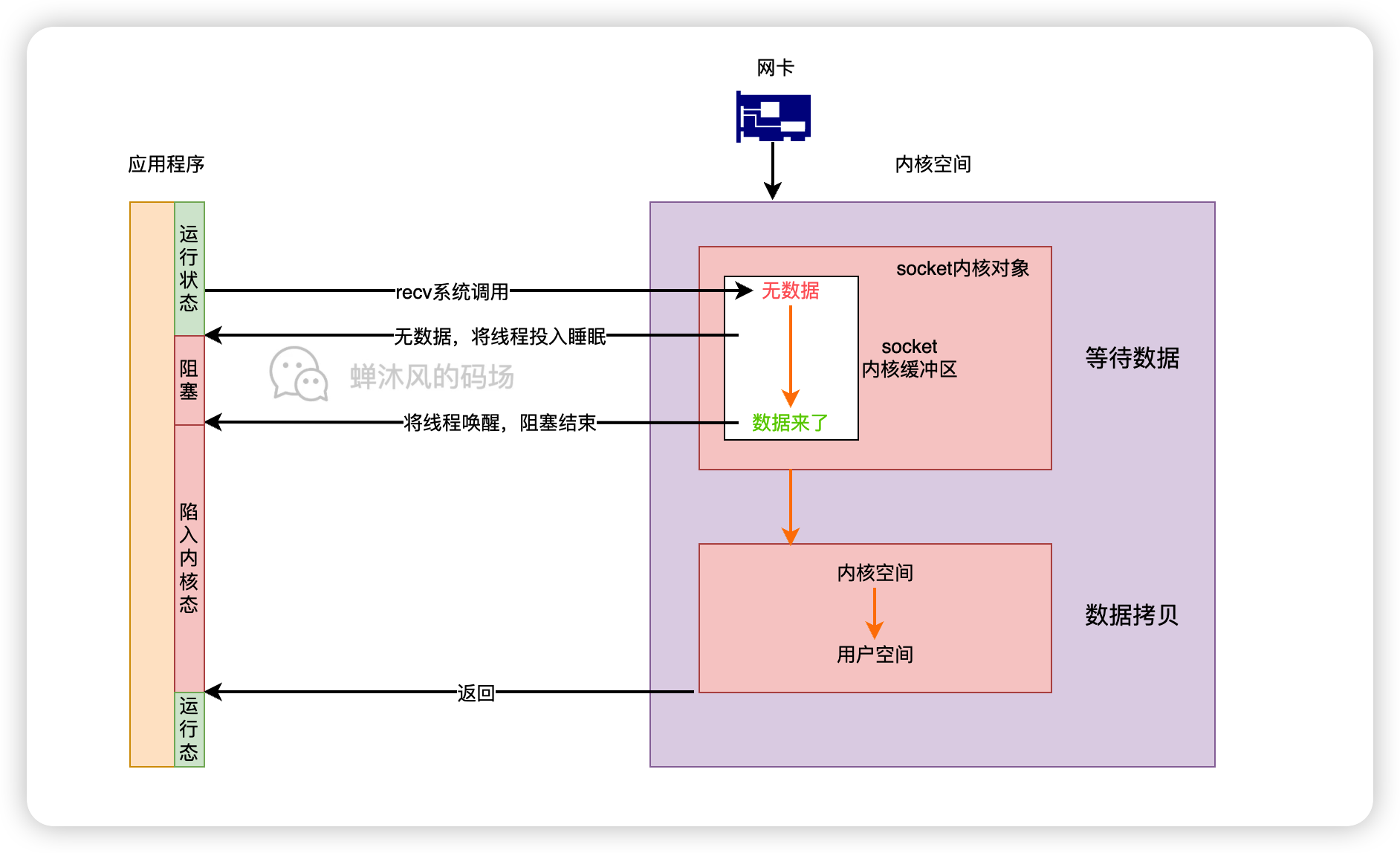

假设socket为阻塞模式,则IO调用如下图所示。

当处于运行状态的用户线程发起recv系统调用时,如果socket内核缓冲区内没有数据,则内核会将当前线程投入睡眠,让出CPU的占用。

直到网络数据到达网卡,网卡DMA数据到内存,再经过硬中断、软中断,由内核线程唤醒用户线程。

此时socket的数据已经准备就绪,用户线程由用户态进入到内核态,执行数据拷贝,将数据从内核空间拷贝到用户空间,系统调用结束。此阶段,开发者通常认为用户线程处于等待(称为阻塞也行)状态,因为在用户态的角度上,线程确实啥也没干(虽然在内核态干得累死累活)。

2.2 非阻塞

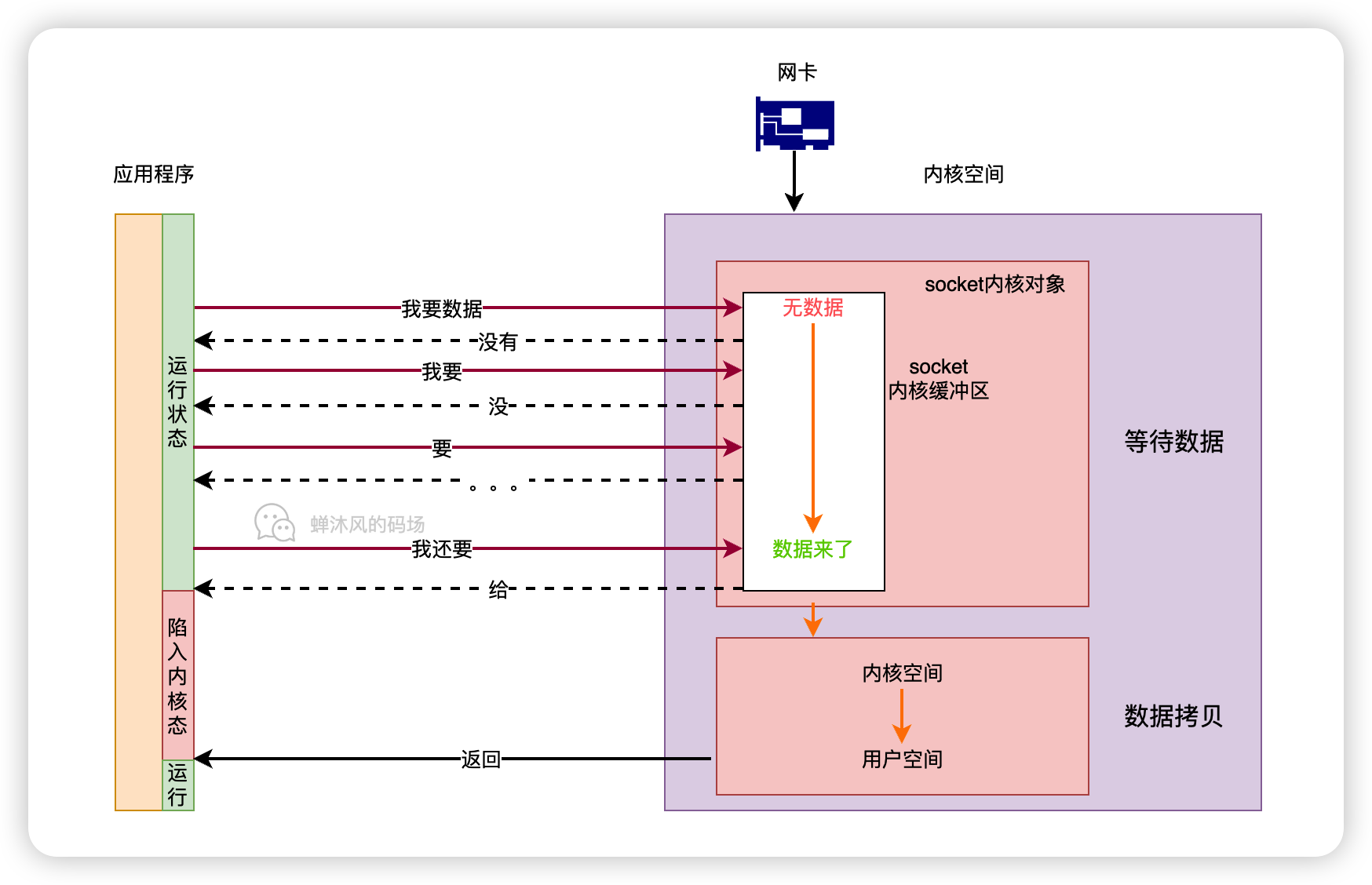

如果将socket设置为非阻塞模式,调用便换了一副光景。

用户线程发起系统调用,如果socket内核缓冲区中没有数据,则系统调用立即返回,不会挂起线程。而线程会继续轮询,直到socket内核缓冲区内有数据为止。

如果socket内核缓冲区内有数据,则用户线程进入内核态,将数据从内核空间拷贝到用户空间,这一步和2.1小节没有区别。

3. 同步与异步

同步和异步主要看请求发起方对消息结果的获取方式,是主动获取还是被动通知。区别主要体现在数据拷贝阶段。

3.1 同步

同步我们其实已经见识过了,2.1节和2.2节中的数据拷贝阶段其实都是同步!

注:把同步的流程画在阻塞和非阻塞的第二阶段,并不是说阻塞和非阻塞的第二阶段只能搭配同步手段!

同步指的是数据到达socket内核缓冲区之后,由用户线程参与到数据拷贝过程中,直到数据从内核空间拷贝到用户空间。

因此,IO多路复用,对于应用程序而言,仍然只能算是一种同步,因为应用程序仍然花费时间等待IO结果,等待期间CPU要么用于遍历文件描述符的状态,要么用于休眠等待事件发生。

以select为例,用户线程发起select调用,会切换到内核空间,如果没有数据准备就绪,则用户线程阻塞到有数据来为止,select调用结束。结束之后用户线程获取到的只是「内核中有N个socket已经就绪」的这么一个信息,还需要用户线程对着1024长度的描述符数组进行遍历,才能获取到socket中的数据,这就是同步。

举个生活中的例子,我们给物流客服打电话询问我们的包裹是否已到达,如果未到达,我们就先睡一会儿,等到了之后客服给我们打电话把我们喊起来,然后我们屁颠屁颠地去快递驿站拿快递。这就是同步阻塞。

如果我们不想睡,就一直打电话问,直到包裹到了为止,然后再屁颠屁颠地去快递驿站拿快递。这就是同步非阻塞。

问题就是,能不能直接让物流的人把快递直接送到我家,别让我自己去拿啊!这就是异步。

3.2 理想的异步

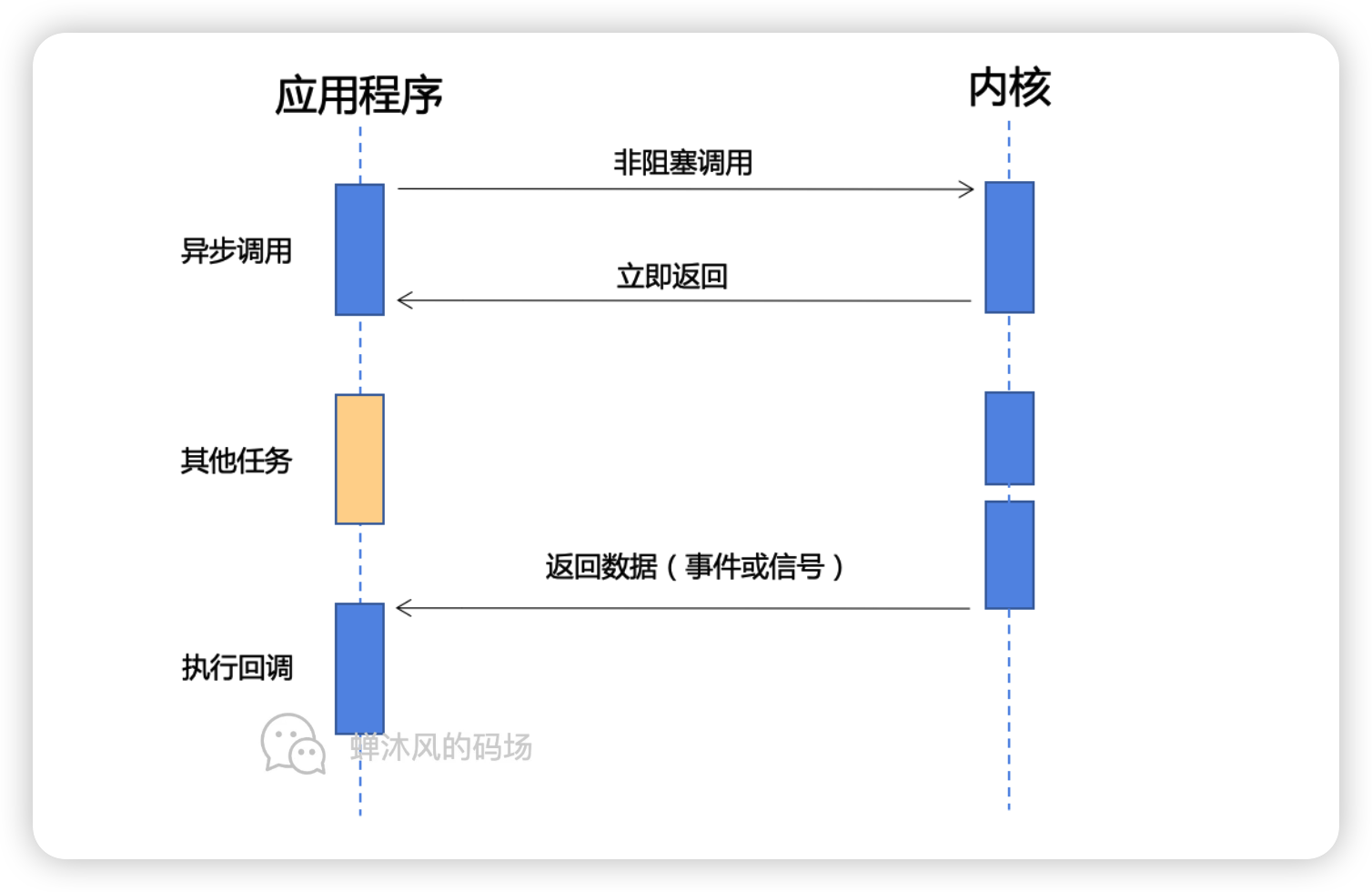

我们理想中的完美异步应该是用户进程发起非阻塞调用,内核直接返回结果之后,用户线程可以立即处理下一个任务,只需要IO完成之后通过信号或回调函数的方式将数据传递给用户线程。如下图所示。

因此,在理想的异步环境下,数据准备阶段和数据拷贝阶段都是由内核完成的,不会对用户线程进行阻塞,这种内核级别的改进自然需要操作系统底层的功能支持。

3.3 现实的异步

现实比理想要骨感一些。

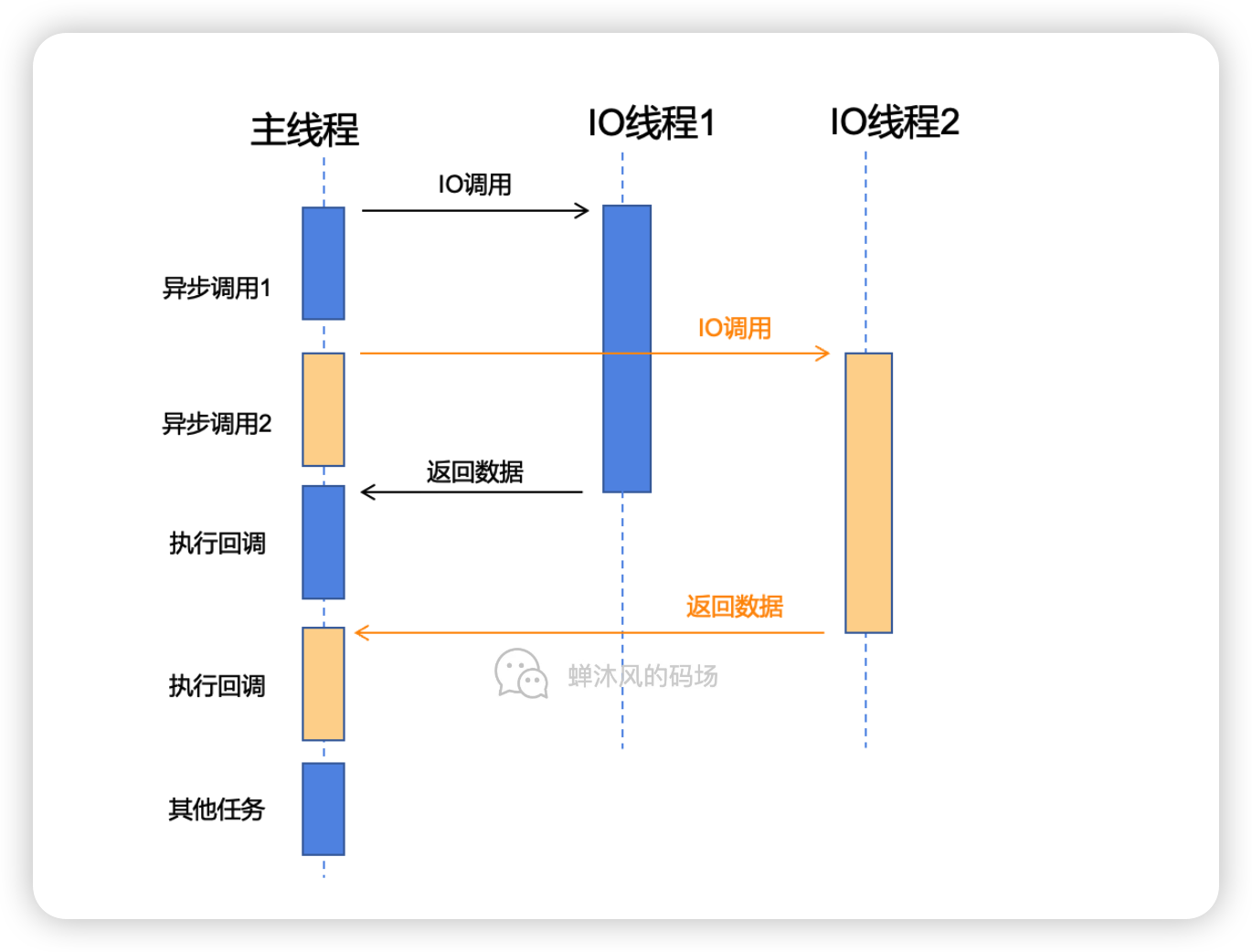

Linux内核并没有太惹眼的异步IO机制,这难不倒各路大神,比如Node的作者采用多线程模拟了这种异步效果。

比如让某个主线程执行主要的非IO逻辑操作,另外再起多个专门用于IO操作的线程,让IO线程进行阻塞IO或者非阻塞IO加轮询的方式来完成数据获取,通过IO线程和主线程之间通信进行数据传递,以此来实现异步。

还有一种方案是Windows上的IOCP,它在某种程度上提供了理想的异步,其内部依然采用的是多线程的原理,不过是内核级别的多线程。

遗憾的是,用Windows做服务器的项目并不是特别多,期待Linux在异步的领域上取得更大的进步吧。

4. 异步阻塞?

说完了同步异步、阻塞非阻塞,一个很自然的操作就是对他们进行排列组合。

- 同步阻塞

- 同步非阻塞

- 异步非阻塞

- 异步阻塞

但是异步阻塞是什么鬼?按照上文的解释,该IO模型在第一阶段应该是用户线程阻塞,等待数据;第二阶段应该是内核线程(或专门的IO线程)处理IO操作,然后把数据通过事件或者回调的方式通知用户线程,既然如此,那么第一步的阻塞完全没有必要啊!非阻塞调用,然后继续处理其他任务岂不是更好。

因此,压根不存在异步阻塞这种模型哦~

5. 千万分清主语是谁

最后给各位提个醒,和别人讨论阻塞非阻塞的时候千万要带上主语。

如果我问你,epoll是阻塞还是非阻塞?你怎么回答?

应该说,epoll_wait这个函数本身是阻塞的,但是epoll会将socket设置为非阻塞。因此单纯把epoll认为阻塞是太委屈它,认为其是非阻塞又抬举它。

具体关于epoll的说明可以参见IO多路复用中的epoll部分。

链接:https://juejin.cn/post/7199809805362495546

来源:稀土掘金

著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。

你还在傻傻的npm run serve吗?快来尝尝这个!

背景

大家在日常开发中应该经常会有需要切换不同环境地址的情况。当一个项目代码切换环境地址时,vue-cli没有能够感知文件的变化,所以代理的还是旧的地址,所以通常我们需要执行npm run serve进行项目重跑,而项目重跑往往意味着长时间的等待,非常痛苦!

方案调研

事实上,其实我们只是需要重启webpack为我们启动的proxy代理服务,或许能够从webpack的代理服务插件中找到解决方法。

从webpack官网可以看到proxy服务其实是由

http-proxy-middleware提供的,或许我们能够从中找到解决方法。

初步方案

在http-proxy-middleware的配置选项中,除了我们常见的target,还有router。router返回一个字符串的服务地址,当两个选项都配置了的情况下,会优先使用router函数的返回值,只有当router的返回值不可用时,才会使用target的值。

我们可以利用这一点来重新配置我们的项目代码。参考文档在这里

// vue.config.js

const { defineConfig } = require('@vue/cli-service')

const { proxy } = require('./environments/proxy.js')

module.exports = defineConfig({

devServer:{

proxy

},

})

复制代码// proxy.js

const fs = require('fs')

const path = require('path')

const encoding = 'utf-8'

const getContent = filename => {

const dir = path.resolve(process.cwd(), 'environments')

return fs.readFileSync(path.resolve(dir, filename), { encoding })

}

const jsonParse = obj => { return Function('"use strict";return (' + obj + ')')() }

const getConfig = () => { try {

return jsonParse(getContent('proxy-config.json'))

} catch (e) { return {} } }

module.exports = {

proxy: {

// 接口匹配规则自行修改

'/api': {

// 这里必须要有字符串来进行占位

// 如果报错Invaild Url,将target改成有效的url字符串即可,如http://localhost:9001

target: 'that must have a empty placeholder',

changeOrigin: true,

router: () => (getConfig() || {}).target || ''

}

}

}

复制代码// proxy-config.json

{ "target": "http://localhost:9001" }

复制代码自此,当我们需要修改环境地址时,只需要修改proxy-config.json文件便能够实时生效,不再需要npm run serve!

重点代码分析

实现代码中其实最主要的就是getContent这个方法,我们项目在每次发起http请求时都会调用router中的函数,而getContent则会通过node的fs服务,对我们的环境地址文件进行实时读取,从而指向我们最新修改的环境地址。

方案总结

在按照参考文档配置了项目代码之后,我们发现确实能够及时指向新的环境地址,再也不需要重启代码,不需要长时间的等待了。但是,我们多了两个需要维护的文件,每次我们修改环境地址时,不仅需要修改config中的api,还需要修改proxy-config.json中的target!

有没有可能在只需要修改config文件的情况下,实现代理地址动态修改呢?

方案优化

从上面的重点代码分析中,可以看到只要我们可以在router函数执行时,拿到正确的config文件中导出的api属性的值,也可以实现同样的效果!

这是不是意味着只要我们在函数中对config文件进行require请求,读取api的值,再return出去就能及时修改代理指向了呢?

没错,你会发现无论你怎么修改,函数内require取到的api永远是不变的,还是服务刚启动时的环境地址。

参考源码可以知道,这是因为我们在使用require请求文件信息时,node会解析出我们传入的字符串的文件路径的绝对路径,并且以绝对路径为键值,对该文件进行缓存。

因此,如果我们在执行require函数时打断点进行观察的话,会发现require上面有一个cache缓存了已经加载过的文件。

这也恰恰说明了只要我们能够删除掉文件保存在require中的缓存,我们就能够拿到最新的文件内容,那么我们也可以据此得出我们的最终优化方案。

// vue.config.js

const hotRequire = modulePath => {

// require.resolve可以通过相对路径获取绝对路径

// 以绝对路径为键值删除require中的对应文件的缓存

delete require.cache[require.resolve(modulePath)]

// 重新获取文件内容

const target = require(modulePath)

return target

}

...

proxy: {

'/api': {

// 如果router有效优先取router返回的值

target: 'that must have a empty placeholder',

changeOrigin: true,

// 每次发起http请求都会执行router函数

router: () => (hotRequire('./src/utils/config') || {}).api || '',

ws: true,

pathRewrite: {

'^/api': ''

}

}

}

复制代码自此,我们项目修改环境地址将不在需要重启项目,也不需要维护额外的文件夹,再也不需要痛苦等待了!

来源:https://juejin.cn/post/7198696282336313400

从 微信 JS-SDK 认识 JSBridge

前言

前段时间由于要实现 H5 移动端拉取微信卡包并同步卡包数据的功能,于是在项目中引入了 微信 JS-SDK(jweixin) 相关包实现功能,但也由此让我对其产生了好奇心,于是打算好好了解下相关的内容,通过查阅相关资料发现这其实属于 JSBridge 的一种实现方式。

因此,只要了解 JSBridge 就能明白 微信 JS-SDK 是怎么一回事。

为什么需要 JSBridge?

相信大多数人都有相同的经历,第一次了解到关于 JSBridge 都是从 微信 JS-SDK(WeiXinJSBridge) 开始,当然如果你从事的是 Hybrid 应用 或 React-Native 开发的话相信你自然(应该、会)很了解。

其实 JSBridge 早就出现并被实际应用了,如早前桌面应用的消息推送等,而在移动端盛行的时代已经越来越需要 JSBridge,因为我们期望移动端(Hybrid 应用 或 React-Native)能做更多的事情,其中包括使用 客户端原生功能 提供更好的 交互 和 服务 等。

然而 JavaScript 并不能直接调用和它不同语言(如 Java、C/C++ 等)提供的功能特性,因此需要一个中间层去实现 JavaScript 与 其他语言 间的一个相互协作,这里通过一个 Node 架构来进行说明。

Node 架构

核心内容如下:

顶层 Node Api

- 提供 http 模块、流模块、fs文件模块等等,

可以通过 JavaScript 直接调用

- 提供 http 模块、流模块、fs文件模块等等,

中间层 Node Bindings

- 主要是使 JavaScript 和 C/C++ 进行通信,原因是 JavaScript 无法直接调用 C/C++ 的库(libuv),需要一个中间的桥梁,node 中提供了很多 binding,这些称为

Node bindings

- 主要是使 JavaScript 和 C/C++ 进行通信,原因是 JavaScript 无法直接调用 C/C++ 的库(libuv),需要一个中间的桥梁,node 中提供了很多 binding,这些称为

底层 V8 + libuv

- v8 负责解释、执行顶层的 JavaScript 代码

- libuv 负责提供 I/O 相关的操作,其主要语言是

C/C++语言,其目的就是实现一个 跨平台(如 Windows、Linux 等)的异步 I/O 库,它直接与操作系统进行交互

这里不难发现 Node Bindings 就有点类似 JSBridge 的功能,所以 JSBridge 本身是一个很简单的东西,其更多的是 一种形式、一种思想。

为什么叫 JSBridge?

Stack Overflow 联合创始人 Jeff Atwood 在 2007 年的博客《The Principle of Least Power》中认为 “任何可以使用 JavaScript 来编写的应用,并最终也会由 JavaScript 编写”,后来 JavaScript 的发展确实非常惊人,现在我们可以基于 JavaScript 来做各种事情,比如 网页、APP、小程序、后端等,并且各种相关的生态越来越丰富。

作为 Web 技术逻辑核心的 JavaScript 自然而然就需要承担与 其他技术 进行『桥接』的职责,而且任何一个 移动操作系统 中都会包含 运行 JavaScript 的容器环境,例如 WebView、JSCore 等,这就意味着 运行 JavaScript 不用像运行其他语言时需要额外添加相应的运行环境。

JSBridge应用在国内真正流行起来则是因为 微信 的出现,当时微信的一个主要功能就是可以在网页中通过JSBridge来实现 内容分享。

JSBridge 能做什么?

举个最常见的前端和后端的例子,后端只提供了一个查找接口,但是没有提供更新接口,那么对于前端来讲就是再想实现更新接口,也是没有任何法子的!

同样的,JSBridge 能做什么得看原生端给 JavaScript 提供调用 Native 什么功能的接口,比如通过 微信 JS-SDK 网页开发者可借助微信使用 拍照、选图、语音、位置 等手机系统的能力,同时可以直接使用 微信分享、扫一扫、卡券、支付 等微信特有的能力。

JSBridge 作为 JavaScript 与 Native 之间的一个 桥梁,表面上看是允许 JavaScript 调用 Native 的功能,但其核心是建立 Native 和 非 Native 间消息 双向通信 通道。

双向通信的通道:

JavaScript 向 Native 发送消息:

- 调用 Native 功能

- 通知 Native 当前 JavaScript 的相关状态等

Native 向 JavaScript 发送消息:

- 回溯调用结果

- 消息推送

- 通知 JavaScript 当前 Native 的状态等

JSBridge 是如何实现的?

JavaScript 的运行需要 JS 引擎的支持,包括 Chrome V8、Firefox SpiderMonkey、Safari JavaScriptCore 等,总之 JavaScript 运行环境 是和 原生运行环境 是天然隔离的,因此,在 JSBridge 的设计中我们可以把它 类比 成 JSONP 的流程:

- 客户端通过

JavaScript定义一个回调函数,如:function callback(res) {...},并把这个回调函数的名称以参数的形式发送给服务端 - 服务端获取到

callback并携带对应的返回数据,以JS脚本形式返回给客户端 - 客户端接收并执行对应的

JS脚本即可

JSBridge 实现 JavaScript 调用的方式有两种,如下:

JavaScript调用NativeNative调用JavaScript

在开始分析具体内容之前,还是有必要了解一下前置知识 WebView。

WebView 是什么?

WebView 是 原生系统 用于 移动端 APP 嵌入 Web 的技术,方式是内置了一款高性能 webkit 内核浏览器,一般会在 SDK 中封装为一个 WebView 组件。

WebView 具有一般 View 的属性和设置外,还对 url 进行请求、页面加载、渲染、页面交互进行增强处理,提供更强大的功能。

WebView 的优势 在于当需要 更新页面布局 或 业务逻辑发生变更 时,能够更便捷的提供 APP 更新:

- 对于

WebView而言只需要修改前端部分的Html、Css、JavaScript等,通知用户端进行刷新即可 - 对于

Native而言需要修改前端内容后,再进行打包升级,重新发布,通知用户下载更新,安装后才可以使用最新的内容

微信小程序中的 WebView

小程序的主要开发语言是 JavaScript ,其中 逻辑层 和 渲染层 是分开的,分别运行在不同的线程中,而其中的渲染层就是运行在 WebView 上:

| 运行环境 | 逻辑层 | 渲染层 |

|---|---|---|

| iOS | JavaScriptCore | WKWebView |

| 安卓 | V8 | chromium 定制内核 |

| 小程序开发者工具 | NWJS | Chrome WebView |

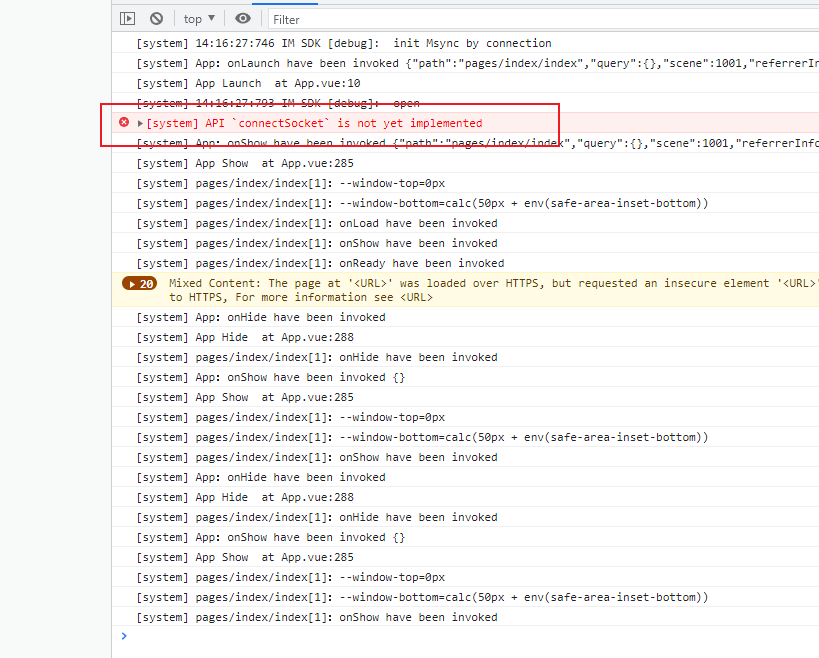

在开发过程中遇到的一个 坑点 就是:

- 在真机中,需要实现同一域名下不同子路径的应用实现数据交互(纯前端操作,不涉及接口),由于同域名且是基于同一个页面进行跳转的(当然只是看起来是),而且这个数据是 临时数据,因此觉得使用

sessionStorage实现数据交互是很合适的 - 实际上从 A 应用 跳转到 B 应用 中却无法获取对应的数据,而这是因为 sessionStorage 是基于当前窗口的会话级的数据存储,移动端浏览器 或 微信内置浏览器 中在跳转新页面时,可能打开的是一个新的 WebView,这就相当于我们在浏览器中的一个新窗口中进行存储,因此是没办法读取在之前的窗口中存储的数据

JavaScript 调用 Native — 实现方案一

通过 JavaScript 调用 Native 的方式,又会分为:

- 注入 API

- 劫持 URL Scheme

- 弹窗拦截

【 注入 API 】

核心原理:

- 通过

WebView提供的接口,向JavaScript的上下文(window)中注入 对象 或者 方法 - 允许

JavaScript进行调用时,直接执行相应的Native代码逻辑,实现JavaScript调用Native

这里不通过 iOS 的 UIWebView 和 WKWebView 注入方式来介绍了,感兴趣可以自行查找资料,咱们这里直接通过 微信 JS-SDK 来看看。

当通过 的方式引入 JS-SDK 之后,就可以在页面中使用和 微信相关的 API,例如:

// 微信授权

window.wx.config(wechatConfig)

// 授权回调

window.wx.ready(function () {...})

// 异常处理

window.wx.error(function (err) {...})

// 拉起微信卡包

window.wx.invoke('chooseInvoice', invokeConf, function (res) {...})如果通过其内部编译打包后的代码(简化版)来看的话,其实不难发现:

- 其中的

this(即参数e)此时就是指向全局的window对象 - 在代码中使用的

window.wx实际上是e.jWeixin也是其中定义的N对象 - 而在

N对象中定义的各种方法实际上又是通过e.WeixinJSBridge上的方法来实际执行的 e.WeixinJSBridge就是由 微信内置浏览器 向window对象中注入WeiXinJsBridge接口实现的!(function (e, n) {

'function' == typeof define && (define.amd || define.cmd)

? define(function () {

return n(e)

})

: n(e, !0)

})(this, function (e, n) {

...

function i(n, i, t) {

e.WeixinJSBridge

? WeixinJSBridge.invoke(n, o(i), function (e) {

c(n, e, t)

})

: u(n, t)

}

if (!e.jWeixin) {

var N = {

config(){

i(...)

},

ready(){},

error(){},

...

}

return (

S.addEventListener(

'error',callback1,

!0

),

S.addEventListener(

'load',callback2,

!0

),

n && (e.wx = e.jWeixin = N),

N

)

}

})

【 劫持 URL Scheme 】

URL Scheme 是什么?

URL Scheme 是一种特殊的 URL,一般用于在 Web 端唤醒 App(或是跳转到 App 的某个页面),它能方便的实现 App 间互相调用(例如 QQ 和 微信 相互分享讯息)。

URL Scheme 的形式和 普通 URL(如:https://www.baidu.com)相似,主要区别是 protocol 和 host 一般是对应 APP 自定义的。

通常当 App 被安装后会在系统上注册一个 自定义的 URL Scheme,比如 weixin:// 这种,所以我们在手机浏览器里面访问这个 scheme 地址,系统就会唤起对应的 App。

例如,当在浏览器中访问 weixin:// 时,浏览器就会询问你是否需要打开对应的 APP:

劫持原理

Web 端通过某种方式(如 iframe.src)发送 URL Scheme 请求,之后 Native 拦截到请求并根据 URL Scheme 和 携带的参数 进行对应操作。

例如,对于谷歌浏览器可以通过 chrome://version/、chrome://chrome-urls/、chrome://settings/ 定位到不同的页面内容,假设 跳转到谷歌的设置页并期望当前搜索引擎改为百度,可以这样设计 chrome://settings/engine?changeTo=baidu&callbak=callback_id:

- 谷歌客户端可以拦截这个请求,去解析对应参数

changeTo来修改默认引擎 - 然后通过

WebView上面的callbacks对象来根据callback_id进行回调

以上只是一个假设哈,并不是说真的可以这样去针对谷歌浏览器进行修改,当然它要是真的支持也不是不可以。

是不是感觉确实和 JSONP 的流程很相似呀 ~ ~【 弹窗拦截 】

弹窗拦截核心:利用弹窗会触发 WebView 相应事件来实现的。

一般是在通过拦截 Prompt、Confirm、Alert 等方法,然后解析它们传递过来的消息,但这种方法存在的缺陷就是 iOS 中的 UIWebView 不支持,而且 iOS 中的 WKWebView 又有更好的 scriptMessageHandler,因此很难统一。

Native 调用 JavaScript — 实现方案二

Native 调用 JavaScript 的方式本质就是 执行拼接 JavaScript 字符串,这就好比我们通过 eval() 函数来执行 JavaScript 字符串形式的代码一样,不同的系统也有相应的方法执行 JavaScript 脚本。

Android

在 Android 中需要根据版本来区分:

安卓 4.4 之前的版本使用

loadUrl()loadUrl()不能获取JavaScript执行后的结果,这种方式更像在的href属性中编写的JavaScript代码webView.loadUrl("javascript:foo()")

安卓 4.4 以上版本使用

evaluateJavascript()webView.evaluateJavascript("javascript:foo()", null);IOS

UIWebView中通常使用stringByEvaluatingJavaScriptFromStringresults = [self.webView stringByEvaluatingJavaScriptFromString:"foo()"];WKWebView中通常使用evaluateJavaScript[self.webView evaluateJavaScript:@"document.body.offsetHeight;" completionHandler:^(id _Nullable response, NSError * _Nullable error) {

// 获取返回值

}];最后

来源:segmentfault.com/a/1190000043417038

开始!使用node搭建一个小页面

介绍

这个小demo是Node.js, Express, MongoDB & More: The Complete Bootcamp系列课程的第一个demo,本篇文章主要介绍实现过程以及可能带来的思考。

完成展示

首页

详情页面

前置知识

首先我们需要了解一些知识,以便完成这个demo

fs

首先是node对文件的操作,也就是fs模块。本文只介绍一些简单的操作,大部分是例子中需要用到的方法。想要了解更多可以去API文档去查找。

首先引入fs模块:const fs = require("fs");

readFileSync

const textIn = fs.readFileSync("./txt/append.txt", "utf-8");

复制代码上面代码展示的是readFileSync的使用,两个参数中,第一个参数是要读取文件的位置,第二个参数是编码格式encoding。如果指定encoding返回一个字符串,否则返回一个Buffer。

writeFileSync

fs.writeFileSync("./txt/output.txt", textOut);

复制代码writeFileSync毫无疑问是写文件,第一个参数为写文件的地址,第二个参数是写入的内容。

readFile、writeFile

上面的两个API都是同步的读写操作。但是nodeJs作为一个单线程的语言,在很多时候,使用同步的操作会造成不必要的拥堵。例如等待用户输入这类I/O操作,就会浪费很多时间。所以 js中有异步的方式解决这类问题,nodejs也一样。通过回调的方式来解决。

fs.readFile("./txt/append.txt", "utf-8", (err, data) => {

fs.writeFile("./txt/final.txt", `${data}`, (err) => {

console.log("ok");

});

});

复制代码http

createServer

http.createServer(requestListener);

复制代码http.createServer() 方法创建一个HTTP Server 对象,参数requestListener为每次服务器收到请求时要执行的函数。

server.listen(8001, "127.0.0.1", () => {

console.log("Listening to requests on port 8001");

});

复制代码上面表代码表示监听8001端口。

url

url.parse

这个模块可以很好的处理URL信息。比如当我们请求http://127.0.0.1:8001/product?id=0的时候通过url.parse可以获取到很多信息。如下图:

实现过程

对于已经给出的完成页面,我们可以看到在切换页面时URL的变化,所以我们需要得到用户请求时的 URL地址,并根据地址展示不同的页面。所以我们通过path模块得到pathname,进行处理。

对于不同的请求,我们返回不同的界面。首先对于Overview page界面,由于它的类型是 html界面,所以我们通过writeHead将它的Content-type设置为text/html。

res.writeHead(200, {

"Content-type": "text/html",

});

复制代码其他的几个返回html的页面也是同样的处理。由于前端界面已经给出,我们只需要读取JSON里面的数据,并将模板字符串替换即可。最后我们通过res.end(output)返回替换后的页面。

总结

通过这一个小页面的练习,可以学习到node对文件的操作以及HTTP模块的操作。并对后端有了初步的认识。

链接:https://juejin.cn/post/7171295946372972557

来源:稀土掘金

著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。

一篇文章告诉你 <按钮> 如何选择,div button 还是a?

前言

当你要创建一个可点击的元素时,是使用 a标签 、button按钮 还是 div 等其他不同的元素?

// 🚩

export function MyButton() {

return <div onClick={...}>点击我</div>

}

//❓

export function MyButton() {

return <button onClick={...}>点击我</button>

}

//❓

export function MyButton() {

return <a onClick={...}>点击我</a>

}

复制代码出人意料的是大多数人都会选择div,这似乎与我们所学的很不一样。

这篇文章将展开对比三者的区别,并做了一个总结,这对于你工作或者面试的时候是很有帮助的。

div

让我们首先弄清楚一件事

您不应该将 div 用于可点击的元素(至少在 99% 的情况下)。

为什么?

严格上来说, div != 按钮。 div 只是一个通用容器,缺少一些可正确点击的元素应具备的特性,例如:

- Div 不可聚焦,例如,

tab键不会像设备上的任何其他按钮那样聚焦 div。 - 屏幕阅读器和其他辅助设备不会将 div 识别为可点击元素。

- Div 不会将某些键输入(如空格键或返回键)转换为获得焦点时的点击。

但是,您可以使用 tabindex="0" 和 role=”button” 等几个属性解决其中一些问题:

// 🚩 试着将 div 改造成像 button一样...

export function MyButton() {

function onClick() { ... }

return (

<div

className="my-button"

tabindex="0" // 让div 能聚焦

role="button" // 屏幕阅读器和其他辅助设备 识别可点击

onClick={onClick}

onKeydown={(event) => {

// 聚焦时监听 回车键和空格键

if (event.key === "Enter" || event.key === "Space") {

onClick()

}

}}

>

点击我

</div>

)

}

复制代码是的,我们需要确保设置聚焦状态的样式,以便用户反馈该元素也被聚焦。我们必须确保这通过了所有问题可访问性,例如:

.my-button:focus-visible {

outline: 1px solid blue;

}

复制代码如果要还原所有细微且关键的按钮行为,并手动实现,需要大量工作。

button

The beauty of the button tag is it behaves just like any other button on your device, and is exactly what users and accessibility tools expect.

button 标签的美妙之处在于它的行为与您设备上的任何其他 button 一样,并且正是用户和辅助工具所期望的。

它是可聚焦的、可访问的、可键盘输入的,具有兼容的焦点状态样式!

// ✅

export function MyButton() {

return (

<button onClick={...}>

点击我

</button>

)

}

复制代码有几个我们需要注意的问题。

button 的问题

我一直对按钮最大的烦恼是它们的样式。

例如,给按钮一个浅紫色背景:

<button class="my-button">

Click me

</button>

<style>

/* 🤢 */

.my-button {

background-color: purple;

}

</style>

复制代码这看起来就像 Windows 95 一样的样式。

这就是为什么我们都喜欢 div。它们没有额外的样式或默认行为。它们的工作和外观每次都完全符合预期。

你可以说, appearance: none 会重置外观!但是这并不能完全按照您的想法进行。

<button class="my-button">

Click me

</button>

<style>

.my-button {

appearance: none; /* 🤔 */

background-color: purple;

}

</style>

复制代码它仍然是这样:

重置 button 的样式

没错,我们必须对每一个样式属性逐行重置:

/* ✅ */

button {

padding: 0;

border: none;

outline: none;

font: inherit;

color: inherit;

background: none

}

复制代码这就是一个样式和行为都像 div 的按钮,它仍然使用浏览器的默认焦点样式。

您的另一种选择是使用 all: unset 恢复一个简单属性中的无特殊样式:

/* ✅ */

button { all: unset; }

button:focus-visible { outline: 1px solid var(--your-color); }

复制代码但是不要忘记添加您自己的焦点状态;例如,您的品牌颜色的轮廓具有足够的对比度。

修复 button 行为属性

使用 button 标签时需要注意最后一个问题。

默认情况下, form 内的任何按钮都被视为提交按钮,单击时将提交表单。

function MyForm() {

return (

<form onSubmit={...}>

...

<button type="submit">Submit</button>

{/* 🚩 点击 "Cancel"仍然会提交表单! */}

<button onClick={...}>Cancel</button>

</form>

)

}

复制代码没错,按钮的默认 type 属性是 submit 。很奇怪。而且很烦人。

要解决此问题,除非您的按钮实际上是为了提交表单,否则请始终向其添加 type="button" ,如下所示:

export function MyButton() {

return (

<button

type="button" // ✅

onClick={...}>

Click me

</button>

)

}

复制代码现在我们的按钮将不再尝试找到它们最接近的 form parent 并提交它。

哇,配置一个简单的按钮几乎变得奇怪了。

a标签 链接

这是大部分人也不注意的一点。我们使用按钮链接到其他页面:

// 🚩

function MyLink() {

return (

<button

type="button"

onClick={() => {

location.href = "/"

}}

>

Don't do this

</button>

)

}

复制代码使用 点击事件 链接到页面的按钮的一些问题:

- 它们不可抓取,因此对 SEO 非常不利。

- 用户无法在新标签页或窗口中打开此链接;例如,右键单击在新选项卡中打开。

因此,我们不要使用按钮进行导航。这就是我们需要 a 标签。

// ✅

function MyLink() {

return (

<a href="/">

Do this for links

</button>

)

}

复制代码a 标签具有按钮的所有上述优点——可访问、可聚焦、可键盘输入——而且它们没有一堆默认的样式!

那我们是否应该将它们用于任何可点击的东西为我们自己省去一些麻烦?

// 🚩

function MyButton() {

return (

<a onClick={...}>

Do this for links

</a>

)

}

复制代码不行

这是因为没有 href属性 的 a 标签不再像按钮一样工作。没错,当它 href 属性有值时,才有完整的按钮行为,例如可聚焦... 。

所以,我们一定要坚持使用按钮作为按钮,使用锚点作为链接。

把 button 和 a 结合起来

我非常喜欢的是将这些规则封装在一个组件中,这样你就可以只使用你的 MyButton 组件,

如果你 提供一个 URL,它就会变成一个链接,否则就是一个按钮就像这样:

// ✅

function MyButton(props) {

if (props.href) {

return <a className="my-button" {...props} />

}

return <button type="button" className="my-button" {...props} />

}

// 渲染出一个 <a href="/">

<MyButton href="/">Click me</MyButton>

// 渲染出 <button type="button">

<MyButton onClick={...}>Click me</MyButton>

复制代码这样,无论按钮的用途是单击处理程序还是指向另一个页面的链接,我们都可以获得一致的开发人员体验和用户体验。

总结

对于链接,使用带有

href属性的a标签,

对于所有其他按钮,使用带有

type="button"的button标签。

需要一个点击容器,就用

div标签

链接:https://juejin.cn/post/7197995910566740025

来源:稀土掘金

著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。

CSS简单实现一幅新春对联

前言

今年过年家里没有贴春联,这两天在网上看到一幅对联,觉得写得挺好的, 上联——只生欢喜不生愁;下联——此心安处是吾家; 横批——平安喜乐, 因此使用css简单实现这幅新春对联。

具体实现

页面先做一个简单描述,首先页面中间有一个大门,然后在大门两侧实现春联的上下联,大门的上面实现春联的横批,再做一个打开大门,出现兔年祝福图片的效果。

效果展示:(毛笔字体文件没有线上的资源,所以字体没有效果) code.juejin.cn/pen/7197022…

页面整体布局:

<div class="wrapper">

<div class="container">

<div class="title">平安喜乐</div>

<div class="content">

<h1>此心安处是吾家</h1>

<div class="door">

<div class="door-l"></div>

<div class="door-r"></div>

<!-- 送福图片 -->

<img src="/4034970a304e251fb44609698ce95a1c7e3e536c.webp" alt="" class="pic">

</div>

<h1>只生欢喜不生愁</h1>

</div>

</div>

</div>1. 大门的实现

大门的总体宽高都设置成350px,设置视角(perspective:1000px), 大门打开的时候呈现一种3D的视觉感受。

大门分成左右两部分门扇,使用绝对定位控制左右的位置,并使用transform-origin属性设置大门旋转动画的基点,默认情况下,元素的动作参考点(基点)为元素盒子的中心(center),这里设置左边门扇的transform-origin: left,左门扇以左边基点旋转;右边门扇的transform-origin: right,右门扇以右边基点旋转。

大门门扇的圆形门环使用伪元素实现,使用hover属性实现当鼠标移到大门上时,大门的门扇分别旋转一定的角度,实现打开大门的效果

兔年祝福图片使用绝对定位控制在大门的居中位置,并设置层级最低,当打开大门图片慢慢变大

.door {

width: 350px;

height: 350px;

border: 2px solid #333;

margin: 0 auto;

position: relative;

perspective: 1000px;

}

.door .pic{

position: absolute;

top: 50%;

left: 50%;

width: 70%;

object-fit: cover;

transform: translate(-50%,-50%);

z-index: -1;

transition: all 0.3s ease-in;

}

.door-l,

.door-r {

width: 50%;

height: 100%;

background-color: #e1b12c;

position: absolute;

top: 0;

transition: all 0.5s;

}

.door-l {

left: 0;

border-right: 1px solid #000;

transform-origin: left;

}

.door-r {

right: 0;

border-left: 1px solid #000;

transform-origin: right;

}

.door-l::before,

.door-r::before {

content: "";

border: 1px solid #000;

width: 20px;

height: 20px;

position: absolute;

top: 50%;

border-radius: 50%;

transform: translateY(-50%);

}

.door-l::before {

right: 5px;

}

.door-r::before {

left: 5px;

}

.door:hover .door-l {

transform: rotateY(-120deg);

}

.door:hover .door-r {

transform: rotateY(120deg);

}

.door:hover .pic{

width: 100%;

}2. 春联的实现

春联一般是用毛笔写的,因此在网上找了一款毛笔字体下载下来,并引入到样式中,并给春联设置红色的背景

网上下载下来的毛笔字体为trueType格式(.ttf,Windows和Mac上常见的字体格式,是一种原始格式,没有为网页进行优化处理),需要转换成Web Open Font格式(.woff,针对网页进行特殊优化,是Web字体中最佳格式)。可以在这个网站上传字体进行转换

@font-face 用于设置自定义字体,可以自定义字体名称。两个必要属性:

font-family:给引入的字体起一个名称,注意:名字不要和那些专属的名称起冲突了,比如:微软雅黑。

src:自定义字体的路径,一般采用相对路径去使用。

@font-face {

font-family: 'YFJLXS8';

src: url('./font.woff2') format('woff2'),

url('./font.woff') format('woff');

font-weight: normal;

font-style: normal;

}

* {

margin: 0;

padding: 0;

box-sizing: border-box

}

.wrapper {

height: 100vh;

font-family: 'YFJLXS8', 'Courier New', Courier, monospace;

padding: 50px;

overflow: hidden;

background: #ccc;

}

.content {

display: flex;

align-items: center;

justify-content: center;

width: 44%;

margin: 20px auto;

}

h1 {

font-size: 40px;

font-weight: 700;

width: 5vw;

color: #000;

line-height: 1;

text-align: center;

background-color: #d63031;

padding: 20px 0;

}

.title{

width: 20%;

font-size: 40px;

font-weight: 700;

text-align: center;

margin: 0 auto;

background-color: #d63031;

}作者:sherlockkid7

来源:juejin.cn/post/7196994373237866553

详解css中伪元素::before和::after和创意用法

伪类和伪元素

首先我们需要搞懂两个概念,伪类和伪元素,像我这种没有系统全面性的了解过css的人来说,突然一问我伪类和伪元素的区别我还真不知道,我之前一直以为这两个说法指的是一个东西,就是我题目中的提到的那两个::before和::after。偶然间才了解到,原来指的是两个东西

伪类

w3cSchool对于伪类的定义是”伪类用于定义元素的特殊状态“。向我们常用到的:link、:hover、:active、:first-child等都是伪类,全部伪类比较多,大家感兴趣的话可以去官方文档了解一下

伪元素

至于伪元素,w3cSchool的定义是”CSS 伪元素用于设置元素指定部分的样式“,光看定义我是搞不懂,其实我们只要记住有哪些东西就好了,伪元素共有5个,分别是::before、::after、::first-letter、::first-line和::selection

伪类和伪元素可以叠加使用,如

.sbu-btn:hover::before,本文后面示例部分也会用到此种用法。

::first-letter主要用于为文本的首字母添加特殊样式

注意:

::first-letter伪元素只适用于块级元素。

::first-line 伪元素用于向文本的首行添加特殊样式。

注意:

::first-line伪元素只能应用于块级元素。

::selection 伪元素匹配用户选择的元素部分。也就是给我们鼠标滑动选中的部分设置样式,它可以设置以下属性

colorbackgroundcursoroutline

以上几种我们简单了解一下就可以了,也不在我们今天的讨论范围之内,今天我们来着重了解一下::before和::after,相信大家在工作中都或多或少的用过,但很少有人真的去深入的了解过他们,本文是我对我所知的关于他们用法的一个总结,如有缺漏,欢迎补充。

用法及示例

::before用于在元素内容之前插入一些内容,::after用于在元素内容之后插入一些内容,其他方面的都相同。写法就是只要在想要添加的元素选择器后面加上::before或::after即可,有些人会发现,写一个冒号和两个冒号都可以有相应的效果,那是因为在css3中,w3c为了区分伪类和伪元素,用双冒号取代了伪元素的单冒号表示法,所以我们以后在写伪元素的时候尽量使用双冒号。

不同于其他伪元素,::before和::after在使用的时候必须提供content属性,可以为字符串和图片,也可以是空,但不能省略该属性,否则将不生效。

给指定元素前添加内容

这个用法是最基础也是最常用的,比如我们可以给一个或多个元素前面或者后面添加想要的文字

<div class="class1">

<p class="q">你的名字是?</p>

<p class="a">张三</p>

<p class="q">你的名字是?</p>

<p class="a">张三</p>

<p class="q">你的名字是?</p>

<p class="a">张三</p>

</div>.class1::before {

content: '问卷';

font-size: 30px;

}

.class1 .q::before {

content: '问题:'

}

.class1 .a::before {

content: '回答:'

}

当然也可以添加形状,默认的是行内元素,如果有需要,我们可以把它变为块级元素

<div class="class2">

<div class="news-item">今天天气为多云</div>

<div class="news-item">今天天气为多云</div>

<div class="news-item">今天天气为多云</div>

<div class="news-item">今天天气为多云</div>

<div class="news-item">今天天气为多云</div>

</div>

.news-item::before {

content: '';

display: inline-block;

width: 16px;

height: 16px;

background: rgb(96, 228, 255);

margin-right: 8px;

border-radius: 50%;

}我们也可以使用它来添加图片

<div class="class3">

<p class="text1">阅读和写作同样重要</p>

<p class="text1">阅读和写作同样重要</p>

<p class="text1">阅读和写作同样重要</p>

<p class="text1">阅读和写作同样重要</p>

</div>

.class3 .text1::before {

content: url(https://lf3-cdn-tos.bytescm.com/obj/static/xitu_juejin_web/e08da34488b114bd4c665ba2fa520a31.svg);

}不过这一方法的缺点就是,不能调整图片大小,如果我们需要使用伪元素添加图片的话,建议通过给伪元素设置背景图片的方式设置

结合clear属性清除浮动

我们都知道清除浮动的一种方式就是给一个空元素设置clear:both属性,但在页面里添加过多的空元素一方面代码不够简洁,另一方面也不便于维护,所以我们可以通过给伪元素设置clear:both属性的方法更好的实现我们想要的效果

禁用网页ctrl+f搜索

有些时候,我们不想要用户使用ctrl+f搜索我们网页内的内容,必须在一些文字识别的网页小游戏里,我们又不想把文字做成图片,那么就可以使用这个属性,使用::before和::after渲染出来的文字,不可选中也不能搜索。当然这个低版本浏览器的兼容性我木有试,谷歌浏览器和safari是可以实现不能选中不可搜索的效果的。

拿上面的示例进行尝试,可以看到,我们使用伪元素添加的[问题]两个字,就无法使用浏览器的搜索工具搜到。

制作一款特殊的鼠标滑入滑出效果

这个效果还是之前一个朋友从某网站看到之后问我能不能实现,我去那个网站查看了代码学会的,觉得很有趣,特意分享给大家。

可以先看一下效果

这里附上源码和在线演示

.h-button {

z-index: 1;

position: relative;

overflow: hidden;

}

.h-button::before,

.h-button::after {

content: "";

width: 0;

height: 100%;

position: absolute;

filter: brightness(.9);

background-color: inherit;

z-index: -1;

}

.h-button::before {

left: 0;

}

.h-button:after {

right: 0;

transition: width .5s ease;

}

.h-button:hover::before {

width: 100%;

transition: width .5s ease;

}

.h-button:hover::after {

width: 100%;

background-color: transparent;

}这里我做了一些改进,就是鼠标滑入之后的颜色是对按钮本身颜色进行一定的变换得来的,这样我们就无需对每一个按钮单独设置鼠标滑入时候的颜色了,全局时候的时候只需要对目标按钮添加一个类名h-button就可以,更加的方便简单,当然,如果大家觉得这样的颜色不好看的话,还是可以自行设置,或者修改一我对颜色的处理方式

这个效果的实现思路其实很简单,就是使用::before和::after给目标按钮添加两个伪元素,然后使用定位让他们重合在一起,再通过改变两者的宽度实现的。

首先是创建两个伪元素,宽高都和目标元素一致,我这里的背景色由于是对按钮本身颜色进行处理得来的,所以给他们设置的背景色是沿用父级背景色,如果你想单独设置这里可以分别设置为自己想要的颜色。

.h-button {

z-index: 1;

position: relative;

overflow: hidden;

}

.h-button::before,

.h-button::after {

content: "";

width: 0;

height: 100%;

position: absolute;

filter: brightness(.9);

background-color: inherit;

z-index: -1;

}我们的实现原理是通过改变伪元素的宽度实现,所以我们需要第一个伪元素的定位以左边为准,从而实现鼠标移入时色块从左往右出现的效果,而第二个伪元素的定位以右为准,从而实现鼠标移出时色块从左往右消失的效果。

这里可以看到,我们在没有给第一个伪元素的初始状态添加过渡效果,那是因为它只需要在从鼠标移出的时候展示动画即可,在鼠标移出的时候需要瞬间消失,所以在初始状态不需要添加过渡效果,而第二个伪元素恰恰相反,它在鼠标滑入的时候不需要展示动画效果,在鼠标滑入也就是回归初始状态的时候需要展示动画效果,所以我们需要在最开始的时候就添加上过渡效果。

.h-button::before {

left: 0;

}

.h-button::after {

right: 0;

transition: width .5s ease;

}两个伪元素的初始宽度都为0,鼠标滑入的时候,让两个伪元素宽度都变为100%,由于鼠标滑入时我们并不需要第二个伪元素出现,所以这里我们给它的背景颜色设置为透明,这样就可以实现鼠标滑入时只展示第一个伪元素宽度从0到100%的动画,而鼠标移出时第一个伪元素宽度变为0,因为没有过渡效果,所以它的宽度会瞬间变为0,然后展示第二个色块宽度从100%到0的动画效果。

.h-button:hover::before {

width: 100%;

transition: width .5s ease;

}

.h-button:hover::after {

width: 100%;

background-color: transparent;

}伪元素能实现的创意用法还有很多,如果大家有不同的用法,欢迎分享,希望本篇文章可以对大家有所帮助。

作者:十里青山

来源:juejin.cn/post/7163867155639828488

团队的技术分享又轮到我了,分享点啥才能显得牛逼又有趣?

引言

新年好,我是飞叶_程序员。

见过我这个ID的朋友们肯定都知道,作为前端,我主要通过 B站up主 的身份来来进行社区交流的。 虽然主要的交流渠道不是掘金、segmentfault这样的技术站点,但与在掘金活跃的大佬们遇到的问题其实是一样的。

那就是我们需要经常阅读技术文章、技术资讯,保持和丰富自己的知识储备,不然怎么给别人分享知识呢? 这是我作为一个创作者和分享者 和 广大其他创作者们遇到的共性问题。

那作为一线的开发者,其实也有技术分享的需要,我相信大家的技术团队都是需要技术分享的。 而技术分享一般都是通过轮流进行的,也不能逮着团队里的几个人一直薅羊毛对吧。

那轮到你技术分享的时候,你是否会苦恼于不知道该分享点啥呢?

你是否担心:万一我分享的东西其他人都已经知道了,显得自己不够牛逼呢?

我想这些问题,归根到底是不知道去哪里获取技术资讯的问题。

如果你手里有大量的技术站点,他们能给你提供大量的高质量技术文章,在里面找到一篇值得分享的内容应该就不难了。

回顾2022年,我在B站发布了100多个技术视频,平均约每周两个,现在看起来都不可思议。 哪有那么多可以分享的内容啊!

前端森林

实际上我能分享那么多,得益于我收录了一些英文站点。尤其是有一些技术周刊。

我的灵感来源都是他们。不是凭空产生的。

过年期间我一直在想着把我收藏的这些站点公开出来,让其他人和创作者们也不再有技术分享的苦恼。 所以创建了一个开源项目,叫awesome-fe-sites,GitHub, 并把它部署在了fesites.netlify.app。

他的作用是收录前端资讯类站点,周刊类网站,高质量个人博客和技术团队博客,在线服务类/工具类网站等。

slogan:前端网站,尽收眼底。

同时也希望它也可以解放你的浏览器书签栏。

参与贡献

不知道你有没有一些私藏的高质量的前端站点,如果你希望把它贡献出来,欢迎PR。

另外这个站点是通过qwik这个很新的前端框架搭建的,对qwik感兴趣的话,也可以看看这个项目的代码。

作者:飞叶_前端

来源:juejin.cn/post/7193136620948684860

不修改任何现有源代码,将项目从 webpack 迁移到 vite

背景

之前将公司项目开发环境从 webpack 迁移到 vite,实现了 dev 环境下使用 vite、打包使用 webpack 的共存方案。本文将讲述开发环境下 vue3 项目打包器从 webpack 迁移到 vite 过程中的所遇问题、解决方案、迁移感受,以及如何不修改任何源码完成迁移。

迁移的前提及目标

我们之前的项目大概有 10w+ 行代码,开发环境下冷启动所花费的时间大概 1 分钟多,所以迁移到 vite 就是看中了它的核心价值:快!但是迁移到 vite,也会伴随着风险:代码改动及回归成本。

作为一个大型的已上线项目,它的线上稳定性的一定比我们工程师开发时多减少一些项目启动时间的价值要高,所以如果迁移带来了很多线上问题,那便得不偿失了。

所以我们迁移过程中有前提也有目标:

- 前提:不因为迁移打包工具引发线上问题

- 目标:实现开发环境下的快速启动

方案

有了上述前提和目标,那我们的方案就可以从这两方面思考入手了。

- 如何能确保实现前提?我们已有了稳定版本,那只要保证源代码不改动,线上的打包工具 webpack 及配置也不改动,就可以确保实现前提。

- 如何实现目标?vite 的快主要是体现在开发环境,打包使用的 rollup 相比 webpack 速度上并无太明显的优势,所以我们只要开发环境下使用 vite 启动就可以实现目标。

由此得出最终方案:不改动任何现有源代码,开发环境使用 vite,线上打包使用 webpack。

迁移过程

安装 vite 及进行基础配置

- 在终端执行下述命令,安装 vite 相关基础依赖:

yarn add vite @vitejs/plugin-vue vite-plugin-html -D

复制代码

- 因为 vite 的 html 模板文件需要显示引入入口的

.js/.ts文件,同时有一些模板变量上面的区别,为了完全不影响线上打包,在/public目录下新建一个index.vite.html文件。将/public/index.html文件的内容拷贝进来并添加入口文件的引用(/src/main.ts指向项目的入口文件):

<!DOCTYPE html>

<html lang="">

<!-- other code... -->

<body>

<!-- other code... -->

<div id="app"></div>

+ <script type="module" src="/src/main.ts"></script>

</body>

</html>

复制代码

- 新增

vite.config.js,内容如下:

import { defineConfig } from 'vite';

import vue from '@vitejs/plugin-vue';

import { createHtmlPlugin } from 'vite-plugin-html';

// https://vitejs.dev/config/

export default defineConfig({

plugins: [

vue(),

createHtmlPlugin({

minify: true,

/**

* After writing entry here, you will not need to add script tags in `index.html`, the original tags need to be deleted

* @default src/main.ts

*/

entry: 'src/main.ts',

/**

* If you want to store `index.html` in the specified folder, you can modify it, otherwise no configuration is required

* @default index.html

*/

template: 'public/index.vite.html',

}),

]

});

复制代码

- 在

package.json的scripts里新增一条 vite 开发启动的指令:

{

"scripts": {

"serve": "vue-cli-service serve",

"build": "vue-cli-service build",

"lint": "vue-cli-service lint",

+ "vite": "vite"

}

}

复制代码

到这里,我们基本的配置就已经完成了,现在可以通过 npm run vite 来启动 vite 开发环境了,只不过会有一大堆的报错,我们根据可能遇到的问题一个个去解决。

问题及解决方案

HtmlWebpackPlugin 变量处理

报错: htmlWebpackPlugin is not defined

是因为之前在 webpack 的 HtmlWebpackPlugin 插件中配置了变量,而 vite 中没有这个插件,所以缺少这个变量。

我们先前安装了 vite-plugin-html 插件,所以可以在这个插件中配置变量来代替:

- 将

index.vite.html中所有的htmlWebpackPlugin.options.xxx修改为xxx,如:

<!DOCTYPE html>

<html lang="">

<head>

- <title><%= htmlWebpackPlugin.options.title %></title>

+ <title><%= title %></title>

</head>

</html>

复制代码

- 在

vite.config.js中添加如下内容:

export default defineConfig({

plugins: [

createHtmlPlugin({

+ inject: {

+ data: {

+ title: '我的项目',

+ },

+ },

}),

]

});

复制代码

其他的 html 中未定义的变量亦可以通过此方案来解决。

alias 配置

报错:Internal server error: Failed to resolve import "@/ok.ts" from "src/main.ts". Does the file exist?

通常我们的项目都会在 alias 中将 src 目录配置为 @ 来便于引用,所以遇到这个报错我们需要再 vite.config.js 中将之前 webpack 的 alias 配置补充进来(同时 vite 中 css 等样式文件的 alias 不需要加 ~ 前缀,所以也需要配置下 ~@):

import { defineConfig } from 'vite';

import path from 'path';

export default defineConfig({

resolve: {

alias: {

'@': path.resolve(__dirname, './src'),

'~@': path.resolve(__dirname, './src'),

// 其他的 alias 配置...

}

},

});

复制代码css 全局变量

报错:Internal server error: [less] variable @primaryColor is undefined

是因为项目在 less 文件中定义了变量,并在 webpack 的配置中通过 style-resources-loader 将其设置为了全局变量。我们可以在 vite.config.js 中添加如下配置引入文件将其设置为全局变量:

// vite.coonfig.js

export default defineConfig({

css: {

preprocessorOptions: {

less: {

additionalData: `@import "src/styles/var.less";`

},

},

},

});

复制代码环境变量

报错:ReferenceError: VUE_APP_HOST is not defined

这是因为项目中在 .env.local 文件中设置了以 VUE_APP_XXX 开头的环境变量,我们通过可以通过在 vite.config.js 的 define 中定义为全局变量:

// vite.config.js

export default defineConfig({

define: {

'process.env': {

NODE_ENV: import.meta.env,

APP_NAME: '我的项目名称',

},

+ VUE_APP_HOST: '"pinyin-pro.com"', // 这里需要注意定义为一个字符串

},

})

复制代码process 未定义

报错: ReferenceError: process is not defined

这是因为 webpack 启动时会根据 node 环境将代码中的 process 变量会将值给替换,而 vite 未替换该变量,所以在浏览器环境下会报错。

我们可以通过在 vite.config.js 中将 process.env 定义成一个全局变量,将相应的属性给配置好:

// vite.config.js

export default defineConfig({

define: {

'process.env': {

NODE_ENV: import.meta.env,

APP_NAME: '我的项目名称',

},

},

})

复制代码使用 JSX

报错:Uncaught ReferenceError: React is not defined

这是因为 react16 版本之后,babel 默认会将 .jsx/.tsx 语法转换为 react 函数,而我们需要以 vue 组件的方式来解析 .jsx/.tsx 文件,需要通过新的插件来解决:

- 安装

@vitejs/plugin-vue-jsx插件:

yarn add @vitejs/plugin-vue-jsx -D

复制代码

- 在

vite.config.js文件中引入插件:

// others

import vueJsx from '@vitejs/plugin-vue-jsx';

// https://vitejs.dev/config/

export default defineConfig({

plugins: [

vue(),

vueJsx(),

// others...

],

});

复制代码

CommonJS 不识别

报错:ReferenceError: require is not defined

这是因为项目中通过 require() 引入了图片,webpack 支持 commonjs 语法,而 vite 开发环境是 esmodule 不支持 require。可以通过 @originjs/vite-plugin-commonjs 插件,它能解析 require 进行语法转换以支持同样效果:

- 安装

@originjs/vite-plugin-commonjs插件:

yarn add @originjs/vite-plugin-commonjs -D

复制代码

- 在

vite.config.js中引入插件:

import { viteCommonjs } from '@originjs/vite-plugin-commonjs'

export default defineConfig({

plugins: [

viteCommonjs()

]

})

复制代码

多模块导入

报错:Uncaught ReferenceError: require is not defined

这个报错注意比前面的 ReferenceError: require is not defined 多了一个 Uncaught,是因为 @originjs/vite-plugin-commonjs 并不是对所有的 require 进行了转换,我们项目中还通过 webpack 提供的 require.context 进行了多模块导入。要解决这个问题可以通过 @originjs/vite-plugin-require-context 插件实现:

- 安装

@originjs/vite-plugin-require-context插件:

yarn add @originjs/vite-plugin-require-context -D

复制代码

- 在

vite.config.js中引入插件:

import ViteRequireContext from '@originjs/vite-plugin-require-context'

export default defineConfig({

plugins: [

ViteRequireContext()

]

})

复制代码

其他 webpack 配置

其他的一些 webpack 配置例如 devServer 以及引用的一些 loader 和 plugin,只需要参考 vite 文档一一修改就行,由于各个团队的项目配置不同,我在这里就不展开了。需要注意的是,因为是开发环境下使用 vite,只需要适配开发环境的 webpack 配置就行,打包优化等不需要处理。

潜在隐患

上述方案中,我们通过不修改源代码 + 打包依然使用 webpack,保证了现有项目线上的稳定性:但还有一个潜在隐患:随着项目后期的迭代,因为开发环境是 vite,打包是 webpack,可能因为两种打包工具的不同导致开发和打包产物表现不同的缺陷。例如一旦你开发环境使用了 import.meta.xxx,打包后立马就会报错。

写在最后

我们当时采用此方案是因为 vite 刚发布没太久,用于正式环境有不少坑,而现在 vite 已经成为一款比较成熟的打包工具了,如果要迁移的话还是建议开发和打包都采用 vite,这种方面可以作为 webpack 迁移 vite 的短期过渡方案使用。(我们的项目现在打包也迁移到了 vite 了)

另外我们要明确,作为公司项目稳定性是第一位的,技术方案的变更需要明确能给项目带来收益。例如 webpack 迁移的 vite,是明确能够大幅优化开发环境的等待时间成本,而非看到别人都在用随大流而用。如果已知项目后期发展规模不会太大,当前项目启动时间也不长,就没有迁移的必要了。

上述迁移过程中遇到的坑只是针对我们的项目,没能包含全部的迁移坑点,大家有其他的遇到问题欢迎分享一起讨论。

最后推荐一个工具,可以将项目一键 webpack 迁移到 vite: webpack-to-vite

链接:https://juejin.cn/post/7197222701220053047

来源:稀土掘金

著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。

10000+条数据的内容滚动功能如何实现?

遇到脑子有问题的产品经理该怎么办?如果有这么一个需求要你在一个可视区范围内不间断循环滚动几千上万条数据你会怎么去实现?

且不说提这个需求的人是不是脑子有问题,这个需求能不能实现?肯定是可以的,把数据请求回来渲染到页面写个滚动样式就好了。抛开这样一次性请求上万条数据合不合理不讲,一万条数据渲染到页面上估计都要卡死了吧。那有没有更好的方法呢? 当然有

分析一波思路

我们分批次请求数据,比如可视化区域展示的是20条数据,那我们就一次只请求30条,然后把请求回来的数据保存起来,定义一个滚动的数组,把第一次请求的30条数据赋值给它。后面每当有一条数据滚出可视区域我们就把它删掉,然后往尾部新增一条,让滚动数组始终保持30条的数据,这样渲染在页面上的数据始终只有30条而不是一万条。文字描述太生硬我们上代码

首先定义两个数组,一个滚动区域的数组scrollList,一个总数据的数组totalList,模拟一个异步请求的方法和获取数据的方法。

<script lang="ts" setup>

import { nextTick, ref } from "vue";

type cellType = {

id: number,

title: string,

}

interface faceRequest {

data: cellType,

total: number

}

// 总数据的数组

const totalList = ref<Array<cellType>>([]);

// 滚动的数组

const scrollList = ref<Array<cellType>>([]);

// 数据是否全部加载完毕

let loading: Boolean = false

// 模拟异步请求

const request = () => {

return new Promise<faceRequest>((resolve: any, reject: any) => {

let data: Array<cellType> = []

// 每次返回30条数据

for (let i = 0; i < 30; i++) {

data.push({

id: totalList.value.length + i,

title: 'cell---' + (totalList.value.length + i)

});

}

let total = 10000// 数据的总数

resolve({ data, total })

})

}

const getData = () => {

request().then(res => {

totalList.value = totalList.value.concat(res.data)

// 默认获取第一次请求回来的数据

if (totalList.value.length <= 30) {

scrollList.value = scrollList.value.concat(res.data)

}

// 当前请求的数量小于总数则继续请求

if (totalList.value.length < res.total) {

getData()

} else {

loading = true

}

})

}

getData()

</script>

复制代码上面写好了数据的获取处理,接下来写一下页面

<template>

<div class="div">

<div :style="styleObj" @mouseover="onMouseover" @mouseout="onMouseout" ref="divv">

<div v-for="item in scrollList" :key="item.id" @click="onClick(item)">

<div class="cell">{{ item.title }}</div>

</div>

</div>

</div>

</template>

<script lang="ts" setup>

// 滚动样式

const styleObj = ref({

transform: "translate(0px, 0px)",

});

</script>

<style scoped>

.div {

width: 500px;

height: 500px;

background-color: aquamarine;

overflow: hidden;

}

.cell {

height: 30px;

}

</style>

复制代码现在页面跟数据的前提条件都写好,下面就是数据逻辑的处理了,也就是这篇文章的重点

- 获取页面上单条数据的总体高度

- 设置定时器使页面不停的滚动

- 当一条数据滚动出视图范围时调用处理数据的方法并且重置滚动高度为0

const divv = ref();

// 当前滚动高度

const ScrollHeight = ref<number>(0);

// 储存定时器

const setInt = ref();

// 内容滚动

const roll = () => {

nextTick(() => {

let offsetHeight = divv.value.childNodes[1].offsetHeight

setInt.value = setInterval(() => {

if (ScrollHeight.value == offsetHeight) {

onDel();

ScrollHeight.value = 0;

}

ScrollHeight.value++;

styleObj.value.transform = `translate(0px, -${ScrollHeight.value}px)`;

}, 10);

})

};

onMounted(() => {

roll()

})

复制代码处理数据的方法

- 保存需要被删除的数据

- 删除超出视窗的数据

- 获取总数组的数据添加到滚动数组的最后一位

- 将被删除的数组数据添加到总数组最后面,

- 当滚动到最后一条数据时重置下标为0,使得数据首位相连不断循环

let index = 29;// 每次请求的数量-1,例如每次请求30条数据则为29

const onDel = () => {

index++;

if (loading) {

// 当滚动到最后一条数据时重置下标为0

if (index == totalList.value.length) {

index = 0;

}

scrollList.value.shift();

scrollList.value.push(totalList.value[index]);

} else {

if (index == totalList.value.length) {

index = 0;

}

// 保存需要被删除的数据

let value = scrollList.value[0]

// 删除超出视窗的数据

scrollList.value.shift();

// 获取总数组的数据添加到滚动数组的最后一位

scrollList.value.push(totalList.value[index]);

// 将被删除的数组数据添加到总数组最后面

totalList.value.push(value)

}

};

复制代码到这里代码就写好了,接下来让我们看看效果怎么样

总结

在我们开发的过程中会遇到各种各样天马行空的需求,尤其会遇到很多不合理的需求,这时候我们就要三思而后行,

想清楚能不能不做?

能不能下次再做?

能不能让同事去做?

链接:https://juejin.cn/post/7169940462357184525

来源:稀土掘金

著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。

CSS动画篇之404动画

当前页面无法访问,可能没有权限或已删除。 作为一个从事互联网行业的你是不是见过各种各种的404页面,今天刚好发现一个比较有趣的404页面,如上图所示,是不是感觉挺炫酷呢,本文将和大家分享一下实现原理。

前言

看到上面的404你的第一感觉会是这么做呢?

来,UI同学给我上GIF。

当然这种方式对于前端同学来说肯定是最简单的实现方式,单纯的加载一张图片即可。

但是对于一个有追求的前端,绝对不会答应这么干,加载一张GIF图片的成本太高了,网络差的情况下会导致白屏时间过长,所以我们尽可能的用代码实现,减少这种不必要的网络请求。

实现

当你仔细看这个动画的时候可以发现其实主体只有一个标签,内容就是404,另外的几个动画都是基于这个主体实现,所以我们先写好这个最简单的html代码。

<h1 data-t="404">404</h1>

复制代码细心的同学应该看到了我们自定义了一个熟悉data-t,这个我们后续在css中会用到,接下来实现主体的动画效果,主要的动画效果就是让主体抖动并增加模糊的效果,代码实现如下所示。

h1 {

text-align: center;

width: 100%;

font-size: 6rem;

animation: shake .6s ease-in-out infinite alternate;

}

@keyframes shake {

0% {

transform: translate(-1px)

}

10% {

transform: translate(2px, 1px)

}

30% {

transform: translate(-3px, 2px)

}

35% {

transform: translate(2px, -3px);

filter: blur(4px)

}

45% {

transform: translate(2px, 2px) skewY(-8deg) scaleX(.96);

filter: blur(0)

}

50% {

transform: translate(-3px, 1px)

}

}

复制代码接下来增加主体动画后面子两个子动画内容,基于伪元素实现,伪元素的内容通过上面html中自定义data-t获取,主要还用了clip中的rect,具体css代码如下。

h1:before {

content: attr(data-t);

position: absolute;

left: 50%;

transform: translate(-50%,.34em);

height: .1em;

line-height: .5em;

width: 100%;

animation: scan .5s ease-in-out 275ms infinite alternate,glitch-anim .3s ease-in-out infinite alternate;

overflow: hidden;

opacity: .7;

}

@keyframes glitch-anim {

0% {

clip: rect(32px,9999px,28px,0)

}

10% {

clip: rect(13px,9999px,37px,0)

}

20% {

clip: rect(45px,9999px,33px,0)

}

30% {

clip: rect(31px,9999px,94px,0)

}

40% {

clip: rect(88px,9999px,98px,0)

}

50% {

clip: rect(9px,9999px,98px,0)

}

60% {

clip: rect(37px,9999px,17px,0)

}

70% {

clip: rect(77px,9999px,34px,0)

}

80% {

clip: rect(55px,9999px,49px,0)

}

90% {

clip: rect(10px,9999px,2px,0)

}

to {

clip: rect(35px,9999px,53px,0)

}

}

@keyframes scan {

0%,20%,to {

height: 0;

transform: translate(-50%,.44em)

}

10%,15% {

height: 1em;

line-height: .2em;

transform: translate(-55%,.09em)

}

}

复制代码伪元素after的动画与before中的一致,只是部分参数改动,如下所示。

h1:after {

content: attr(data-t);

position: absolute;

top: -8px;

left: 50%;

transform: translate(-50%,.34em);

height: .5em;

line-height: .1em;

width: 100%;

animation: scan 665ms ease-in-out .59s infinite alternate,glitch-anim .3s ease-in-out infinite alternate;

overflow: hidden;

opacity: .8

}

复制代码总结

到此为止我们的功能就实现完成啦,看完代码是不是感觉并没有很复杂,又为我们的页面性能提升了大大的一步。

完整的代码可以访问codepen查看 👉 codepen-404

链接:https://juejin.cn/post/7091848998830473230

来源:稀土掘金

著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。

老板说:把玉兔迎春图实现高亮

前言

兔年来临,老板意气风发的说:我们的系统登录页要换做玉兔迎春的背景页,而且用户

ctrl+f搜索【玉兔迎春】关键字时,图片要高亮。

新的一年,祝大家身体健康、Bug--

一、明确需求

将系统的登录页面背景换做如上图【玉兔迎春】。

而且,用户可以通过搜索关键字【玉兔迎春】让背景图的文字进行高亮。

下面我们进行分析一下。

二、进行分析

接到该需求的时候,心里是这样子的。

于是,老板像是看穿我的疑惑时,语重心长的对我们说:我们要给用户一个焕然一新的感觉。

疯狂点点头,并想好如何让图片里面的文字进行高亮的对策。

静下来思考片刻,其实不是很难。

2.1 思路

我们只需要盖一层div在图片上,然后设置文字透明,浏览器ctrl+f搜索的时候,会给文字他高亮黄的颜色,我们就可以看到文字了。

盖的这层div,里面包含着我们的文字。

那么,难点就是怎么从图片获取文字出来。

其实这个技术,有个专业词语来描述,叫ocr识别技术。

2.2 ocr

ocr,其实也叫“光学字符识别技术”,是最为常见的、也是目前最高效的文字扫描技术,它可以从图片或者PDF中识别和提取其中的文字内容,输出文本文档,方便验证用户信息,或者直接进行内容编辑。

揭秘该技术:实现文字识别?从图片到文字的过程发生了什么?

分别是输入、图像与处理、文字检测、文本识别,及输出。每个过程都需要算法的深度配合,因此从技术底层来讲,从图片到文字输出,要经历以下的过程:

1、图像输入:读取不同图像格式文件;

2、图像预处理:主要包括图像二值化,噪声去除,倾斜校正等;

3、版面分析:将文档图片分段落,分行;

4、字符切割:处理因字符粘连、断笔造成字符难以简单切割的问题;

5、字符特征提取:对字符图像提取多维特征;

6、字符识别:将当前字符提取的特征向量与特征模板库进行模板粗分类和模板细匹配,识别出字符;

7、版面恢复:识别原文档的排版,按原排版格式将识别结果输出到文本文档;

8、后处理校正: 根据特定的语言上下文的关系,对识别结果进行校正。

2.3 应用

随着ocr技术的成熟,不少软件已经出了该功能。

比如:微信、qq、语雀等等。

还有一些试卷试题,都会用到ocr识别技术。

还有一些技术文档,实现自定义搜索功能,表格关键字高亮。

老板这次需求:把玉兔迎春图实现高亮。

和如上实现的技术思路类似。

我们也可以自定义颜色,加个span标签给其想要的样式。

三、使用

当然,我们可能并不关心底层的实现,只关心怎么怎么去使用。

我们可以调用百度API:文字提取技术

还可以使用java的tesseract-ocr库,其实就是文字的训练。

所以会有个弊端,就是文件可能会有点大,存放着大量文字。

后记

在一个需求的产生之后,我们如果没什么思路,可以借鉴一下,目前市场上有没有类似的技术的沉淀,从而实现需求。

最后,望大家的新的一年,工作顺利,身体健康。

玉兔迎春啦🐇🧨🐇🏮🐇~

👍 如果对您有帮助,您的点赞是我前进的润滑剂。

作者:Dignity_呱

来源:juejin.cn/post/7186459084303335481

一个有趣的交互效果的实现

效果分析

最近在做项目,碰到了这样一个需求,就是页面有一个元素,这个元素可以在限定的区域内进行拖拽,拖拽完成吸附到左边或者右边,并且在滚动页面的时候,这个元素要半隐状态,停止滚动的时候恢复到原来的位置。如图所示:

根据视频所展示的效果,我们得出了我们需要实现的效果主要有2个部分:

拖拽并吸附

滚动半隐元素

那么如何实现这2个效果呢?我们一个效果一个效果的来分析。

ps: 由于这里采用的是react技术栈,所以这里以react作为讲解

首先对于第一个效果,我们要想实现拖拽,有2种方式,第一种就是html5提供的拖拽api,还有一种就是监听鼠标的mousedown,mousemove和mouseup事件,由于这里兼容的移动端,所以我采用的是第二种实现方法。

思路是有了,接下来我想的就是将这三个事件封装一下,写成一个hook函数,这样方便调用,也方便扩展。

对于拖拽的实现,我们只需要在鼠标按下的时候,记录一下横坐标x和纵坐标y,在鼠标拖动的时候用当前拖动的横坐标x和横坐标y去与鼠标按下的时候的横坐标x与y坐标相减就可以得到拖动的偏移坐标,而这个偏移坐标就是我们最终要使用到的坐标。

在鼠标按下的时候,我们还需要减去元素本身所在的left偏移和top偏移,这样计算出来的坐标才是正确的。

然后,由于元素需要通过设置偏移来改变位置,因此我们需要将元素脱离文档流,换句话说就是元素使用定位,这里我采用的是固定定位。

hooks函数的实现

基于以上思路,一个任意拖拽功能实现的hooks函数就结构就成型了。

当然由于我们需要限定范围,这时候我们可以思考会有2个方向上的限定,即水平方向和垂直方向上的限定。除此之外,我们还需要提供一个默认的坐标值,也就是说元素默认应该是在哪个位置上。现在我们用伪代码来表示一下这个函数的结构,代码如下:

const useLimitDrag = (el,options,container) => {

//核心代码

}

export default useLimitDrag;参数类型

这个hooks函数有3个参数,第一个参数自然是需要拖拽的元素,第二个参数则是配置对象,而第三个参数则是限定的容器元素。拖拽的元素和容器元素都是属于dom元素,在react中,我们还可以传递ref来表示一个dom元素,所以这两个参数,我们可以约定一下类型定义。我们先来定义元素的类型如下:

export type ElementType = Element | HTMLElement | null;dom元素的类型就是Element | HTMLElement这2个类型,现在我们知道react的ref可以传递dom元素,并且我们还可以传入一个函数当作参数,所以基于这个类型,我们又额外的扩展了参数的类型,也方便配置。让我们继续写下如下代码:

import type { RefObject } from 'react';

export type RefElementType = RefObject<ElementType>;

export type FunctionElementType = () => ElementType;这样el和container元素的类型就一目了然,我们再定义一个类型简单合并一下这两个类型,代码如下:

export type ParamType = RefElementType | FunctionElementType;接下来,让我们看配置对象,配置对象主要有2个地方,第一个就是默认值,第二个则是限定方向,因此我们约定了3个参数,islimitX,isLimitY,defaultPosition,并且配置对象都应该是可选的,我们可以使用Partial内置泛型将这个类型包裹一下,ok,来看看代码吧。

export type OptionType = Partial<{

isLimitX: boolean,

isLimitY: boolean,

defaultPosition: {

x: number,

y: number

}

}>;嗯现在,我们可以修改一下以上的核心函数了,代码如下:

const useLimitDrag = (el: ParamType,options: OptionType,container?: ParamType) => {

//核心代码

}

export default useLimitDrag;返回值类型

下一步,我们需要确定我们返回的值,首先肯定是当前被计算出来的x和y坐标,其次由于我们这个需求还有一个吸附效果,这个吸附效果是什么意思呢?就是说,以屏幕的中间作为划分界限为左右两部分,当拖动的x坐标大于中间,那么就吸附到最右边,否则就吸附到最左边。

根据这个需求,我们可以将坐标分为最大x坐标,最小x坐标以及中间的x坐标,当然由于需求只提到了水平方向上的吸附,垂直方向上并没有,但是为了考虑扩展,与之对应的我们同样要分成最大y坐标,最小y坐标以及中间的y坐标。

最后,我们还可以返回一个是否正在拖动中,方便我们做额外的操作。根据描述,以上的代码我们也就可以构造如下:

export type PositionType = Partial<{ x: number, y: number, isMove: boolean, maxX: number, maxY: number, minX: number, minY: number, centerX: number, centerY: number }>;

//

const useLimitDrag = (el: ParamType,options: OptionType,container?: ParamType): PositionType => {

//核心代码

}

export default useLimitDrag;核心代码实现第一步---判断当前环境

最基本的结构搭建好了,接下来第一步,我们要做什么?首先当然是判断当前环境是否表示移动端啊。那么如何判断呢?浏览器提供了一个navigator对象,通过这个对象的userAgent属性我们就可以判断,这个属性是一个很长的字符串,但是我们可以从其中一些值看出一些端倪,在移动端的环境中,通常都会看到iPhone|iPod|Android|ios这些字符串值,比如在iphone手机中就会有iPhone字符串,同理android也是。所以我们就可以通过写一个正则表达式来匹配这些字符串,如果有这些字符串就代表是移动端环境,否则就是pc浏览器环境,代码如下:

const isMobile = navigator.userAgent.match(/(iPhone|iPod|Android|ios)/i);我们为什么要判断是否是移动端环境?因为在移动端环境,我们通常监听的是触摸事件,即touchstart,touchmove与touchend,而非mousedown,mousemove和mouseup。所以下一行代码自然就是定义好事件呢。如下:

const eventType = isMobile ? ['touchstart', 'touchmove', 'touchend'] : ['mousedown', 'mousemove', 'mouseup'];核心代码实现第二步---一些初始化工作

下一步,我们通过useRef方法来存储拖拽元素和限定拖拽容器元素。代码如下:

const element = useRef<ElementType>();

const containerElement = useRef<ElementType>();接着我们获取配置对象的值,然后我们定义最大边界的值,代码如下:

const { isLimitX, isLimitY,defaultPosition } = option;

const globalWidthHeight = {

offsetWidth: window.innerWidth,

offsetHeight: window.innerHeight

}随后,我们用一个变量代表鼠标是否按下的状态,这样做的目的是让拖拽变得更丝滑流畅一些,而不容易出问题,然后我们用useState定义返回的值,再定义一个对象存储鼠标按下时的x坐标和y坐标的值。代码如下:

let isStart = false;

const [position, setPosition] = useState<PositionType>({

x: defaultPosition?.x,

y: defaultPosition?.y,

maxX: 0,

maxY: 0,

centerX: 0,

centerY: 0,

minX: 0,

minY: 0

});

const [isMove, setIsMove] = useState(false);

const downPosition = {

x:0,

y:0

}另外为了确保拖动在限定区域内,我们需要设置滚动截断的样式,让元素不能在出现滚动条后还能拖动,因为这样会出现问题。我们定义一个方法用来设置,代码如下:

const setOverflow = () => {

const limitEle = (containerElement.current || document.body) as HTMLElement;

if (isLimitX) {

limitEle.style.overflowX = 'hidden';

} else {

limitEle.style.overflowX = '';

}

if (isLimitY) {

limitEle.style.overflowY = 'hidden';

} else {

limitEle.style.overflowY = '';

}

}这个方法也就比较好理解了,如果使用的时候传入isLimitX那么就设置overflowX为hidden,否则不设置,y方向同理。

核心代码的实现第三步---监听事件

接下来,我们在react的钩子函数中监听事件,此时有了一个选择就是钩子函数我们使用useEffect还是useLayoutEffect呢?要决定使用哪个,我们需要知道这两个钩子函数的区别,这个超出了本文范围,不提及,可以查阅相关资料了解,这里我选择的是useLayoutEffect。

在钩子函数的回调函数中,我们首先将拖拽元素和容器元素存储下来,然后如果拖拽元素不存在,我们就不执行后续事件,回调函数返回一个函数,在该函数中我们移除对应的事件。代码如下:

useLayoutEffect(() => {

element.current = typeof el === 'function' ? el() : el.current;

containerElement.current = typeof containerRef === 'function' ? containerRef() : containerRef?.current;

if (!element.current) {

return;

}

element.current.addEventListener(eventType[0], onStartHandler);

return () => {

element.current?.removeEventListener(eventType[0], onStartHandler);

}

}, []);核心代码实现第四步---拖动开始事件回调

接下来,我们来看一下onStartHandler函数的实现,在这个函数中,我们主要其实就是存储按下时候的坐标值,并且设置状态以及拖拽元素的鼠标样式和滚动截断的样式,随后当然是监听拖动和拖动结束事件,代码如下:

const onStartHandler = useCallback((e:Event) => {

isStart = true;

const target = element.current as HTMLElement;

if (target) {

target.style.cursor = 'move';

}

const event: Touch | MouseEvent = e instanceof TouchEvent ? e.changedTouches[0] : e as MouseEvent;

const { clientX, clientY } = event;

downPosition.x = clientX - target.offsetLeft;

downPosition.y = clientY - target.offsetTop;

setOverflow();

window.addEventListener(eventType[1], onMoveHandler);

window.addEventListener(eventType[2], onUpHandler);

}, []);pc端是可以直接从事件对象中拿出来坐标,可是在移动端我们要通过一个changedTouches属性,这个属性是一个伪数组,第一项就是我们要获取到的坐标值。

接下来就是拖动事件的回调函数以及拖动结束的回调函数的实现了。

核心代码实现第五步---拖动事件回调

这是一个最核心实现的回调,我们在这个函数当中是要计算坐标的,首先当然是根据isStart状态来确定是否执行后续逻辑,其次,还要获取到当前拖拽元素,因为我们要根据这个拖拽元素的宽高做坐标的计算,另外还要获取到容器元素,如果没有提供容器元素,那么就是我们最开始定义的globalWidthHeight中取,然后获取鼠标按下时的x和y坐标值,将当前移动的x坐标和y坐标分别与按下时相减,就是我们的移动x坐标和y坐标,如果有设置isLimitX和isLimitY,我们还要额外设置滚动截断样式,并且我们通过将0和moveX以及最大值(也就是屏幕或者是容器元素的宽高减去拖拽元素的宽高)得到我们的最终的moveX和moveY值。

最后,我们将最终的moveX和moveY用react的状态存储起来即可。代码如下:

const onMoveHandler = useCallback((e: Event) => {

if (!isStart) {

return;

}

setOverflow();

const event: Touch | MouseEvent = e instanceof TouchEvent ? e.changedTouches[0] : e as MouseEvent;

const { clientX, clientY } = event;

if (!element.current) {

return;

}

const { offsetWidth, offsetHeight} = element.current as HTMLElement;

const { offsetWidth: containerWidth, offsetHeight: containerHeight } = (containerElement.current as HTMLElement ||globalWidthHeight);