低代码是“未来”还是“骗局”?作为前端我被内耗到了

「我一个前端,最后成了平台数据填表员,写页面?不存在的。」

😅项目开始前,我是兴奋的

当领导说“这个项目我们用低代码平台做,提效百分百”,我甚至有点激动。

作为一个写了 5 年组件的前端老油子,谁不想脱离日复一日的 v-model 和 props 地狱?

领导还补充:“平台我们组自己封装的,配个 schema 就能跑,前端工程师只需要写逻辑。”

我一听这话,心想:

终于要进入“写配置赚钱”的时代了!

然而,我万万没想到——这段低代码旅程,最后让我怀疑人生。

😵上线第一天,我差点把键盘砸了

第一个需求很简单:

做个带搜索、分页、导出 Excel 的用户列表页。

我打开平台,选择“表格组件”,拖入“搜索框”,配置字段、绑定接口——一切都看起来毫无门槛。

结果运行之后,搜索没反应、分页错乱、导出根本没绑定。

我一查 schema,300 多行配置里,居然混了三种不同的写法:

{

"onSearch": "handleSearch",

"onSearch()": "handleSearch",

"onSearchEvent": "handleSearch"

}

问后端:“你这个文档是哪个是对的?”

后端说:“都对,我们兼容了。”

我瞬间明白:这不是低代码,这是自制混沌生成器。

🤯技术债太多,修个 key,整页全崩

最魔幻的一次,是我想修改表格的一个字段名,从 user_name 改成 username。

我只是改了 schema 的字段名,结果:

- 表格没显示

- 搜索没了

- 编辑表单也报错

- 提交接口直接抛了个 500

我调试了三个小时,才发现平台内部是按字段名 字符串拼接 key 绑定状态 的……只要字段名变了,所有逻辑都得重配。

我恍然大悟:

传统开发用 IDE 报错提醒你;低代码等你点击线上按钮才告诉你挂了。

😓协作地狱:产品配页面,我修 schema

最痛苦的不是技术问题,而是人。

产品说:“我来拖页面,你只用帮我看看为什么点了没反应。”

然后我收到一个 schema 文件,2000 行,不带注释,结构是这样:

{

"component": "Form",

"props": {

"items": [

{

"label": "名称",

"field": "formA.formB.userName",

"rules": "{ required: true }",

"props": {

"onClick": "fn1()"

}

}

]

}

}

我想问三件事:

- 你这个路径到底是怎么拼出来的?

- 为什么校验规则是字符串?

- 你拖了个按钮怎么会触发五个请求?

我调试一天,结论是:产品误操作删除了一个容器组件,但平台没报错,直接让数据结构断链。

🧨所谓低代码:把逻辑封死、把锅甩你

我总结这个项目两个最深的坑:

1. 复杂交互,低代码写不来

比如“用户选择类型后,自动拉接口重新加载选项”这种需求,纯配置根本搞不定。

最后我只能写自定义组件注入到平台里,甚至还要写类似:

platform.on("fieldChange", (field, value) => {

if (field === "type") {

reloadOptions(value)

}

})

这叫低代码吗?我写的代码比原来还绕。

2. 前端不是没活了,是变成了“修配置+查日志工程师”

- 页面功能跑飞了?前端看 schema;

- 按钮不响应?前端查绑定字段;

- 接口返回异常?前端加拦截 hook;

- 表单校验失败?前端写正则规则;

最后我只写了两行 JS,却维护了十几套 JSON。

我真的开始怀疑,前端的价值,是不是变成了“修别人的 schema”?

🧩我从这个项目学到的东西

不是说低代码没用,而是:

不是所有团队都配拥有一套低代码平台。

低代码系统真正的“提效”,需要这些前提:

- 强约束的规范体系(字段、组件、交互都必须有标准)

- 良好的权限隔离机制(避免“产品能改逻辑,运营能删字段”)

- 持续有人维护平台底层能力(不然技术债只会越来越重)

- 合理的分工协作机制(schema 的维护不应该是前端一个人干)

否则,它只是一个混乱责任分配工具,表面上 everyone can build,实际上 everyone push bugs。

📌低代码,不是骗局,也不是未来——是一个选项

如果你问我现在怎么看低代码?

我的回答是:

低代码不是“未来”也不是“骗局”,而是“项目管理方式的折中”。

它适合一些场景:

- 表单多、CRUD 重复度高的后台系统;

- 业务快速试错、页面变动频繁的 MVP 阶段;

- 运营自己想搭点落地页的场景。

但如果你希望:

- 页面复杂,交互灵活;

- 可测试、可维护、可拓展;

- 高性能、大工程;

那——你得写代码。

🗣最后

你也踩过低代码的坑吗?

有没有类似“debug 三小时发现产品配错 schema”的经历?

📌 你可以继续看我的《为什么》系列文章

来源:juejin.cn/post/7514611888991387667

前端难还是后端难?作为八年后端开发,我想说点实话

前端难还是后端难?作为八年后端开发,我想说点实话

前端容易吗?不容易。

后端轻松吗?也不轻松。

那到底哪个更难?

这事还真不是一句话能说清楚的……

一、先说说我个人的背景

我是一个写了 8 年 Java 后端的程序员,经历过中后台系统、金融系统、ToC App 的服务端架构,也跟前端打了无数交道。从最早的 jQuery 到现在的 Vue、React、Vite,从最早的 JSP 页面到现在的前后端分离,我见证了不少“变化”。

我不是要拉踩谁,只是想以一个偏后端开发者的视角,聊聊我对“前端难还是后端难”这个话题的理解。

二、前端的“难”是不断变化的“浪潮”

不得不承认,前端的变化速度是真的快。去年刚学完 Vue 2,今年要学 Vue 3;React 的 Hook 还没深入掌握,新的 Server Component 又来了;Webpack 配熟了,Vite 火了;CSS 还没写顺手,Tailwind 席卷而来。

除了框架和工具链的变化,更别说适配各种浏览器、屏幕尺寸、终端设备、无障碍要求、多语言、性能优化、SEO、交互设计……

而且最近几年,前端逐渐“全栈化”:你可能要写服务端渲染(SSR)、搞 Node 服务、上 Docker 部署、调数据库、甚至自己写接口 mock。

前端难吗?难,而且是越来越难。

三、后端的“难”是看不见的深度

后端的难,往往藏在系统的底层逻辑中。你可能看不到一个后端接口的“UI 效果”,但它背后往往涉及:

- 数据库设计 & 索引优化

- 分布式事务

- 消息队列 & 异步处理

- 缓存策略 & 数据一致性

- 服务容灾 & 高可用架构

- 权限系统、加密解密、审计日志

- 安全防护(SQL 注入、XSS、CSRF)

- 性能调优 & JVM 调试

- CI/CD、灰度发布、日志平台接入

而且一旦出问题,前端崩了是“用户体验不好”,后端崩了是“公司赔钱” 。这不是开玩笑,有一次我们一个订单服务接口挂了 5 分钟,损失了几十万。

后端难吗?当然难,而且是“看不见但不能错”的难。

四、我最怕的不是“前端难”或“后端难”,而是互相看不起

说实话,我见过太多前后端互相“看不上”的情况:

- 后端觉得前端就是摆样子,“你不就封个壳子嘛?”

- 前端觉得后端接口又臭又长,“你这 JSON 谁看得懂?”

- 后端吐槽前端不会调接口,前端吐槽后端不会写文档……

但你仔细去看,一个优秀的前端开发,往往比很多“伪全栈”更懂系统结构;一个优秀的后端,也会在意接口的易用性、响应速度和文档清晰度。

技术没有高低,但人有格局。

五、站在“代码人生”的角度看,难易是阶段性的

我年轻的时候觉得后端“更高级”,因为能接触系统底层、数据和业务逻辑。但这几年,我越来越觉得前端也有它独特的价值:

- 是前端让用户第一眼喜欢上产品;

- 是前端让复杂的系统变得“看得见”;

- 是前端在用户和系统之间,搭了一座桥。

你说哪个更重要?没有谁离开谁就能独立运行的系统。

我现在更看重的是协作、共建、以及对整个产品的理解。做前端也好,后端也罢,最终我们解决的都是“人”的问题 —— 让人更高效、更便捷、更愉快地使用系统。

六、那到底哪个更难?

如果你非要我选一个答案,我只能说:

哪个你不熟,哪个就难。

前端和后端,都有容易入门但难以精进的曲线。你用 jQuery 写个页面不难,但你做一个大型可维护的组件库就难了;你写个 CRUD 接口不难,但你做一个高并发分布式系统就非常难。

真正的难点在于:你愿不愿意持续去深入、去理解、去完善自己的认知体系。

七、写在最后:别问“哪个难”,问“你想走多远”

我见过写前端写到年薪百万的,也见过写后端写到身心俱疲的。

我见过全栈工程师一人顶两人,也见过只会写“增删改查”却年薪 30w 的老哥。

这行最不缺的,就是例外;最需要的,是清醒的自我认知。

别纠结哪个更难,多花时间让自己变强,才是正解。

**你觉得前端难,还是后端难?你有没有在项目里遇到“前后端合作”的那些故事?欢迎评论区聊聊.

来源:juejin.cn/post/7516897654170222592

进入外包,我犯了所有程序员都会犯的错!

前言

前些天有位小伙伴和我吐槽他在外包工作的经历,语气颇为激动又带着深深的无奈。

本篇以他的视角,进入他的世界,看看这一段短暂而平凡的经历。

1. 上岸折戟尘沙

本人男,安徽马鞍山人士,21年毕业于江苏某末流211,在校期间转码。

上网课期间就向往大城市,于是毕业后去了深圳,找到了一家中等IT公司(人数500+)搬砖,住着宝安城中村,来往繁华南山区。

待了三年多,自知买房变深户无望,没有归属感,感觉自己也没那么热爱技术,于是乎想回老家考公务员,希望待在宇宙的尽头。

24年末,匆忙备考,平时工作忙里偷闲刷题,不出所料,笔试卒,梦碎。

2. 误入外包

复盘了备考过程,觉得工作占用时间过多,想要找一份轻松点且离家近的工作,刚好公司也有大礼包的指标,于是主动申请,辞别深圳,前往徽京。

Boss上南京的软件大部分是外包(果然是外包之都),前几年外包还很活跃,这些年外包都沉寂了不少,找了好几个月,断断续续有几个邀约,最后实在没得选了,想着反正就过渡一下挣点钱不寒碜,接受了外包,作为WX服务某为。薪资比在深圳降了一些,在接受的范围内。

想着至少苟着等待下一次考公,因此前期做项目比较认真,遇到问题追根究底,为解决问题也主动加班加点,同为WX的同事都笑话我说比自有员工还卷,我却付之一笑。

直到我经历了几件事,正所谓人教人教不会,事教人一教就会。

3. 我在外包的二三事

有一次,我提出了自有员工设计方案的衍生出的一个问题,并提出拉个会讨论一下,他并没有当场答应,而是回复说:我们内部看看。

而后某天我突然被邀请进入会议,聊了几句,意犹未尽之际,突然就被踢出会议...开始还以为是某位同事误触按钮,然后再申请入会也没响应。

后来我才知道,他们内部商量核心方案,因为权限管控问题,我不能参会。

这是我第一次体会到WX和自有员工身份上的隔阂。

还有一次和自有员工一起吃饭的时候,他不小心说漏嘴了他的公积金,我默默推算了一下他的工资至少比我高了50%,而他的毕业院校、工作经验和我差不多,瞬间不平衡了。

还有诸如其它的团建、夜宵、办公权限、工牌等无一不是明示着你是外包员工,要在外包的规则内行事。

至于转正的事,头上还有OD呢,OD转正的几率都很低,好几座大山要爬呢,别想了。

3. 反求诸己

以前网上看到很多吐槽外包的帖子,还总觉得言过其实,亲身经历了才刻骨铭心。

我现在已经摆正了心态,既来之则安之。正视自己WX的身份,给多少钱干多少活,给多少权利就承担多少义务。

不攀比,不讨好,不较真,不内耗,不加班。

另外每次当面讨论的时候,我都会把工牌给露出来,潜台词就是:快看,我就是个外包,别为难我😔~

另外我现在比较担心的是:

万一我考公还是失败,继续找工作的话,这段外包经历会不会是我简历的污点😢

当然这可能是我个人感受,其它外包的体验我不知道,也不想再去体验了。

对,这辈子和下辈子都不想了。

附南京外包之光,想去或者不想去的伙伴可以留意一下:

来源:juejin.cn/post/7511582195447824438

为什么说 AI 时代,前端开发者对前端工程化的要求更高了❓❓❓

前端工程化在前端领域地位极高,因为它系统性地解决了前端开发中效率、协作、质量、维护性等一系列核心问题,可以说是现代前端技术体系的基石。

前端工程化带来的价值可以从这四个方面看:

- 提升开发效率:

- 模块化开发:通过组件、模块拆分使开发更加清晰,复用性更强。

- 自动化构建:Webpack、Vite 等工具自动处理打包、压缩、转译等。

- 代码热更新 / HMR:开发过程中能实时看到改动,节省调试时间。

- 规范团队协作

- 代码规范检查:如 ESLint、Stylelint 统一代码风格,避免“风格大战”。

- Git 提交规范:如使用 commitlint + husky 保证提交信息标准化。

- 持续集成(CI):如 GitHub Actions、Jenkins 保证每次提交自动测试、构建。

- 提升代码质量和可维护性

- 单元测试 / 集成测试:如 Jest、Cypress 确保代码稳定可靠。

- 类型系统支持:TypeScript 保证更严格的类型检查,降低 Bug 率。

- 文档生成工具:如 Storybook、jsdoc 方便维护和阅读。

- 自动化部署与运维

- 自动化构建发布流程(CI/CD)使得上线更安全、更快速。

- 多环境配置管理(开发/测试/生产)更加方便和稳定。

总的来说,前端工程化让开发者从单纯的 “切图仔” 成长为能够参与大型系统开发的工程师。通过引入规范与工具,不仅显著提升了团队协作效率,还有效减少了开发过程中的冲突与返工,成为现代前端团队协作的 “润滑剂”。

什么是前端工程化

前端工程化 大约在 2018 年前后在国内被广泛提出,其核心是将后端成熟的软件工程理念、工具与流程系统性地引入前端开发。

它旨在通过规范、工具链与协作流程,提升开发效率、保障交付质量、降低维护成本。前端工程化不只是技术选型,更是一种体系化、流程化的开发方式。

其核心包括代码规范、自动化构建、模块化设计、测试体系和持续集成等关键环节。通过工程化,前端从“写页面”转向“做工程”,实现了从个体开发到团队协作的转变。

它不仅优化了前端的生产方式,也推动了大型系统开发中前端角色的重要性。如今,前端工程化已成为现代前端开发不可或缺的基础能力。

为什么 AI 时代,前端工程化更重要

在 AI 时代,前端工程化不仅没有“过时”,反而变得更重要,甚至成为人机协作高效落地的关键基石。原因可以从以下几个方面理解。

虽然 AI 可以辅助生成代码、文档甚至 UI,但它并不能替代工程化体系,原因有:

- AI 的代码质量不稳定:没有工程化流程约束,容易引入 Bug 或不一致的风格。

- AI 更依赖工程规范作为提示上下文:没有良好的工程结构,AI 输出也会混乱低效。

- AI 更像“助理”,而非“工程师”:它执行快,但依然需要工程体系保障产出质量和集成稳定性。

最差的情况下有可能会删除或者修改你之前已经写好的代码,如果缺少这些工程化的手段,你甚至不知道它已经修改你的代码了,最终等到上线的时候无数的 bug 产生。

通过标准化输出让 AI 更智能,清晰的项目结构、代码规范、模块划分能让 AI 更准确地补全、修改或重构代码。例如 ESLint、TypeScript 的规则为 AI 提供了明确的限制条件,有助于生成更高质量的代码。

在生成的代码需要规范,生成完成之后更需要检验,大概的流程也有如下几个方面:

- 格式化检查(Prettier、ESLint)

- 单元测试(Jest)

- 构建打包(Vite/Webpack)

- 自动部署(CI/CD)

没有工程化,AI 产出的代码难以被真正“上线使用”。

AI 时代,对一些 CRUD 的简单要求减少了,但是对工程化提出了更高要求。

| 方面 | 普通时代要求 | AI 时代新挑战 |

|---|---|---|

| 模块结构 | 清晰划分 | 需辅助 AI 理解上下文 |

| 代码规范 | 避免团队矛盾 | 指导 AI 输出符合规范 |

| 自动化测试 | 保证功能正确 | 验证 AI 代码不会引发异常 |

| CI/CD 流程 | 提升上线效率 | 确保 AI 代码自动验证上线 |

前端工程化

接下来我们将分为多个小节来讲解一下前端工程化的不同技术充当着什么角色。

技术选型

在前端工程化中,技术选型看似是一道“选择题”,本质上却关系到项目的开发效率、团队协作和未来的可维护性。对于框架选择而言,建议优先考虑两个关键因素:

- 团队熟悉程度:选择你或团队最熟悉的框架,能确保在遇到复杂或疑难问题时,有人能迅速定位问题、解决“坑点”,避免因为不熟悉而拖慢项目进度。

- 市场占有率与人才生态:选择主流、活跃度高的框架(如 Vue、React),不仅能更容易找到合适的开发者,还意味着有更丰富的社区资源、第三方生态和维护支持,降低长期人力与技术风险。

统一规范

统一规范又分为代码规范、git 规范、项目规范和 UI 规范。

代码规范

统一代码规范带来的好处是显而易见的,尤其在团队开发中更显重要:

- 提升团队协作效率:统一的代码风格能让团队成员在阅读和理解他人代码时无障碍,提高沟通效率,减少因风格差异带来的理解成本。

- 降低项目维护成本:规范的代码结构更易读、易查、易改,有助于快速定位问题和后期维护。

- 促进高效 Code Review:一致的代码格式可以让审查者专注于业务逻辑本身,而非纠结于命名、缩进等细节。

- 帮助程序员自身成长:遵循良好的代码规范,有助于开发者养成系统化的编程思维,提升工程意识和代码质量。

当团队成员都严格遵循统一的代码规范时,整个项目的代码风格将保持高度一致,看别人的代码就像在看自己的代码一样自然顺畅。

为了实现这一目标,我们可以借助工具化手段来强制和规范编码行为,例如使用 ESLint 检查 JavaScript/TypeScript 的语法和代码质量,Stylelint 统一 CSS/SCSS 的书写规范,而 Prettier 则负责自动格式化各类代码,使其保持整洁一致。

这些工具不仅能在编码阶段就发现潜在问题,还能集成到 Git Hook 或 CI 流程中,确保所有提交的代码都符合团队标准。统一规范减少了 code review 中对格式问题的争论,让团队更专注于业务逻辑的优化。

更重要的是,长期在规范的约束下编程,有助于开发者养成良好的工程素养和职业习惯,提升整体开发质量和协作效率。工具是手段,习惯是目标,工程化规范最终是为了让每一位开发者都能写出“团队级”的代码。

除了上面提到的,还有很多相同功能的工具这里就不细说了。

Git 规范

Git 规范主要指团队在使用 Git 进行代码版本管理时,对分支策略、提交信息、代码合并方式等的统一约定,其目标是提升协作效率、降低沟通成本、保障版本可控。

分支管理规范可以遵循如下 Git Flow 模型:

main # 生产环境分支

develop # 开发集成分支

feature/* # 功能分支

release/* # 发布准备分支

hotfix/* # 线上紧急修复分支

分支重要,提交信息规范也更重要,一份清晰规范的提交信息对后期维护、回滚、自动发布都非常重要,好的提交信息让其他协作人员知道你这个分支具体做了什么。

推荐使用 Conventional Commits 规范,格式如下:

<type>():

常见的

| 类型 | 说明 |

|---|---|

| feat | 新增功能 |

| fix | 修复 bug |

| docs | 修改文档 |

| style | 格式修改(不影响代码运行) |

| refactor | 重构(无新功能或修复) |

| test | 添加测试 |

| chore | 构建过程或辅助工具变动 |

如下示例所示:

feat(login): 添加用户登录功能

fix(api): 修复接口返回字段错误

docs(readme): 完善项目使用说明

配套的工具推荐如下表所示:

| 工具 | 作用 |

|---|---|

| Commitlint | 校验提交信息是否符合格式规范 |

| Husky | Git 钩子管理工具(如提交前检查) |

| lint-staged | 提交前只格式化/检查改动的文件 |

| Standard Version | 自动生成 changelog、自动打 tag 和版本号 |

Git 规范,是让代码“有条不紊”地流动在团队之间的交通规则,是高效协作和持续交付的基础设施。

项目规范

项目规范是对整个项目工程的结构、组织方式、开发约定的一套统一标准,它能帮助团队协作、代码维护、快速上手和高质量交付。

项目目录结构规范可以让项目保持统一、清晰的项目目录结构,有助于快速定位文件、分工协作,如下是一个简单的目录规范:

src/

├── assets/ # 静态资源(图片、字体等)

├── components/ # 可复用的基础组件

├── pages/ # 页面级组件

├── services/ # API 请求模块

├── utils/ # 工具函数

├── hooks/ # 自定义 hooks(React 项目)

├── styles/ # 全局样式

├── config/ # 配置文件(如常量、环境变量)

├── router/ # 路由配置

├── store/ # 状态管理(如 Vuex / Redux)

└── main.ts # 应用入口

这只是一个很简答也很通用的目录结构,还有很多进阶的目录结构方案。

命名方式,这个可以根据不同的团队不同的风格来指定。

部署

借助自动化流程实现一键部署或者自动部署,常用的工具主要有以下:

- GitHub Actions

- GitLab CI

- Jenkins

流程通常如下:

Push → 检查代码规范 → 构建 → 运行测试 → 上传产物 → 通知部署 → 上线

可以参考一下 Action 配置:

name: Deploy Next.js to Alibaba Cloud ECS

on:

push:

branches:

- main

jobs:

deploy:

runs-on: ubuntu-latest

steps:

- name: Checkout code

uses: actions/checkout@v4.2.0

- name: Set up Node.js

uses: actions/setup-node@v4.2.0

with:

node-version: "22.11.0"

- name: Install pnpm

run: npm install -g pnpm@9.4.0

- name: Deploy to server via SSH

uses: appleboy/ssh-action@v1.2.1

with:

host: ${{ secrets.SERVER_HOST }}

username: ${{ secrets.SERVER_USERNAME }}

port: ${{ secrets.SERVER_PORT }}

password: ${{ secrets.SERVER_PASSWORD }}

script: |

# 显示当前环境信息

echo "Shell: $SHELL"

echo "PATH before: $PATH"

# 加载环境配置文件

source ~/.bashrc

source ~/.profile

# 如果使用 NVM,加载 NVM 环境

export NVM_DIR="$HOME/.nvm"

[ -s "$NVM_DIR/nvm.sh" ] && \. "$NVM_DIR/nvm.sh"

# 添加常见的 Node.js 安装路径到 PATH

export PATH="$HOME/.nvm/versions/node/*/bin:/usr/local/bin:/usr/bin:/bin:$HOME/.npm-global/bin:$PATH"

echo "PATH after: $PATH"

# 查找 npm 的位置

which npm || echo "npm still not found in PATH"

# 使用绝对路径查找 npm

NPM_PATH=$(find /usr -name npm -type f 2>/dev/null | head -1)

if [ -n "$NPM_PATH" ]; then

echo "Found npm at: $NPM_PATH"

export PATH="$(dirname $NPM_PATH):$PATH"

fi

# 确保目标目录存在

mkdir -p /home/interview-guide

cd /home/interview-guide

# 如果本地仓库不存在,进行克隆

if [ ! -d "/home/interview-guide/.git" ]; then

echo "Cloning the repository..."

# 删除可能存在的空目录内容

rm -rf /home/interview-guide/*

# 使用 SSH 方式克隆

git clone git@github.com:xun082/interview-guide.git .

else

# 确保远程 URL 使用 SSH

git remote set-url origin git@github.com:xun082/interview-guide.git

# 获取最新代码

git fetch origin main

git reset --hard origin/main

fi

# 使用找到的 npm 路径或尝试直接运行

if [ -n "$NPM_PATH" ]; then

$NPM_PATH install -g pnpm@9.4.0

$NPM_PATH install -g pm2

else

npm install -g pnpm@9.4.0

npm install -g pm2

fi

# 安装依赖

pnpm install || npm install

# 构建项目

pnpm run build || npm run build

# 重启应用

pm2 restart interview-guide || pm2 start "pnpm start" --name interview-guide || pm2 start "npm start" --name interview-guide

这段 GitHub Actions 配置实现了将 Next.js 项目自动部署到阿里云 ECS 服务器的流程。它在检测到 main 分支有新的代码提交后,自动拉取代码、安装依赖并构建项目。随后通过 SSH 远程连接服务器,拉取或更新项目代码,并使用 PM2 启动或重启应用。整个流程自动化,无需人工干预,保障部署高效、可重复。

除了 PM2 之外,我们还可以使用 Docker 镜像部署。

🛡️ 监控

前端监控是指:对 Web 应用在用户真实环境中的运行状态进行实时采集与分析,以发现性能瓶颈、错误异常和用户行为,最终帮助开发团队提升系统稳定性和用户体验。

🚦 性能监控

性能监控的目标是衡量页面加载速度、交互流畅度等关键性性能指标。

常见指标:

- 首屏加载时间(FP/FCP)

- 页面完全加载时间(Load)

- 首次输入延迟(FID)

- 长任务(Long Task)

- 慢资源加载(如图片、脚本)

它有助于定位性能瓶颈(如资源过大、阻塞脚本)、优化用户体验(如加载缓慢或白屏问题),并支持性能回归分析,及时发现上线后的性能退化。

❌ 错误监控

错误监控的目标是捕捉并上报运行时异常,辅助开发快速修复 Bug。

常见的错误类型主要有以下几个方面:

| 错误类型 | 示例说明 |

|---|---|

| JS 运行错误 | ReferenceError, TypeError 等 |

| Promise 异常 | unhandledrejection |

| 资源加载失败 | 图片、脚本、字体 404、403 |

| 网络请求异常 | 接口失败、超时、断网等 |

| 跨域/白屏 | CORS 错误、DOM 元素为空 |

| 控制台报错 | console.error() 日志监控 |

| 用户行为异常 | 点击无响应、重复操作、高频异常等 |

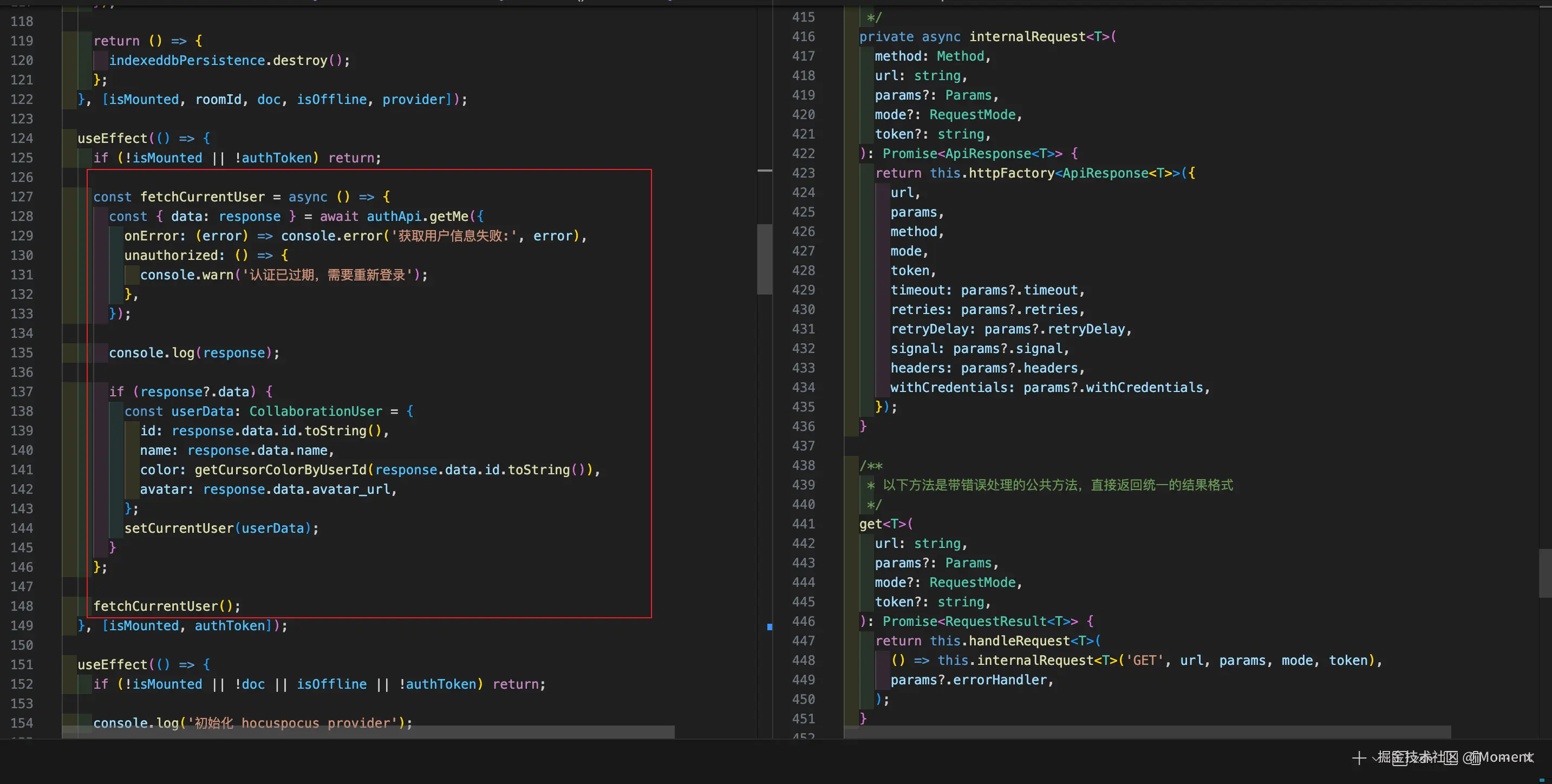

假设我们使用了 fetch 进行封装,那么我们就可以对错误进行统一处理,后续我们可以再具体调用的时候根据不同的场景来传入不同的错误提示告知用户:

错误上报

数据上报是指前端在运行过程中将采集到的监控信息(性能、错误、行为等)发送到服务端的过程。它是前端监控从“收集”到“分析”的桥梁。

上报的数据类型主要有以下几个方面:

| 类型 | 说明 |

|---|---|

| 性能数据 | 页面加载时间、资源加载时间、Web Vitals 等 |

| 错误信息 | JS 异常、Promise 异常、请求失败、白屏等 |

| 用户行为 | 点击、跳转、页面停留时间、操作路径等 |

| 自定义事件 | 特定业务事件,如支付、注册等 |

| 环境信息 | 浏览器版本、设备类型、操作系统、用户 IP 等 |

数据上报需要重点考虑的几个关键因素:

- 怎么上报(上报方式)

- 使用 sendBeacon、fetch、img 打点还是 WebSocket?

- 是否异步?是否阻塞主线程?

- 是否需要加密、压缩或编码?

建议:选择 异步非阻塞 且浏览器支持好的方式(优先 sendBeacon),并对数据做统一封装处理。

- 何时上报(上报时机)

- 立即上报:错误发生后马上发送(如 JS 报错)

- 延迟上报:页面稳定后延迟几秒,防止干扰首屏加载

- 页面卸载前上报:用 sendBeacon 上报用户停留数据等

- 批量上报:积累一批数据后统一发送,减少请求频率

- 定时上报:用户停留一段时间后定期上报(行为数据)

建议:根据数据类型区分时机,错误即时上报、性能延迟上报、行为数据可批量处理。

- 上报频率控制(防抖 / 节流 / 采样)

- 错误或点击频繁时可能产生大量上报请求

- 需要加防抖、节流机制,或采样上报(如只上报 10% 用户)

🔍 建议:对于高频行为(如滚动、点击),加防抖或只上报部分用户行为,避免拖垮前端或服务端。

- 异常处理与重试机制:遇到网络断开、后端失败等应支持自动重试或本地缓存,可将数据暂存至 localStorage,等网络恢复后重发

- 数据结构设计:统一字段格式、数据类型,方便服务端解析,包含上下文信息:页面 URL、用户 ID、浏览器信息、时间戳等,如下所示:

{

"type": "error",

"event": "ReferenceError",

"message": "xxx is not defined",

"timestamp": 1716280000000,

"userId": "abc123",

"url": "https://example.com/home"

}

总的来说,数据上报是前端监控的核心环节,但只有在合适的时机,用合适的方式,上报合适的数据,才能真正发挥价值。

来源:juejin.cn/post/7506414257401004071

我本是写react的,公司让我换赛道搞web3D

当你在会议室里争论需求时,

智慧工厂的数字孪生正同步着每一条产线的脉搏;

当你对着平面图想象空间时,

智慧小区的三维模型已在虚拟世界精准复刻每一扇窗的采光。

当你在CAD里调整参数时,

数字孪生城市的交通流正实时映射每辆车的轨迹;

当你等待客户确认方案时,

机械臂的3D仿真已预演了十万次零误差的运动路径;

当你用二维图纸解释传动原理时,

可交互的3D引擎正让客户‘拆解’每一个齿轮;

当你担心售后维修难描述时,

AR里的动态指引已覆盖所有故障点;

当你用PS拼贴效果图时,

VR漫游的业主正‘推开’你设计的每一扇门;

当你纠结墙面材质时,

光影引擎已算出了午后3点最温柔的折射角度;

从前端到Web3D,

不是换条赛道,

而是打开新维度。

韩老师说过:再牛的程序员都是从小白开始,既然开始了,就全心投入学好技术。

🔴 工具

所有的api都可以通过threejs官网的document,切成中文,去搜:

🔴 平面

⭕️ Scene 场景

场景能够让你在什么地方、摆放什么东西来交给three.js来渲染,这是你放置物体、灯光和摄像机的地方。

import * as THREE from "three";

// console.log(THREE);

// 目标:了解three.js最基本的内容

// 1、创建场景

const scene = new THREE.Scene();

⭕️ camera 相机

import * as THREE from "three";

// console.log(THREE);

// 目标:了解three.js最基本的内容

// 1、创建场景

const scene = new THREE.Scene();

// 2、创建相机

const camera = new THREE.PerspectiveCamera(

75, // 相机的角度

window.innerWidth / window.innerHeight, // 相机的宽高比

0.1, // 相机的近截面

1000 // 相机的远截面

);

// 设置相机位置

camera.position.set(0, 0, 10); // 相机位置 (X轴坐标, Y轴坐标, Z轴坐标)

scene.add(camera); // 相机添加到场景中

⭕️ 物体 cube

import * as THREE from "three";

// console.log(THREE);

// 目标:了解three.js最基本的内容

// 1、创建场景

const scene = new THREE.Scene();

// 2、创建相机

const camera = new THREE.PerspectiveCamera(

75, // 相机的角度

window.innerWidth / window.innerHeight, // 相机的宽高比

0.1, // 相机的近截面

1000 // 相机的远截面

);

// 设置相机位置

camera.position.set(0, 0, 10); // 相机位置 (X轴坐标, Y轴坐标, Z轴坐标)

scene.add(camera); // 相机添加到场景中

// 添加物体

// 创建几何体

const cubeGeometry = new THREE.BoxGeometry(1, 1, 1); // 创建立方体的几何体 (长, 宽, 高)

const cubeMaterial = new THREE.MeshBasicMaterial({ color: 0xffff00 }); // MeshBasicMaterial 基础网格材质 ({ color: 0xffff00 }) 颜色

// 根据几何体和材质创建物体

const cube = new THREE.Mesh(cubeGeometry, cubeMaterial); // 创建立方体的物体 (几何体, 材质)

// 将几何体添加到场景中

scene.add(cube); // 物体添加到场景中

⭕️ 渲染 render

// 初始化渲染器

const renderer = new THREE.WebGLRenderer();

// 设置渲染的尺寸大小

renderer.setSize(window.innerWidth, window.innerHeight); // 设置渲染的尺寸大小 (窗口宽度, 窗口高度)

// console.log(renderer);

// 将webgl渲染的canvas内容添加到body

document.body.appendChild(renderer.domElement); // 将webgl渲染的canvas内容添加到body

// 使用渲染器,通过相机将场景渲染进来

renderer.render(scene, camera); // 使用渲染器,通过相机将场景渲染进来 (场景, 相机)

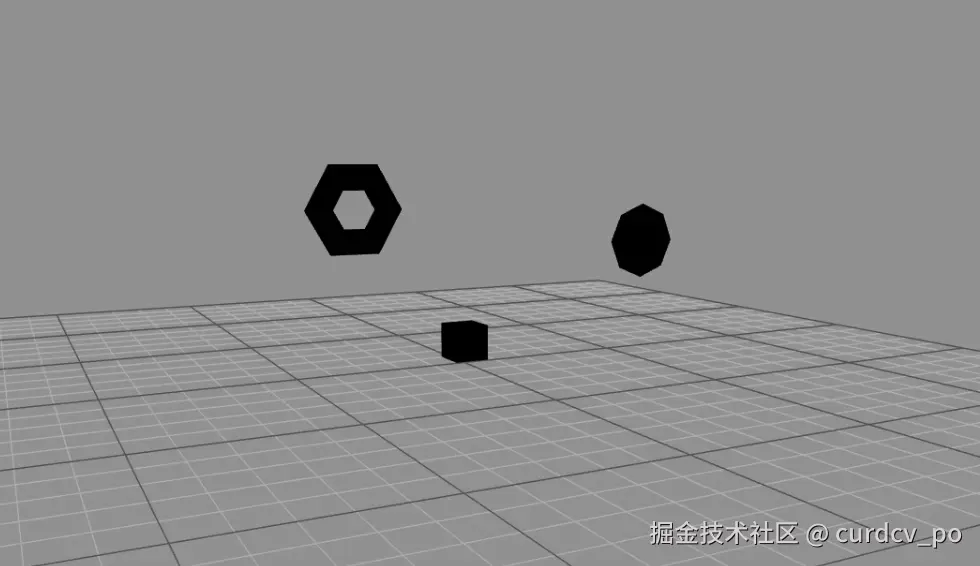

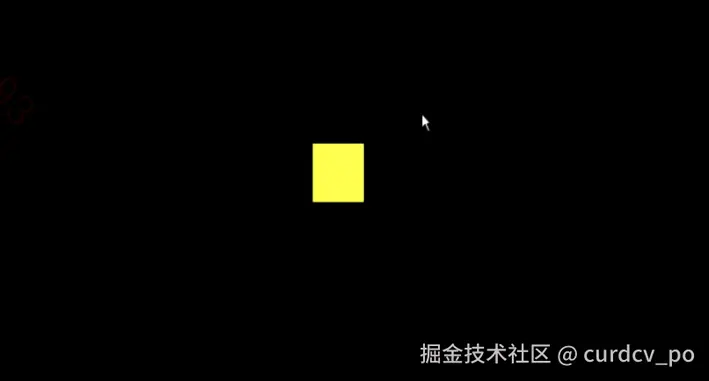

⭕️ 效果

效果是平面的:

到这里,还不是3d的,如果要加3d,要加一下控制器。

🔴 3d

⭕️ 控制器

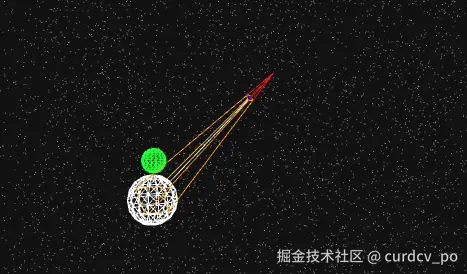

添加轨道。像卫星☄围绕地球🌏,环绕查看的视角:

// 导入轨道控制器

import { OrbitControls } from "three/examples/jsm/controls/OrbitControls";

// 目标:使用控制器查看3d物体

// // 使用渲染器,通过相机将场景渲染进来

// renderer.render(scene, camera);

// 创建轨道控制器

const controls = new OrbitControls(camera, renderer.domElement); // 创建轨道控制器 (相机, 渲染器dom元素)

controls.enableDamping = true; // 设置控制器阻尼,让控制器更有真实效果。

function render() {

renderer.render(scene, camera); // 浏览器每渲染一帧,就重新渲染一次

// 渲染下一帧的时候就会调用render函数

requestAnimationFrame(render); // 浏览器渲染下一帧的时候就会执行render函数,执行完会再次调用render函数,形成循环,每秒60次

}

render();

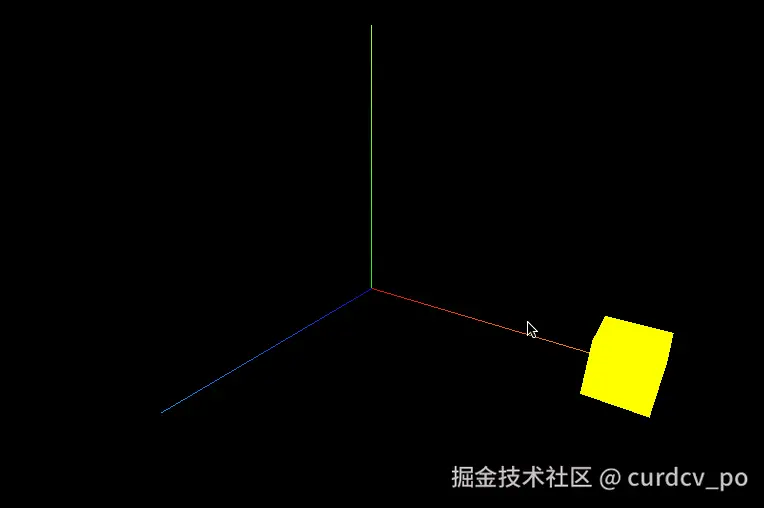

⭕️ 加坐标轴辅助器

// 添加坐标轴辅助器

const axesHelper = new THREE.AxesHelper(5); // 坐标轴(size轴的大小)

scene.add(axesHelper);

⭕️ 设置物体移动

// 设置相机位置

camera.position.set(0, 0, 10);

scene.add(camera);

cube.position.x = 3;

// 往返移动

function render() {

cube.position.x += 0.01;

if (cube.position.x > 5) {

cube.position.x = 0;

}

renderer.render(scene, camera);

// 渲染下一帧的时候就会调用render函数

requestAnimationFrame(render);

}

render();

⭕️ 缩放

cube.scale.set(3, 2, 1); // xyz, x3倍, y2倍

单独设置

cube.position.x = 3;

⭕️ 旋转

cube.rotation.set(Math.PI / 4, 0, 0, "XZY"); // x轴旋转45度

单独设置

cube.rotation.x = Math.PI / 4;

⭕️ requestAnimationFrame

function render(time) {

// console.log(time);

// cube.position.x += 0.01;

// cube.rotation.x += 0.01;

// time 是一个不断递增的数字,代表当前的时间

let t = (time / 1000) % 5; // 为什么求余数,物体移动的距离就是t,物体移动的距离是0-5,所以求余数

cube.position.x = t * 1; // 0-5秒,物体移动0-5距离

// if (cube.position.x > 5) {

// cube.position.x = 0;

// }

renderer.render(scene, camera);

// 渲染下一帧的时候就会调用render函数

requestAnimationFrame(render);

}

render();

⭕️ Clock 跟踪事件处理动画

// 设置时钟

const clock = new THREE.Clock();

function render() {

// 获取时钟运行的总时长

let time = clock.getElapsedTime();

console.log("时钟运行总时长:", time);

// let deltaTime = clock.getDelta();

// console.log("两次获取时间的间隔时间:", deltaTime);

let t = time % 5;

cube.position.x = t * 1;

renderer.render(scene, camera);

// 渲染下一帧的时候就会调用render函数

requestAnimationFrame(render);

}

render();

大概是8毫秒一次渲染时间.

⭕️ 不用算 用 Gsap动画库

// 导入动画库

import gsap from "gsap";

// 设置动画

var animate1 = gsap.to(cube.position, {

x: 5,

duration: 5,

ease: "power1.inOut", // 动画属性

// 设置重复的次数,无限次循环-1

repeat: -1,

// 往返运动

yoyo: true,

// delay,延迟2秒运动

delay: 2,

onComplete: () => {

console.log("动画完成");

},

onStart: () => {

console.log("动画开始");

},

});

gsap.to(cube.rotation, { x: 2 * Math.PI, duration: 5, ease: "power1.inOut" });

// 双击停止和恢复运动

window.addEventListener("dblclick", () => {

// console.log(animate1);

if (animate1.isActive()) {

// 暂停

animate1.pause();

} else {

// 恢复

animate1.resume();

}

});

function render() {

renderer.render(scene, camera);

// 渲染下一帧的时候就会调用render函数

requestAnimationFrame(render);

}

render();

⭕️ 根据尺寸变化 实现自适应

// 监听画面变化,更新渲染画面

window.addEventListener("resize", () => {

// console.log("画面变化了");

// 更新摄像头

camera.aspect = window.innerWidth / window.innerHeight;

// 更新摄像机的投影矩阵

camera.updateProjectionMatrix();

// 更新渲染器

renderer.setSize(window.innerWidth, window.innerHeight);

// 设置渲染器的像素比

renderer.setPixelRatio(window.devicePixelRatio);

});

⭕️ 用js控制画布 全屏 和 退出全屏

window.addEventListener("dblclick", () => {

const fullScreenElement = document.fullscreenElement;

if (!fullScreenElement) {

// 双击控制屏幕进入全屏,退出全屏

// 让画布对象全屏

renderer.domElement.requestFullscreen();

} else {

// 退出全屏,使用document对象

document.exitFullscreen();

}

// console.log(fullScreenElement);

});

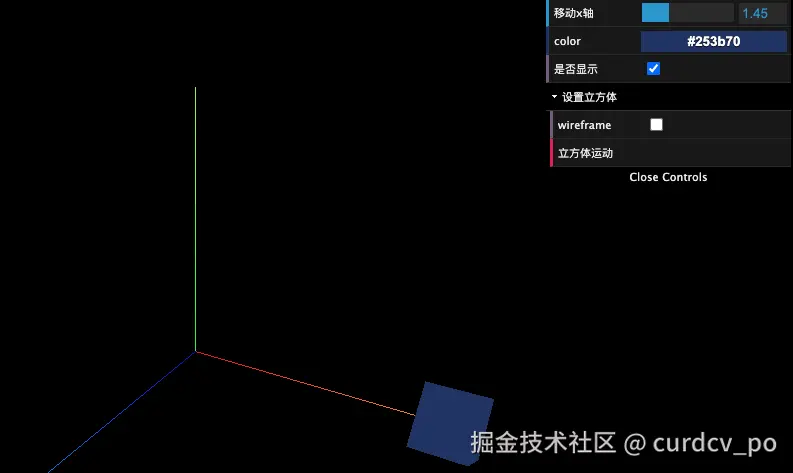

⭕️ 应用 图形 用户界面 更改变量

// 导入dat.gui

import * as dat from "dat.gui";

const gui = new dat.GUI();

gui

.add(cube.position, "x")

.min(0)

.max(5)

.step(0.01)

.name("移动x轴")

.onChange((value) => {

console.log("值被修改:", value);

})

.onFinishChange((value) => {

console.log("完全停下来:", value);

});

// 修改物体的颜色

const params = {

color: "#ffff00",

fn: () => {

// 让立方体运动起来

gsap.to(cube.position, { x: 5, duration: 2, yoyo: true, repeat: -1 });

},

};

gui.addColor(params, "color").onChange((value) => {

console.log("值被修改:", value);

cube.material.color.set(value);

});

// 设置选项框

gui.add(cube, "visible").name("是否显示");

var folder = gui.addFolder("设置立方体");

folder.add(cube.material, "wireframe");

// 设置按钮点击触发某个事件

folder.add(params, "fn").name("立方体运动");

🔴 结语

前端的世界,

不该只有Vue和React——

还有WebGPU里等待你征服的星辰大海。"

“当WebGL成为下一代前端的基础设施,愿你是最早站在三维坐标系里的那个人。”

来源:juejin.cn/post/7517209356855164978

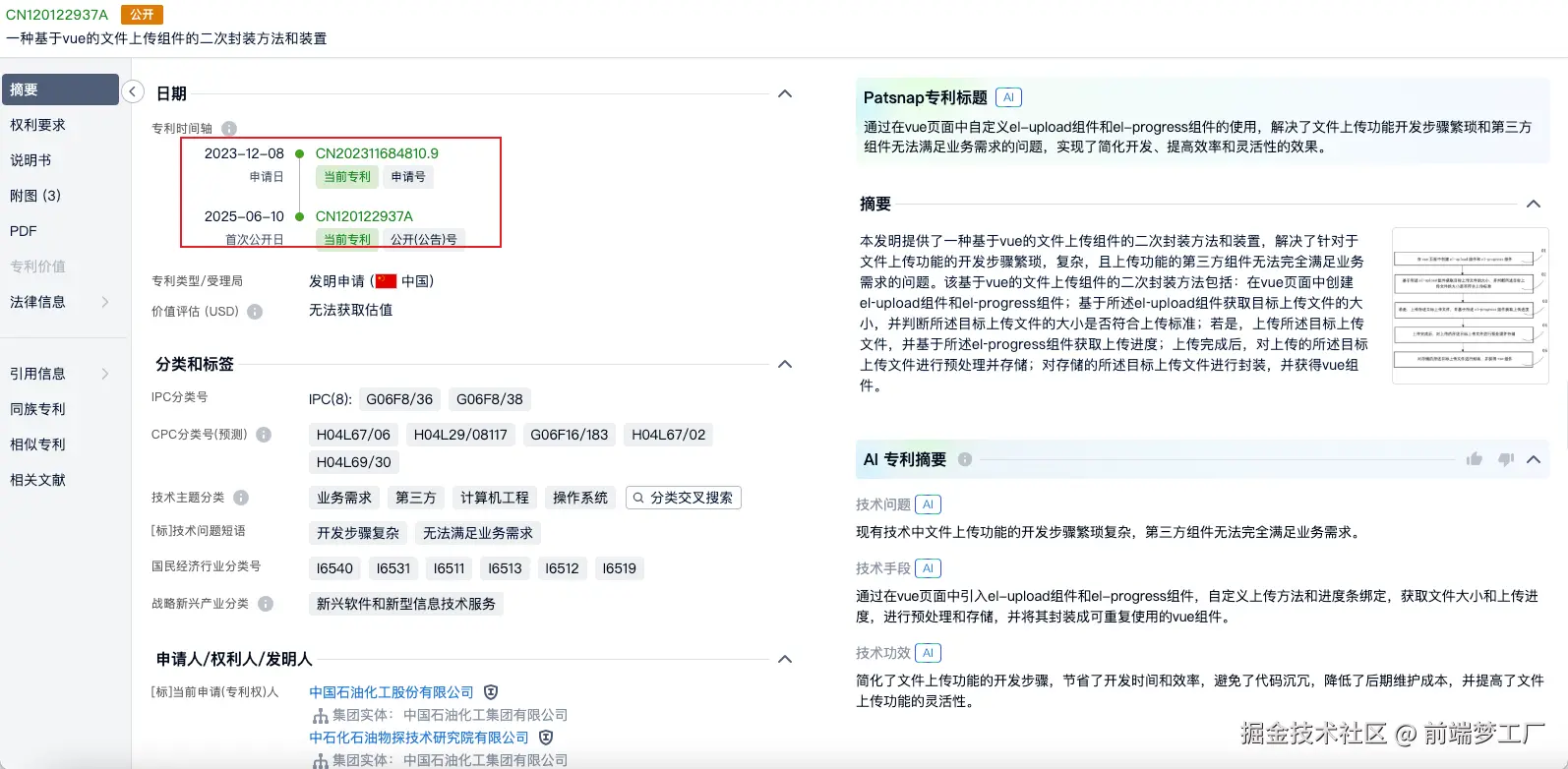

震惊,中石化将开源组件二次封装申请专利,这波操作你怎么看?

一. 前言

昨天看到了一篇关于 “中石化申请基于 vue 的文件上传组件二次封装方法和装置专利,解决文件上传功能开发繁琐问题” 的新闻。

今天特地在专利系统检索了一下,竟然是真的,令人不禁大跌眼镜!用的全是开源组件,最后还把它们变成了自己的专利!这波操作属实厉害啊!

难道以后要用这种方式上传文件,要交专利费了?哈哈....

说来好笑,有掘友指出有单词拼写错误,我又查看一下专利文件,竟然还真有拼写错误...

二. 了解一下

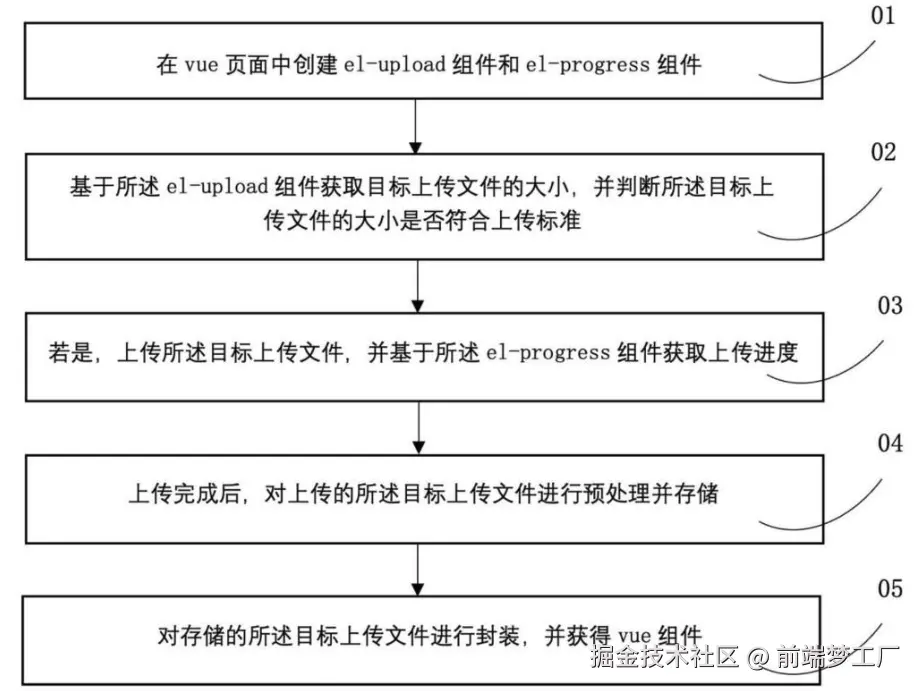

本专利是通过在 vue 页面中自定义 el-upload 组件和 el-progress 组件的使用,解决了文件上传功能开发步骤繁琐和第三方组件无法满足业务需求的问题,实现了简化开发、提高效率和灵活性的效果。

1. 摘要

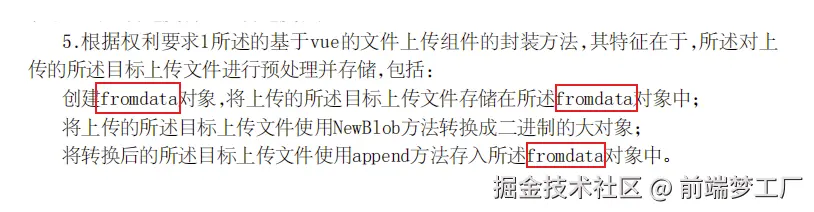

本发明提供了一种基于 vue 的文件上传组件的二次封装方法和装置,解决了针对于文件上传功能的开发步骤繁琐,复杂,且上传功能的第三方组件无法完全满足业务需求的问题。

该基于 vue 的文件上传组件的二次封装方法包括:在 vue 页面中创建 el‑upload 组件和 el‑progress 组件;

基于所述 el‑upload 组件获取目标上传文件的大小,并判断所述目标上传文件的大小是否符合上传标准;若是,上传所述目标上传文件,并基于所述 el‑progress 组件获取上传进度;上传完成后,对上传的所述目标上传文件进行预处理并存储;

对存储的所述目标上传文件进行封装,并获得 vue 组件。

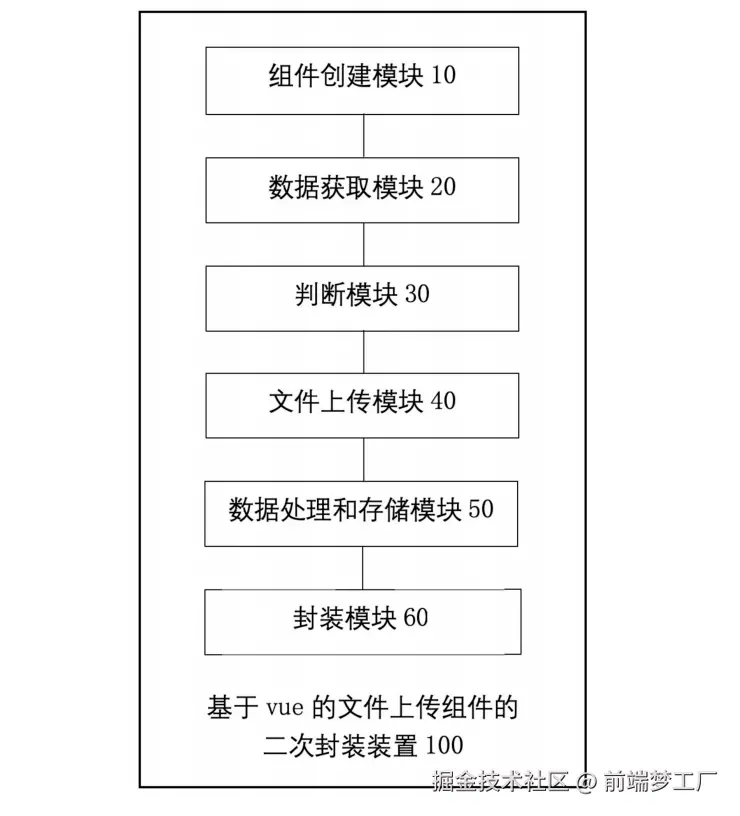

技术流程图:

二次封装装置模块:

2. 解决的技术问题

现有技术中文件上传功能的开发步骤繁琐复杂,第三方组件无法完全满足业务需求。

3. 采用的技术手段

通过在 vue 页面中引入 el-upload 组件和 el-progress 组件,自定义上传方法和进度条绑定,获取文件大小和上传进度,进行预处理和存储,并将其封装成可重复使用的 vue 组件。

4. 产生的技术功效

简化了文件上传功能的开发步骤,节省了开发时间和效率,避免了代码沉冗,降低了后期维护成本,并提高了文件上传功能的灵活性。

三. 实现一下

这种简单的上传文件+上传进度显示不是最基本的业务封装吗?相信这是每个前端开发工程师必备的基础技能。

1. el-upload + el-progress 组合

- el-upload 负责文件选择、上传。

- el-progress 负责展示上传进度。

2. 文件大小校验

- 使用 el-upload 的

before-upload钩子,判断文件大小是否符合标准。

3. 上传进度获取

- 使用 el-upload 的

on-progress钩子,实时更新进度条。

4. 上传完成后的预处理与存储

- 上传完成后,触发自定义钩子(如

beforeStore、onStore),进行预处理和存储。

5. 封装为 Vue 组件

- 通过 props、emits、插槽等方式,暴露灵活的接口,便于业务页面集成。

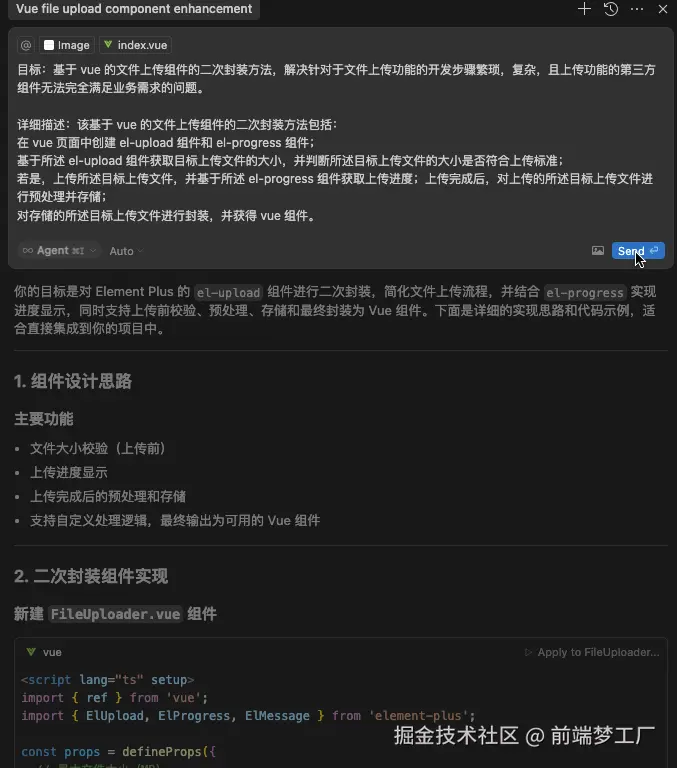

都懒得自己动手,让 Cursor 来实现一下。Cursor 还是一如既往的强大,基本上一次询问就能成功!我表示 Cursor 在手,天下我有!

UploaderWrapper 自定义组件:

<template>

<div class="file-uploader">

<ElUpload

:action="action"

:before-upload="beforeUpload"

:on-progress="handleProgress"

:on-success="handleSuccess"

:on-error="handleError"

:limit="limit"

:on-exceed="handleExceed"

:show-file-list="showFileList"

:multiple="multiple"

:accept="accept"

v-model:file-list="fileList"

:on-remove="handleRemove"

>

<template #trigger>

<ElButton type="primary"> 选择文件上传 ElButton>

template>

<template #tip>

<div class="el-upload__tip">

支持的文件类型: {{ accept }},单个文件不超过 {{ maxSize }}MB

div>

template>

ElUpload>

<ElProgress

v-if="isUploading"

:percentage="uploadPercent"

:status="uploadPercent === 100 ? 'success' : ''"

class="mt-4"

/>

div>

template>

<style scoped>

.file-uploader {

width: 100%;

}

.el-upload__tip {

font-size: 12px;

color: #606266;

margin-top: 8px;

}

style>

使用方式:

<template>

<ElCard class="mb-5 w-80">

<template #header> 文件上传演示 template>

<UploaderWrapper

action="/api/upload"

:max-size="5"

:before-store="beforeStore"

:on-store="onStore"

/>

ElCard>

template>

效果如下所示:

声明:“代码仅供演示,不要使用,以免有专利侵权风险,慎重!”

四. 思考一下

从开发者的角度来看,这个专利事件是否能给我们带来了一些值得思考影响和启示:

- 技术创新的边界问题

- 使用开源组件进行二次封装是否应该被授予专利?

- 是否对开源社区的发展可能产生负面影响?

- 对日常开发的影响

- 如果专利获得授权,其他公司使用类似的文件上传组件封装方案是否可能面临法律风险?

- 开发者是否需要寻找替代方案或支付专利费用?

- 对开源社区的影响

- 可能打击开发者对开源项目的贡献热情,自己辛苦开源项目为别人做了嫁衣?

- 是否会影响开源组件的使用和二次开发

- 可能导致更多公司效仿,将开源组件的二次封装申请专利,因为毕竟专利对公司的招投标挺大的

五. 后记

“中石化作为传统能源企业,都能积极拥抱前端技术,还将内部技术方案申请专利,体现了他们对知识产权的重视?”

那我们是不是要在技术创新和知识产权保护之间找到平衡点,既要保护创新,又不能阻碍技术的发展。

而作为开发者的我们呢?这么简单的封装都能申请专利成功的话,那么...,大家有什么想法,是不是现在强的可怕?哈哈...

专利来源于国家知识产权局

申请公布号:CN120122937A

来源:juejin.cn/post/7514858513442078754

润开鸿亮相HDC2025 以AI驱动基于开源鸿蒙的行业新“智”场景创新

2025年6月20日至22日,第七届华为开发者大会(HDC.2025)在东莞松山湖盛大举行。作为鸿蒙生态的核心伙伴和深度参与者、华为OpenHarmony使能伙伴、华为HarmonyOS开发服务商,江苏润开鸿数字科技有限公司(以下简称“润开鸿”)以专题演讲、成果展示、CodeLabs训练营等多元形式参会,充分展示了自身基于“OpenHarmony+AI” “OpenHarmony+星闪”的数智化解决方案及赋能服务等鸿蒙生态创新成果。

在本届HDC大会期间,HarmonyOS 6 Developer Beta面向开发者启动报名,其新特性将为千行百业的鸿蒙应用带来更多创新可能;同时,鸿蒙星光计划也正式推出,将投入总额1亿元的现金和资源,支持更多校园开发者和创意人才开发鸿蒙应用。

当前,更多“生而不同”的创新体验正在鸿蒙生态中不断涌现。作为领先的鸿蒙方向专业技术公司及终端操作系统发行版提供商,以及开放原子开源基金会OpenHarmony项目群A类捐赠人和核心共建单位,润开鸿于本届大会上重磅发布了基于OpenHarmony的智慧中医AI诊疗解决方案。该方案以基于OpenHarmony的智慧中医辅助诊疗机器人为核心,构建覆盖三甲医院至社区医院的一体化中医诊疗服务体系,通过“OpenHarmony+AI”驱动场景全要素融合,创新重塑中医诊疗“诊前→诊中→诊后”全流程服务体验,打破医疗资源分布不均现状,运用数智化技术让优质中医资源得以广泛共享,提升整体中医诊疗效率与专业能力一致性,为患者提供便捷、高效的中医医疗个性化定制服务。在大会互动体验区开源鸿蒙成果展区现场,润开鸿展示了基于OpenHarmony的智慧中医AI诊疗解决方案核心设备——智慧中医AI诊疗机器人,并通过其与HarmonyOS平板的互联协作,直观呈现了以“OpenHarmony+AI”驱动新“智”场景创新的典型范例。

润开鸿基于OpenHarmony的智慧中医AI诊疗解决方案重磅发布

润开鸿基于OpenHarmony的智慧中医AI诊疗机器人现场体验

同时,润开鸿面向青少年信息科技教育全新打造的星闪场景DEMO——基于源师兄的“使命召唤”无人设备指挥控制方案也于大会互动体验区首发亮相。该方案作为基于“OpenHarmony+星闪”的信息科技教学场景,通过润开鸿OH-CODE图形化编程平台接入控制多形态、多类型智能终端,应用星闪(NearLink)互联实现基于“源师兄”的跨场景一体化协同,凸显了 “OpenHarmony+星闪”创新构建智能物联场景的技术潜力。

润开鸿基于源师兄的“使命召唤”无人设备指挥控制方案首发亮相

互动展区亮点展品

润开鸿矿鸿物联管理平台

润开鸿基于OpenHarmony的姿态机器人

润和软件星闪科技纸笔互动解决方案

值得关注的是,本届大会还为与会开发者设计了丰富的专题论坛及技术公开课等活动议程,在“【鸿蒙生态产业场景创新方案】生态共建,赋能产业数字化变革”专题论坛上,润开鸿副总裁于大伍在以“OpenHarmony+AI:探索行业新智硬件无限可能”为题的主题演讲中表示,OpenHarmony作为契合AI时代的绝佳数字底座,天然具备高能效、强智能、自协同三大优势,弥补了传统操作系统“重”“笨”“杂”的问题。同时,随着AI应用的深入,AI大模型已经从云端逐步走向“云”“边”“端”协同进化,润开鸿基于多年在OpenHarmony领域积累的经验以及在AI行业大模型的实践,打造了鸿锐AI云桌面、鸿锐AI box、鸿锐AI平板以及AI PC等基于“OpenHarmony+AI”的多款产品,并形成了面向金融、电力、医疗、办公、智慧城市等多场景的“云”“边”“端”协同全栈AI交付方案。

润开鸿副总裁于大伍做主题演讲

在“【星闪】打造全场景新体验,星闪开放能力繁荣鸿蒙生态”专题论坛上,江苏润和软件股份有限公司副总裁刘洋以“润和软件聚力生态协同,构建可持续开发者支持体系”为题做主题演讲。他表示,润和软件以“OpenHarmony+星闪”生态为基石,构建“可学、可用、可商用”的开发者支持体系,切实降低行业智能化转型门槛。聚焦工业、能源、教育等场景打造行业落地案例,加速场景化创新与人才储备。未来,将持续聚力生态协同,驱动技术深度赋能千行百业,为产业数字化升级注入可持续创新动能。

润和软件副总裁刘洋做主题演讲

在“【人才赋能】携手共育共拓HarmonyOS创新人才”专题论坛上,润开鸿生态技术专家徐建国以“领航HarmonyOS技术布道,使能开发者持续创新”为题,分享了自身从社区开发者一步步成长为鸿蒙应用技术专家,并作为华为HDE反哺社区,助力更多开发者突破技术难点、共拓鸿蒙生态及应用落地的成长与贡献历程。

润开鸿生态技术专家徐建国做主题演讲

同时,在本届大会同期举办的开发者技术挑战及互动活动中,润开鸿为开发挑战赛带来了鸿蒙设备上云实战赛项——“基于润开鸿DAYU800A实现智能家居多端联动与云端智能响应方案开发”。该项目要求开发者通过集成IoT Device SDK,结合DeepSeek、人脸识别等功能,快速实现鸿蒙设备联网上云及云端响应,重点检验开发者结合场景实际,实现“云、边、端”交互体验的智能家居新“智”场景综合开发能力。

“基于润开鸿DAYU800A实现智能家居多端联动与云端智能响应方案开发”挑战赛现场

伴随HarmonyOS6 Developer Beta启动报名,将支持更多鸿蒙开发者、各领域生态伙伴不断推出更丰富、更具创意的新功能、新体验,让用户在出行、娱乐、办公、购物等场景下的体验全面焕新。润开鸿充分认同鸿蒙生态“持续开放、协同共建”的发展理念,将持续聚焦国产自主数字底座与AI等前沿技术的场景融合与赋能,以开源鸿蒙行业发行版驱动和牵引行业硬件与终端设备的创新,为行业创造新“智”生产工具。

收起阅读 »31 岁,写了 8 年代码的我,终于懂了啥叫成功

31 岁,写了 8 年代码的我,终于懂了啥叫成功

现在每天下午六点,我准时关了 IDEA,开车穿过 4 公里的晚高峰,20 分钟就到小区。

一、去年那个手忙脚乱的夏天,我差点错过儿子的成长

去年 5 月 23 号,老婆生了,是个儿子,我在产房陪产,当时是又激动,又紧张。初为人父的兴奋劲还没过,一周的陪产假结束就被加班打回原形。在原来的公司,我每天像个陀螺似的转,写接口、改 bug、开不完的会,常常凌晨才回家。儿子六个月大的时候,有天我凌晨一点推门进去,看见他趴在婴儿床上,小屁股撅得老高,枕边还放着我落在家里的工牌 —— 他把工牌上的照片啃得皱巴巴的,估计是想闻闻爸爸的味道。

那时候我才惊觉,儿子第一次会翻身、第一次长出小牙、第一次喊 "妈妈",这些重要的时刻我全错过了。有次老妈发视频给我,说儿子扶着婴儿床站起来了,摇摇晃晃像个小企鹅,我却在会议室跟产品经理掰扯接口设计,只能匆匆说一句 "知道了",挂了视频心里堵得慌。

二、当 "加班换高薪" 不如 "陪娃玩半小时",我果断选择了后者

有天晚上,我看着怀里这个小生命,突然觉得自己像个失败的程序员:写了八年代码,能优化千万级流量的接口,却连儿子的成长日志都没空更新。

咬咬牙辞了高薪 996,找了家朝九晚五的公司,月薪少了 25%,但胜在能准时下班。每天开车回家的路上,车载广播放着儿歌,我跟着瞎唱,儿子坐在安全座椅上咯咯笑,口水顺着下巴流到围兜上 —— 这 20 分钟的车程,比以前凌晨三点在高速上开代驾幸福一万倍。

三、现在的 "躺平" 生活,比任何技术方案都更让我有成就感

每天吃完晚饭,我雷打不动带儿子去小区遛弯。他刚学会走路,小区里儿子是我见过走的最早的那个,十一个月就开始走了,摇摇晃晃像个小醉汉,那一刻我觉得,以前追求的那些高薪、职级,在这双小手面前,根本不值一提。

周末带他去公园,他坐在草地上玩树叶,我陪他一起捡形状好看的,夹在笔记本里做标本。老妈总说我 "以前写代码的脑子,现在全用来研究怎么让娃多吃两口饭",可我觉得这才是正经事:以前写的代码可能过两年就被重构了,但儿子现在喊的每一声 "爸爸",都是永远存放在我心里的温暖记忆。

四、给新人讲技术时,我现在总提 "家庭并发量"

现在带新人,他们总问我 "怎么才能快速升职加薪",我会指着电脑桌面上儿子的照片说:"先学会给生活做负载均衡。" 以前我总觉得 "躺平" 是贬义词,现在才明白,拒绝无效加班,把时间留给家人,不是躺平,是给人生做了一次关键优化。

有次朋友问我:"你现在不焦虑吗?工资少了这么多。以前挣得多却总焦虑,怕被裁员、怕技术落后;现在挣得少却踏实,因为我没错过儿子的每一个第一次。你说,是银彳亍卡里的数字重要,还是孩子看见你时眼里的光重要?"

结语:31 岁,我的 "成功" 代码里只有一行注释

现在我的键盘上,贴着儿子百日照,每次敲代码时看见,心里都软乎乎的。写了八年 Java,终于懂了:成功不是简历上的项目经验,是能记住儿子每天的小变化;不是会议室里的技术汇报,是陪他在小区里看星星的夜晚;不是职级表上的晋升,是他跌跌撞撞跑向我时,张开的那双小胳膊。

31 岁这年,我把人生代码重构了一次。新版本没有复杂的架构,没有华丽的优化,只有一行简单的注释:家人的笑容,才是这辈子最稳定的依赖。 至于工资少了?没关系,儿子的笑声,比任何高薪都更值钱。

现在摸鱼时,我总会一遍遍翻看他从一岁到现在的照片和视频,或许我算不上技术精湛的程序员,但在工作间隙反复回味这些影像时,我愈发坚定:我一定要成为小时候自己渴望拥有的那种父亲。当然我的父亲也很优秀,买房买车都有赞助,只是他们那一代永远有个好心也不会有个好颜色,懂得都懂,哈哈。

来源:juejin.cn/post/7511903601452630025

从前端的角度出发,目前最具性价比的全栈路线是啥❓❓❓

我正在筹备一套前端工程化体系的实战课程。如果你在学习前端的过程中感到方向模糊、技术杂乱无章,那么前端工程化将是你实现系统进阶的最佳路径。它不仅能帮你建立起对现代前端开发的整体认知,还能提升你在项目开发、协作规范、性能优化等方面的工程能力。

✅ 本课程覆盖构建工具、测试体系、脚手架、CI/CD、Docker、Nginx 等核心模块,内容体系完整,贯穿从开发到上线的全流程。每一章节都配有贴近真实场景的企业级实战案例,帮助你边学边用,真正掌握现代团队所需的工程化能力,实现从 CRUD 开发者到工程型前端的跃迁。

详情请看前端工程化实战课程

学完本课程,对你的简历和具体的工作能力都会有非常大的提升。如果你对此项目感兴趣,或者课程感兴趣,可以私聊我微信 yunmz777

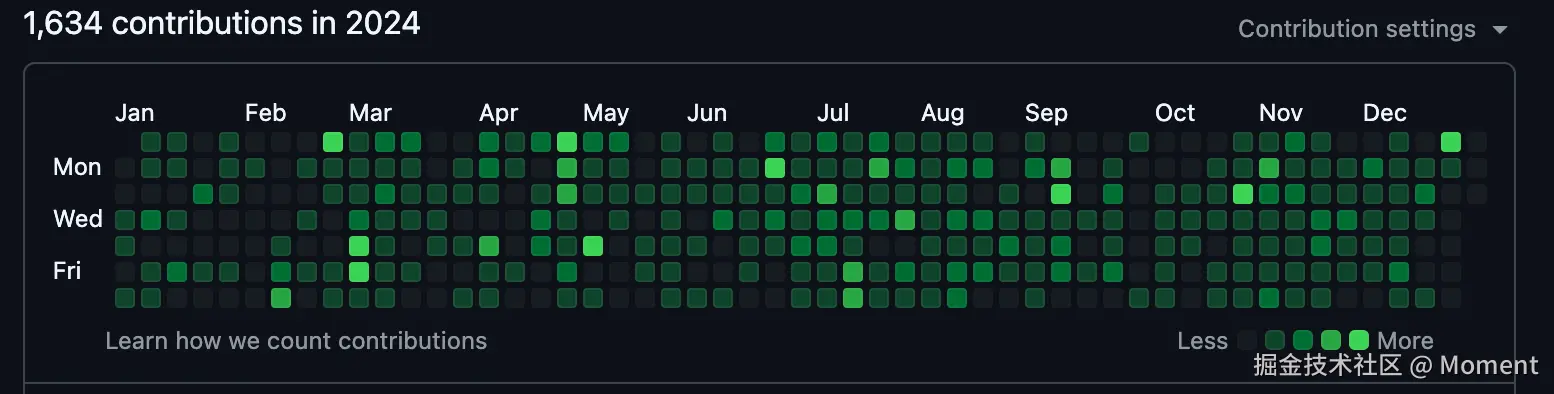

今年大部分时间都是在编码上和写文章上,但是也不知道自己都学到了啥,那就写篇文章来盘点一下目前的技术栈吧,也作为下一年的参考目标,方便知道每一年都学了些啥。

我的技术栈

首先我先来对整体的技术做一个简单的介绍吧,然后后面再对当前的一些技术进行细分吧。

React、Typescript、React Native、mysql、prisma、NestJs、Redis、前端工程化。

React

React 这个框架我花的时间应该是比较多的了,在校期间已经读了一遍源码了,对这些原理已经基本了解了。在随着技术的继续深入,今年毕业后又重新开始阅读了一遍源码,对之前的认知有了更深一步的了解。

也写了比较多跟 React 相关的文章,包括设计模式,原理,配套生态的使用等等都有一些涉及。

在状态管理方面,redux,zustand 我都用过,尤其在 Zustand 的使用上,我特别喜欢 Zustand,它使得我能够快速实现全局状态管理,同时避免了传统 Redux 中繁琐的样板代码,且性能更优。也对 Zustand 有比较深入的了解,也对其源码有过研究。

NextJs

Next.js 是一个基于 React 的现代 Web 开发框架,它为开发者提供了一系列强大的功能和工具,旨在优化应用的性能、提高开发效率,并简化部署流程。Next.js 支持多种渲染模式,包括服务器端渲染(SSR)、静态生成(SSG)和增量静态生成(ISR),使得开发者可以根据不同的需求选择合适的渲染方式,从而在提升页面加载速度的同时优化 SEO。

在路由管理方面,Next.js 采用了基于文件系统的路由机制,这意味着开发者只需通过创建文件和文件夹来自动生成页面路由,无需手动配置。这种约定优于配置的方式让路由管理变得直观且高效。此外,Next.js 提供了动态路由支持,使得开发者可以轻松实现复杂的 URL 结构和参数化路径。

Next.js 还内置了 API 路由,允许开发者在同一个项目中编写后端 API,而无需独立配置服务器。通过这种方式,前后端开发可以在同一个代码库中协作,大大简化了全栈开发流程。同时,Next.js 对 TypeScript 提供了原生支持,帮助开发者提高代码的可维护性和可靠性。

Typescript

今年所有的项目都是在用 ts 写了,真的要频繁修改的项目就知道用 ts 好处了,有时候用 js 写的函数修改了都不知道怎么回事,而用了 ts 之后,哪里引用到的都报红了,修改真的非常方便。

今年花了一点时间深入学习了一下 Ts 类型,对一些高级类型以及其实现原理也基本知道了,明年还是多花点时间在类型体操上,除了算法之外,感觉类型体操也可以算得上是前端程序员的内功心法了。

React Native

不得不说,React Native 不愧是接活神器啊,刚学完之后就来了个安卓和 ios 的私活,虽然没有谈成。

React Native 和 Expo 是构建跨平台移动应用的两大热门工具,它们都基于 React,但在功能、开发体验和配置方式上存在一些差异。React Native 是一个开放源代码的框架,允许开发者使用 JavaScript 和 React 来构建 iOS 和 Android 原生应用。Expo 则是一个构建在 React Native 之上的开发平台,它提供了一套工具和服务,旨在简化 React Native 开发过程。

React Native 的核心优势在于其高效的跨平台开发能力。通过使用 React 语法和组件,开发者能够一次编写应用的 UI 和逻辑,然后部署到 iOS 和 Android 平台。React Native 提供了对原生模块的访问,使开发者能够使用原生 API 来扩展应用的功能,确保性能和用户体验能够接近原生应用。

Expo 在此基础上进一步简化了开发流程。作为一个开发工具,Expo 提供了许多内置的 API 和组件,使得开发者无需在项目中进行繁琐的原生模块配置,就能够快速实现设备的硬件访问功能(如摄像头、位置、推送通知等)。Expo 还内置了一个开发客户端,使得开发者可以实时预览应用,无需每次都进行完整的构建和部署。

另外,Expo 提供了一个完全托管的构建服务,开发者只需将应用推送到 Expo 服务器,Expo 就会自动处理 iOS 和 Android 应用的构建和发布。这大大简化了应用的构建和发布流程,尤其适合不想处理复杂原生配置的开发者。

然而,React Native 和 Expo 也有各自的局限性。React Native 提供更大的灵活性和自由度,开发者可以更自由地集成原生代码或使用第三方原生库,但这也意味着需要更多的配置和维护。Expo 则封装了很多功能,简化了开发,但在需要使用某些特定原生功能时,开发者可能需要“弹出”Expo 的托管环境,进行额外的原生开发。

样式方案的话我使用的是 twrnc,大部分组件都是手撸,因为有 cursor 和 chatgpt 的加持,开发效果还是杠杠的。

rn 原理也争取明年能多花点时间去研究研究,不然对着盲盒开发还是不好玩。

Nestjs

NestJs 的话没啥好说的,之前也都写过很多篇文章了,感兴趣的可以直接观看:

对 Nodejs 的底层也有了比较深的理解了:

Prisma & mysql

Prisma 是一个现代化的 ORM(对象关系映射)工具,旨在简化数据库操作并提高开发效率。它支持 MySQL 等关系型数据库,并为 Node.js 提供了类型安全的数据库客户端。在 NestJS 中使用 Prisma,可以让开发者轻松定义数据库模型,并通过自动生成的 Prisma Client 执行类型安全的查询操作。与 MySQL 配合时,Prisma 提供了一种简单、直观的方式来操作数据库,而无需手动编写复杂的 SQL 查询。

Prisma 的核心优势在于其强大的类型安全功能,所有的数据库操作都能通过 Prisma Client 提供的自动生成的类型来进行,这大大减少了代码中的错误,提升了开发的效率。它还包含数据库迁移工具 Prisma Migrate,能够帮助开发者方便地管理数据库结构的变化。此外,Prisma Client 的查询 API 具有很好的性能,能够高效地执行复杂的数据库查询,支持包括关系查询、聚合查询等高级功能。

与传统的 ORM 相比,Prisma 使得数据库交互更加简洁且高效,减少了配置和手动操作的复杂性,特别适合在 NestJS 项目中使用,能够与 NestJS 提供的依赖注入和模块化架构很好地结合,提升整体开发体验。

Redis

Redis 和 mysql 都仅仅是会用的阶段,目前都是直接在 NestJs 项目中使用,都是已经封装好了的,直接传参调用就好了:

import { Injectable, Inject, OnModuleDestroy, Logger } from "@nestjs/common";

import Redis, { ClientContext, Result } from "ioredis";

import { ObjectType } from "../types";

import { isObject } from "@/utils";

@Injectable()

export class RedisService implements OnModuleDestroy {

private readonly logger = new Logger(RedisService.name);

constructor(@Inject("REDIS_CLIENT") private readonly redisClient: Redis) {}

onModuleDestroy(): void {

this.redisClient.disconnect();

}

/**

* @Description: 设置值到redis中

* @param {string} key

* @param {any} value

* @return {*}

*/

public async set(

key: string,

value: unknown,

second?: number

): Promise<Result<"OK", ClientContext> | null> {

try {

const formattedValue = isObject(value)

? JSON.stringify(value)

: String(value);

if (!second) {

return await this.redisClient.set(key, formattedValue);

} else {

return await this.redisClient.set(key, formattedValue, "EX", second);

}

} catch (error) {

this.logger.error(`Error setting key ${key} in Redis`, error);

return null;

}

}

/**

* @Description: 获取redis缓存中的值

* @param key {String}

*/

public async get(key: string): Promise<string | null> {

try {

const data = await this.redisClient.get(key);

return data ? data : null;

} catch (error) {

this.logger.error(`Error getting key ${key} from Redis`, error);

return null;

}

}

/**

* @Description: 设置自动 +1

* @param {string} key

* @return {*}

*/

public async incr(

key: string

): Promise<Result<number, ClientContext> | null> {

try {

return await this.redisClient.incr(key);

} catch (error) {

this.logger.error(`Error incrementing key ${key} in Redis`, error);

return null;

}

}

/**

* @Description: 删除redis缓存数据

* @param {string} key

* @return {*}

*/

public async del(key: string): Promise<Result<number, ClientContext> | null> {

try {

return await this.redisClient.del(key);

} catch (error) {

this.logger.error(`Error deleting key ${key} from Redis`, error);

return null;

}

}

/**

* @Description: 设置hash结构

* @param {string} key

* @param {ObjectType} field

* @return {*}

*/

public async hset(

key: string,

field: ObjectType

): Promise<Result<number, ClientContext> | null> {

try {

return await this.redisClient.hset(key, field);

} catch (error) {

this.logger.error(`Error setting hash for key ${key} in Redis`, error);

return null;

}

}

/**

* @Description: 获取单个hash值

* @param {string} key

* @param {string} field

* @return {*}

*/

public async hget(key: string, field: string): Promise<string | null> {

try {

return await this.redisClient.hget(key, field);

} catch (error) {

this.logger.error(

`Error getting hash field ${field} from key ${key} in Redis`,

error

);

return null;

}

}

/**

* @Description: 获取所有hash值

* @param {string} key

* @return {*}

*/

public async hgetall(key: string): Promise<Record<string, string> | null> {

try {

return await this.redisClient.hgetall(key);

} catch (error) {

this.logger.error(

`Error getting all hash fields from key ${key} in Redis`,

error

);

return null;

}

}

/**

* @Description: 清空redis缓存

* @return {*}

*/

public async flushall(): Promise<Result<"OK", ClientContext> | null> {

try {

return await this.redisClient.flushall();

} catch (error) {

this.logger.error("Error flushing all Redis data", error);

return null;

}

}

/**

* @Description: 保存离线通知

* @param {string} userId

* @param {any} notification

*/

public async saveOfflineNotification(

userId: string,

notification: any

): Promise<void> {

try {

await this.redisClient.lpush(

`offline_notifications:${userId}`,

JSON.stringify(notification)

);

} catch (error) {

this.logger.error(

`Error saving offline notification for user ${userId}`,

error

);

}

}

/**

* @Description: 获取离线通知

* @param {string} userId

* @return {*}

*/

public async getOfflineNotifications(userId: string): Promise<any[]> {

try {

const notifications = await this.redisClient.lrange(

`offline_notifications:${userId}`,

0,

-1

);

await this.redisClient.del(`offline_notifications:${userId}`);

return notifications.map((notification) => JSON.parse(notification));

} catch (error) {

this.logger.error(

`Error getting offline notifications for user ${userId}`,

error

);

return [];

}

}

/**

* 获取指定 key 的剩余生存时间

* @param key Redis key

* @returns 剩余生存时间(秒)

*/

public async getTTL(key: string): Promise<number> {

return await this.redisClient.ttl(key);

}

}

前端工程化

前端工程化这块花了很多信息在 eslint、prettier、husky、commitlint、github action 上,现在很多项目都是直接复制之前写好的过来就直接用。

后续应该是投入更多的时间在性能优化、埋点、自动化部署上了,如果有机会的也去研究一下 k8s 了。

全栈性价比最高的一套技术

最近刷到一个帖子,讲到了

我目前也算是一个小全栈了吧,我也来分享一下我的技术吧:

- NextJs

- React Native

- prisma

- NestJs

- taro (目前还不会,如果有需求就会去学)

剩下的描述也是和他下面那句话一样了(毕业后对技术态度的转变就是什么能让我投入最小,让我最快赚到钱的就是好技术)

总结

学无止境,任重道远。

最后再来提一下这两个开源项目,它们都是我们目前正在维护的开源项目:

如果你想参与进来开发或者想进群学习,可以添加我微信 yunmz777,后面还会有很多需求,等这个项目完成之后还会有很多新的并且很有趣的开源项目等着你。

来源:juejin.cn/post/7451483063568154639

同志们,我去外包了

同志们,我去外包了

同志们,经历了漫长的思想斗争,我决定回老家发展,然后就是简历石沉大海,还好外包拯救了我,我去外包了!

都是自己人,说这些伤心话干嘛;下面说下最近面试的总结地方,小小弱鸡,图一乐吧。

首先随着工作年限的增加,越来越多公司并不会去和你抠八股文了(那阵八股风好像停了),只是象征性的问几个问题,然后会对照着项目去问些实际的问题以及你的处理办法。

(ps:(坐标合肥)突然想到某鑫面试官问我你知道亿级流量吗?你怎么处理的,听到这个问题我就想呼过去,也许读书读傻了,他根本不知道亿级流量是个什么概念,最主要的是它是个制造业公司啊,你哪来的亿级流量啊,也不知道问这个问题时他在想啥,还有某德(不是高德),一场能面一个小时,人裂开)。

好了,言归正传,咱说点入职这家公司我了解到的一点东西,我分为两部分:代码和sql;

代码上

首先传统的web项目也会分前端后端,这点不错;

1.获取昨天日期

可以使用jdk自带的LocalDate.now().minusDays(-1)

这个其实内部调用的是plusDays(-1)方法,所以不如直接就用plusDays方法,这样少一层判断;

PS:有多少人和我之前一样直接new Date()的。

2.字符填充

apache.common下的StringUtils的rightPad方法用于字符串填充使用方法是StringUtils.rightPad(str,len,fillStr)

大概意思就是str长度如果小于len,就用fillStr填充;

PS:有多少人之前是String.format或者StringBuilder用循环实现的。

3.获取指定年指定月的某天

获取指定年指定月的某天可以用localDate.of(year,month,day),如果我们想取2025年的五月一号,可以写成LocalDate.of(2025, 5, 1),那有人可能就想到了如果月尾呢,LocalDate.of(2025, 5, 31)也是可以的,但是我们需要清楚知道这个月有多少天,比如说你2月给个30天,那就会抛异常;

麻烦;

更好的办法就是先获取第一天,然后调用localDate.with(TemporalAdjusters.lastDayOfMonth());方法获取最后一天,TemporalAdjusters.lastDayOfMonth()会自动处理不同月份和闰年的情况;

sql层面的

有言在先,说实话我不建议在sql层面写这种复杂的东西,毕竟我们这么弱的人看到那么长的且复杂的sql会很无力,那种无力感你懂吗?打工人不为难打工人;不过既然别人写了,咱们就学习一下嘛;

1.获取系统日期

首先获取系统日期可以试用TRUNC(SYSDATE)进行截取,这样返回的时分秒是00:00:00,比如2025-05-29 00:00:00,它也可以截取数字,想知道就去自行科普下,不建议掌握,学习了下,有点搞;

2.返回date当前月份的最后一天

LAST_DAY(date)这个返回的是date当前月份的最后一天,比如今天是2025-05-29,那么返回的是2025-05-31

ADD_MONTH(date,11)表示当前日期加上11个月,比如2025-01-02,最终返回的是2025-12-02;

3.左连接的知识点

最后再提个左连接的知识点,最近看懵了,图一乐哈,A left join B,就是on的条件是在join生成临时表时起作用的,而where是对生成的临时表进行过滤;

两者过滤的时机不一样。我想了很久我觉得可以这么理解,on它虽然可以添加条件,但他的条件只是一个匹配条件比如B.age>10;它是不会对A表查询出来的数据量产生一个过滤效果;

而where是一个实打实的过滤条件,不管怎么说都会影响最终结果,对于inner join这个特例,on和where的最终效果一样,因为B.age>10会导致B的匹配数据减少,由于是交集,故会对整体数据产生影响。

好了,晚安,外包打工仔。。。

来源:juejin.cn/post/7510055871465308212

京东购物车动效实现:贝塞尔曲线的妙用

前言

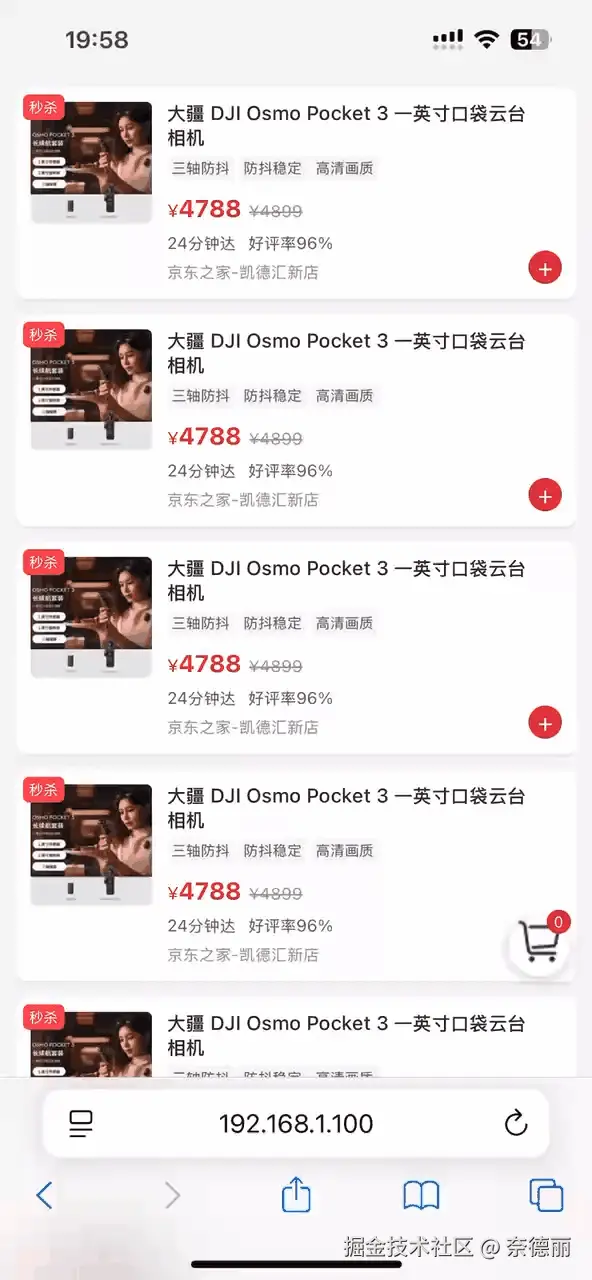

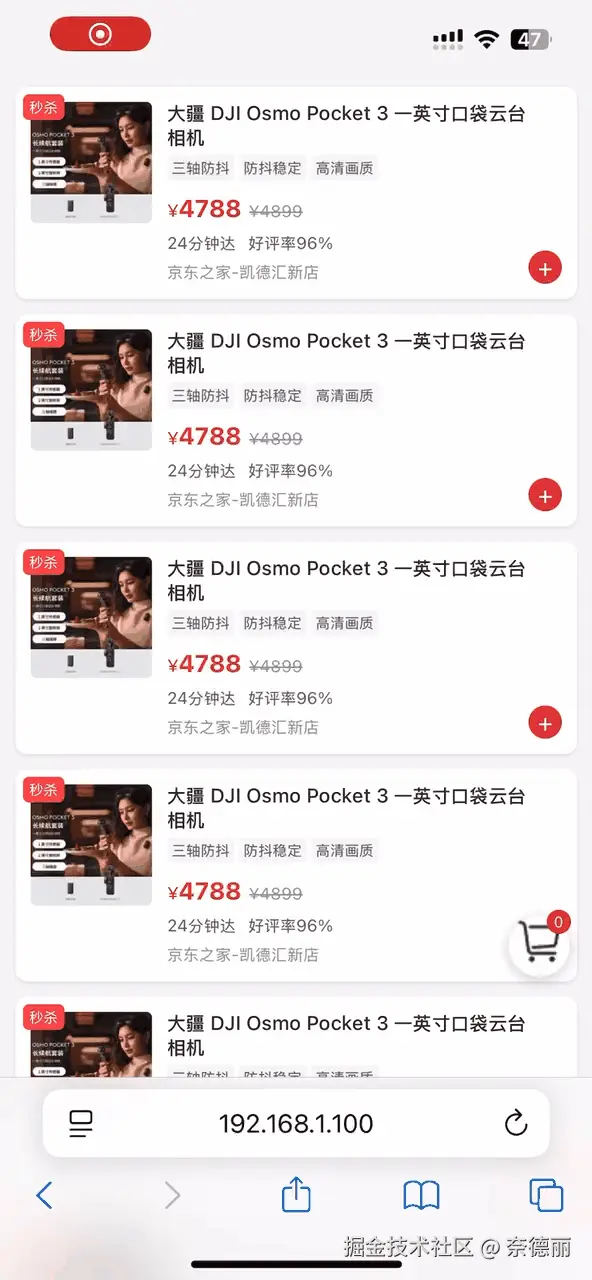

大家好,我是奈德丽。前两天在逛京东想买Pocket 3的时候,注意到了它的购物车动效,当点击"加入购物车"按钮时,一个小红球从商品飞入购物车,我觉得很有意思,于是花了点时间来研究。

实现效果

看了图才知道我在讲什么,那么先看Gif吧!

代码演示

代码已经上传到了码上掘金,感兴趣的可以自行查看,文章中没有贴全部代码了,主要讲讲思路,

code.juejin.cn/pen/7503150…

实现思路

下面这个思路,小白也能会,我们将通过以下几个步骤来实现这个效果:

画页面——>写逻辑实现动画效果

好了,废话不多说,开始进入正题

第一步:先让AI帮我们写出来UI结构

像我们这种工作1坤年以上的切图仔,能偷懒当然偷懒啦,这种画页面的活可以丢给AI来干了,下面是Taro帮我生成的页面部分,没什么难点,就是一些普普通通的页面元素。

<template>

<div class="rolling-ball-container">

<!-- 商品列表 -->

<div class="item-list">

<div class="item" v-for="item in 10" :key="item">

<div class="product-card">

<div class="product-tag">秒杀</div>

<div class="product-image">

<img src="/product.jpg" alt="商品图片" />

</div>

<div class="product-info">

<div class="product-title">大疆 DJI Osmo Pocket 3 一英寸口袋云台相机</div>

<div class="product-features">

<span class="feature-tag">三轴防抖</span>

<span class="feature-tag">防抖稳定</span>

<span class="feature-tag">高清画质</span>

</div>

<div class="product-price">

<span class="price-symbol">¥</span>

<span class="price-value">4788</span>

<span class="price-original">¥4899</span>

</div>

<div class="product-meta">

<span class="delivery-time">24分钟达</span>

<span class="rating">好评率96%</span>

</div>

<div class="product-shop">京东之家-凯德汇新店</div>

</div>

<div class="add-to-cart" @click="startRolling($event)">+</div>

</div>

</div>

</div>

<!-- 购物车图标 -->

<div class="point end-point">

<div style="position: relative;">

<img src="/cart.png" />

<div class="cart-count">{{ totalCount }}</div>

</div>

</div>

<!-- 小球容器 -->

<div

v-for="(ball, index) in balls"

:key="index"

class="ball"

v-show="ball.show"

:style="getBallStyle(ball)"

></div>

</div>

</template>

第二步:设计小球数据模型

有了页面元素了,我们需要创建小球数组和计数器

import { reactive, ref } from 'vue';

// 购物车商品计数

const totalCount = ref(0);

// 创建小球数组(预先创建3个小球以应对连续点击)

const balls = reactive(Array(3).fill(0).map(() => ({

show: false, // 是否显示

startX: 0, // 起点X坐标

startY: 0, // 起点Y坐标

endX: 0, // 终点X坐标

endY: 0, // 终点Y坐标

pathX: 0, // 路径X偏移量

pathY: 0, // 路径Y偏移量

progress: 0 // 动画进度

})));

为什么小球要用一个数组来存储呢?因为我看到京东上用户是可以连续点击+号将商品加入购入车的,页面上可以同时存在很多个飞行的小球。

第三步:实现动画触发函数

当用户点击"+"按钮时,我们需要计算起点和终点坐标,然后启动动画,这儿有一个细节,为了让小球刚好落到在购物车中间,对终点坐标进行了微调。

// 开始滚动动画

const startRolling = (event: MouseEvent) => {

// 获取起点和终点元素

const startPoint = event.currentTarget as HTMLElement;

const endPoint = document.querySelector('.end-point') as HTMLElement;

if (startPoint && endPoint) {

// 找到一个可用的小球

const ball = balls.find(ball => !ball.show);

if (ball) {

// 获取起点位置

const startRect = startPoint.getBoundingClientRect();

ball.startX = startRect.left + startRect.width / 2;

ball.startY = startRect.top + startRect.height / 2;

// 获取终点位置

const endRect = endPoint.getBoundingClientRect();

const endX = endRect.left + endRect.width / 2;

const endY = endRect.top + endRect.height / 2;

// 微调终点位置

ball.endX = endX - 4;

ball.endY = endY - 7;

// 设置路径偏移量

ball.pathX = 0;

ball.pathY = 100;

// 显示小球并重置进度

ball.show = true;

ball.progress = 0;

// 使用requestAnimationFrame实现动画

let startTime = Date.now();

const duration = 400; // 动画持续时间(毫秒)

function animate() {

const currentTime = Date.now();

const elapsed = currentTime - startTime;

ball.progress = Math.min(elapsed / duration, 1);

if (ball.progress < 1) {

requestAnimationFrame(animate);

} else {

// 动画结束后隐藏小球

setTimeout(() => {

ball.show = false;

}, 100);

}

}

requestAnimationFrame(animate);

// 增加购物车商品数量

totalCount.value++;

}

}

};

第四步:使用贝塞尔曲线计算小球轨迹

点击"+"按钮,不能让小球做自由落体运动吧,那是伽利略研究的,你看这自由落体好看嘛,指定不行,要是长这样,那东哥的商城还能卖出去东西吗?Hah

为了不让它自由落体,给它一个向左的偏移量100px

// 获取小球样式

const getBallStyle = (ball: any) => {

if (!ball.show) return {};

// 使用二次贝塞尔曲线计算路径

const t = ball.progress;

const mt = 1 - t;

// 判断起点和终点是否在同一垂直线上

const isVertical = Math.abs(ball.startX - ball.endX) < 20;

// 计算控制点(确保有弧度)

let controlX, controlY;

if (isVertical) {

// 如果在同一垂直线上,向左偏移一定距离

controlX = ball.startX - 100;

controlY = (ball.startY + ball.endY) / 2;

} else {

// 否则使用向左偏移

controlX = (ball.startX + ball.endX) / 2 - 100;

controlY = (ball.startY + ball.endY) / 2 + (ball.pathY || 100);

}

// 二次贝塞尔曲线公式

const x = mt * mt * ball.startX + 2 * mt * t * controlX + t * t * ball.endX;

const y = mt * mt * ball.startY + 2 * mt * t * controlY + t * t * ball.endY;

return {

left: `${x}px`,

top: `${y}px`,

transform: `rotate(${ball.progress * 360}deg)` // 添加旋转效果

};

};

技术要点解析

1. 贝塞尔曲线原理

贝塞尔曲线是一种参数化曲线,广泛应用于计算机图形学。二次贝塞尔曲线由三个点定义:起点P₀、控制点P₁和终点P₂。

曲线上任意点的坐标可以通过以下公式计算:

B(t) = (1-t)²P₀ + 2(1-t)tP₁ + t²P₂ (0 ≤ t ≤ 1)

在我们的实现中,通过调整控制点的位置,可以控制曲线的形状,从而实现小球的抛物线运动效果。

2. requestAnimationFrame的优势

与setTimeout或setInterval相比,requestAnimationFrame有以下优势:

- 性能更好:浏览器会在最合适的时间(通常是下一次重绘之前)执行回调函数,避免不必要的重绘

- 节能:当页面不可见或最小化时,动画会自动暂停,节省CPU资源

- 更流畅:与显示器刷新率同步,动画更平滑

3. 动态计算元素位置

我们使用getBoundingClientRect()方法获取元素在视口中的精确位置,这确保了无论页面如何滚动或调整大小,动画始终能准确地从起点到达终点。

总结

通过这个小球飞入购物车的动画效果,我们不仅提升了用户体验,还学习了:

- 如何使用贝塞尔曲线创建平滑动画

- 如何用requestAnimationFrame实现高性能动画

- 如何动态计算元素位置

- 如何使用rem单位实现移动端适配

这个小小的交互设计虽然看起来简单,但能大大提升用户体验,让你的电商网站更加生动有趣。从京东商城的灵感到实际代码实现,我们完成了一个专业级别的交互效果。

恩恩……懦夫的味道

来源:juejin.cn/post/7502647033401704484

工作两年,最后从css转向tailwind了!

菜鸟上班已经两年了,从一个对技术充满热情的小伙子,变成了一个职场老鸟了。自以为自己在不停的学习,但是其实就是学一些零碎的知识点,比如:vue中什么东西没见过、js什么特性没用过、css新出了个啥 ……

菜鸟感觉自己也出现了惰性,就是暂时用不上的或者学习成本比较大的,就直接收藏了,想着后面再来学习;然后那些很快能接收有用的小的知识点,就感觉看过几次就收藏了,后面有用,就来收藏里面翻一下就行!

但是菜鸟最近再来回想才发现,这些其实都是虚的,程序员最重要的应该是思维模式,以及如何把学的东西、好用的东西用起来,找到应用场景,而不是到时候再去找。

正如标题所说,菜鸟其实很早就知道css原子化,但是一直都走不出自己的舒适圈,感觉就写点css也挺好,为什么还要花力气去记别人想好的类名?要是一直用这些,岂不是css知识都忘记完了?

直到我们公司的大佬来了之后,力推tailwind,而菜鸟感觉和大佬的差距真的很大,所以又激起了菜鸟想要学习的兴趣!

怎么从css过渡到tailwind

菜鸟在之前,是很不想使用tailwind的,因为菜鸟感觉里面很多类名需要去记,而且和我之前取类名的方式也不一样!相信大部分人都和菜鸟一样,在用tailwind之前,取类名一般都是和包裹的内容相关的名字,例如:contentBox、title、asideBox ……

前期使用不熟的时候直接打开官网就行:http://www.tailwindcss.cn/docs/instal…

菜鸟告诉大家一个办法,就是别想着去记类名,直接你想要用什么css属性,直接点击搜索即可,敲入你想使用的属性

多用几次,自然就记住了,而且现在编译器有提示的。用了tailwind之后,只能说句真香,因为再也不会有怎么取名以及有重名的困扰了!

tailwind yyds

一开始菜鸟用tailwind,感觉也不是很自由啊!

菜鸟就感觉这个也太low了吧,我要是想用别的值怎么办?直到菜鸟看到了这个

基本上有了这个,就可以天下无敌了,想多少就多少,这就是自由的感觉!

反正菜鸟基本上用的都是这个,不管是颜色还是大小,除非比较好记的,例如:w-1、w-2、p-1、p-2、m-1、mr-1 ……

tailwind 自定义类名

有一个问题,就是当类名太多的时候,感觉也不是很好看,这个时候就要用到复杂一点的tailwind,见文档:http://www.tailwindcss.cn/docs/reusin…

很多地方都用到一样的样式,就适合这种方式!不然直接多写几个类名也不是不能接受!

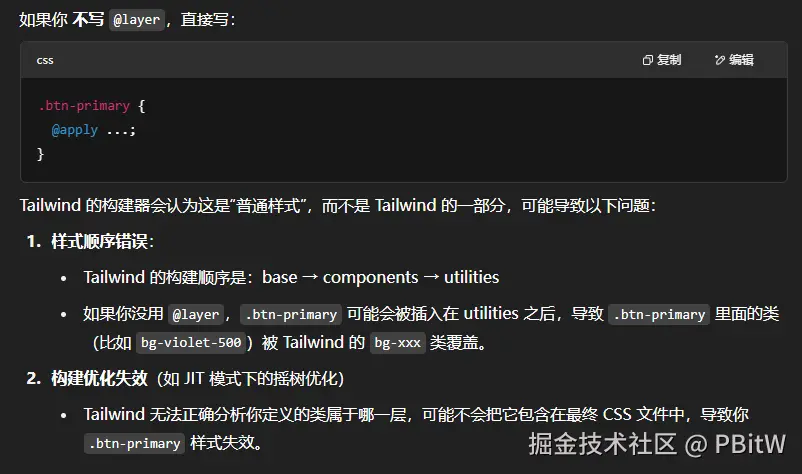

@layer

这个@layer components是避免样式冲突和被覆盖的作用,菜鸟感觉不好理解,但是你肯定不会去重写tailwind的类名,至于有没有树摇优化那就是菜鸟没有涉猎了,反正就当默认写法比较好理解,一般也确实就是这样写。

这里也可以看看tailwind4的官网,感觉说得清楚一点:tailwindcss.com/docs/adding…

当然有懂的读者,可以指点江山,激扬文字!

更多函数或指令

tailwind中不止有@layer、@apply,只是 菜鸟主要就用了这两个,更多见官网:tailwindcss.com/docs/functi…

类名太多,团队规范

当一个元素类名比较多时,每个人的想法都不一样,那么类名就会比较杂乱,可能每个人都不一样,看着就不是很好,这个时候就要使用自动格式化工具了,让每个人的类名排列顺序都是一样,也避免了不少冲突!

只要使用了prettier就可以使用这个,关于prettier的知识可以见:vue3+vite+eslint|prettier+elementplus+国际化+axios封装+pinia

使用tailwind不会忘记css,更是加强css

菜鸟之前对tailwind的误解有点深,其实使用tailwind根本不会降低我们的css水平,相反,你平时多逛逛tailwind官网,反而能发现一些你从未使用过或者使用很少的css属性,你会用tailwind实现,其实就是css会实现,反正都可以增加你对css某个属性的理解,且tailwind还附带了效果示例!

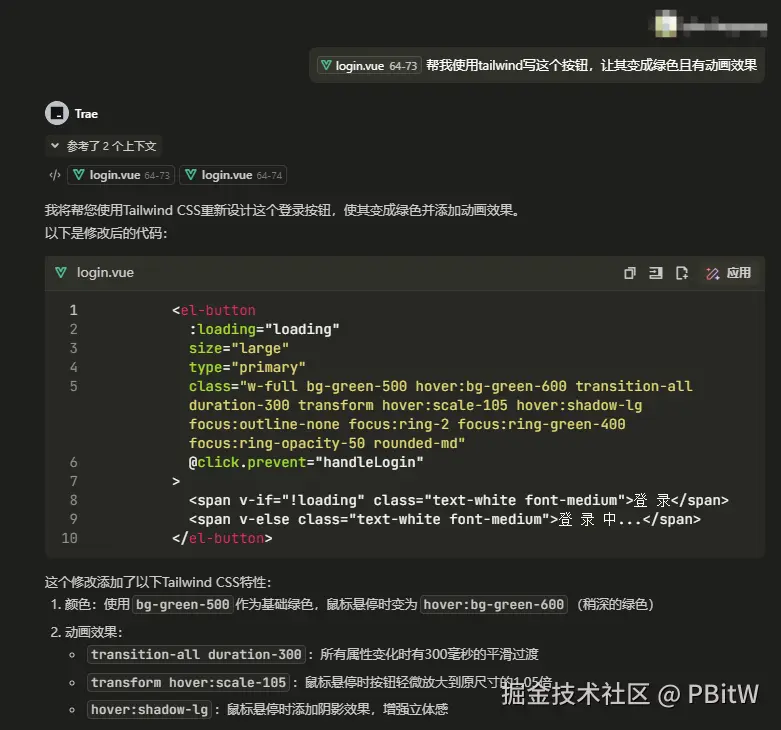

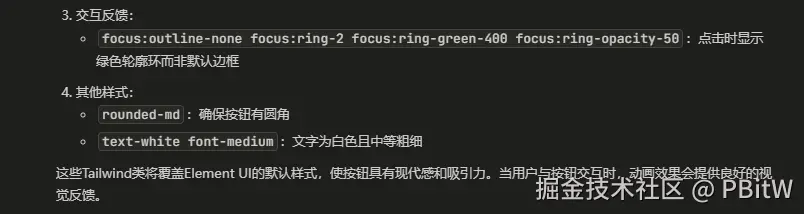

Trae 对 tailwind 的支持

之前的代码

<el-button

:loading="loading"

size="large"

type="primary"

s =tyle="width: 100%"

@click.prevent="handleLogin"

>

<span v-if="!loading">登 录</span>

<span v-else>登 录 中...</span>

</el-button>

实现效果

感觉Trae对tailwind的支持挺好的,一些简单的效果都可以快速实现!

tailwind 可以替代 scss 等

tailwind4 中有明确的说明,见:tailwindcss.com/docs/compat…

菜鸟只能说tailwind的目标很宏大!

总结

tailwind使用不难,所以菜鸟也没啥可以写得很多或者很复杂的,菜鸟只是希望这个经历可以让各位新手赶紧掌握tailwind,不是css用不起,而是tailwind更有性价比!

来源:juejin.cn/post/7501147702667952168

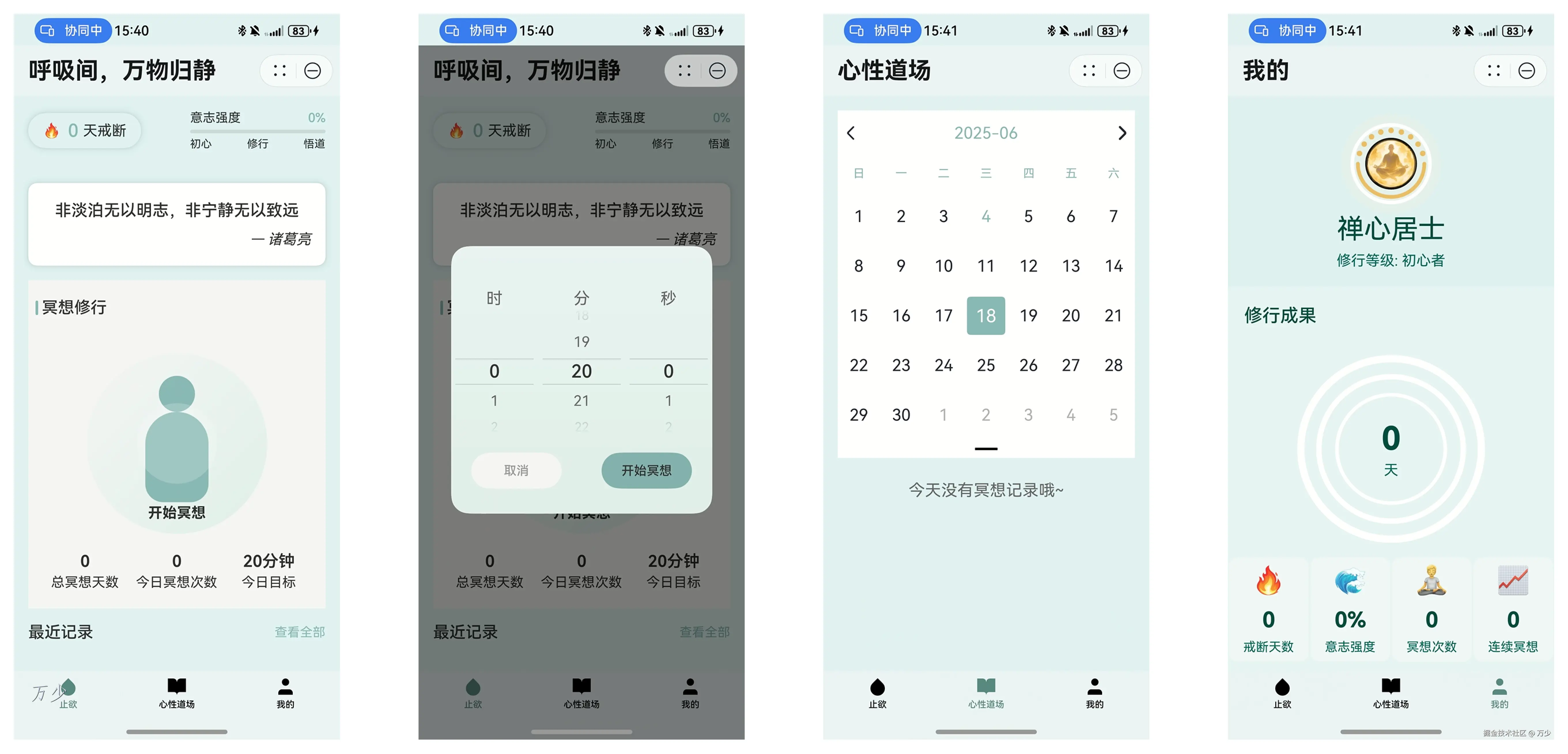

我们又上架了一个鸿蒙项目-止欲

我们又上架了一个鸿蒙项目-止欲

止欲介绍

止欲是一款休闲类的鸿蒙元服务,希望可以通过冥想让繁杂的生活慢下来、静下来。

《止欲》从立项到上架总过程差不多两个月,主要都是我们青蓝的小伙伴在工作止欲抽空完成的,已经实属不易了,我们主要开发者都是 00 后,最年轻的开发者也是才 19 岁。

立项时间是:2025-04-08

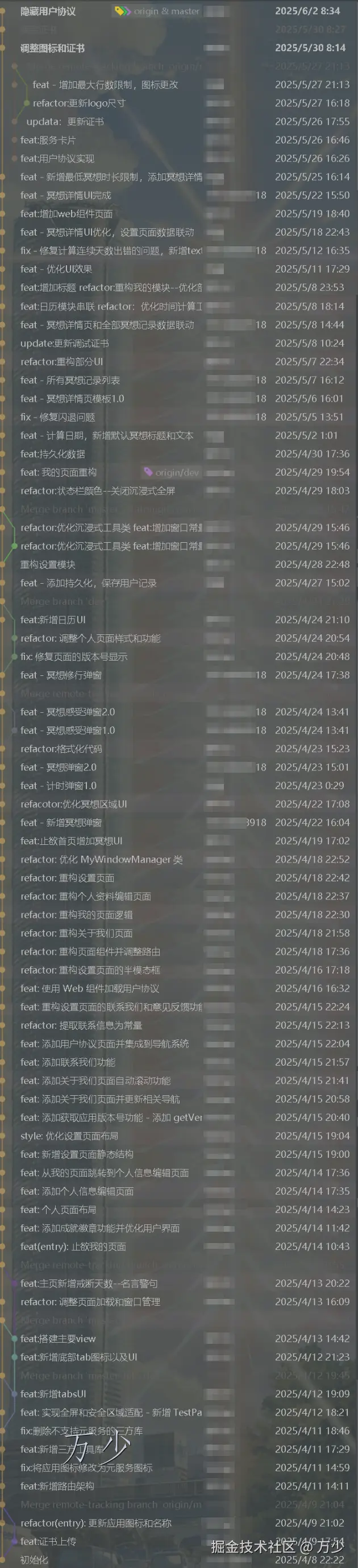

上架时间是:2025-06-03

止欲同时也是我们青蓝逐码组织上架的第三个作品了,每个作品都是由初入职场、甚至大学还没有毕业的小伙伴高度参与!

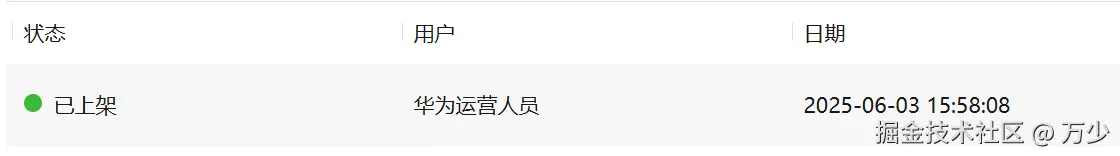

git 日志一览

项目技术细节

项目架构

Serenity/Application/

├── entry/ # 主模块

│ ├── src/main/

│ │ ├── ets/ # TypeScript源码

│ │ │ ├── entryability/ # 应用入口能力

│ │ │ ├── entryformability/ # 服务卡片能力

│ │ │ ├── pages/ # 页面文件

│ │ │ ├── view/ # UI组件

│ │ │ ├── utils/ # 工具类

│ │ │ ├── model/ # 数据模型

│ │ │ ├── const/ # 常量定义

│ │ │ └── navigationStack/ # 导航栈管理

│ │ └── resources/ # 资源文件

│ └── module.json5 # 模块配置

├── EntryCard/ # 服务卡片模块

├── AppScope/ # 应用级配置

└── oh-package.json5 # 依赖管理

技术栈

- 开发语言: ArkTS (TypeScript)

- UI 框架: ArkUI

- 构建工具: Hvigor

- 包管理: ohpm

核心开发套件 (Kit)

本项目使用了多个 HarmonyOS 官方开发套件:

| 套件名称 | 用途 | 主要 API |

|---|---|---|

| @kit.ArkUI | UI 框架和导航 | AtomicServiceNavigation, window |

| @kit.BasicServicesKit | 基础服务 | BusinessError, request |

| @kit.MediaLibraryKit | 媒体库访问 | photoAccessHelper |

| @kit.CoreFileKit | 文件操作 | fileIo |

| @kit.ImageKit | 图像处理 | image.createImageSource |

| @kit.PerformanceAnalysisKit | 性能分析 | hilog |

| @kit.AbilityKit | 应用能力 | UIAbility, abilityAccessCtrl |

开发环境要求

- HarmonyOS SDK: 5.0.1(13) 或更高版本

- DevEco Studio: 5.0 或更高版本

- 编译目标: HarmonyOS

开发细节

开始立项

分析如何选型

暴躁起来了

成功上架

后续计划

- 接入登录

- 接入端云一体

- 增加趣味性功能

- 代码开源-分享教程

总结

如果你兴趣想要了解更多的鸿蒙应用开发细节和最新资讯,甚至你想要做出一款属于自己的应用!欢迎在评论区留言或者私信或者看我个人信息,可以加入技术交流群。

来源:juejin.cn/post/7511779749967347747

解锁企业高效未来|上海飞络Synergy AI开启智能体协作新时代

他/她可以有自己的电脑,可以有自己的邮箱号,可以有自己的企业微信号。只要赋予权限,他/她可以替你完成各种日常工作,他/她可以随时随地和你沟通并完成你安排的任务,他/她永远高效!他/她永不抱怨!

Synergy AI数字员工雇佣管理平台,以大语言模型驱动的AI Agent为核心,结合MCP工具集,并在数据安全、信息安全及行为安全的多维度监控下,为企业提供安全、合规、高效的“智能体员工”,重塑人机协作新范式!

为什么选择Synergy AI数字员工管理平台?

1、智能生产力升级

AI Agent数字员工深度融合语言理解、逻辑推理与工具调用能力,是能够自主感知环境、决策并执行任务的人工智能系统。它可以拥有自己的电脑、邮箱,微信号等所有员工的权限,同时也具备MCP工具集中的各种技能,能够像真人一样沟通,处理工作,但是能够实现更高的工作效率和更加低廉的成本!

2、根据职位定制AI员工工作流

通过“AIGC+Workflow”组合,实现任务自动化执行,响应速度大幅提升,成为企业降本增效的核心引擎。

同时基于企业人员、技能、文档、流程等六大核心信息库,AI数字员工可快速融入业务场景,提供从单职能支持、人机协同到多职能协作的全链路服务。

3、安全合规,全程可控

1)行为监测

实时检测AI数字员工是否存在权限越界、敏感数据操作,信息泄露,被黑客利用等安全合规隐患。

2)数据安全管控

智能识别、过滤、脱敏替换AI数字员工及大语言模型使用过程中触发的敏感数据,企业核心数据泄漏等风险。

3)效能可视化

通过工作流执行情况、人工干预度等指标,持续优化AI员工表现。

Synergy AI能实现什么效果?

1、AI销售助理

可协助销售管理日程、预约会议、统计CRM数字,甚至代替销售联络沟通回款问题。入职飞络销售部门后,内部数据显示客户响应效率提升3倍以上,人力成本降低60%,助力团队精准触达商机。

2、SOC安全及运维专员

在安全运营和运维场景中,AI员工可以迅速响应各个安全系统平台的告警,并根据制定的工作流程,进行下一步的沟通、交流、处置。让企业安全事件响应速度大幅提升,精准提高准确率,为企业筑牢数字防线。

3、更多AI人职位有待解锁

根据每家企业不同的场景需求,Synergy AI提供可以定制化的各种企业AI数字员工,让AI智能体真正能够匹配企业需求,为企业带来实际帮助。

Synergy AI如何落地实施?

1、分析岗位SOW/SOP

找到重复、需要与人互动的工作流,快速实现智能化并通过拟人化的AI员工来完成,逐步将AI工作流覆盖全业务。

2、无缝对接系统

支持OA、ERP、CRM、M365等主流平台MCP / API对接。

3、7×24小时护航

飞络安全运营中心全程监控,保障业务稳定运行。

企业的信息安全如何保护?

飞络基于自研发两大安全管理平台,为企业在使用AI的同时,极大限度保障企业的数据以及隐私安全:

企业AI安全事件监控管理平台

通过企业AI安全事件监控管理平台,我们可以实时提供AI系统以及AI Agents的运行状态,对于所发生的安全事件,实行7*24小时的安全监控及管理。

ASSA:企业AI数据过滤平台

通过ASSA,企业可以管理及管控企业内部信息传输到大语言模型上的数据,对于敏感信息、企业机密、个人信息等进行阻止、脱敏、模糊化等管理操作

7*24 SOC服务

基于飞络提供的7*24级别的SOC运营服务,可以协助客户一起实时监控及管理所有AI相关的安全事件,为企业的数据安全保驾护航!

Synergy AI数字员工雇佣管理平台,以自主研发技术为核心,为企业提供一站式智能解决方案。

收起阅读 »Chrome AI:颠覆网页开发的全新黑科技

Chrome AI 长啥样

废话不多说,让我们直接来看一个示例:

async function askAi(question) {

if (!question) return "你倒是输入问题啊"

// 检查模型是否已下载(模型只需下载一次,就可以供所有网站使用)

const canCreate = await window.ai.canCreateTextSession()

if (canCreate !== "no") {

// 创建一个会话进程

const session = await window.ai.createTextSession()

// 向 AI 提问

const result = await session.prompt(question)

// 销毁会话

session.destroy()

return result

}

return "模型都还没下载好,你问个蛋蛋"

}

askAi("玩梗来说,世界上最好的编程语言是啥").then(console.log)

//打印: **Python 语言:程序员的快乐源泉!**

可以看到这些浏览器原生 AI 接口是挂在 window.ai 对象下面的,浏览器自带 AI 模型(要下载),无需消耗开发者的资金去调用 OpenAI API 或者是 文心一言 API等。

由于没有成本限制,想象空间极大扩展。你可以将智能融入网页的每一个环节。例如,实时翻译,传统的 i18n 只能映射静态字符串来支持多语言,对于后端传过来的字符串毫无办法,现在可以交给 AI 实时翻译并展示。

未来,这个浏览器 AI 标准接口将不仅限于 Chrome 和 PC 端,其他浏览器厂商也会跟进,手机也将拥有本地运行小模型的浏览器。

Chrome AI 接口文档

我们刚刚看到了 Chrome AI 的调用示例,现在让我们看一下完整的 Chrome 文档。我将用 TypeScript 和注释方式展示,这些类型和注释是我手动编写的,全网独一无二,赶紧收藏:

declare global {

interface Window {

readonly ai: AI;

}

interface AI {

/**

* 判断模型是否准备好了

* @example

* ```js

* const availability = await window.ai.canCreateTextSession()

* if (availability === 'readily') {

* console.log('模型已经准备好了')

* } else if (availability === 'after-download') {

* console.log('模型正在下载中')

* } else {

* console.log('模型还没下载')

* }

* ```

*/

canCreateTextSession(): Promise<AIModelAvailability>;

/**

* 创建一个文本生成会话进程

* @param options 会话配置

* @example

* ```js

* const session = await window.ai.createTextSession({

* topK: 50, // 生成文本的多样性,越大越多样

* temperature: 0.8 // 生成文本的创造性,越大越随机

* })

*

* const text = await session.prompt('今天天气怎么样?')

* console.log(text)

* ```

*/

createTextSession(options?: AITextSessionOptions): Promise<AITextSession>;

/**

* 获取默认的文本生成会话配置

* @example

* ```js

* const options = await window.ai.defaultTextSessionOptions()

* console.log(options) // { topK: 50, temperature: 0.8 }

* ```

*/

defaultTextSessionOptions(): Promise<AITextSessionOptions>;

}

/**

* AI模型的可用性

* - `readily`:模型已经准备好了

* - `after-download`:模型正在下载中

* - `no`:模型还没下载

*/

type AIModelAvailability = 'readily' | 'after-download' | 'no';

interface AITextSession {

/**

* 询问 AI 问题, 返回 AI 的回答

* @param input 输入文本, 询问 AI 的问题

* @example

* ```js

* const session = await window.ai.createTextSession()

* const text = await session.prompt('今天天气怎么样?')

* console.log(text)

* ```

*/

prompt(input: string): Promise<string>;

/**

* 询问 AI 问题, 以流的形式返回 AI 的回答

* @param input 输入文本, 询问 AI 的问题

* @example

* ```js

* const session = await window.ai.createTextSession()

* const stream = session.promptStreaming('今天天气怎么样?')

* let result = ''

* let previousLength = 0

*

* for await (const chunk of stream) {

* const newContent = chunk.slice(previousLength)

* console.log(newContent) // AI 的每次输出

* previousLength = chunk.length

* result += newContent

* }

*

* console.log(result) // 最终的 AI 回答(完整版)

*/

promptStreaming(input: string): ReadableStream;

/**

* 销毁会话

* @example

* ```js

* const session = await window.ai.createTextSession()

* session.destroy()

* ```

*/

destroy(): void;

/**

* 克隆会话

* @example

* ```js

* const session = await window.ai.createTextSession()

* const cloneSession = session.clone()

* const text = await cloneSession.prompt('今天天气怎么样?')

* console.log(text)

* ```

*/

clone(): AITextSession;

}

interface AITextSessionOptions {

/**

* 生成文本的多样性,越大越多样,正整数,没有范围

*/

topK: number;

/**

* 生成文本的创造性,越大越随机,0-1 之间的小数

*/

temperature: number;

}

}

如何启用 Chrome AI

准备工作

- 下载最新 Chrome Dev 版或 Chrome Canary 版。(版本号不低于

128.0.6545.0) - 确保你的电脑有

22G的可用存储空间。 - 很科学的网络

启用 Gemini Nano 和 Prompt API

- 打开

Chrome, 在地址栏输入:chrome://flags/#optimization-guide-on-device-model,选择enable BypassPerfRequirement,这步是绕过性能检查,确保Gemini Nano能顺利下载。 - 再输入

chrome://flags/#prompt-api-for-gemini-nano,选择enable。 - 重启

Chrome浏览器。

确认 Gemini Nano 是否可用

- 按

F12打开开发者工具, 在控制台输入await window.ai.canCreateTextSession(),如果返回readily,就说明 OK 了。 - 如果上面的步骤不成功,重启

Chrome后继续下面的操作:

- 新开一个标签页,输入

chrome://components - 找到

Optimization Guide On Device Model,点击Check for update,等待一个世纪直到Status - Component updated出现就是模型下载完成。(模型版本号不低于2024.5.21.1031)

- 新开一个标签页,输入

- 模型下载完成后, 再次在开发者工具的控制台中输入

await window.ai.canCreateTextSession(),如果这次返回readily,那就 OK 了。 - 如果还是不行,可以等一会儿再试。多次尝试后仍然失败,请关闭此文章🐶。

思考

AI 最近两年可谓是爆发式增长,从 GPT-3 开始,笔者就一直在使用 AI 产品,如 Github copilot。ChatGPT 推出后,我迅速开发了一个 GPT-Runner vscode 扩展,用于勾选代码文件进行对话。

我一直在思考,AI 能给网页产品带来哪些变革?例如,有没有可能出现一个 AI 组件库,将 AI 智能赋予组件,如 input 框猜测用户下一步输入,或 table 组件实现自然语言搜索和数据拼装。

与 AI 相关的技术通常需要额外的计算成本,企业主和用户支付意愿低。如果能利用本地算力,就无需额外花费。这个场景现在似乎在慢慢实现。

作为开发者,我们正在迎来 AI 全面赋能网页操作的时代。让我们积极拥抱变化,向老板展示更多的迭代需求,找到前端就业的新增长点。

如果本文章感兴趣者众多,将考虑使用这个 AI 接口实现兼容 OpenAI API 规范,这样你可以不用花钱,不用装 Docker,直接使用浏览器算力和油猴插件免费使用各类开源 chat web ui,如在线版的 Chat-Next-Web。

彩蛋

仔细观察 window.ai.createTextSession ,你会发现它为什么不叫 window.ai.createSession ?我猜测未来可能会有 text-to-speech 模型、 speech-to-text 模型、text-to-image 模型、image-to-text 模型,或者更多惊喜。

这不是随便猜测,我是在填写 Chrome AI preview 邀请表时看到的选项。敬请期待吧,各位前端开发er。

来源:juejin.cn/post/7384997062415843339

为了不让同事看到我的屏幕,我写了一个 Chrome 插件

那天下午,我正在浏览一些到岛国前端技术文档,突然听到身后传来脚步声。我下意识地想要切换窗口,但已经来不及了——我的同事小张已经站在了我身后。"咦,你在看什么?"他好奇地问道。我尴尬地笑了笑,手忙脚乱地想要关闭页面。那一刻,我多么希望有一个快捷键,能瞬间让整个屏幕变得模糊,这样就不会有人看到我正在浏览的内容了。

于是乎我想:为什么不开发一个 Chrome 插件,让用户能够一键模糊整个网页呢?这样不仅能保护隐私,还能避免类似的尴尬情况。

开发过程

说干就干,我开始了 Web Blur 插件的开发。这个插件的核心功能很简单:

- 一键切换:使用快捷键(默认 Ctrl+B)快速开启/关闭模糊效果

- 可调节的模糊程度:根据个人喜好调整模糊强度

- 记住设置:自动保存用户的偏好设置

技术实现

1.首先,我们需要在 manifest.json 中声明必要的权限:

"manifest_version": 3,

"name": "Web Blur",

"version": "1.0",

"permissions": [

"activeTab",

"storage",

"commands"

],

"action": {

"default_popup": "popup.html",

"default_icon": {

"128": "images/icon.png"

}

},

"commands": {

"toggle-blur": {

"suggested_key": {

"default": "Ctrl+Shift+B"

},

"description": "Toggle blur effect"

}

}

}

2. 实现模糊效果

function applyBlur(amount) {

const style = document.createElement('style');

style.id = 'web-blur-style';

style.textContent = `

body {

filter: blur(${amount}px) !important;

transition: filter 0.3s ease;

}

`;

document.head.appendChild(style);

}

// 移除模糊效果

function removeBlur() {

const style = document.getElementById('web-blur-style');

if (style) {

style.remove();

}

}

3. 快捷键控制

if (command === 'toggle-blur') {

chrome.tabs.query({active: true, currentWindow: true}, (tabs) => {

chrome.tabs.sendMessage(tabs[0].id, {action: 'toggleBlur'});

});

}

});

4. 用户界面

5px

Current: Ctrl+Shift+B

5. 设置持久化

function saveSettings(settings) {

chrome.storage.sync.set({settings}, () => {

console.log('Settings saved');

});

}

// 加载设置

function loadSettings() {

chrome.storage.sync.get(['settings'], (result) => {

if (result.settings) {

applySettings(result.settings);

}

});

}

以后可以愉快的学技术辣

来源:juejin.cn/post/7509042833152851978

开源鸿蒙开发者大会2025 | 大屏生态分论坛:共建共享,共赢未来

5月24日,开源鸿蒙开发者大会2025(OHDC.2025)在深圳成功举办。在主论坛上隆重举行了“开源鸿蒙TV SIG”成立仪式,开源鸿蒙TV SIG旨在携手产业伙伴,基于开源鸿蒙社区,构建TV关键技术能力、推动产业标准制定和落地、加强生态合作,促进大屏生态繁荣。

开源鸿蒙TV SIG成立仪式

大会期间,同步举办了以“共建共享,共赢未来”为主题的大屏生态分论坛,与会者围绕开源鸿蒙TV SIG技术规划、大屏应用、系统、产品、芯片及配件等关键技术的突破等11个热点议题进行分享与交流,并就未来的发展方向进行了深入探讨,全方位展示基于开源鸿蒙操作系统的大屏生态在创新实践和落地应用方面的成果。本次论坛由开源鸿蒙TV SIG组长、华为终端BG OpenHarmony使能部大屏生态总监汪曙光担任出品人。

大屏生态分论坛圆满举办

华为终端BG OpenHarmony使能部副部长李彦举发表开幕致辞,向所有参与开源鸿蒙大屏生态共建的开发者及企业致谢,并高度评价了开源鸿蒙大屏建设所取得的阶段性成果。基于对大屏行业的深度洞察与开源鸿蒙技术的演进趋势,他指出:“开源鸿蒙大屏产业近年来取得了显著的阶段性成果,已进入高速发展期。”同时,他呼吁更多伙伴和开发者加入生态共建,加速推进大屏生态从技术验证向规模商用的关键跨越,共同把握智慧显示终端的时代机遇。

华为终端BG OpenHarmony使能部副部长李彦举

开源鸿蒙TV SIG组长汪曙光发表题为《开源鸿蒙TV SIG整体规划及最新共建进展》的主题演讲。他表示,TV SIG将以“建能力、立标准、促生态、广复制”为目标,携手SIG成员及广大生态伙伴,搭建社区大屏公共软硬件平台,进行技术的孵化和生态的推动,并展示了SIG组的技术全景图以及路标规划。在演讲中,汪曙光详细介绍了大屏生态已取得的成果:完善了10多个系统应用和专有能力,推出了9个第三方应用(涵盖应用市场、影音娱乐、工具游戏等多个领域)和4颗媒体SoC主芯片(适用于TV、商显、盒子等多种设备)。在演讲最后他提到,基于开源鸿蒙的大屏北向三方应用预计将于今年下半年取得阶段性进展,SIG组也将支撑伙伴孵化出更多商用产品。

华为终端BG OpenHarmony使能部大屏生态总监汪曙光

开源鸿蒙TV SIG副组长、北京风行在线技术有限公司高级技术专家韩超在论坛上做了《风行面向开源鸿蒙的大屏应用市场进展分享》的主题演讲。作为内容运营服务商,风行始终致力于让内容流动更简单,并为数亿用户提供了优质的数字文娱服务。韩超详细介绍了风行在应用开发方面的技术方案和成功实践,并将应用框架源码开源至社区,帮助行业伙伴缩短开发周期。截止目前,风行已推出多款开源鸿蒙大屏应用,其中“橙子市场”作为开源鸿蒙大屏端首个应用市场,旨在为生态伙伴提供内容及应用分发服务,当前已上架的应用涵盖了影视、游戏、教育等多个品类。未来,风行将继续携手行业伙伴,鼓励更多优质应用入驻,持续丰富应用种类,满足用户多样化需求。

北京风行在线技术有限公司高级技术专家韩超

开源鸿蒙TV SIG副组长、华为终端BG智慧交互软件开发部技术专家华红宁带来《面向开源鸿蒙的大屏TV子系统共建进展分享》议题演讲。他详细介绍了华为智慧屏的业务、产品愿景及使命,并表达了通过共建共享,与开源鸿蒙生态伙伴携手推动传统大屏产业升级的期望。与此同时,他还分享了开源鸿蒙TV子系统的架构、业务分层以及核心业务的逻辑,并同步了最新的开发进展和后续规划:通过开源共建,TV子系统已取得显著进展,预计上半年将完成核心功能开发,并将在下半年持续进行功能迭代与完善,后续版本也已规划一系列新特性。他诚邀行业伙伴共同参与代码共建,提升未来产品竞争力。

华为终端BG智慧交互软件开发部技术专家华红宁

开源鸿蒙TV SIG副组长、四川长虹电子控股集团有限公司操作系统高级技术专家张帅做《长虹面向开源鸿蒙的大屏实践分享和后续展望》议题分享,展示了长虹积极拥抱开源鸿蒙的坚定态度。他指出,长虹云计算与大数据研究中心长期深度参与开源鸿蒙大屏社区共建,推动开源鸿蒙在智慧显示终端领域的生态完善。作为重要共建单位,长虹积极贡献遥控器拾音、分布式白板应用等关键技术架构,完善了社区的技术能力。未来,长虹将持续深化与开源鸿蒙社区的合作,聚焦于开源鸿蒙教育大屏、开源鸿蒙TV等有屏设备以及工业智能终端、工业机器人等方向,推动开源鸿蒙能力平台与产业落地深度融合,为构建智能终端操作系统生态贡献力量。

四川长虹电子控股集团有限公司操作系统高级技术专家张帅

开源鸿蒙TV SIG副组长、海思技术有限公司产品规划总监陈超带来《上海海思媒体领域面向开源鸿蒙的探索与实践》主题分享。他详细介绍了上海海思全面拥抱开源鸿蒙的策略,强调了开源鸿蒙与上海海思芯片深度融合的整体解决方案优势。他表述,开源鸿蒙与星闪技术的强强联合,将有力推动IoT、轻智能、泛媒体等领域智能化升级。在泛媒体终端领域,上海海思已有多款媒体类模组/开发板通过开源鸿蒙认证,涵盖了会议平板、闺蜜机、直播机、智慧大屏等多种产品形态。上海海思正全面支持产业产品的创新发展,助力开源鸿蒙生态繁荣壮大。

海思技术有限公司产品规划总监陈超

开源鸿蒙TV SIG成员、未来电视有限公司高级技术专家李欣做了《聚力开源鸿蒙,共启央视频TV未来》议题分享,详细介绍了未来电视在TV端大屏应用——央视频TV的发展历程、平台架构演进,以及开源鸿蒙版本的开发与迭代计划。未来,央视频TV将在其开源鸿蒙版本中逐步集成灵犀触控、互动卡片等创新功能,持续优化用户互动操控体验。此外,央视频TV将依托开源鸿蒙的人脸识别技术,在确保用户隐私安全的基础上为不同用户群体提供个性化的内容推荐和事件推送等陪伴功能,共同构建“有温度”的客厅场景。

未来电视有限公司高级技术专家李欣

开源鸿蒙TV SIG成员、湖南国科微电子股份有限公司资深系统架构师刘杰兵带来《国科微基于开源鸿蒙的芯片平台介绍》议题分享。他指出,基于开源鸿蒙行业发行版的芯片适配是点亮亿级行业设备的关键。作为国内领先的集成电路设计企业,国科微在大型SoC及解决方案开发方面积累了丰富的实践经验,并积极推进开源鸿蒙芯片适配工作,为开源鸿蒙生态建设注入强劲动力。截至目前,国科微已获得5张兼容性测评证书,涵盖机顶盒、电视、商显、摄像头等多个应用场景,实现多个业内首款“开源鸿蒙认证”。未来,国科微将持续提速国科芯开源鸿蒙适配工作,并将于2025年第三季度和第四季度推出基于开源鸿蒙的5.0和5.1商用版本。

湖南国科微电子股份有限公司资深系统架构师刘杰兵

开源鸿蒙TV SIG成员、上海视九信息科技有限公司总裁周云龙发表《面向开源鸿蒙的大屏小程序平台介绍》主题演讲。他介绍了公司研发的JsView引擎,其核心价值在于能为开源鸿蒙生态快速引入丰富的大屏小程序应用。作为在国内主流OTT、IPTV设备稳定运行多年的成熟引擎,JsView以开发周期短、部署升级快、页面流畅、特效丰富等优势,成为行业开发标杆。目前,JsView引擎已完成开源鸿蒙系统适配,基于该平台开发的央视国学苑、唱吧K歌等数十家头部内容的小程序版本,可直接上线开源鸿蒙大屏设备。全新的内容或应用,也可经由该引擎快速开发融入开源鸿蒙生态。

上海视九信息科技有限公司总裁周云龙

开源鸿蒙TV SIG成员、广东辰奕智能科技股份有限公司研究院院长严开云带来《面向开源鸿蒙的大屏配件生态解决方案介绍》,并现场发布首款基于开源鸿蒙的指向语音遥控器及生态配件产品。作为开源鸿蒙TV生态的亮点创新成果,该遥控器具备隔空触控、智慧触摸、近场语音及灵活批注等功能,兼容多类南向应用,灵活适配家庭娱乐场景需求,为用户带来更智能、便捷的交互体验。该产品的发布,充分彰显了开源鸿蒙在智能硬件领域的应用潜力。

广东辰奕智能科技股份有限公司研究院院长严开云

开源鸿蒙TV SIG成员、鸿湖万联(江苏)科技发展有限公司PC及大屏产品总监袁杰做《基于开源鸿蒙的教育及会议大屏产品实践分享》主题分享。据介绍,软通动力充分融合子公司鸿湖万联在开源鸿蒙领域的创新突破以及软通计算机(原同方计算机)的硬件优势,率先推出搭载SwanLinkOS天鸿操作系统的开源鸿蒙智能交互大屏产品,并完成跨系统跨终端形态的多屏协同、集成DeepSeek大模型应用、以及教育应用软件的开源鸿蒙移植工作,为行业客户提供软硬一体端到端的产品及服务能力。

鸿湖万联(江苏)科技发展有限公司PC及大屏产品总监袁杰

开源鸿蒙TV SIG成员、江苏润开鸿数字科技有限公司开源鸿蒙应用架构师傅康带来《基于开源鸿蒙文件管理器与DeepSeek的大屏开发实践》议题分享,深入介绍文件管理器和DeepSeek在开源鸿蒙大屏上的实现方案及核心功能点,并针对大屏设备的交互特点,适配了遥控器走焦、灵犀操控功能。基于DeepSeek的语音助手还支持蓝牙遥控器语音以及ASR语音转文字等功能,显著提升用户操控体验的同时,也赋予大屏如家庭管家、家庭医生和家庭教师等更多角色。

江苏润开鸿数字科技有限公司开源鸿蒙应用架构师傅康

本次大屏生态分论坛内容丰富,活动现场人气火爆,充分彰显了大屏行业伙伴对开源鸿蒙大屏技术发展、生态进展的高度关注与殷切期待。同时,也印证了开源鸿蒙在大屏产业中拥有广阔的发展前景,具备广泛应用与行业创新的巨大潜力。诚挚欢迎更多开发者和企业加入开源鸿蒙TV SIG组,一起“共建共享,共赢未来”!

收起阅读 »2025 BOE(京东方)全球供应伙伴大会隆重举行 共筑全球显示产业共生共赢新格局

5月28日,备受瞩目的2025年BOE(京东方)全球供应伙伴大会(BOE SPC 2025)在东方帆船之都——青岛盛大启幕。作为半导体显示领域极具影响力的供应链盛会,本届BOE SPC大会以“屏之物联 共生共赢”为主题,汇聚了全球千余位显示行业专家、卓越合作伙伴企业代表及业界精英齐聚一堂,不仅展现了意义深远的行业蓝图、精彩纷呈的主题演讲,BOE(京东方)还对在技术、品质、服务等方面做出杰出贡献的合作伙伴进行表彰,倡导行业协同可持续发展。BOE(京东方)将充分发挥在显示领域的引领作用,携手全球合作伙伴构建可持续的创新生态,树立显示产业技术升级与供应链绿色发展的全新标杆。

BOE(京东方)董事长陈炎顺在致辞中表示:“在当今物联网、人工智能等与产业深度融合的时代,‘屏’已从简单的显示终端进化为智能交互的核心枢纽。我们深知供应伙伴是企业发展的重要支撑,是推动全球产业链协同的关键力量。我们举办SPC大会,旨在搭建一个开放包容、共生共赢的多方交流平台,加强与全球合作伙伴之间的合作,共同探讨未来技术创新、高质发展的有效路径,推动全球产业链不断优化升级。在未来的发展道路上,BOE(京东方)将始终以创新为驱动,以共赢为目的,以质量为基石,并期望以刚发布的半导体显示行业首个可持续发展品牌‘ONE’为纽带,携手全球合作伙伴,构建绿色可持续生态体系,秉承开放、包容、创新理念共同书写产业高质量发展新篇章。”

在“屏之物联 共生共赢”主题演讲环节,BOE(京东方)首席执行官冯强表示:“今天的物联时代,数字化与智能化逐渐成为驱动产业创新的重要引擎。BOE(京东方)紧抓时代机遇,以显示技术为原点,将屏幕硬件与传感系统、大数据分析、优化算法等智能要素深度融合,为客户提供从器件到解决方案的全链条服务,依托器件研发、智能制造、系统集成等核心能力,以‘科技+绿色’引领产业向新,持续突破应用场景边界。多年来,BOE(京东方)始终坚持开放合作,基于‘屏’及周边能力价值延展,强化资源赋能。未来,BOE(京东方)向行业发起倡议,深化技术协同创新,贯彻可持续发展理念,强化产业战略协同,携手全球伙伴共同谱写产业高质发展新篇章。“

经过多年的探索与深耕,BOE(京东方)已在生态共创方面取得了一系列成果,形成了以BOE(京东方)为核心的产业链生态,在技术创新、产业发展、生态构建等方面与合作伙伴开展了深度合作。在活动现场,BOE(京东方)首席采购官张学智对合作伙伴长期以来的大力支持与并肩同行表示感谢,并围绕“稳筑生态求共生 聚势协同谋共赢”主题发表演讲。他表示,BOE(京东方)通过全产业链协同创新,实现了UB Cell创新技术及三折模组产品弯折良率等显示领域的创新突破。在绿色转型方面,BOE(京东方)构建从设计到回收的全生命周期绿色体系。未来,BOE(京东方)将通过技术共研、生态共建的协同模式,持续引领行业向绿色低碳、智能创新方向突破发展。

在可持续发展领域,BOE(京东方)持续践行ESG理念,发布行业首个可持续发展品牌“ONE”(Open Next Earth),以开放凝聚共识,以创新定义未来,以永续守护生态。此次SPC大会,BOE(京东方)也将可持续发展理念融入大会议程的各个环节,携手合作伙伴共同推动产业生态的绿色发展。在“共生共赢:可持续供应链的探索与实践”圆桌论坛中,BOE(京东方)携手德勤、福莱盈、山西宇皓等合作伙伴共议绿色发展新路径。德勤谢安指出,供应链金融与低碳转型是应对全球监管趋势的必然方向。BOE(京东方)副总裁、京东方创新投资有限公司COO赵月明分享了定制化金融解决方案,通过稳定资金链构建“共生”生态;BOE(京东方)副首席建设官李彦则展示了绿色运营成果,并联动京东方能源董事长马亮发布公司新能源战略布局。作为合作伙伴代表,山西宇皓郭伦铭、福莱盈张靖表示,BOE(京东方)“绿色+金融”双轮驱动的模式效果显著,既通过供应链金融服务缓解了资金压力,又以智慧能源解决方案助力抢占绿色市场先机。BOE(京东方)将依托技术创新持续深化供应链赋能,携手伙伴迈向“技术驱动、开放包容”的可持续未来。

为表彰一路同行的合作伙伴,本届BOE SPC特别为近百家优秀合作伙伴颁发“钻石奖”、“杰出战略伙伴奖”、“卓越服务奖”、“卓越品质奖”、 “协同创新奖”、“最佳进步奖”,其中,DNP、杉金、SUNIC凭借深厚的技术底蕴和强大的研发实力荣获BOE(京东方)全球供应伙伴最高荣誉——“钻石奖”。该奖项不仅承载了BOE(京东方)携手合作伙伴共谋发展、共创未来的坚定信念,更是对双方长期合作关系的深度认可。值得关注的是,本次大会共有十余家合作伙伴与BOE(京东方)签署了战略合作协议,未来将不断进行技术合作研发和产品共创,塑造更大的产业价值。

当前,实体经济与数字经济的深度融合正加速重构全球产业格局,以AI、物联网为代表的前沿技术形成颠覆性创新浪潮,推动全产业链向智能化、场景化、生态化方向跃迁。面向未来,BOE(京东方)将持续深耕“屏之物联”发展战略,坚持市场化、国际化、专业化的发展道路,以“科技+绿色”推动显示行业高质永续发展,携手全球合作伙伴在技术创新、可持续发展、绿色供应链能力建设等方面开展深度交流与合作,共赢发展新机遇,开启显示赋能人类美好生活的无限可能。

开源鸿蒙开发者大会2025成功召开,启动开源鸿蒙应用技术组件共建

5月24日,开源鸿蒙开发者大会2025(OHDC.2025,以下简称“大会”)在深圳成功举办。开源四年多来,开源鸿蒙代码规模已达 1.3 亿多行,代码贡献者达 8600 多位,超过 1100 款软硬件产品通过兼容性测评,覆盖金融、交通、教育、医疗、航天等多个行业领域,已成为发展速度最快的开源操作系统之一。截至目前,开源鸿蒙已累计发布 8 个大版本,共建共享15个技术域的1115款开源三方库和6个跨平台框架,加速应用和设备的开发。

会上,开源鸿蒙项目群工作委员会携手包括华为、腾讯端服务、京东、去哪儿、杭州通易科技、东北大学、上海大学、深开鸿、九联开鸿、中科鸿略、诚迈科技、鸿湖万联、润开鸿、开鸿智谷在内的14家共建伙伴,共同启动了开源鸿蒙应用技术组件共建。

社区的繁荣发展离不开每一位参与其中并积极贡献的开发者,每一行代码都是对开源鸿蒙社区的重要贡献。共建伙伴积极投入开源三方库和跨平台框架的特性开发、版本升级、Upstream上游社区以及社区Issue响应和维护,为开源鸿蒙应用的开发节约重复的代码开发工作量。期望更多的伙伴、开发者加入到开源鸿蒙应用三方库和跨平台框架的共建中,共建共享开源鸿蒙应用生态组件。

![1748411439482163.png M$@I91O{0R`XUD]WSSR80]H.png](http://objectnsg.oss-cn-beijing.aliyuncs.com/default/202505/28/20250528135039741444044.png)

期望更多的伙伴、开发者加入到开源鸿蒙应用三方库和跨平台框架的共建中,共建共享开源鸿蒙应用生态组件。

收起阅读 »“你好BOE”2025首站启幕 助力“横琴-澳门国际数字艺术博览会”打造沉浸式科技艺术新高地

5月26日,BOE(京东方)年度标杆性线下品牌营销活动“你好BOE”2025启动仪式在珠海横琴文化艺术中心举办。作为2025年“你好BOE”首站活动,BOE(京东方)助力首届“横琴-澳门国际数字艺术博览会”,通过超高清显示技术及数字化解决方案为展会三大展区的10余个数字艺术展项提供高端显示技术解决方案,打造沉浸式科技艺术现场,生动传递“以创新科技赋能数字艺术”理念。历经四年迭代,“你好BOE”从最初展现BOE(京东方)自身领先技术、与合作伙伴构建联合生态,到如今更加关注创新技术与应用场景的深度融合,该品牌推广IP已升维至全新的3.0时代。活动现场,此次博览会的主办方南光(集团)有限公司副总经理宋晓冬,阳光媒体集团董事长杨澜,亚洲和平慈善基金会董事会主席李伟杰,参展艺术家代表中央美术学院设计学院艺术与科技方向教授、博士生导师、某集体ART+TECH创始人费俊,京东方科技集团副总裁、MLED业务CEO刘毅,艺云科技副总裁、华南区域总经理刘华等众多嘉宾领导出席“你好BOE”2025年启动仪式,开启BOE(京东方)品牌生态合作新篇章。

京东方科技集团副总裁、MLED业务CEO刘毅在启动仪式上表示,BOE(京东方)深耕横琴,正是因为这里涌动的创新基因与我们不谋而合。“你好BOE”作为BOE(京东方)的品牌IP,从2021年诞生至今,它像一座桥梁,一头是我们深耕的技术,一头是大众对美好生活的期待。我们希望用最直观的方式告诉大家:科技可以很温暖,可以成为连接想象与现实的纽带。

作为大湾区文化融合的标志性活动,“横琴-澳门国际数字艺术博览会”共设四大主题展区。BOE(京东方)作为该活动的战略合作伙伴,以ADS Pro显示技术、MLED显示技术,以及新一代无损Gamma显示专利技术等深度赋能“艺术未来式”“重施魔法”“科技重构艺术”三大展区,为观众带来一场沉浸式、强交互的数字艺术视觉盛宴,成为推动“科技+文化”深度融合的又一典范实践。

进入“艺术未来式”主题展区中,BOE(京东方)MLED显示技术赋能产品随处可见。BOE(京东方)Mini LED显示屏具有高亮低功耗,以及灰度表现更富层次等显示优势,将艺术家王之纲、梁蓝波等多款沉浸式装置作品细腻呈现。艺术家张文超的算法生成交互影像装置《一个传说故事的嬗变》则依托BOE(京东方)高端LCD显示技术解决方案ADS Pro的加持,在8个46英寸3.5mm超窄边拼接屏上,以1200:1超高对比度、178°超大可视角度,以及更均匀的亮度表现,呈现出传说故事在时间中经由无数人的想象而拼贴演绎的动态演变过程。同时,BOE(京东方)以P2.6 LED弧度屏赋能艺术家费俊的互动影像装置《情绪剧场》,在高曲度的LED屏幕上实时检测并呈现观众情绪,创造具有疗愈性的音画体验。此外,黑特·史德耶尔(德)、徐冰、田晓磊等国内外艺术家的数字艺术作品,也均由BOE(京东方)提供高端显示技术支持,多方位展现数字艺术创作领域的亮眼成果。

与此同时,基于BOE(京东方)与故宫博物院的战略合作,又恰逢故宫博物院建院100周年,BOE(京东方)携手故宫博物院打造了“在横琴,看见故宫”数字故宫体验展,BOE(京东方)旗下艺云科技通过多款沉浸式场景显示产品,将故宫景致与珍藏文物展现得活灵活现。在“数字多宝阁”“宫廷文化生活”等展区空间内,观众可通过BOE(京东方)类纸触控画屏,在屏幕上与故宫珍藏文物及交互场景进行触控互动,其运用了BOE(京东方)新一代无损Gamma显示专利技术(专利号:ZL 2016 1 0214546.6),通过高精细数据的细节扩大和360度自由改变的视点,为观众带来沉浸式交互体验。而在“千里江山图”空间,BOE(京东方)P1.5类纸LED不仅逼真地还原出40平方米超长画作中的山水世界,达到屏幕防眩光效果,还能够在相同亮度下节约40%能耗,做到节能环保。同时,BOE(京东方)以高亮度、高透光度的三面透明LED屏,沉浸式营造出“瑞象万千”空间的祥光瑞影,屏幕透光率可达到70%-90%,打造故宫动态叙事空间。除此之外,在“重施魔法”展区、“科技重构艺术”展区以及博览会展览通道等区域,也均能看到BOE(京东方)显示产品赋能的身影。

作为这次博览会的主办方代表,资深媒体人、阳光媒体集团董事长杨澜表示,“本届博览会构建起了一个‘可体验、可思考、可创造’的数字艺术生态系统。数字技术、AI技术的到来,展现了艺术创作的新的可能性,艺术表达的需求也激励了技术的迭代与快速发展。”

作为BOE(京东方)年度标杆性的品牌IP,“你好BOE”自2021年启动以来,已连续5年在北京、上海、深圳、成都、青岛、合肥、巴黎、珠海等国内外城市举办13站巡展活动,并先后与敦煌画院、OUTPUT、318国道、无畏契约、上海国际光影节等各领域顶级IP,以及联想、海信、雷神、ROG等十余家合作伙伴进行跨界合作,线下累计触达近450万消费者。而今年全面焕新升级的“你好BOE”持续关注与合作伙伴的生态共创与场景融合,将携手阳光媒体集团、极氪、OPPO、京东、微博、318等打造品牌生态合作性IP,以跨界联合开启BOE(京东方)品牌全新旅程。面向未来,BOE(京东方)将继续秉承“屏之物联”发展战略,携手各界合作伙伴共建“Powered by BOE”创新生态,以显示技术为纽带,融合物联网及数字技术,让艺术与科技在山顶重逢。

关于BOE(京东方):

京东方科技集团股份有限公司(BOE)是全球领先的物联网创新企业,为信息交互和人类健康提供智慧端口产品和专业服务。作为全球半导体显示产业的龙头企业,BOE(京东方)带领中国显示产业破局“少屏”困境,实现了从0到1的跨越。如今,全球每四个智能终端就有一块显示屏来自BOE(京东方)。在“屏之物联”战略引领下,BOE(京东方)凭借“1+4+N+生态链”业务架构,将超高清液晶显示、柔性显示、MLED、微显示等领先技术广泛应用于交通、金融、艺术、零售、教育、办公、医疗等多元场景,赋能千行百业。目前,BOE(京东方)的子公司遍布全球近20个国家和地区,拥有超过5000家全球生态合作伙伴。更多详情可访问BOE(京东方)官网:https://www.boe.com.cn

被问tsconfig.json 和 tsconfig.node.json 有什么作用,我懵了……

背景

事情是这样的,前几天在项目例会上,领导随口问了我我一个看似简单的问题:

“我们项目里有tsconfig.json 和 tsconfig.node.json ,它们有什么作用?”

活久见,我从来没注意过这个细节,我内心无语,问这种问题对项目有什么用!但机智的我还是回答上来了:不都是typescript的配置文件么。

领导肯定了我的回答,又继续问,那为什么项目中有两个配置文件呢?我机智的说,我理解的不深,领导您讲讲吧,我学习一下。

tsconfig.json 是干嘛的?

说白了,tsconfig.json 就是 告诉 TypeScript:我要用哪些规则来“看懂”和“检查”我写的代码。

你可以把它想象成 TypeScript 的“眼镜”,没有它,TS 编译器就会“看不清楚”你的项目到底该怎么理解、怎么校验。

- 影响代码能不能被正确编译

如果我们用了某些新语法(比如 optional chaining、import type),却没有在 tsconfig 里声明 "target": "ESNext",那 TypeScript 就会报错:看不懂!

- 影响编辑器的智能提示

如果我们用了路径别名 @/utils/index.ts,但没有配置:

{

"compilerOptions": {

"baseUrl": ".",

"paths": {

"@/*": ["src/*"]

}

}

}

那 VS Code 就会一直红线报错:“找不到模块”。

- 影响类型检查的严格程度

比如 "strict": true 会让我们代码写得更规范,少写 any,避免“空值未处理”这类隐患;而关闭了就“宽松模式”,你可能一不小心就放过了 bug。

- 影响团队代码规范一致性

当多个成员一起开发时,统一 tsconfig.json 能让大家都用一样的校验标准,避免“我这边没问题你那边报错”的尴尬。

tsconfig.json文件的一个典型配置如下:

{

"compilerOptions": {

// ECMAScript 的目标版本(决定生成的代码是 ES5 还是 ES6 等)

"target": "ESNext",

// 模块系统,这里用 ESNext 是为了支持 Vite 的现代打包机制

"module": "ESNext",

// 模块解析策略,Node 方式支持从 node_modules 中解析模块

"moduleResolution": "Node",

// 启用源映射,便于调试(ts -> js 映射)

"sourceMap": true,

// 启用 JSX 支持(如用于 Vue 的 TSX/JSX 语法)

"jsx": "preserve",

// 编译结果是否使用 ES 模块的导出语法(import/export)

"esModuleInterop": true,

// 允许默认导入非 ESModule 模块(兼容 CommonJS)

"allowSyntheticDefaultImports": true,

// 生成声明文件(一般用于库开发,可选)

"declaration": false,

// 设置项目根路径,配合 paths 使用

"baseUrl": ".",

// 路径别名配置,@ 代表 src 目录,方便引入模块

"paths": {

"@/*": ["src/*"]

},

// 开启严格模式(类型检查更严格,建议开启)

"strict": true,

// 不检查未使用的局部变量

"noUnusedLocals": true,

// 不检查未使用的函数参数

"noUnusedParameters": true,

// 禁止隐式的 any 类型(没有类型声明时报错)

"noImplicitAny": true,

// 禁止将 this 用在不合法的位置

"noImplicitThis": true,

// 允许在 JS 文件中使用 TypeScript(一般不建议)

"allowJs": false,

// 允许编译 JS 文件(如需使用 legacy 代码可开启)

"checkJs": false,

// 指定输出目录(Vite 会忽略它,一般不用)

"outDir": "./dist",

// 开启增量编译(提升大型项目编译效率)

"incremental": true,

// 类型定义自动引入的库(默认会包含 dom、esnext 等)

"lib": ["ESNext", "DOM"]

},

// 指定编译包含的文件(推荐指定为 src)

"include": ["src/**/*"],

// 排除 node_modules 和构建输出目录

"exclude": ["node_modules", "dist"]

}

Vite 项目中,一般 tsconfig.json 会被自动加载,所以只需要按需修改上述配置即可。

tsconfig.node.json 又是干嘛的?

tsconfig.node.json 并不是 TypeScript 官方强制的命名,而是一种 社区约定俗成 的分离配置方式。它用于配置运行在 Node.js 环境下的 TypeScript 代码,例如:

vite.config.ts(构建配置)scripts/*.ts(一些本地开发脚本)server/*.ts(如果你有 Node 后端)

tsconfig.node.json的一大作用就是针对业务代码和项目中的node代码做区分,划分职责。

如果不写tsconfig.node.json,会出现以下问题:

比如你写了一个脚本:scripts/generate-sitemap.ts,其中用到了 fs、path、url 等 Node 原生模块,但主 tsconfig.json 是为浏览器服务的:

- 设置了

"module": "ESNext",TypeScript 编译器可能不会生成符合 Node 环境要求的代码。 - 缺少

moduleResolution: "node"会导致路径解析失败。

常见配置内容:

{

"compilerOptions": {

// 使用最新的 ECMAScript 特性

"target": "ESNext",

// 使用 CommonJS 模块系统,兼容 Node.js(也可根据项目设置为 ESNext)

"module": "CommonJS",

// 模块解析方式设置为 Node(支持 node_modules 和路径别名)

"moduleResolution": "Node",

// 启用严格模式,增加类型安全

"strict": true,

// 允许默认导入非 ESModule 的模块(如 import fs from 'fs')

"esModuleInterop": true,

// 支持 import type 等语法

"allowSyntheticDefaultImports": true,

// 添加 Node.js 类型定义

"types": ["node"],

// 源码映射(可选)

"sourceMap": true,

// 启用增量编译(加快重编译速度)

"incremental": true

},

// 指定哪些文件纳入编译,通常包含 Node 环境下的脚本或配置文件

"include": [

"vite.config.ts",

"scripts/**/*",

"build/**/*"

],

// 排除构建产物和依赖

"exclude": [

"node_modules",

"dist"

]

}

两者区别

| 对比点 | tsconfig.json | tsconfig.node.json |

|---|---|---|

| 目标环境 | 浏览器(前端代码) | Node.js(构建脚本、配置文件) |

| 类型声明支持 | 浏览器相关,通常不包含 node类型 | 显式包含 node类型 |

| 使用场景 | 项目源码、页面组件、前端逻辑 | vite.config.ts、开发工具脚本、构建相关逻辑 |

| 典型依赖项 | Vue 类型(如 vue, @vue/runtime-dom) | Node 类型(如 fs, path) |

| 是否必须存在 | 是,TypeScript 项目基本都要有 | 否,但推荐拆分使用以清晰职责 |

| 是否引用主配置 | 通常是主配置 | 可通过 tsconfig.json的 references引用它 |

来源:juejin.cn/post/7500130421608579112

京东鸿蒙上线前瞻——使用 Taro 打造高性能原生应用

背景

2024 年 1 月,京东正式启动鸿蒙原生应用开发,基于 HarmonyOS NEXT 的全场景、原生智能、原生安全等优势特性,为消费者打造更流畅、更智能、更安全的购物体验。同年 6 月,京东鸿蒙原生应用尝鲜版上架华为应用市场,计划 9 月完成正式版的上架。

早在 2020 年,京东与华为就签署了战略合作协议,不断加大技术投入探索 HarmonyOS 的创新特性。作为华为鸿蒙生态的首批头部合作伙伴,在适配鸿蒙操作系统的过程中,京东与华为一直保持着密切的技术沟通与共创,双方共同攻坚行业适配难点,并推动多端统一开发解决方案 Taro 在业界率先实现对鸿蒙 ArkUI 的原生开发支持。

本文将阐述京东鸿蒙原生应用在开发时所采用的技术方案、技术特点、性能表现以及未来的优化计划。通过介绍选择 Taro 作为京东鸿蒙原生应用的开发框架的原因,分析 Taro 在支持 Web 范式开发、快速迁移存量项目、渲染性能优化、高阶功能支持以及混合开发模式等方面的优势。

技术方案

京东在开发鸿蒙原生应用的过程中,需要考虑如何在有限的时间内高效完成项目,同时兼顾应用的性能与用户体验。为了达成这一目标,选择合适的技术方案至关重要。

在技术选型方面,开发一个鸿蒙原生应用,一般会有两种选择:

- 使用原生 ArkTS 进行鸿蒙开发

- 使用跨端框架进行鸿蒙开发

使用原生 ArkTS 进行鸿蒙开发,面临着开发周期冗长、维护多端多套应用代码成本高昂的挑战。在交付时间紧、任务重的情况下,京东果断选择跨端框架来开发鸿蒙原生应用,以期在有限的时间内高效完成项目。

作为在业界具备代表性的开源跨端框架之一,Taro 是由京东凹凸实验室团队开发的一款开放式跨端跨框架解决方案,它支持开发者使用一套代码,实现在 H5、小程序以及鸿蒙等多个平台上的运行。

通过 Taro 提供的编译能力,开发者可以将整个 Taro 项目轻松地转换为一个独立的鸿蒙应用,无需额外的开发工作。

另外,Taro 也支持将项目里的部分页面以模块化的形式打包进原生的鸿蒙应用中,京东鸿蒙原生应用便是使用这种模式进行开发的。

京东鸿蒙原生应用的基础基建能力如路由、定位、权限等能力由京东零售 mpass 团队来提供,而原生页面的渲染以及与基建能力的桥接则由 Taro 来负责,业务方只需要将写好的 Taro 项目通过执行相应的命令,就可以将项目以模块的形式一键打包到鸿蒙应用中,最终在应用内渲染出对应的原生页面,整个过程简单高效。

技术特点

Taro 作为一款开放式跨端跨框架解决方案,在支持开发者一套代码多端运行的同时,也为开发鸿蒙原生应用提供了诸多便利。在权衡多方因素后,我们最终选择了 Taro 作为开发鸿蒙原生应用的技术方案,总的来说,使用 Taro 来开发鸿蒙原生应用会有下面几点优势:

支持开发者使用 Web 范式来开发鸿蒙原生应用

与鸿蒙原生开发相比,使用 Taro 进行开发的最大优点在于 Taro 支持开发者使用前端 Web 范式来开发鸿蒙原生应用,基于这一特点,我们对大部分 CSS 能力进行了适配:

- 支持常见的 CSS 样式和布局,支持 flex、伪类和伪元素

- 支持常见的 CSS 定位,绝对定位、fixed 定位

- 支持常见的 CSS 选择器和媒体查询

- 支持常见的 CSS 单位,比如 vh、vw 以及计算属性 calc

- 支持 CSS 变量以及安全区域等预定义变量

在编译流程上,我们采用了 Rust 编写的 LightningCSS,极大地提升了 CSS 文件的编译和解析速度。

(图片来自 LightningCSS 官网)