摆动序列

摆动序列

一、问题描述

LeetCode:376. 摆动序列

如果连续数字之间的差严格地在正数和负数之间交替,则数字序列称为摆动序列。第一个差(如果存在的话)可能是正数或负数。仅有一个元素或者含两个不等元素的序列也视作摆动序列。

例如,[1, 7, 4, 9, 2, 5] 是一个摆动序列,因为差值 (6, -3, 5, -7, 3) 是正负交替出现的。

相反,[1, 4, 7, 2, 5] 和 [1, 7, 4, 5, 5] 不是摆动序列,第一个序列是因为它的前两个差值都是正数,第二个序列是因为它的最后一个差值为零。

给定一个整数数组 nums,返回 nums 中作为摆动序列的最长子序列的长度。

二、解题思路

摆动序列的关键在于寻找数组中的峰和谷。每当序列发生方向变化时,摆动序列的长度就会增加。因此,可以通过遍历数组,统计方向变化的次数来得到最长摆动序列的长度。

- 记录初始趋势:计算数组前两个元素的差值作为最开始的变化趋势preTrend = nums[1] - nums[0],若差值不为 0,说明前两个元素构成了摆动序列的初始趋势,此时摆动序列长度初始化为 2;若差值为 0,意味着前两个元素相等,不构成摆动趋势,摆动序列长度初始化为 1。

- 遍历数组寻找变化趋势:记录当前变化趋势curTrend = nums[i] - nums[i - 1],若当前变化趋势curTrend 与之前的变化趋势preTrend 不同,preTrend <= 0 && curTrend > 0 或者 preTrend >= 0 && curTrend < 0 时 更新变化趋势preTrend ,摆动序列加1

三、代码实现

以下是使用 JavaScript 实现的代码:

var wiggleMaxLength = function (nums) {

// 统计波峰波谷的数量

// 若长度为1 或为 0

if (nums.length < 2) return nums.length;

let preTrend = nums[1] - nums[0];

let reLen = preTrend !== 0 ? 2 : 1;

for (let i = 2; i < nums.length; i++) {

let curTrend = nums[i] - nums[i - 1];

// 当出现波谷或者波峰时,更新preTrend

if ((preTrend <= 0 && curTrend > 0) || (preTrend >= 0 && curTrend < 0)) {

preTrend = curTrend;

reLen++;

}

}

return reLen;

};

四、注意事项

- 边界条件需谨慎:在处理数组前两个元素确定初始趋势时,要特别注意数组长度为 2 的情况。若两个元素相等,初始化摆动序列长度为 1,此时不能因为后续没有更多元素判断趋势变化,就错误认为长度还能增加。在遍历过程中,若遇到数组结尾,也应保证最后一次趋势变化能正确统计,避免遗漏。

- 趋势判断避免误判:在比较差值判断趋势变化时,条件 (preTrend <= 0 && curTrend > 0) 与 (preTrend >= 0 && curTrend < 0) 中的 “小于等于” 和 “大于等于” 不能随意替换为 “小于” 和 “大于”。例如,当出现连续相等元素后趋势改变的情况,若使用严格的 “小于” 和 “大于” 判断,可能会错过第一个有效趋势变化点,导致结果错误。

五、复杂度分析

- 时间复杂度:O(n),其中 n 是数组的长度。只需要遍历一次数组。

- 空间复杂度:O(1),只需要常数级的额外空间。

来源:juejin.cn/post/7518198430662492223

绿盟科技重磅发布AI安全运营新成果,全面驱动智能攻防体系升级

8月29日,绿盟科技在北京成功举办以“智御新境·安全无界”为主题的AI赋能安全运营线上成果发布会,全面展示了公司在AI安全领域的最新技术成果与实践经验。

会议总结了“风云卫”AI安全能力平台上半年在客户侧的实际运营成效,介绍了AISOC平台的新特性与能力,进一步验证了“AI+安全运营”在降噪、研判、处置闭环以及未知威胁检测等核心场景中的规模化应用价值。

此外,还正式发布了“绿盟AI智能化渗透系统”,该系统依托AI技术全面赋能渗透测试全流程,可广泛应用于常态化扫描和日常安全运维等场景,有效帮助客户降本增效,显著降低渗透测试的专业门槛。

双底座多智能体架构,构建三位一体AI安全生态

2020年至2022年,绿盟科技连续发布三部AI安全白皮书《安全AI赋能安全运营白皮书》、《知识图谱白皮书》和《AI安全分析白皮书》,并于2023年推出“风云卫”安全大模型,深度融合AI与攻防知识。2025年,公司再度升级,构建“风云卫+DeepSeek”双底座与多智能体架构,打造AI驱动的安全生态,覆盖模型生产、场景适配与应用复制三大层面,全面提升安全检测、运营、数据安全及蓝军对抗能力,实现全域智能赋能。

安全运营实现“智防”质变,绿盟“风云卫”AI实战成效显著

绿盟科技产品BG总经理吴天昊

绿盟科技产品BG总经理吴天昊表示,安全运营人员每天面临几万到几十万不等的原始攻击告警,绿盟“风云卫”AI安全能力平台依托千亿级安全样本训练的大模型,能够自动识别系统日志中的无效告警与重复信息,达到百级左右的高价值告警的优先推荐。

针对不同攻击事件,可自动展开研判分析,精准解析攻击路径和手法,并通过可视化分析界面清晰呈现完整攻击链条。通过自主调查,智能开展横向溯源,自动关联跨端、跨网、跨身份数据,构建出完整的攻击图谱;同时进行并案分析,深度挖掘同类攻击线索,精准定位攻击组织;最后通过SOAR剧本自动生成与执行,实现分钟级事件闭环,并为未来同类事件建立自动化处置范式。

实际应用数据显示,绿盟科技的AI降噪率平均达到95%以上,AI综合辅助研判准确率超过90%。在处置响应方面,依托自主响应可实现超过40%的安全事件端到端的自动化响应处置。特别值得关注的是,经过实际观测和验证,针对13大类77小类的攻击类型,绿盟风云卫AI辅助识别准确率超过95%。

会上,绿盟科技全流程演示了AI赋能安全运营的过程,生动体现了AI技术在安全运营各环节的深度融合——从海量告警的智能降噪、攻击链路的自动重构,到复杂事件的自主研判和自动化响应,真正实现了安全运营从"人防"到"智防"的质变升级。

AI赋能安全检测:混淆检测+自主基线,让未知威胁检测变成可能

在攻防演练中,统计数据显示有76%的攻击属于“已知家族、未知变种”类型,这类攻击因具备一定家族特征又存在变异特性,给检测工作带来不小挑战。

绿盟“风云卫”AI安全能力平台在此类场景中展现出显著优势:在混淆检测方面,AI凭借强大的语义理解能力,能够深入剖析恶意程序的本质特征。即便攻击手段经过混淆处理,改变了表面形态,AI也能透过现象看本质,精准识别出其属于已知家族的核心属性,从而有效识破“未知变种”的伪装。

在自主基线构建上,AI能够自主解读并理解全量日志,从中提炼出账号、流量、进程等各类实体在正常时段的行为画像。基于这些画像,AI可以秒级输出动态阈值,形成精准的正常行为基线。当“已知家族、未知变种”的攻击出现,导致相关实体行为偏离动态阈值时,系统能快速察觉异常,为及时发现和应对威胁提供有力支撑。

智能体中心成效显著,20多个安全领域智能体协同赋能

绿盟“风云卫”AI安全能力平台汇聚绿盟安全专家经验,内置20+安全领域智能体,覆盖网络安全多个关键环节,包含钓鱼邮件检测、可疑样本分析、敏感数据识别、零配置日志解析、情报分析、报告生成等多个智能体。这些智能体既可以赋能产品,也可以独立运行。值得一提的是,智能体中心支持智能体可视化编排,这一特性为用户带来了极大便利。即便是非专业的技术人员,也能通过简单的拖拽、连线操作,如同搭建积木一般,将多个智能体按照企业自身的业务逻辑与安全需求,灵活组合成个性化的安全工作流程。

例如,用户可通过可视化方式自定义编排敏感信息检测智能体,将企业特定的敏感信息嵌入其中,从而实现更精准的自定义检测。这种低代码的编排方式不仅大幅降低了使用门槛,还能灵活应对企业不断变化的安全需求,实现安全防护的定制化与敏捷化,全面提升网络安全工作的效能。

多行业落地实践,安全运营效率大幅提升

绿盟科技鹰眼安全运营中心技术经理李昀磊

截至目前,绿盟科技已助力电信、金融、政府、高校等行业的多家客户实现安全运营智能化转型。在近期多项攻防演练中,公司依托“风云卫”AI安全能力平台,为客户提供全面支撑,多项智能体——包括未知威胁检测、行为分析、钓鱼邮件识别等——均发挥关键作用。

绿盟科技鹰眼安全运营中心技术经理李昀磊介绍,绿盟安全运营中心已持续为超2000家企业提供安全运营服务,并于2023年起全面融合“风云卫”大模型,AI赋能成效主要体现在三方面:

●高频场景AI全自动处置:对实时性要求极高的常见攻击,实现从检测、研判、通知到响应的全自动闭环,无需人工干预;

●复杂事件智能辅助调查:针对约占20%+的复杂事件,AI可自主拓展调查路径,完成情报搜集与初步总结,提升分析师决策效率;

●工具调度与客户交互自动化:AI统一调度多类分析工具,并自动完成工单发送、报告生成与客户反馈响应,显著节约人力。

截至目前,绿盟云端安全运营中心约77%的告警日志依托AI实现辅助研判与处置,在客户预授权条件下5分钟内发现确认并处置闭环事件,运营效率大幅提升。

绿盟AI智能化渗透系统发布

绿盟科技产品总监许伟强

绿盟科技产品总监许伟强表示,公司基于多年攻防实战经验与大模型技术,正式推出新一代绿盟AI智能化渗透系统。该系统全面覆盖常态化扫描与日常安全运维等多种场景,在国内首次实现AI智能体在真实网络环境中完成端到端渗透测试,显著提升渗透效率与响应能力。该系统具备四大核心能力:

●智能任务规划:通过多智能体分层协作,结合专业攻防知识库,实现对复杂渗透场景的智能化任务分解;

●智能工具调度:依托工具调度智能体,无缝调用并协同多种渗透工具,破除工具间壁垒,增强协同作战效能;

●渗透路径推荐:基于安全大模型技术,融合知识图谱与漏洞利用知识,提供渗透路径规划、过程可视化及标准化报告输出;

●AI智能对话:支持自然语言交互,可依据用户指令智能推荐并自动执行渗透工具,大幅降低操作门槛。

绿盟AI智能化渗透系统基于“风云卫”平台构建,采用“人在环路”安全机制与多智能体协同架构,具备“直接模式+深度模式”双轨机制,可快速响应常规攻击面,也可深入攻坚复杂高对抗场景,动态适应多样化的实战攻防需求。

随着国务院常务会议审议通过《关于深入实施“人工智能+”行动的意见》,“人工智能+”正成为产业升级的关键方向,各领域在快速发展的同时,安全问题将不容忽视。绿盟科技始终站在技术前沿,目前形成了以风云卫AI安全能力平台为核心,构建“模型生产、场景适配、应用赋智”的“三位一体”AI安全生态体系,可为不同用户提供全方位的智能安全保障。面向未来,绿盟科技将继续以创新为引擎,携手客户与合作伙伴,共同迎接智能安全新时代。

本地Docker部署Transmission,内网穿透无限远程访问教程

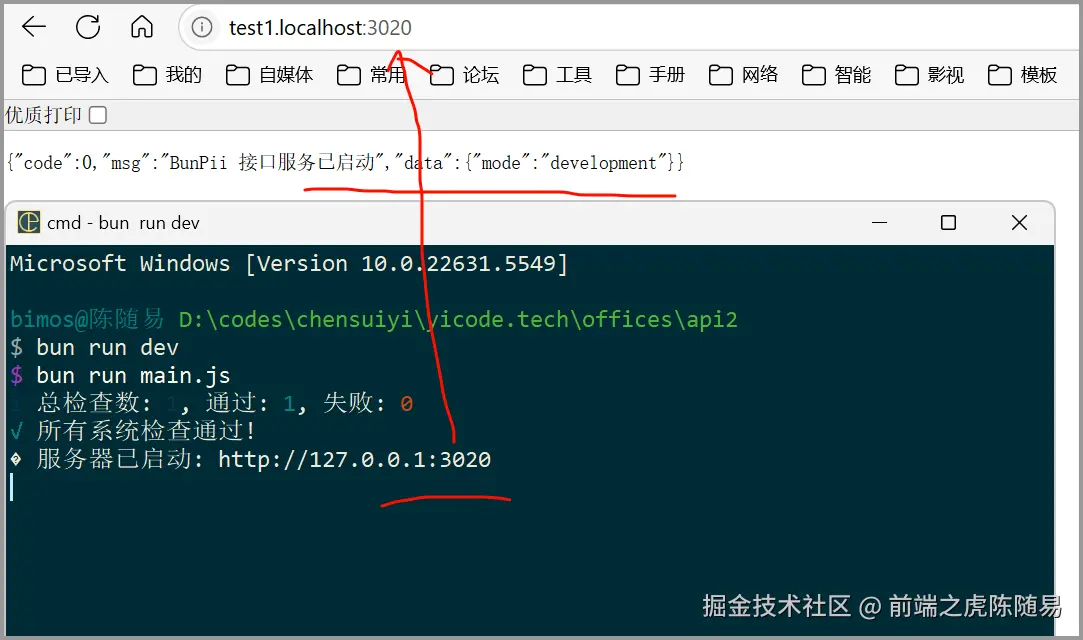

Transmission是一款开源、轻量且资源占用极低的BitTorrent客户端。借助Docker,可以在几分钟内把它跑起来;再借助贝锐花生壳的内网穿透功能,又能随时随地从外网安全访问。下面给出一条龙的部署与远程访问流程,全部命令可直接复制粘贴。

一、准备Docker环境

1. 一键安装最新版Docker(已包含阿里云镜像加速):

2. 启动并设为开机自启:

二、拉取Transmission镜像

如果拉取超时,可在 `/etc/docker/daemon.json` 中追加国内镜像源,例如:

三、运行Transmission容器

下面命令把Web端口9091、BT 监听端口41234(TCP/UDP)都映射出来,并把配置、下载目录、监控目录挂到宿主机持久化。按需替换UID/GID、时区、用户名密码以及宿主机路径。

启动后,浏览器访问 http://局域网IP:9091即可看到Transmission Web UI。

点击左上角图标即可上传种子或粘贴磁力链接开始下载。

四、安装并配置贝锐花生壳

1. 下载客户端

在同一内网任意设备上,从花生壳官网下载最新Linux版客户端,可根据实际情况,选择docker安装花生壳。(`phddns_5.x.x_amd64.deb`)。

2. 安装

根据不同位数的系统输入下面的命令进行安装,安装完成会自动生成SN码与登录密码。

3. 激活与登录

浏览器打开 [花生壳管理平台](http://b.oray.com),用SN和默认密码登录。

首次登录需激活设备,支持微信扫码或绑定贝锐账号。

4. 添加映射

激活成功后,进入「内网穿透」→「添加映射」,填写新增的映射信息。

保存后,贝锐花生壳会生成一个 `http://xxxx.hsk.oray.com:端口` 的外网地址。可访问外网地址访问transmission。

五、外网访问与日常使用

任何地点打开浏览器,输入花生壳提供的外网地址,即可远程管理Transmission:添加种子、查看进度、做种、限速等操作与局域网完全一致。

至此,借助贝锐花生壳内网穿透就可以使本地Docker版Transmission已可安全、便捷地实现远程访问。

收起阅读 »一文说透WebSocket协议(秒懂)

本文首发于公众号:托尼学长,立个写 1024 篇原创技术面试文章的flag,欢迎过来视察监督~

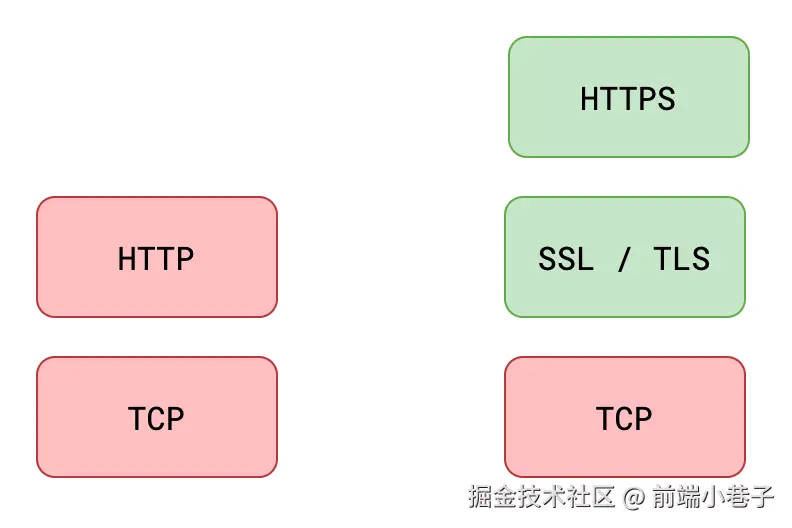

为避免同学们概念混淆,先声明一下,其实WebSocket和Socket之间是毫无关系的,就像北大青鸟和北大一样,大家不要被名字给带偏了。

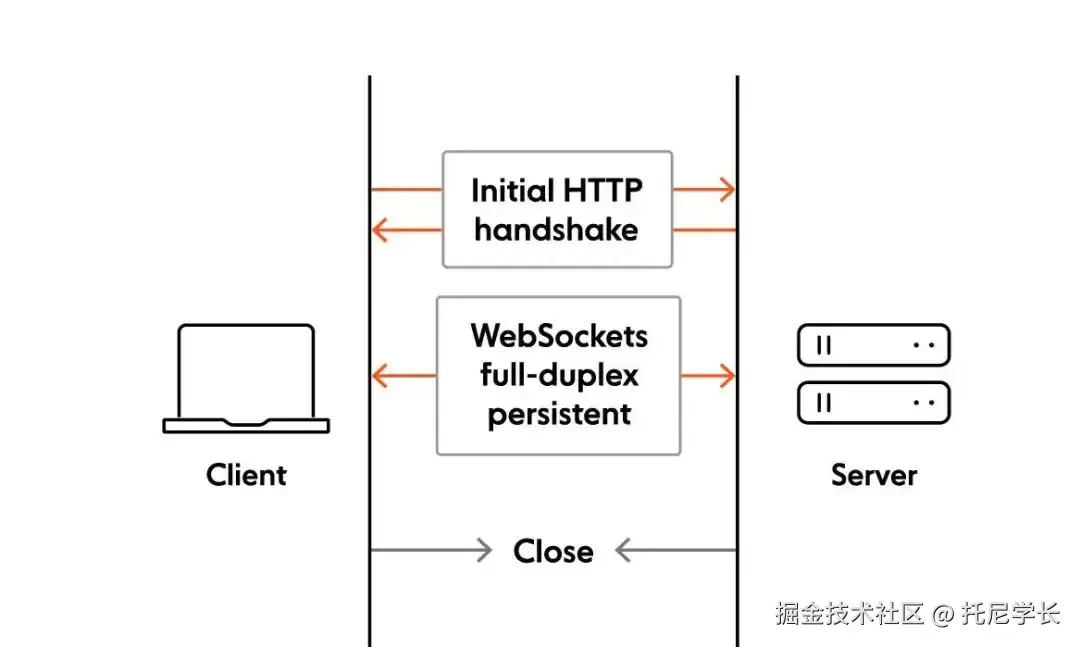

WebSocket是一种建立在TCP底层连接上,使web客户端和服务器端可进行持续全双工通信的协议。

用大白话来说,WebSocket协议最大的特点是支持服务器端给客户端发送消息。

只需先通过HTTP协议进行握手并进行协议升级,即可让服务器端和客户端一直保持连接并实现通信,直到连接关闭。

如下图所示:

一定会有同学存在疑问,WebSocket协议所具备的“支持服务器端给客户端发送消息”的特点,具体适用场景是什么呢?

下面我们就来详细地讲解一下。

适用场景

对于这个问题,我们有必须逆向思考一下,WebSocket协议所适用的场景,必然是其他协议不适用的场景,这个协议就是HTTP。

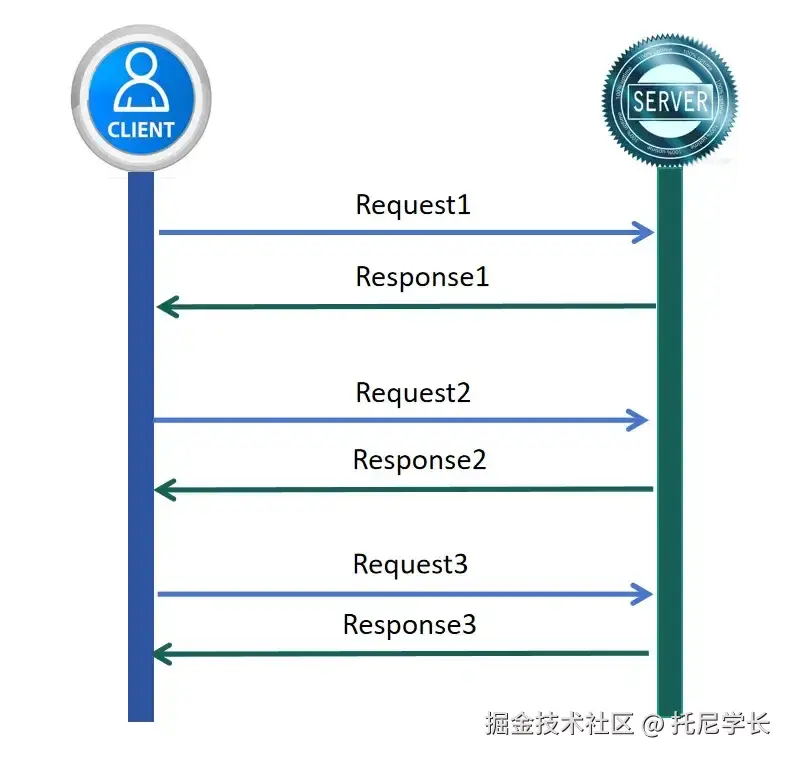

由于HTTP协议是半双工模式,只能由客户端发起请求并由服务器端进行响应。

所以在线聊天、实时互动游戏、股票行情、物联网设备监控等业务场景下,只能通过客户端以轮询、长轮询的方式去服务器端获取最新数据。

股票行情场景,如下图所示:

这种方式所带来的问题有两点:

1、客户端频繁发送HTTP请求会带来网络开销,也会给服务器端带来负载压力;2、轮询间隔难以把控,间隔过短同样会带来问题(1)中提到的点,间隔过长会导致数据延迟。

而WebSocket协议只有在服务器端有事件发生的时候,才会第一时间给客户端发送消息,彻底杜绝了HTTP轮询所带来的网络开销、服务器负载和数据时延问题。

实现步骤

阶段一、客户端通过 HTTP 协议发送包含特殊头部的请求,触发协议升级:

GET /chat HTTP/1.1

Host: server.example.com

Upgrade: websocket

Connection: Upgrade

Sec-WebSocket-Key: dGhlIHNhbXBsZSBub25jZQ==

Sec-WebSocket-Version: 13

- Upgrade: websocket明确请求升级协议。

- Sec-WebSocket-Key:客户端生成的随机字符串,用于安全验证。

- Sec-WebSocket-Version:指定协议版本(RFC 6455 规定为 13)。

阶段二、服务器端进行响应确认,返回 101 Switching Protocols 响应:

HTTP/1.1 101 Switching Protocols

Upgrade: websocket

Connection: Upgrade

Sec-WebSocket-Accept: s3pPLMBiTxaQ9kYGzzhZRbK+xOo=

- Sec-WebSocket-Accept:服务器将客户端的 Sec-WebSocket-Key 与固定字符串拼接后,计算 SHA-1 哈希并进行 Base64 编码,生成验证令牌。

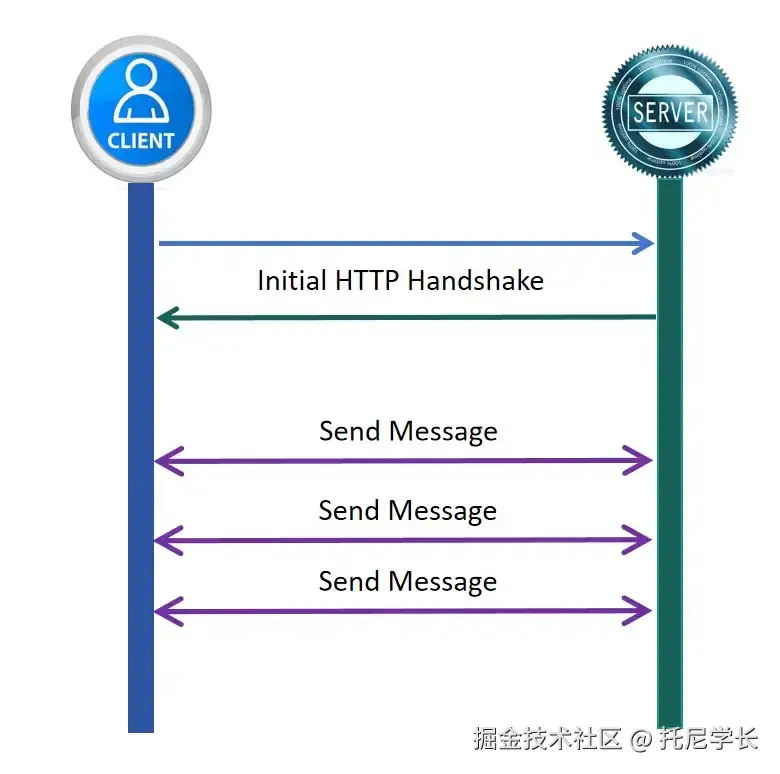

阶段三、此时 TCP 连接从 HTTP 升级为 WebSocket 协议,后续数据可通过二进制帧进行传输。

阶段四、数据传输,WebSocket是一种全双工通信协议,客户端与服务端可同时发送/接收数据,无需等待对方请求,数据帧是以二进制格式进行传输的。

如下图所示:

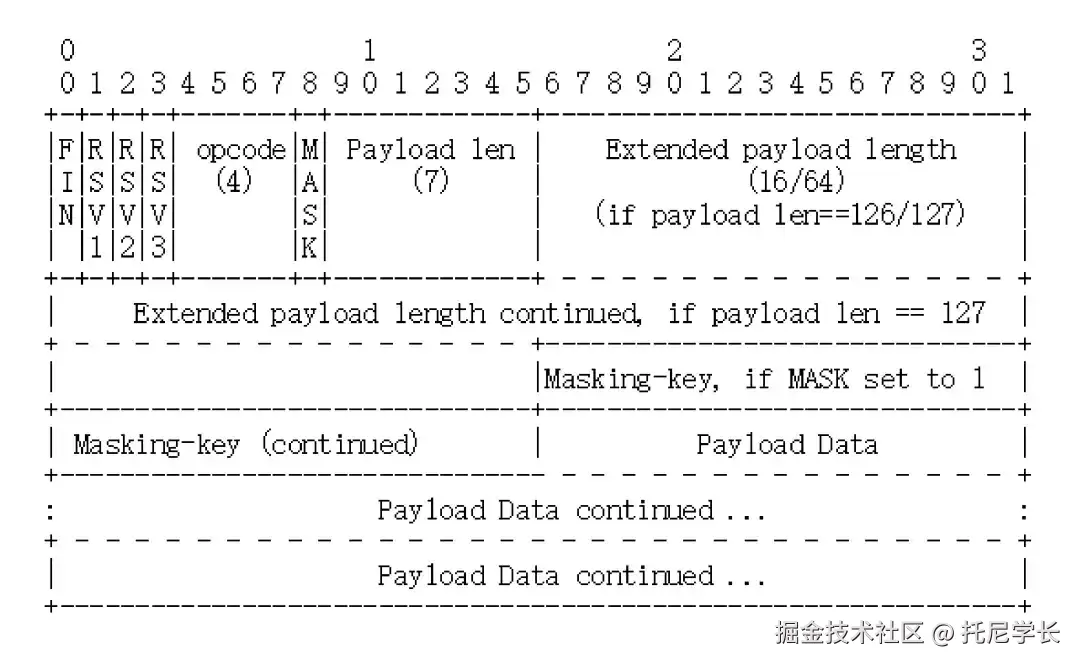

- FIN (1 bit):标记是否为消息的最后一个分片。

- Opcode (4 bits):定义数据类型(如文本 0x1、二进制 0x2、关闭连接 0x8、Ping 0x9、Pong 0xA)。

- Mask (1 bit):客户端发送的数据需掩码处理(防止缓存污染攻击),服务端发送的数据无需掩码。

- Payload Length (7 or 7+16 or 7+64 bits):帧内容的长度,支持最大 2^64-1 字节。

- Masking-key(32 bits),掩码密钥,由上面的标志位 MASK 决定的,如果使用掩码就是 4 个字节的随机数,否则就不存在。

- payload data 字段:这里存放的就是真正要传输的数据

阶段五、连接关闭,客户端或服务器端都可以发起关闭。

示例代码

前端代码:

<!DOCTYPE html>

<html>

<body>

<input type="text" id="messageInput" placeholder="输入消息">

<button onclick="sendMessage()">发送</button>

<div id="messages"></div>

<script>

// 创建 WebSocket 连接

const socket = new WebSocket('ws://localhost:8080/ws');

// 连接打开时触发

socket.addEventListener('open', () => {

logMessage('连接已建立');

});

// 接收消息时触发

socket.addEventListener('message', (event) => {

logMessage('收到消息: ' + event.data);

});

// 连接关闭时触发

socket.addEventListener('close', () => {

logMessage('连接已关闭');

});

// 错误处理

socket.addEventListener('error', (error) => {

logMessage('连接错误: ' + error.message);

});

// 发送消息

function sendMessage() {

const message = document.getElementById('messageInput').value;

socket.send(message);

logMessage('发送消息: ' + message);

}

// 日志输出

function logMessage(message) {

const messagesDiv = document.getElementById('messages');

const p = document.createElement('p');

p.textContent = message;

messagesDiv.appendChild(p);

}

</script>

</body>

</html>

我们通过 Spring WebSocket 来实现服务器端代码。

1、添加 Maven 依赖:

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-websocket</artifactId>

<version>2.7.14</version>

</dependency>

2、配置类启用 WebSocket:

import org.springframework.context.annotation.Configuration;

import org.springframework.web.socket.config.annotation.EnableWebSocket;

import org.springframework.web.socket.config.annotation.WebSocketConfigurer;

import org.springframework.web.socket.config.annotation.WebSocketHandlerRegistry;

@Configuration

@EnableWebSocket

public class WebSocketConfig implements WebSocketConfigurer {

@Override

public void registerWebSocketHandlers(WebSocketHandlerRegistry registry) {

registry.addHandler(new MyWebSocketHandler(), "/ws")

.setAllowedOrigins("*");

}

}

3、消息处理器实现:

import org.springframework.web.socket.TextMessage;

import org.springframework.web.socket.WebSocketSession;

import org.springframework.web.socket.handler.TextWebSocketHandler;

import java.util.Collections;

import java.util.HashSet;

import java.util.Set;

public class MyWebSocketHandler extends TextWebSocketHandler {

private static final Set<WebSocketSession> sessions =

Collections.synchronizedSet(new HashSet<>());

@Override

public void afterConnectionEstablished(WebSocketSession session) {

sessions.add(session);

log("新连接: " + session.getId());

}

@Override

protected void handleTextMessage(WebSocketSession session, TextMessage message) {

String payload = message.getPayload();

log("收到消息: " + payload);

// 广播消息

sessions.forEach(s -> {

if (s.isOpen() && !s.equals(session)) {

try {

s.sendMessage(new TextMessage("广播: " + payload));

} catch (Exception e) {

log("发送消息失败: " + e.getMessage());

}

}

});

}

@Override

public void afterConnectionClosed(WebSocketSession session, CloseStatus status) {

sessions.remove(session);

log("连接关闭: " + session.getId());

}

private void log(String message) {

System.out.println("[MyWebSocketHandler] " + message);

}

}

结语

在本文中,我们先是对WebSocket协议的概念进行了讲解,也对其适用场景、实现步骤进行描述,最后给出了实例代码,旨在帮助大家一站式熟悉WebSocket协议。

来源:juejin.cn/post/7503811248288661558

交替打印最容易理解的实现——同步队列

前言

原创不易,禁止转载!

本文旨在实现最简形式的交替打印。理解了同步队列,你可以轻松解决60%以上的多线程面试题。同步队列作为JUC提供的并发原语之一,使用了无锁算法,性能更好,但是却常常被忽略。

交替打印是一类常见的面试题,也是很多人第一次学习并发编程面对的问题,如:

- 三个线程T1、T2、T3轮流打印ABC,打印n次,如ABCABCABCABC.......

- 两个线程交替打印1-100的奇偶数

- N个线程循环打印1-100

很多文章(如: zhuanlan.zhihu.com/p/370130458 )总结了实现交替打印的多种做法:

- synchronized + wait/notify: 使用synchronized关键字和wait/notify方法来实现线程间的通信和同步。

- join() : 利用线程的join()方法来确保线程按顺序执行。

- Lock: 使用ReentrantLock来实现线程同步,通过锁的机制来控制线程的执行顺序。

- Lock + Condition: 在Lock的基础上,使用Condition对象来实现更精确的线程唤醒,避免不必要的线程竞争。

- Semaphore: 使用信号量来控制线程的执行顺序,通过acquire()和release()方法来管理线程的访问。

- 此外还有LockSupport、CountDownLatch、AtomicInteger 等实现方式。

笔者认为,在面试时能够选择一种无bug实现即可。

缺点

这些实现使用的都是原语,也就是并发编程中的基本组件,偏向于底层,同时要求开发者深入理解这些原语的工作原理,掌握很多技巧。

问题在于:如果真正的实践中实现,容易出现 bug,一般也不推荐在生产中使用;

这也是八股文的弊端之一:过于关注所谓的底层实现,忽略了真正的实践。

我们分析这些组件的特点,不外乎临界区锁定、线程同步、共享状态等。以下分析一个实现,看看使用到了哪些技巧:

class Wait_Notify_ACB {

private int num;

private static final Object LOCK = new Object();

private void printABC(int targetNum) {

for (int i = 0; i < 10; i++) {

synchronized (LOCK) {

while (num % 3 != targetNum) {

try {

LOCK.wait();

} catch (InterruptedException e) {

e.printStackTrace();

}

}

num++;

System.out.print(Thread.currentThread().getName());

LOCK.notifyAll();

}

}

}

public static void main(String[] args) {

Wait_Notify_ACB wait_notify_acb = new Wait_Notify_ACB ();

new Thread(() -> {

wait_notify_acb.printABC(0);

}, "A").start();

new Thread(() -> {

wait_notify_acb.printABC(1);

}, "B").start();

new Thread(() -> {

wait_notify_acb.printABC(2);

}, "C").start();

}

}

整体观之,使用的是 synchronized 隐式锁。使用等待队列实现线程同步,while 循环避免虚假唤醒,维护了多线程共享的 num 状态,此外需要注意多个任务的启动和正确终止。

InterruptedException 的处理是错误的,由于我们没有使用到中断机制,可以包装后抛出 IllegalStateException 表示未预料的异常。实践中,也可以设置当前线程为中断状态,待其他代码进行处理。

Lock不应该是静态的,可以改成非静态或者方法改成静态也行。

总之,经过分析可以看出并发原语的复杂性,那么有没有更高一层的抽象来简化问题呢?

更好的实现

笔者在项目的生产环境中遇到过类似的问题,多个线程需要协作,某些线程需要其他线程的结果,这种结果的交接是即时的,也就是说,A线程的结果直接交给B线程进行处理。

更好的实现要求我们实现线程之间的同步,同时应该避免并发修改。我们很自然地想到 SynchronousQueue,使用 CSP 实现 + CompletableFuture,可以减少我们考虑底层的心智负担,方便写出正确的代码。SynchronousQueue 适用于需要在生产者和消费者之间进行直接移交的场景,通常用于线程之间的切换或传递任务。

看一个具体例子:

以下是两个线程交替打印 1 - 100 的实现,由于没有在代码中使用锁,也没有状态维护的烦恼,这也是函数式的思想(减少状态)。

实现思路为:任务1从队列1中取结果,计算,提交给队列2。任务2同理。使用SynchronousQueue 实现直接交接。

private static Stopwatch betterImpl() {

Stopwatch sw = Stopwatch.createStarted();

BlockingQueue<Integer> q1 = new SynchronousQueue<>();

BlockingQueue<Integer> q2 = new SynchronousQueue<>();

int limit = 100;

CompletableFuture<Void> cf1 = CompletableFuture.runAsync(() -> {

while (true) {

Integer i = Uninterruptibles.takeUninterruptibly(q1);

if (i <= limit) {

System.out.println("thread1: i = " + i);

}

Uninterruptibles.putUninterruptibly(q2, i + 1);

if (i == limit - 1) {

break;

}

}

});

CompletableFuture<Void> cf2 = CompletableFuture.runAsync(() -> {

while (true) {

Integer i = Uninterruptibles.takeUninterruptibly(q2);

if (i <= limit) {

System.out.println("thread2: i = " + i);

}

if (i == limit) {

break;

}

Uninterruptibles.putUninterruptibly(q1, i + 1);

}

});

Uninterruptibles.putUninterruptibly(q1, 1);

CompletableFuture.allOf(cf1, cf2).join();

return sw.stop();

}

Uninterruptibles 是 Guava 中的并发工具,很实用,可以避免 try-catch 中断异常这样的样板代码。

线程池配置与本文讨论内容关系不大,故忽略。

一般实践中,阻塞方法都要设置超时时间,这里也忽略了。

这个实现简单明了,性能也不错。如果不需要即时交接,可以替换成缓冲队列(如 ArrayBlockingQueue)。

笔者简单比较了两种实现,结果如下:

private static Stopwatch bufferImpl() {

Stopwatch sw = Stopwatch.createStarted();

BlockingQueue<Integer> q1 = new ArrayBlockingQueue<>(2);

BlockingQueue<Integer> q2 = new ArrayBlockingQueue<>(2);

// ...

}

public static void main(String[] args) {

for (int i = 0; i < 100; i++) {

betterImpl();

bufferImpl();

// 预热

}

Stopwatch result1 = bufferImpl();

Stopwatch result2 = betterImpl();

System.out.println("result1 = " + result1);

System.out.println("result2 = " + result2);

}

// ...

thread2: i = 92

thread1: i = 93

thread2: i = 94

thread1: i = 95

thread2: i = 96

thread1: i = 97

thread2: i = 98

thread1: i = 99

thread2: i = 100

result1 = 490.3 μs

result2 = 469.1 μs

结论:使用 SynchronousQueue 性能更好,感兴趣的读者可以自己写 JMH 比对。

如果你觉得本文对你有帮助的话,欢迎给个点赞加收藏,也欢迎进一步的讨论。

后续我将继续分享并发编程、性能优化等有趣内容,力求做到全网独一份、深入浅出,一周两更,欢迎关注支持。

来源:juejin.cn/post/7532925096828026899

订单表超10亿数据,如何设计Sharding策略?解决跨分片查询和分布式事务?

订单表超10亿数据,如何设计Sharding策略?解决跨分片查询和分布式事务?

引言:

在电商平台高速发展的今天,海量订单处理已成为技术团队必须面对的挑战。当订单数据突破10亿大关,传统单库架构在查询性能、存储容量和运维复杂度上都会遇到瓶颈。

作为有8年经验的Java工程师,我曾主导多个日订单量百万级系统的分库分表改造。今天我将分享从Sharding策略设计到分布式事务落地的完整解决方案,其中包含核心代码实现和实战避坑指南。

一、业务场景分析

1.1 订单数据特点

- 数据量大:日增订单50万+,年增1.8亿

- 访问模式:

- 写操作:高频下单(峰值5000 TPS)

- 读操作:订单查询(用户端+运营端)

- 数据生命周期:热数据(3个月)占80%访问量

1.2 核心挑战

graph LR

A[10亿级订单] --> B[查询性能]

A --> C[存储瓶颈]

A --> D[跨分片聚合]

A --> E[分布式事务]

二、Sharding策略设计

2.1 分片键选择

| 候选方案 | 优点 | 缺点 | 适用场景 |

|---|---|---|---|

| 用户ID | 用户维度查询快 | 可能导致数据倾斜 | C端主导业务 |

| 订单ID | 数据分布均匀 | 用户订单需跨分片查询 | 均匀分布场景 |

| 商户ID | 商户维度查询快 | C端查询效率低 | B2B平台 |

| 创建时间 | 冷热数据分离 | 范围查询可能跨分片 | 推荐方案 |

最终方案:复合分片键(用户ID+创建时间)

2.2 分片算法设计

/**

* 自定义复合分片算法

* 分片键:user_id + create_time

*/

public class OrderShardingAlgorithm implements ComplexKeysShardingAlgorithm<Long> {

private static final String USER_KEY = "user_id";

private static final String TIME_KEY = "create_time";

@Override

public Collection<String> doSharding(

Collection<String> availableTargetNames,

ComplexKeysShardingValue<Long> shardingValue) {

Map<String, Collection<Long>> columnMap = shardingValue.getColumnNameAndShardingValuesMap();

List<String> shardingResults = new ArrayList<>();

// 获取用户ID分片值

Collection<Long> userIds = columnMap.get(USER_KEY);

Long userId = userIds.stream().findFirst().orElseThrow();

// 获取时间分片值

Collection<Long> timestamps = columnMap.get(TIME_KEY);

Long createTime = timestamps.stream().findFirst().orElse(System.currentTimeMillis());

// 计算用户分片(16个分库)

int dbShard = Math.abs(userId.hashCode()) % 16;

// 计算时间分片(按月分表)

LocalDateTime dateTime = Instant.ofEpochMilli(createTime)

.atZone(ZoneId.systemDefault())

.toLocalDateTime();

String tableSuffix = dateTime.format(DateTimeFormatter.ofPattern("yyyyMM"));

// 构建目标分片

String targetDB = "order_db_" + dbShard;

String targetTable = "t_order_" + tableSuffix;

shardingResults.add(targetDB + "." + targetTable);

return shardingResults;

}

}

2.3 分片策略配置(ShardingSphere)

# application-sharding.yaml

spring:

shardingsphere:

datasource:

names: ds0,ds1,...,ds15

# 配置16个数据源...

sharding:

tables:

t_order:

actualDataNodes: ds${0..15}.t_order_${202301..202412}

tableStrategy:

complex:

shardingColumns: user_id,create_time

algorithmClassName: com.xxx.OrderShardingAlgorithm

keyGenerator:

column: order_id

type: SNOWFLAKE

三、跨分片查询解决方案

3.1 常见问题及对策

| 问题类型 | 传统方案痛点 | 优化方案 |

|---|---|---|

| 分页查询 | LIMIT 0,10 扫描全表 | 二次查询法 |

| 排序聚合 | 内存合并性能差 | 并行查询+流式处理 |

| 全局索引 | 无法直接建立 | 异步构建ES索引 |

3.2 分页查询优化实现

/**

* 跨分片分页查询优化(二次查询法)

* 原SQL:SELECT * FROM t_order WHERE user_id=1001 ORDER BY create_time DESC LIMIT 10000,10

*/

public Page<Order> shardingPageQuery(Long userId, int pageNo, int pageSize) {

// 第一步:全分片并行查询

List<Order> allShardResults = shardingExecute(

shard -> "SELECT order_id, create_time FROM t_order "

+ "WHERE user_id = " + userId

+ " ORDER BY create_time DESC"

);

// 第二步:内存排序取TopN

List<Long> targetIds = allShardResults.stream()

.sorted(Comparator.comparing(Order::getCreateTime).reversed())

.skip(pageNo * pageSize)

.limit(pageSize)

.map(Order::getOrderId)

.collect(Collectors.toList());

// 第三步:精准查询目标数据

return orderRepository.findByIdIn(targetIds);

}

/**

* 并行执行查询(使用CompletableFuture)

*/

private List<Order> shardingExecute(Function<Integer, String> sqlBuilder) {

List<CompletableFuture<List<Order>>> futures = new ArrayList<>();

for (int i = 0; i < 16; i++) {

final int shardId = i;

futures.add(CompletableFuture.supplyAsync(() -> {

String sql = sqlBuilder.apply(shardId);

return jdbcTemplate.query(sql, new OrderRowMapper());

}, shardingThreadPool));

}

return futures.stream()

.map(CompletableFuture::join)

.flatMap(List::stream)

.collect(Collectors.toList());

}

3.3 聚合查询优化

/**

* 分布式聚合计算(如:用户总订单金额)

* 方案:并行查询分片结果 + 内存汇总

*/

public BigDecimal calculateUserTotalAmount(Long userId) {

List<CompletableFuture<BigDecimal>> futures = new ArrayList<>();

for (int i = 0; i < 16; i++) {

futures.add(CompletableFuture.supplyAsync(() -> {

String sql = "SELECT SUM(amount) FROM t_order WHERE user_id = ?";

return jdbcTemplate.queryForObject(

sql, BigDecimal.class, userId);

}, shardingThreadPool));

}

return futures.stream()

.map(CompletableFuture::join)

.filter(Objects::nonNull)

.reduce(BigDecimal.ZERO, BigDecimal::add);

}

四、分布式事务解决方案

4.1 方案对比

| 方案 | 一致性 | 性能 | 复杂度 | 适用场景 |

|---|---|---|---|---|

| 2PC | 强一致 | 差 | 高 | 银行核心系统 |

| TCC | 强一致 | 中 | 高 | 资金交易 |

| Saga | 最终一致 | 优 | 中 | 订单系统(推荐) |

| 本地消息表 | 最终一致 | 良 | 低 | 低要求场景 |

4.2 Saga事务实现(订单创建场景)

sequenceDiagram

participant C as 应用

participant O as 订单服务

participant I as 库存服务

participant P as 支付服务

C->>O: 创建订单

O->>I: 预扣库存

I-->>O: 扣减成功

O->>P: 发起支付

P-->>O: 支付成功

O->>C: 返回结果

alt 支付失败

O->>I: 释放库存(补偿)

end

4.3 核心代码实现

/**

* Saga事务管理器(使用Seata框架)

*/

@Service

@Slf4j

public class OrderSagaService {

@Autowired

private InventoryFeignClient inventoryClient;

@Autowired

private PaymentFeignClient paymentClient;

@Transactional

public void createOrder(OrderCreateDTO dto) {

// 1. 创建本地订单(状态:待支付)

Order order = createPendingOrder(dto);

try {

// 2. 调用库存服务(Saga参与者)

inventoryClient.deductStock(

new DeductRequest(order.getOrderId(), dto.getSkuItems()));

// 3. 调用支付服务(Saga参与者)

paymentClient.createPayment(

new PaymentRequest(order.getOrderId(), order.getTotalAmount()));

// 4. 更新订单状态为已支付

order.paySuccess();

orderRepository.update(order);

} catch (Exception ex) {

// 触发Saga补偿流程

log.error("订单创建失败,触发补偿", ex);

handleCreateOrderFailure(order, ex);

throw ex;

}

}

/**

* 补偿操作(需要幂等)

*/

@Compensable(compensationMethod = "compensateOrder")

private void handleCreateOrderFailure(Order order, Exception ex) {

// 1. 释放库存

inventoryClient.restoreStock(order.getOrderId());

// 2. 取消支付(如果已发起)

paymentClient.cancelPayment(order.getOrderId());

// 3. 标记订单失败

order.cancel("系统异常: " + ex.getMessage());

orderRepository.update(order);

}

/**

* 补偿方法(幂等设计)

*/

public void compensateOrder(Order order, Exception ex) {

// 通过状态判断避免重复补偿

if (order.getStatus() != OrderStatus.CANCELLED) {

handleCreateOrderFailure(order, ex);

}

}

}

五、性能优化实践

5.1 分片路由优化

/**

* 热点用户订单查询优化

* 方案:用户分片路由缓存

*/

@Aspect

@Component

public class ShardingRouteCacheAspect {

@Autowired

private RedisTemplate<String, Integer> redisTemplate;

private static final String ROUTE_KEY = "user_route:%d";

@Around("@annotation(org.apache.shardingsphere.api.hint.Hint)")

public Object cacheRoute(ProceedingJoinPoint joinPoint) throws Throwable {

Long userId = getUserIdFromArgs(joinPoint.getArgs());

if (userId == null) {

return joinPoint.proceed();

}

// 1. 查询缓存

String cacheKey = String.format(ROUTE_KEY, userId);

Integer shardId = redisTemplate.opsForValue().get(cacheKey);

if (shardId == null) {

// 2. 计算分片ID(避免全表扫描)

shardId = calculateUserShard(userId);

redisTemplate.opsForValue().set(cacheKey, shardId, 1, TimeUnit.HOURS);

}

// 3. 设置分片Hint强制路由

try (HintManager hintManager = HintManager.getInstance()) {

hintManager.setDatabaseShardingValue(shardId);

return joinPoint.proceed();

}

}

private int calculateUserShard(Long userId) {

// 分片计算逻辑(与分片算法保持一致)

return Math.abs(userId.hashCode()) % 16;

}

}

5.2 冷热数据分离

-- 归档策略示例(每月执行)

CREATE EVENT archive_orders

ON SCHEDULE EVERY 1 MONTH

DO

BEGIN

-- 1. 创建归档表(按年月)

SET @archive_table = CONCAT('t_order_archive_', DATE_FORMAT(NOW(), '%Y%m'));

SET @create_sql = CONCAT('CREATE TABLE IF NOT EXISTS ', @archive_table, ' LIKE t_order');

PREPARE stmt FROM @create_sql; EXECUTE stmt;

-- 2. 迁移数据(6个月前)

SET @move_sql = CONCAT(

'INSERT INTO ', @archive_table,

' SELECT * FROM t_order WHERE create_time < DATE_SUB(NOW(), INTERVAL 6 MONTH)'

);

PREPARE stmt FROM @move_sql; EXECUTE stmt;

-- 3. 删除原表数据

DELETE FROM t_order WHERE create_time < DATE_SUB(NOW(), INTERVAL 6 MONTH);

END

六、避坑指南

6.1 常见问题及解决方案

| 问题类型 | 现象 | 解决方案 |

|---|---|---|

| 分片键选择不当 | 数据倾斜(70%数据在1个分片) | 增加分片基数(复合分片键) |

| 分布式事务超时 | 库存释放失败 | 增加重试机制+人工补偿台 |

| 跨分片查询性能差 | 分页查询超时 | 改用ES做全局搜索 |

| 扩容困难 | 增加分片需迁移数据 | 初始设计预留分片(32库) |

6.2 必须实现的监控项

graph TD

A[监控大盘] --> B[分片负载]

A --> C[慢查询TOP10]

A --> D[分布式事务成功率]

A --> E[热点用户检测]

A --> F[归档任务状态]

七、总结与展望

分库分表本质是业务与技术的平衡艺术,经过多个项目的实践验证,我总结了以下核心经验:

- 分片设计三原则:

- 数据分布均匀性 > 查询便捷性

- 业务可扩展性 > 短期性能

- 简单可运维 > 技术先进性

- 演进路线建议:

graph LR

A[单库] --> B[读写分离]

B --> C[垂直分库]

C --> D[水平分表]

D --> E[单元化部署]

- 未来优化方向:

- 基于TiDB的HTAP架构

- 使用Apache ShardingSphere-Proxy

- 智能分片路由(AI预测热点)

最后的话:

处理10亿级订单如同指挥一场交响乐——每个分片都是独立乐器,既要保证局部精准,又要实现全局和谐。

好的分库分表方案不是技术参数的堆砌,而是对业务深刻理解后的架构表达。

来源:juejin.cn/post/7519688814395719714

Nginx+Keepalive 实现高可用并启用健康检查模块

1. 目标效果

keepalived 负责监控 192.168.1.20 和 192.168.1.30 这两台负载均衡的服务器,并自动选择一台作为主服务器。用户访问 http://192.168.1.10 时,由主服务器接收该请求。当 keepalived 检测到主服务器不可访问时,会将备服务器升级为主服务器,从而实现高可用。

在主服务器中,通过 nginx(tengine)实现负载均衡,将访问请求分流到 192.168.1.100 和 192.168.1.200 这两台业务服务器。 nginx 中的健康检查模块会检测业务服务器状态,如果检测到 192.168.1.100 不可访问,则不再将访问请求发送给该服务器。

2. 部署 Keepalived

2.1 主机 IP

| 主机 | IP |

|---|---|

| 虚拟 IP | 192.168.1.10 |

| 主服务器 | 192.168.1.20 |

| 备服务器 | 192.168.1.30 |

2.2 主服务器设置

官方配置说明文档:Keepalived for Linux

yun install vim epel-release keepalived -y

cp /etc/keepalived/keepalived.conf /etc/keepalived/keepalived.conf.bak

cat > /etc/keepalived/keepalived.conf <<EOF

! Configuration File for keepalived

global_defs {

router_id nginx01

}

vrrp_script check_nginx {

script "/etc/keepalived/nginx_check.sh"

interval 2

weight 2

}

vrrp_instance VI_1 {

state MASTER

interface eth0

virtual_router_id 51

priority 100

advert_int 1

authentication {

auth_type PASS

auth_pass linalive

}

virtual_ipaddress {

192.168.1.10

}

track_script {

check_nginx

}

}

EOF

touch /etc/keepalived/nginx_check.sh && chmod +x /etc/keepalived/nginx_check.sh

cat > /etc/keepalived/nginx_check.sh <<EOF

#!/bin/bash

if ! pgrep -x "nginx" > /dev/null; then

systemctl restart nginx

sleep 2

if ! pgrep -x "nginx" > /dev/null; then

pkill keepalived

fi

fi

EOF

2.2 备服务器设置

yun install vim epel-release keepalived -y

cp /etc/keepalived/keepalived.conf /etc/keepalived/keepalived.conf.bak

cat > /etc/keepalived/keepalived.conf <<EOF

! Configuration File for keepalived

global_defs {

router_id nginx02

}

vrrp_script check_nginx {

script "/etc/keepalived/nginx_check.sh"

interval 2

weight 2

}

vrrp_instance VI_1 {

state BACKUP

interface eth0

virtual_router_id 51

priority 90

advert_int 1

authentication {

auth_type PASS

auth_pass linalive

}

virtual_ipaddress {

192.168.1.10

}

track_script {

check_nginx

}

}

EOF

touch /etc/keepalived/nginx_check.sh && chmod +x /etc/keepalived/nginx_check.sh

cat > /etc/keepalived/nginx_check.sh <<EOF

#!/bin/bash

if ! pgrep -x "nginx" > /dev/null; then

systemctl restart nginx

sleep 2

if ! pgrep -x "nginx" > /dev/null; then

pkill keepalived

fi

fi

EOF

3. 部署 Tengine (主备服务器)

3.1 准备 Tengine 压缩文件

下载 tengine 压缩文件,将文件上传到 /opt 文件夹下。下载地址:The Tengine Web Server

本文章编写时,最新版是:tengine-3.1.0.tar.gz

3.2 解压并编译

yum install -y gcc gcc-c++ make pcre-devel zlib-devel openssl-devel

tar zxvf /opt/tengine-3.1.0.tar.gz -C /opt

cd /opt/tengine-3.1.0

# configure 有众多的参数可设置,可使用 ./configure --help 进行查看

# 按照官方说法默认应该是开启了健康检查模块,但实测需要手动添加参数

./configure --add-module=modules/ngx_http_upstream_check_module/

make && make install

3.3 添加服务项

cat > /etc/systemd/system/nginx.service <<EOF

[Unit]

Description=The Tengine HTTP and reverse proxy server

After=network.target

[Service]

Type=forking

PIDFile=/usr/local/nginx/logs/nginx.pid

ExecStartPre=/usr/local/nginx/sbin/nginx -t

ExecStart=/usr/local/nginx/sbin/nginx

ExecReload=/usr/local/nginx/sbin/nginx -s reload

ExecStop=/usr/local/nginx/sbin/nginx -s stop

PrivateTmp=true

[Install]

WantedBy=multi-user.target

EOF

systemctl daemon-reload

3.4 编辑 nginx 配置文件

此处配置的内容项可参考官方文档:ngx_http_upstream_check_module

# tengine 默认的安装路径是 /usr/local/nginx

# 配置文件路径: /usr/local/nginx/conf/nginx.conf

# /favicon.ico 是接口地址,需替换成真实的 api 接口

worker_processes auto;

events {

worker_connections 1024;

}

http {

upstream cluster1 {

server 192.168.1.100:8082;

server 192.168.1.200:8089;

check interval=3000 rise=2 fall=5 timeout=1000 type=http;

check_http_send "HEAD /favicon.ico HTTP/1.0\r\n\r\n";

check_http_expect_alive http_2xx http_3xx;

}

server {

listen 80;

server_name localhost;

location / {

index Index.aspx;

proxy_pass http://cluster1;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

}

location /status {

check_status;

access_log off;

}

}

}

3.5 启动服务并访问

使用 systemctl start nginx启动服务,并访问 localhost:80/status查看健康检查报表页

4. 写在最后

来源:juejin.cn/post/7483314478957232138

创建型模式:抽象工厂模式

什么是抽象工厂模式

抽象工厂模式是一种创建型设计模式,它提供一个接口来创建一系列相关或相互依赖的对象家族,而无需指定它们的具体类。简单来说,抽象工厂模式是工厂模式的升级版,它不再只生产一种产品,而是生产一整套产品。

抽象工厂vs工厂方法:关键区别

- 工厂方法模式:关注单个产品的创建,一个工厂创建一种产品

- 抽象工厂模式:关注产品族的创建,一个工厂创建多种相关产品

这就像一个生产手机的工厂(工厂方法)和一个生产整套电子设备(手机、平板、耳机)的工厂(抽象工厂)的区别。

抽象工厂模式的核心实现

// 产品A接口

public interface ProductA {

void operationA();

}

// 产品B接口

public interface ProductB {

void operationB();

}

// 产品A1实现

public class ConcreteProductA1 implements ProductA {

@Override

public void operationA() {

System.out.println("产品A1的操作");

}

}

// 产品A2实现

public class ConcreteProductA2 implements ProductA {

@Override

public void operationA() {

System.out.println("产品A2的操作");

}

}

// 产品B1实现

public class ConcreteProductB1 implements ProductB {

@Override

public void operationB() {

System.out.println("产品B1的操作");

}

}

// 产品B2实现

public class ConcreteProductB2 implements ProductB {

@Override

public void operationB() {

System.out.println("产品B2的操作");

}

}

// 抽象工厂接口

public interface AbstractFactory {

ProductA createProductA();

ProductB createProductB();

}

// 具体工厂1 - 创建产品族1(A1+B1)

public class ConcreteFactory1 implements AbstractFactory {

@Override

public ProductA createProductA() {

return new ConcreteProductA1();

}

@Override

public ProductB createProductB() {

return new ConcreteProductB1();

}

}

// 具体工厂2 - 创建产品族2(A2+B2)

public class ConcreteFactory2 implements AbstractFactory {

@Override

public ProductA createProductA() {

return new ConcreteProductA2();

}

@Override

public ProductB createProductB() {

return new ConcreteProductB2();

}

}

抽象工厂模式的关键点

- 产品接口:为每种产品定义接口

- 具体产品:实现产品接口的具体类

- 抽象工厂接口:声明一组创建产品的方法

- 具体工厂:实现抽象工厂接口,创建一个产品族

- 产品族:一组相关产品的集合(例如PC系列组件、移动系列组件)

实际应用示例:跨平台UI组件库

下面通过一个跨平台UI组件库的例子来展示抽象工厂模式的强大应用:

// ===== 按钮组件 =====

public interface Button {

void render();

void onClick();

}

// Windows按钮

public class WindowsButton implements Button {

@Override

public void render() {

System.out.println("渲染Windows风格的按钮");

}

@Override

public void onClick() {

System.out.println("Windows按钮点击效果");

}

}

// MacOS按钮

public class MacOSButton implements Button {

@Override

public void render() {

System.out.println("渲染MacOS风格的按钮");

}

@Override

public void onClick() {

System.out.println("MacOS按钮点击效果");

}

}

// ===== 复选框组件 =====

public interface Checkbox {

void render();

void toggle();

}

// Windows复选框

public class WindowsCheckbox implements Checkbox {

@Override

public void render() {

System.out.println("渲染Windows风格的复选框");

}

@Override

public void toggle() {

System.out.println("Windows复选框切换状态");

}

}

// MacOS复选框

public class MacOSCheckbox implements Checkbox {

@Override

public void render() {

System.out.println("渲染MacOS风格的复选框");

}

@Override

public void toggle() {

System.out.println("MacOS复选框切换状态");

}

}

// ===== 文本框组件 =====

public interface TextField {

void render();

void getText();

}

// Windows文本框

public class WindowsTextField implements TextField {

@Override

public void render() {

System.out.println("渲染Windows风格的文本框");

}

@Override

public void getText() {

System.out.println("获取Windows文本框内容");

}

}

// MacOS文本框

public class MacOSTextField implements TextField {

@Override

public void render() {

System.out.println("渲染MacOS风格的文本框");

}

@Override

public void getText() {

System.out.println("获取MacOS文本框内容");

}

}

// ===== GUI工厂接口 =====

public interface GUIFactory {

Button createButton();

Checkbox createCheckbox();

TextField createTextField();

}

// Windows GUI工厂

public class WindowsFactory implements GUIFactory {

@Override

public Button createButton() {

return new WindowsButton();

}

@Override

public Checkbox createCheckbox() {

return new WindowsCheckbox();

}

@Override

public TextField createTextField() {

return new WindowsTextField();

}

}

// MacOS GUI工厂

public class MacOSFactory implements GUIFactory {

@Override

public Button createButton() {

return new MacOSButton();

}

@Override

public Checkbox createCheckbox() {

return new MacOSCheckbox();

}

@Override

public TextField createTextField() {

return new MacOSTextField();

}

}

如何使用抽象工厂模式

// 应用类 - 与具体工厂解耦

public class Application {

private Button button;

private Checkbox checkbox;

private TextField textField;

// 构造函数接收一个抽象工厂

public Application(GUIFactory factory) {

button = factory.createButton();

checkbox = factory.createCheckbox();

textField = factory.createTextField();

}

// 渲染表单

public void renderForm() {

System.out.println("=== 开始渲染表单 ===");

button.render();

checkbox.render();

textField.render();

System.out.println("=== 表单渲染完成 ===");

}

// 表单操作

public void handleForm() {

System.out.println("\n=== 表单交互 ===");

button.onClick();

checkbox.toggle();

textField.getText();

}

}

// 客户端代码

public class GUIDemo {

public static void main(String[] args) {

// 检测当前操作系统

String osName = System.getProperty("os.name").toLowerCase();

GUIFactory factory;

// 根据操作系统选择合适的工厂

if (osName.contains("windows")) {

factory = new WindowsFactory();

System.out.println("检测到Windows系统,使用Windows风格UI");

} else {

factory = new MacOSFactory();

System.out.println("检测到非Windows系统,使用MacOS风格UI");

}

// 创建并使用应用 - 注意应用不依赖于具体组件类

Application app = new Application(factory);

app.renderForm();

app.handleForm();

}

}

运行结果(Windows系统上)

检测到Windows系统,使用Windows风格UI

=== 开始渲染表单 ===

渲染Windows风格的按钮

渲染Windows风格的复选框

渲染Windows风格的文本框

=== 表单渲染完成 ===

=== 表单交互 ===

Windows按钮点击效果

Windows复选框切换状态

获取Windows文本框内容

运行结果(MacOS系统上)

检测到非Windows系统,使用MacOS风格UI

=== 开始渲染表单 ===

渲染MacOS风格的按钮

渲染MacOS风格的复选框

渲染MacOS风格的文本框

=== 表单渲染完成 ===

=== 表单交互 ===

MacOS按钮点击效果

MacOS复选框切换状态

获取MacOS文本框内容

抽象工厂模式的常见应用场景

- 跨平台UI工具包:为不同操作系统提供一致的界面组件

- 数据库访问层:支持多种数据库系统(MySQL、Oracle、MongoDB等)

- 游戏开发:创建不同主题的游戏元素(中世纪、未来、童话等)

- 多环境配置系统:为开发、测试、生产环境提供不同实现

- 电子设备生态系统:创建配套的产品(手机、耳机、手表都来自同一品牌)

- 多主题应用:切换应用的视觉主题(暗色模式/亮色模式)

抽象工厂模式的实际案例

许多知名框架和库使用抽象工厂模式,如:

- Java的JDBC:

ConnectionFactory创建特定数据库的连接 - Spring Framework:通过BeanFactory创建和管理各种组件

- javax.xml.parsers.DocumentBuilderFactory:创建DOM解析器

- Hibernate:

SessionFactory为不同数据库创建会话

抽象工厂模式的优点

- 产品一致性保证:确保一个工厂创建的产品相互兼容

- 隔离具体类:客户端与具体类隔离,只与接口交互

- 开闭原则:引入新产品族不需要修改现有代码

- 替换产品族:可以整体替换产品族(如UI主题切换)

抽象工厂模式的缺点

- 扩展困难:添加新的产品类型需要修改工厂接口及所有实现

- 复杂度增加:产品较多时,类的数量会急剧增加

- 接口污染:接口中可能包含部分工厂不支持的创建方法

抽象工厂的实现变体

使用反射简化工厂实现

public class ReflectiveFactory implements GUIFactory {

private String packageName;

public ReflectiveFactory(String stylePrefix) {

packageName = "com.example.gui." + stylePrefix.toLowerCase();

}

@Override

public Button createButton() {

return (Button) createComponent("Button");

}

@Override

public Checkbox createCheckbox() {

return (Checkbox) createComponent("Checkbox");

}

@Override

public TextField createTextField() {

return (TextField) createComponent("TextField");

}

private Object createComponent(String type) {

try {

Class<?> clazz = Class.forName(packageName + "." + type);

return clazz.getDeclaredConstructor().newInstance();

} catch (Exception e) {

throw new RuntimeException("无法创建组件", e);

}

}

}

带有默认实现的抽象工厂

public abstract class BaseGUIFactory implements GUIFactory {

// 提供默认实现

@Override

public TextField createTextField() {

return new DefaultTextField(); // 所有平台通用的默认实现

}

// 其他方法需要子类实现

@Override

public abstract Button createButton();

@Override

public abstract Checkbox createCheckbox();

}

实现抽象工厂的设计考虑

- 产品族边界:明确定义哪些产品属于同一族

- 接口设计:保持工厂接口精简,避免方法爆炸

- 工厂选择机制:考虑如何选择/切换具体工厂

- 扩展策略:提前考虑如何添加新产品类型

- 组合与单一职责:大型产品族可考虑拆分为多个子工厂

抽象工厂模式最佳实践

- 适度使用:当确实需要创建一系列相关对象时才使用

- 懒加载:考虑延迟创建产品,而不是一次创建所有产品

- 结合其他模式:与单例、原型、构建者等模式结合使用

- 依赖注入:通过依赖注入框架传递工厂

- 配置驱动:使用配置文件或注解选择具体工厂实现

// 使用配置驱动的工厂

public class ConfigurableGUIFactory {

public static GUIFactory getFactory() {

String factoryType = ConfigLoader.getProperty("ui.factory");

switch (factoryType) {

case "windows": return new WindowsFactory();

case "macos": return new MacOSFactory();

case "web": return new WebFactory();

default: throw new IllegalArgumentException("未知UI工厂类型");

}

}

}

抽象工厂与依赖倒置原则

抽象工厂是实现依赖倒置原则的绝佳方式:高层模块不依赖于低层模块,两者都依赖于抽象。

// 不好的设计:直接依赖具体类

public class BadForm {

private WindowsButton button; // 直接依赖具体实现

private WindowsCheckbox checkbox;

public void createUI() {

button = new WindowsButton(); // 硬编码创建具体类

checkbox = new WindowsCheckbox();

}

}

// 好的设计:依赖抽象

public class GoodForm {

private Button button; // 依赖接口

private Checkbox checkbox;

private final GUIFactory factory; // 依赖抽象工厂

public GoodForm(GUIFactory factory) {

this.factory = factory;

}

public void createUI() {

button = factory.createButton(); // 通过工厂创建

checkbox = factory.createCheckbox();

}

}

抽象工厂模式小结

抽象工厂模式是一种强大但需谨慎使用的创建型模式。它在需要一套相关产品且系统不应依赖于产品的具体类时非常有用。这种模式有助于确保产品兼容性,并为产品族提供统一的创建接口。

适当应用抽象工厂模式可以使代码更具灵活性和可维护性,但也要避免过度设计导致的复杂性。理解产品族的概念和如何设计良好的抽象工厂接口是掌握这一模式的关键。

来源:juejin.cn/post/7491963395284549669

Spring Boot Admin:一站式监控微服务,这个运维神器真香!

关注我的公众号:【编程朝花夕拾】,可获取首发内容。

01 引言

在现代微服务架构中,应用实例的数量动辄成百上千。传统的逐个登录服务器查看日志、检查状态的方式早已变得低效且不现实。

因此,一个集中化、可视化、且能提供实时健康状态的管理平台变得至关重要。Spring Boot Admin (SBA) 正是为了满足这一需求而生的强大工具。

然而,各种厂商的云服务提供了各种监控服务解决客户的各种痛点。Spring Boot Admin这样的工具似乎关注度没有那么高。小编也是无意间发现这款产品,分享给大家。

02 简介

Spring Boot Admin 是一个用于管理和监控 Spring Boot 应用程序的开源社区项目。它并非官方 Spring 项目,但在社区中备受推崇并被广泛使用。

其核心原理是:一个作为“服务器”(Server)的中央管理端,通过收集并展示众多作为“客户端”(Client)的 Spring Boot 应用的监控信息。

Spring Boot Admin 通过集成 Spring Boot Actuator 端点来获取应用数据,并提供了一个友好的 Web UI 界面来展示这些信息。

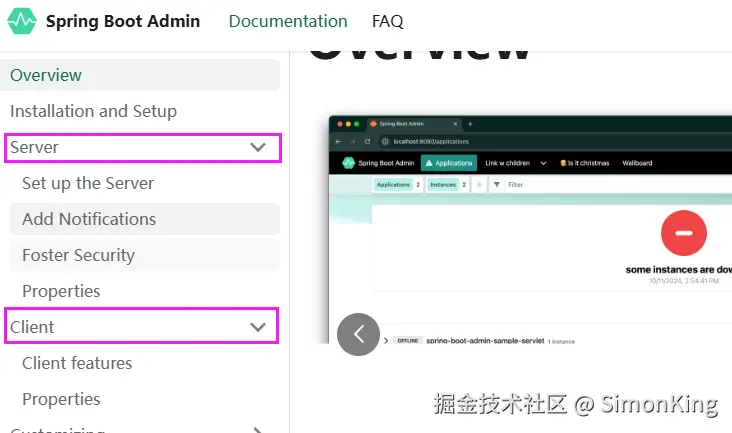

主要分为两部分:

- 服务端:监控平台

- 客户端:业务端

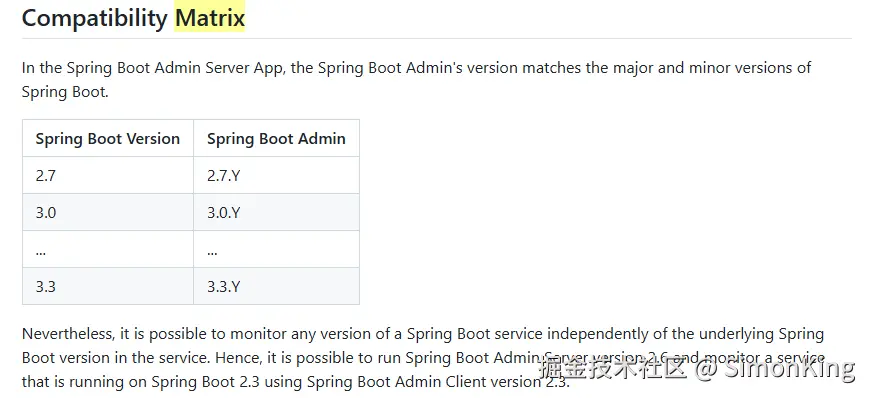

SpringBoot的版本和Spring Boot Admin有一定的对应关系:

GitHub地址:github.com/codecentric…

文档地址:docs.spring-boot-admin.com/

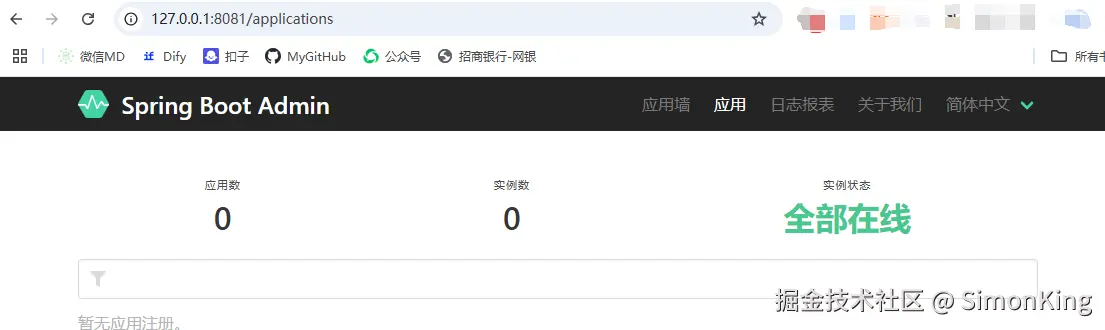

03 Admin服务端

服务的端配置相当简单,只需要引入依赖,启动增加注解。服务端的基础配置就算完成了。

3.1 基础配置

Maven依赖

<dependency>

<groupId>de.codecentric</groupId>

<artifactId>spring-boot-admin-starter-server</artifactId>

<version>${latest.version}</version>

</dependency>

增加注解

@EnableAdminServer

这两个配置就可访问项目的IP+端口,进入管理页面了。

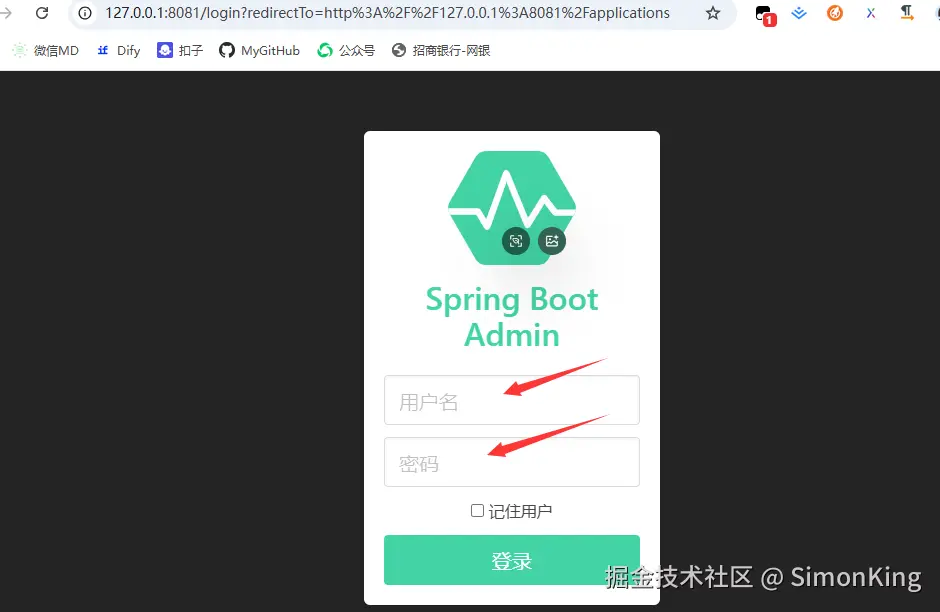

3.2 增加鉴权

为了数据安全,可以增加鉴权。拥有账号和密码方可进入。

Maven依赖

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-security</artifactId>

</dependency>

配置文件

# 设置自己的用户名和密码

spring.security.user.name=admin

spring.security.user.password=123456

输入对应的用户名和密码就可以进入了。

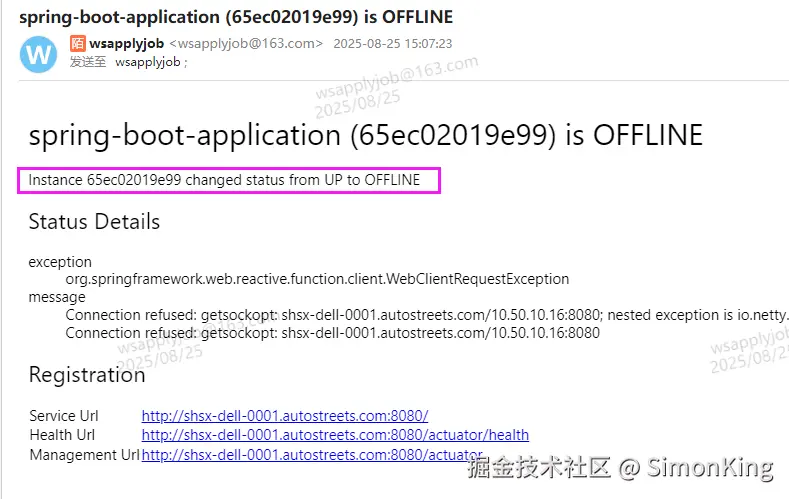

3.3 增加邮件推送

官方提供了各种通知,也可以自定义,如图:

我们以邮件通知为例。

Maven依赖

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-mail</artifactId>

</dependency>

配置

# 邮箱配置

spring.mail.host=smtp.163.com

spring.mail.port=25

spring.mail.username=用户名

spring.mail.password=*****[授权码]

# 发送和接受邮箱

spring.boot.admin.notify.mail.to=wsapplyjob@163.com

spring.boot.admin.notify.mail.from=wsapplyjob@163.com

客户端下线之后会触发邮件:

04 Adamin客户端

因为服务端是依赖Spring Boot Actuator 端点来获取应用数据,所以我们需要开放期其所有的服务。

4.1 基础配置

Maven依赖

<dependency>

<groupId>de.codecentric</groupId>

<artifactId>spring-boot-admin-starter-client</artifactId>

<version>${latest.version}</version>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-actuator</artifactId>

</dependency>

# 服务端地址

spring.boot.admin.client.url=http://127.0.0.1:8081

# 鉴权信息

spring.boot.admin.client.username=admin

spring.boot.admin.client.password=123456

# 开发所有的暴漏的信息

management.endpoints.web.exposure.include=*

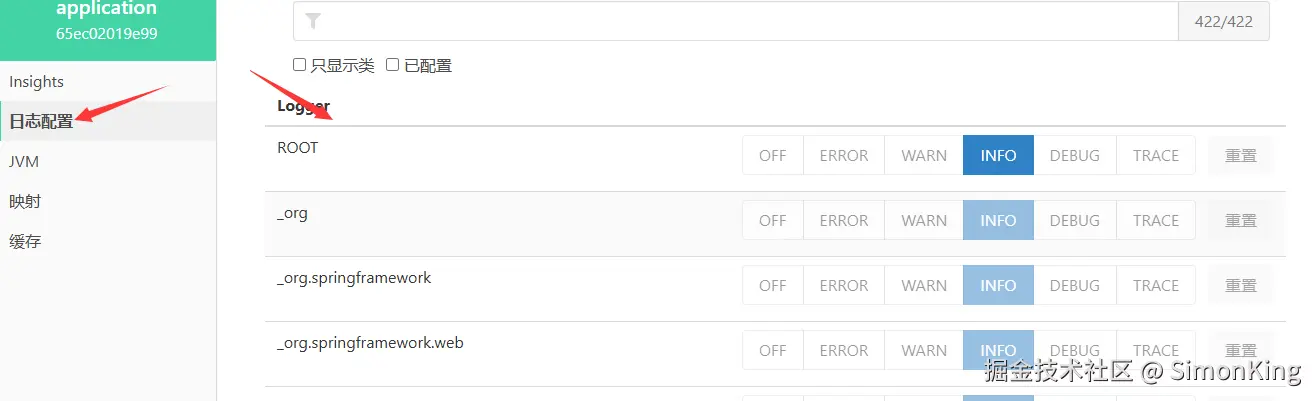

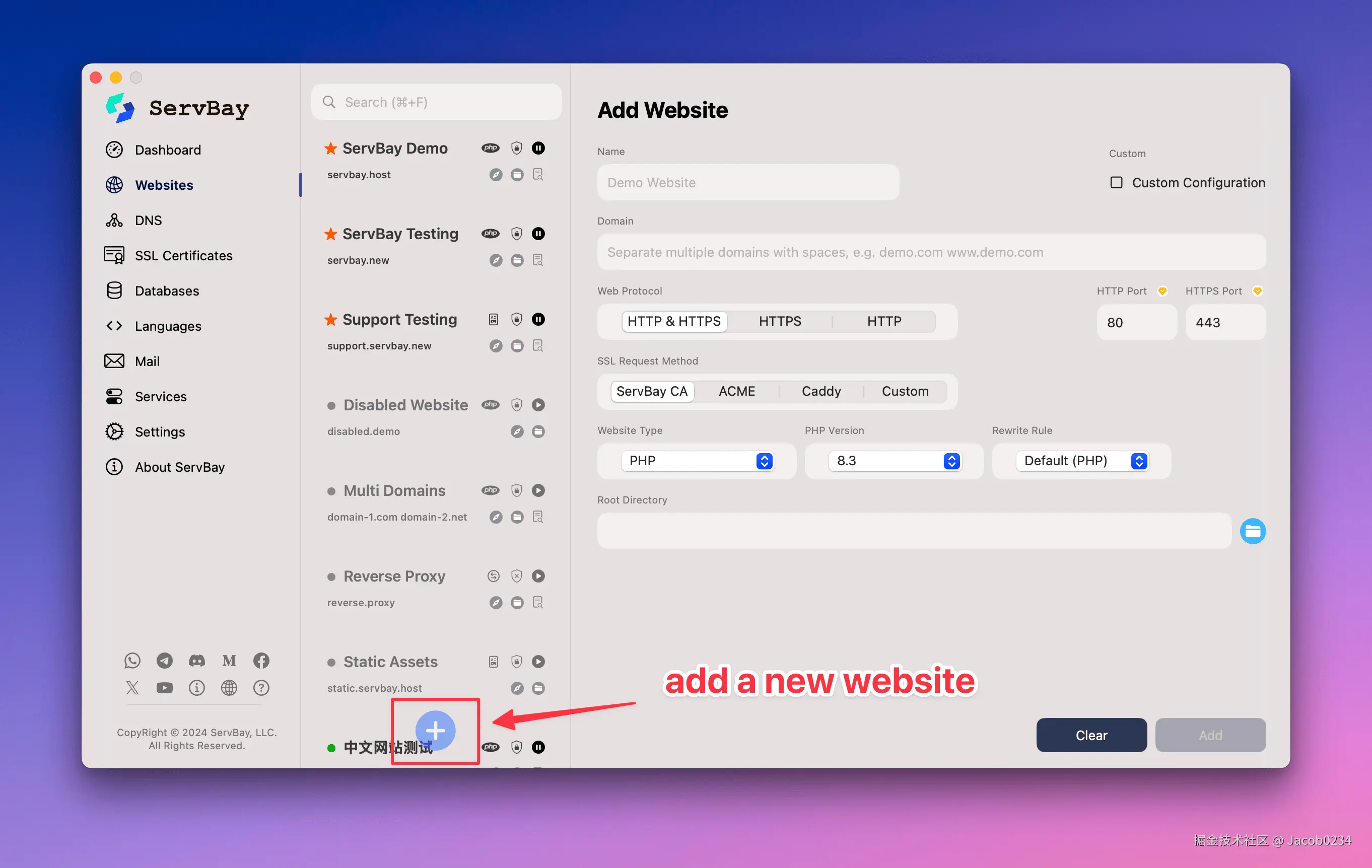

4.2 监控界面

进入之后,我们就会发现上面的页面。点击应用墙,就会展示所有监控的实例。进入之后如图:

进入之后就可以看到五大块。其中②就是我们之前看到的日志级别的控制。还包含了缓存、计划任务、映射甚至类之间的依赖关系。

因为界面支持中文,里面具体的功能就不做描述,感兴趣的可以自己的探索。

4.3 日志配置增加日志

默认的日志进去只有日志的级别,并不会打印日志。

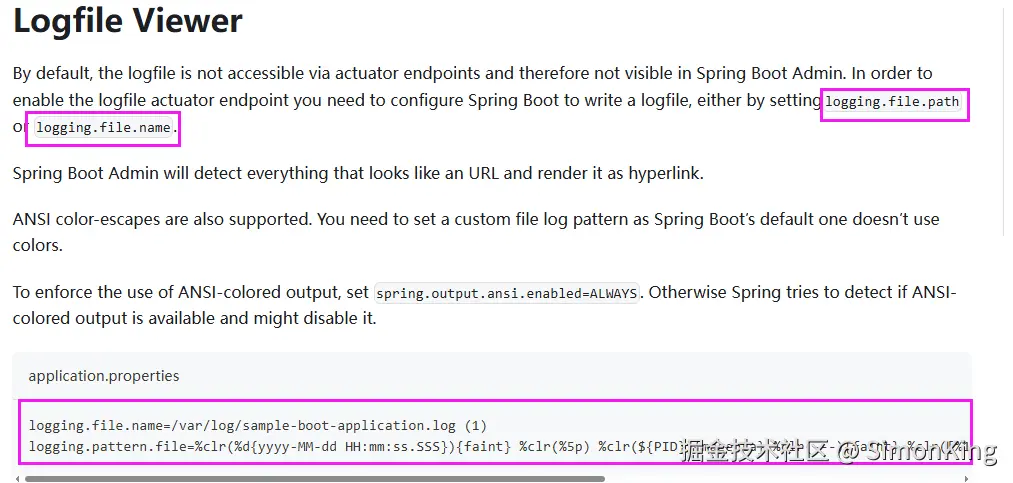

这是官方的描述:

我们增加配置:

logging.file.name=/var/log/boot-log.log

logging.pattern.file=%clr(%d{yyyy-MM-dd HH:mm:ss.SSS}){faint} %clr(%5p) %clr(${PID}){magenta} %clr(---){faint} %clr([.15t]){faint} %clr(%-40.40logger{39}){cyan} %clr(:){faint} %m%n%wEx (2)

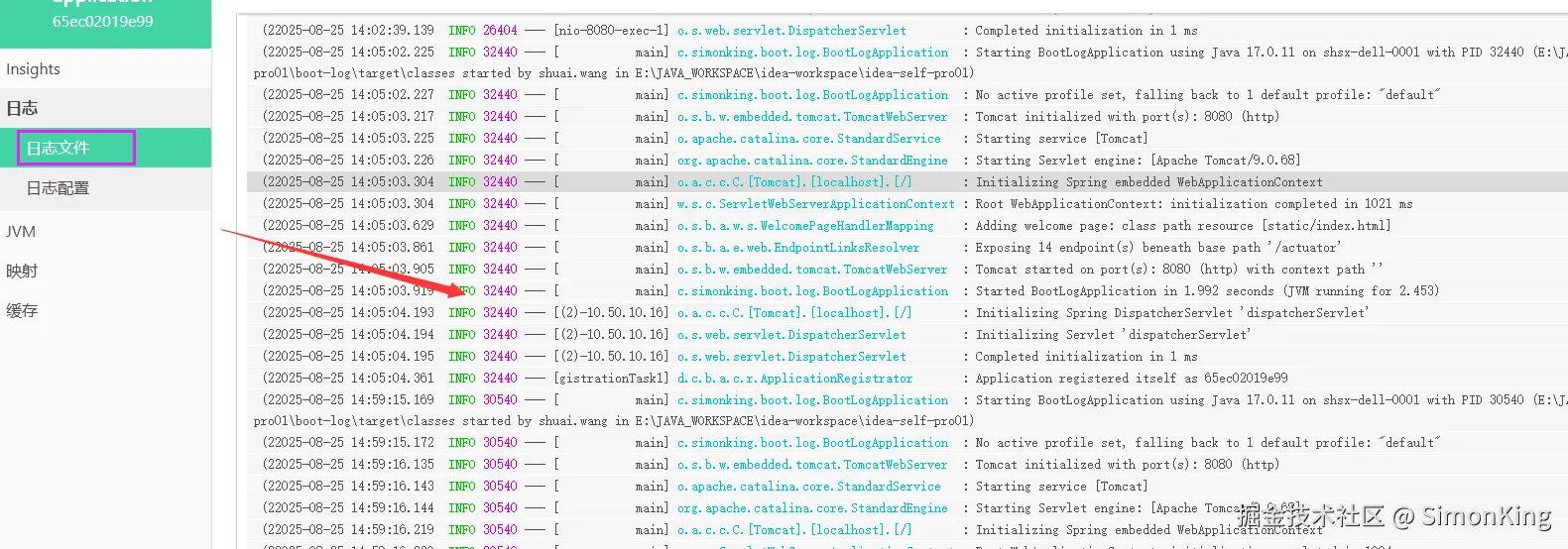

启动查看结果:

我们就可以看到信的菜单:日志文件

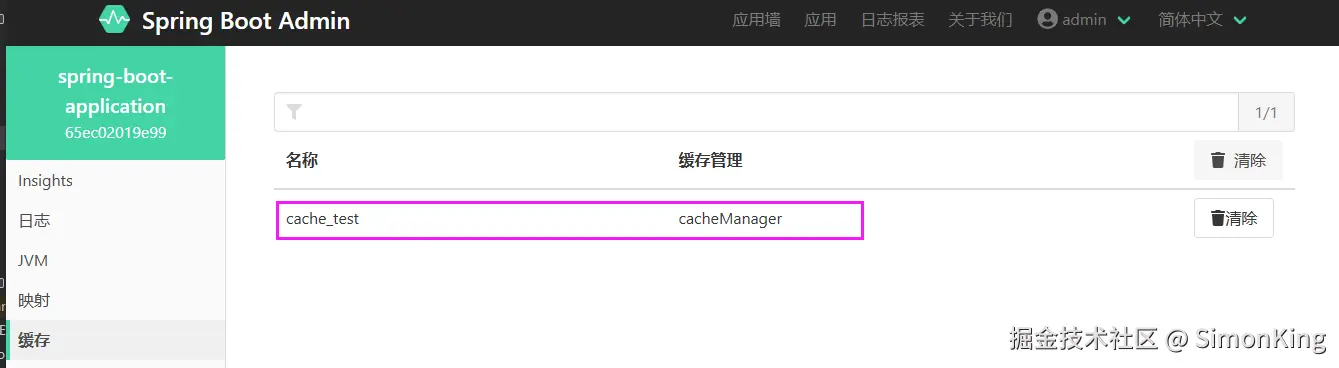

4.4 缓存

【缓存】是没有数据的:

缓存依赖

<!-- 监控缓存需要的依赖 -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-cache</artifactId>

</dependency>

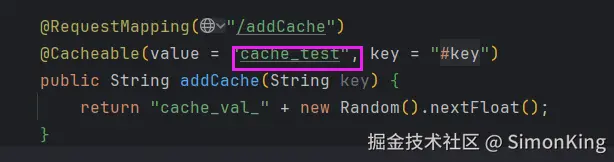

代码

触发缓存任务之后,就会出现缓存的管理:

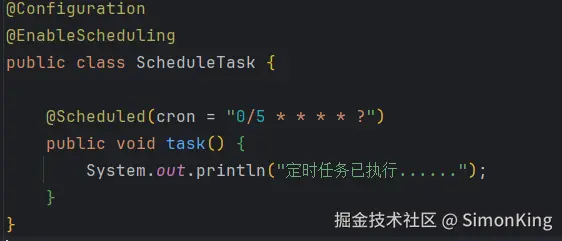

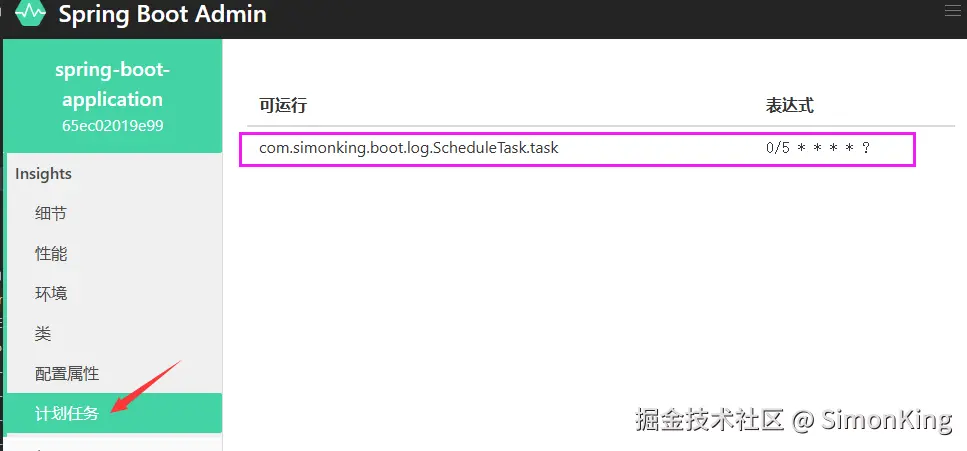

4.5 计划任务

【计划任务】和缓存基本一样,但是无需引入第三方依赖。使用@Scheduled即可。

监控结果:

05 小结

Spring Boot Admin 以其简洁的配置、强大的功能和友好的界面,成为了 Spring Boot 微服务监控领域的事实标准。它极大地降低了监控和运维的复杂度,让开发者能够更专注于业务逻辑开发。

对于中小型规模的微服务集群,直接使用 SBA 是一个高效且成本低廉的解决方案。

赶快去探索里面不同的功能的吧!

来源:juejin.cn/post/7542450691911155762

别再混淆了!一文彻底搞懂System.identityHashCode与Object.hashCode的区别

在Java开发中,哈希码的使用无处不在,但许多开发者对

System.identityHashCode()和Object.hashCode()的区别仍然模糊不清。本文将深入剖析二者的核心区别,并通过实际代码演示它们在不同场景下的行为差异。

一、本质定义:两种哈希码的起源

- Object.hashCode()

- 所有Java对象的默认方法(定义在

Object类中) - 可被子类重写(通常基于对象内容计算)

// 默认实现(未重写时)

public native int hashCode();

- 所有Java对象的默认方法(定义在

- System.identityHashCode()

System类提供的静态工具方法- 无视任何重写,始终返回JVM原始哈希码

public static native int identityHashCode(Object x);

二、核心区别对比(表格速查)

| 特性 | Object.hashCode() | System.identityHashCode() |

|---|---|---|

| 是否可重写 | ✅ 子类可重写改变行为 | ❌ 行为固定不可变 |

| 对重写的敏感性 | 返回重写后的自定义值 | 永远返回JVM原始哈希码 |

null处理 | 调用抛NullPointerException | 安全返回0 |

| 返回值一致性 | 内容改变时可能变化 | 对象生命周期内永不改变 |

| 典型用途 | HashMap/HashSet等基于内容的集合 | IdentityHashMap等身份敏感操作 |

三、关键差异深度解析

1. 重写行为对比(核心区别)

class CustomObject {

private int id;

// 重写hashCode(基于内容)

@Override

public int hashCode() {

return id * 31;

}

}

public static void main(String[] args) {

CustomObject obj = new CustomObject();

obj.id = 100;

System.out.println("hashCode: " + obj.hashCode()); // 3100

System.out.println("identityHashCode: " + System.identityHashCode(obj)); // 356573597

}

输出说明:

✅ hashCode()返回重写后的计算值

✅ identityHashCode()无视重写,返回JVM原始哈希

2. null安全性对比

Object obj = null;

// 抛出NullPointerException

try {

System.out.println(obj.hashCode());

} catch (NullPointerException e) {

System.out.println("调用hashCode()抛NPE");

}

// 安全返回0

System.out.println("identityHashCode(null): "

+ System.identityHashCode(obj));

3. 哈希码不变性验证

String str = "Hello";

int initialIdentity = System.identityHashCode(str);

str = str + " World!"; // 修改对象内容

// 身份哈希码保持不变

System.out.println(initialIdentity == System.identityHashCode(str)); // true

四、经典应用场景

1. 使用Object.hashCode()的场景

// 在HashMap中作为键(依赖内容哈希)

Map<Student, Grade> gradeMap = new HashMap<>();

Student s = new Student("2023001", "张三");

gradeMap.put(s, new Grade(90));

// 重写需遵守规范:内容相同则哈希码相同

class Student {

private String id;

private String name;

@Override

public int hashCode() {

return Objects.hash(id, name);

}

}

2. 使用identityHashCode()的场景

场景1:实现身份敏感的容器

// IdentityHashMap基于身份哈希而非内容

IdentityHashMap<Object, String> identityMap = new IdentityHashMap<>();

String s1 = new String("ABC");

String s2 = new String("ABC");

identityMap.put(s1, "第一对象");

identityMap.put(s2, "第二对象"); // 不同对象,均可插入

System.out.println(identityMap.size()); // 2

场景2:检测hashCode是否被重写

boolean isHashCodeOverridden(Object obj) {

return obj.hashCode() != System.identityHashCode(obj);

}

// 测试

System.out.println(isHashCodeOverridden(new Object())); // false

System.out.println(isHashCodeOverridden(new String("Test"))); // true

场景3:调试对象内存关系

Object objA = new Object();

Object objB = objA; // 指向同一对象

// 身份哈希相同证明是同一对象

System.out.println(System.identityHashCode(objA)

== System.identityHashCode(objB)); // true

五、底层机制揭秘

- 存储位置:身份哈希码存储在对象头中

- 生成时机:首次调用

hashCode()或identityHashCode()时生成 - 计算规则:通常基于内存地址,但JVM会优化(非直接地址)

- 不变性:一旦生成,在对象生命周期内永不改变

六、总结与最佳实践

| 方法 | 选用原则 |

|---|---|

Object.hashCode() | 需要基于对象内容的哈希逻辑时使用 |

System.identityHashCode() | 需要对象身份标识时使用 |

黄金准则:

- 当对象作为

HashMap等内容敏感容器的键时 → 重写hashCode()+equals() - 当需要对象身份标识(如调试、

IdentityHashMap)时 → 使用identityHashCode() - 永远不要在重写的

hashCode()中调用identityHashCode(),这违反哈希契约!

通过合理选择这两种哈希码,可以避免常见的

HashMap逻辑错误和身份混淆问题。理解它们的差异,将使你的Java代码更加健壮高效!

来源:juejin.cn/post/7519797197925367818

别再说你会 new Object() 了!JVM 类加载的真相,绝对和你想的不一样

当我们编写

new Object()时,JVM 背后到底发生了怎样的故事?类加载过程中的初始化阶段究竟暗藏哪些玄机?

一、引言:从一段简单代码说起

先来看一个看似简单的 Java 代码片段:

public class HelloWorld {

public static void main(String[] args) {

System.out.println("Hello, World!");

}

}

当我们执行这段代码时,背后却隐藏着 JVM 复杂的类加载机制。.java 文件经过编译变成 .class 字节码文件,这些"静态"的字节码需要被 JVM 动态地加载、处理并最终执行。这就是类加载过程的神奇之处。

类加载机制是 Java 语言的核心基石,它赋予了 Java "一次编写,到处运行" 的能力。理解这一过程,不仅能帮助我们编写更高效的代码,更是面试中的高频考点。

二、类生命周期:七个阶段的完整旅程

在深入类加载过程之前,我们先来了解类的完整生命周期。一个类在 JVM 中从加载到卸载,总共经历七个阶段:

| 阶段 | 描述 | 是否必须 | 特点 | JVM规范要求 |

|---|---|---|---|---|

| 加载(Loading) | 查找并加载类的二进制数据 | 是 | 将字节码读入内存,生成Class对象 | 强制 |

| 验证(Verification) | 确保被加载的类正确无误 | 是 | 安全验证,防止恶意代码 | 强制 |

| 准备(Preparation) | 为类变量分配内存并设置初始零值 | 是 | 注意:不是程序员定义的初始值 | 强制 |

| 解析(Resolution) | 将符号引用转换为直接引用 | 否 | 可以在初始化后再进行 | 可选 |

| 初始化(Initialization) | 执行类构造器 <clinit>() 方法 | 是 | 初始化类而不是对象 | 强制 |

| 使用(Using) | 正常使用类的功能 | 是 | 类的使命阶段 | - |

| 卸载(Unloading) | 从内存中释放类数据 | 否 | 由垃圾回收器负责 | 可选 |

前五个阶段(加载、验证、准备、解析、初始化)统称为类加载过程。

三、类加载过程的五个步骤详解

3.1 加载阶段:寻找类的旅程

加载阶段是类加载过程的起点,主要完成三件事情:

- 通过类的全限定名获取定义此类的二进制字节流

- 将这个字节流所代表的静态存储结构转换为方法区的运行时数据结构

- 在内存中生成一个代表这个类的

java.lang.Class对象,作为方法区这个类的各种数据的访问入口

// 示例:不同的类加载方式

public class LoadingExample {

public static void main(String[] args) throws Exception {

// 通过类加载器加载

Class<?> clazz1 = ClassLoader.getSystemClassLoader().loadClass("java.lang.String");

// 通过Class.forName加载(默认会初始化)

Class<?> clazz2 = Class.forName("java.lang.String");

// 通过字面常量获取(不会触发初始化)

Class<?> clazz3 = String.class;

System.out.println("三种方式加载的类是否相同: " +

(clazz1 == clazz2 && clazz2 == clazz3));

}

}

3.2 验证阶段:安全的第一道防线

验证阶段确保 Class 文件的字节流中包含的信息符合《Java虚拟机规范》的全部约束要求,保证这些信息不会危害虚拟机自身的安全。

| 验证类型 | 验证内容 | 失败后果 |

|---|---|---|

| 文件格式验证 | 魔数(0xCAFEBABE)、版本号、常量池 | ClassFormatError |

| 元数据验证 | 语义验证、继承关系(如是否实现抽象方法) | IncompatibleClassChangeError |

| 字节码验证 | 逻辑验证、跳转指令合法性 | VerifyError |

| 符号引用验证 | 引用真实性、访问权限(如访问private方法) | NoSuchFieldError、NoSuchMethodError |

3.3 准备阶段:零值初始化的奥秘

这是最容易产生误解的阶段! 在准备阶段,JVM 为**类变量(static变量)**分配内存并设置初始零值,注意这不是程序员定义的初始值。

public class PreparationExample {

// 准备阶段后 value = 0,而不是 100

public static int value = 100;

// 准备阶段后 constantValue = 200(因为有final修饰)

public static final int constantValue = 200;

// 实例变量 - 准备阶段完全不管

public int instanceValue = 300;

}

各种数据类型的零值对照表:

| 数据类型 | 零值 | 数据类型 | 零值 |

|---|---|---|---|

| int | 0 | boolean | false |

| long | 0L | float | 0.0f |

| double | 0.0 | char | '\u0000' |

| 引用类型 | null | short | (short)0 |

关键区别:只有**类变量(static变量)**在准备阶段分配内存和初始化零值,实例变量会在对象实例化时随对象一起分配在堆内存中。

3.4 解析阶段:符号引用到直接引用的转换

解析阶段是虚拟机将常量池内的符号引用替换为直接引用的过程。这个过程可以在初始化之后再进行,这是为了支持Java的动态绑定特性。

解析主要针对以下四类符号引用:

| 引用类型 | 解析目标 | 可能抛出的异常 |

|---|---|---|

| 类/接口解析 | 将符号引用解析为具体类/接口 | NoClassDefFoundError |

| 字段解析 | 解析字段所属的类/接口 | NoSuchFieldError |

| 方法解析 | 解析方法所属的类/接口 | NoSuchMethodError |

| 接口方法解析 | 解析接口方法所属的接口 | AbstractMethodError |

3.5 初始化阶段:执行类构造器 <clinit>()

这是类加载过程的最后一步,也是真正开始执行类中定义的Java程序代码的一步。

JVM规范严格规定的六种初始化触发情况:

- 遇到new、getstatic、putstatic或invokestatic这四条字节码指令时

// new指令 - 创建类的实例

Object obj = new Object();

// getstatic指令 - 读取类的静态字段

int value = MyClass.staticField;

// putstatic指令 - 设置类的静态字段

MyClass.staticField = 100;

// invokestatic指令 - 调用类的静态方法

MyClass.staticMethod();

- 使用java.lang.reflect包的方法对类进行反射调用时

// 反射调用会触发类的初始化

Class<?> clazz = Class.forName("com.example.MyClass");

- 当初始化一个类时,发现其父类还没有进行过初始化

class Parent {

static { System.out.println("Parent初始化"); }

}

class Child extends Parent {

static { System.out.println("Child初始化"); }

}

// 初始化Child时会先初始化Parent

- 虚拟机启动时,用户指定的主类(包含main()方法的那个类)

// 执行 java MyApp 时,MyApp类会被初始化

public class MyApp {

public static void main(String[] args) {

System.out.println("应用程序启动");

}

}

- 使用JDK7新加入的动态语言支持时

// 使用MethodHandle等动态语言特性

MethodHandles.Lookup lookup = MethodHandles.lookup();

- 一个接口中定义了JDK8新加入的默认方法时,如果这个接口的实现类发生了初始化,要先将接口进行初始化

interface MyInterface {

// JDK8默认方法会触发接口初始化

default void defaultMethod() {

System.out.println("默认方法");

}

}

3.6 使用阶段:类的使命实现

当类完成初始化后,就进入了使用阶段。这是类生命周期中最长的阶段,类的所有功能都可以正常使用:

public class UsageStageExample {

public static void main(String[] args) {

// 类已完成初始化,进入使用阶段

MyClass obj = new MyClass(); // 创建对象实例

obj.instanceMethod(); // 调用实例方法

MyClass.staticMethod(); // 调用静态方法

int value = MyClass.staticVar;// 访问静态变量

}

}

class MyClass {

public static int staticVar = 100;

public int instanceVar = 200;

public static void staticMethod() {

System.out.println("静态方法");

}

public void instanceMethod() {

System.out.println("实例方法");

}

}

在使用阶段,类可以:

- 创建对象实例

- 调用静态方法和实例方法

- 访问和修改静态字段和实例字段

- 被其他类引用和继承

3.7 卸载阶段:生命的终结

类的卸载是生命周期的最后阶段,但并不是必须发生的。一个类被卸载需要满足以下条件:

- 该类所有的实例都已被垃圾回收

- 加载该类的ClassLoader已被垃圾回收

- 该类对应的java.lang.Class对象没有被任何地方引用

public class UnloadingExample {

public static void main(String[] args) throws Exception {

// 使用自定义类加载器加载类

CustomClassLoader loader = new CustomClassLoader();

Class<?> clazz = loader.loadClass("com.example.TemporaryClass");

// 创建实例并使用

Object instance = clazz.newInstance();

System.out.println("类已加载并使用: " + clazz.getName());

// 解除所有引用,使类和类加载器可被回收

clazz = null;

instance = null;

loader = null;

// 触发GC,可能卸载类

System.gc();

System.out.println("类和类加载器可能已被卸载");

}

}

class CustomClassLoader extends ClassLoader {

// 自定义类加载器实现

}

所以,在 JVM 生命周期内,由 jvm 自带的类加载器加载的类是不会被卸载的。但是由我们自定义的类加载器加载的类是可能被卸载的。

四、关键辨析:类初始化 vs. 对象实例化

这是本文的核心观点,也是大多数开发者容易混淆的概念。让我们通过一个对比表格来清晰区分:

| 特性 | 类初始化 (Initialization) | 对象实例化 (Instantiation) |

|---|---|---|

| 触发时机 | 类被首次"主动使用"时(JVM控制) | 遇到new关键字时(程序员控制) |

| 发生次数 | 一次(每个类加载器范围内) | 多次(可以创建多个对象实例) |

| 核心方法 | <clinit>()方法 | <init>()方法(构造函数) |

| 操作目标 | 类本身(初始化静态变量/类变量) | 对象实例(初始化实例变量) |

| 内存区域 | 方法区(元空间) | Java堆 |

| 执行内容 | 静态变量赋值、静态代码块 | 实例变量赋值、实例代码块、构造函数 |

public class InitializationVsInstantiation {

// 类变量 - 在<clinit>()方法中初始化

public static String staticField = initStaticField();

// 实例变量 - 在<init>()方法中初始化

public String instanceField = initInstanceField();

// 静态代码块 - 在<clinit>()方法中执行

static {

System.out.println("静态代码块执行");

}

// 实例代码块 - 在<init>()方法中执行

{

System.out.println("实例代码块执行");

}

public InitializationVsInstantiation() {

System.out.println("构造方法执行");

}

private static String initStaticField() {

System.out.println("静态变量初始化");

return "static value";

}

private String initInstanceField() {

System.out.println("实例变量初始化");

return "instance value";

}

public static void main(String[] args) {

System.out.println("=== 第一次创建对象 ===");

new InitializationVsInstantiation();

System.out.println("\n=== 第二次创建对象 ===");

new InitializationVsInstantiation();

}

}

输出结果:

静态变量初始化

静态代码块执行

=== 第一次创建对象 ===

实例变量初始化

实例代码块执行

构造方法执行

=== 第二次创建对象 ===

实例变量初始化

实例代码块执行

构造方法执行

五、深度实战:初始化顺序全面解析

现在,让我们通过一个综合示例来回答开篇的思考题:如果一个类同时包含静态变量、静态代码块、实例变量、实例代码块和构造方法,它们的执行顺序是怎样的?在存在继承关系时又会如何变化?

5.1 单类初始化顺序

public class InitializationOrder {

// 静态变量

public static String staticField = "静态变量";

// 静态代码块

static {

System.out.println(staticField);

System.out.println("静态代码块");

}

// 实例变量

public String field = "实例变量";

// 实例代码块

{

System.out.println(field);

System.out.println("实例代码块");

}

// 构造方法

public InitializationOrder() {

System.out.println("构造方法");

}

public static void main(String[] args) {

System.out.println("第一次实例化:");

new InitializationOrder();

System.out.println("\n第二次实例化:");

new InitializationOrder();

}

}

输出结果:

静态变量

静态代码块

第一次实例化:

实例变量

实例代码块

构造方法

第二次实例化:

实例变量

实例代码块

构造方法

关键发现:

- 静态代码块只在类第一次加载时执行一次

- 实例代码块在每次创建对象时都会执行

- 执行顺序:静态变量/代码块 → 实例变量/代码块 → 构造方法

5.2 继承关系下的初始化顺序

class Parent {

// 父类静态变量

public static String parentStaticField = "父类静态变量";

// 父类静态代码块

static {

System.out.println(parentStaticField);

System.out.println("父类静态代码块");

}

// 父类实例变量

public String parentField = "父类实例变量";

// 父类实例代码块

{

System.out.println(parentField);

System.out.println("父类实例代码块");

}

// 父类构造方法

public Parent() {

System.out.println("父类构造方法");

}

}

class Child extends Parent {

// 子类静态变量

public static String childStaticField = "子类静态变量";

// 子类静态代码块

static {

System.out.println(childStaticField);

System.out.println("子类静态代码块");

}

// 子类实例变量

public String childField = "子类实例变量";

// 子类实例代码块

{

System.out.println(childField);

System.out.println("子类实例代码块");

}

// 子类构造方法

public Child() {

System.out.println("子类构造方法");

}

public static void main(String[] args) {

System.out.println("第一次实例化子类:");

new Child();

System.out.println("\n第二次实例化子类:");

new Child();

}

}

输出结果:

父类静态变量

父类静态代码块

子类静态变量

子类静态代码块

第一次实例化子类:

父类实例变量

父类实例代码块

父类构造方法

子类实例变量

子类实例代码块

子类构造方法

第二次实例化子类:

父类实例变量

父类实例代码块

父类构造方法

子类实例变量

子类实例代码块

子类构造方法

关键发现:

- 父类静态代码块 → 子类静态代码块 → 父类实例代码块 → 父类构造方法 → 子类实例代码块 → 子类构造方法

- 静态代码块只执行一次,实例代码块每次创建对象都执行

- 父类优先于子类初始化

5.3 进阶案例:包含静态变量初始化的复杂情况

public class ComplexInitialization {

public static ComplexInitialization instance = new ComplexInitialization();

public static int staticVar = 100;

public int instanceVar = 200;

static {

System.out.println("静态代码块: staticVar=" + staticVar);

}

{

System.out.println("实例代码块: instanceVar=" + instanceVar + ", staticVar=" + staticVar);

}

public ComplexInitialization() {

System.out.println("构造方法: instanceVar=" + instanceVar + ", staticVar=" + staticVar);

}

public static void main(String[] args) {

System.out.println("main方法开始");

new ComplexInitialization();

}

}

输出结果:

实例代码块: instanceVar=200, staticVar=0

构造方法: instanceVar=200, staticVar=0

静态代码块: staticVar=100

main方法开始

实例代码块: instanceVar=200, staticVar=100

构造方法: instanceVar=200, staticVar=100

关键发现:

- 静态变量

staticVar在准备阶段被初始化为0 - 在初始化阶段,按顺序执行静态变量赋值和静态代码块

- 当执行

instance = new ComplexInitialization()时,staticVar还未被赋值为100(还是0) - 这解释了为什么第一次输出时

staticVar=0

六、面试常见问题与解答

6.1 高频面试题解析

Q1: 下面代码的输出结果是什么?为什么?

public class InterviewQuestion {

public static void main(String[] args) {

System.out.println(Child.value);

}

}

class Parent {

static int value = 100;

static { System.out.println("Parent静态代码块"); }

}

class Child extends Parent {

static { System.out.println("Child静态代码块"); }

}

A: 输出结果为:

Parent静态代码块

100

解析: 通过子类引用父类的静态字段,不会导致子类初始化,这是类加载机制的一个重要特性。

Q2: 接口的初始化与类有什么不同?

A: 接口的初始化与类类似,但有重要区别:

- 接口也有

<clinit>()方法,由编译器自动生成 - 接口初始化时不需要先初始化父接口

- 只有当程序首次使用接口中定义的非常量字段时,才会初始化接口

6.2 类加载机制的实际应用

1. 单例模式的优雅实现:

public class Singleton {

private Singleton() {}

private static class SingletonHolder {

static {

System.out.println("SingletonHolder初始化");

}

private static final Singleton INSTANCE = new Singleton();

}

public static Singleton getInstance() {

return SingletonHolder.INSTANCE;

}

}

这种实现利用了类加载机制的特性:只有在真正调用 getInstance() 时才会加载 SingletonHolder 类,实现了懒加载且线程安全。

2. 常量传播优化:

public class ConstantExample {

public static final String CONSTANT = "Hello";

public static void main(String[] args) {

System.out.println(CONSTANT);

}

}

编译时,常量 CONSTANT 的值会被直接内联到使用处,不会触发类的初始化。

七、总结与思考

通过本文的深入分析,我们可以总结出以下几个关键点:

- 类加载过程五个阶段:加载 → 验证 → 准备 → 解析 → 初始化,每个阶段都有其特定任务

- 关键区别:

- 初始化阶段是初始化类(执行

<clinit>()),而不是初始化对象(执行<init>()) - 类静态变量在准备阶段分配内存并设置零值,在初始化阶段赋实际值

- 实例变量在对象实例化时分配内存和初始化

- 初始化阶段是初始化类(执行

- 初始化顺序原则:

- 父类优先于子类

- 静态优先于实例

- 变量定义顺序决定初始化顺序

- 实际应用:理解类加载机制有助于我们编写更高效的代码,如实现懒加载的单例模式、理解常量内联优化等

希望本文能帮助你深入理解JVM类加载机制,下次遇到相关面试题时,相信你一定能游刃有余!

来源:juejin.cn/post/7541339617489797163

计算初始化内存总长度

计算初始化内存总长度

问题背景

在一个系统中,需要执行一系列的内存初始化操作。每次操作都会初始化一个特定地址范围的内存。这些操作范围可能会相互重叠。我们需要计算所有操作完成后,被初始化过的内存空间的总长度。

核心定义

- 操作范围: 每一次内存初始化操作由一个范围

[start, end]定义,它代表一个左闭右开的区间[start, end)。这意味着地址start被包含,而地址end不被包含。 - 内存长度: 对于一个操作

[start, end],其初始化的内存长度为end - start。

关键假设

- 所有初始化操作都会成功执行。

- 同一块内存区域允许被重复初始化。例如,操作

[2, 5)和[4, 7)是允许的,它们有重叠部分[4, 5)。

任务要求

给定一组内存初始化操作 cmdsOfMemInit,计算所有操作完成后,被初始化过的内存空间的总长度。这等同于计算所有给定区间的并集的总长度。

输入格式

cmdsOfMemInit: 一个二维数组(或列表的列表),代表一系列的内存初始化操作。

- 数组长度:

1 <= cmdsOfMemInit.length <= 100000 - 每个元素

cmdsOfMemInit[i]是一个包含两个整数[start, end]的数组。 - 区间范围:

0 <= start < end <= 10^9

- 数组长度:

输出格式

- 一个整数,表示最终被初始化过的内存空间的总长度。

样例说明

样例 1

- 输入:

[[2, 4], [3, 7], [4, 6]] - 输出:

5 - 解释:

- 我们有三个区间:

[2, 4),[3, 7),[4, 6)。 - 合并

[2, 4)和[3, 7): 因为它们有重叠部分([3, 4)),所以可以合并成一个更大的区间[2, 7)。 - 合并

[2, 7)和[4, 6): 新的区间[4, 6)完全被[2, 7)覆盖。合并后的结果仍然是[2, 7)。 - 所有操作完成后,最终被初始化的内存区域是

[2, 7)。 - 总长度为

7 - 2 = 5。

- 我们有三个区间:

样例 2

- 输入:

[[3, 7], [2, 4], [10, 30]] - 输出:

25 - 解释:

- 我们有三个区间:

[3, 7),[2, 4),[10, 30)。 - 合并

[3, 7)和[2, 4): 它们有重叠部分,合并后的区间为[2, 7)。 - 合并

[2, 7)和[10, 30): 这两个区间没有重叠,因为10大于7。它们是两个独立的初始化区域。 - 所有操作完成后,最终的初始化内存区域由两个不相交的区间组成:

[2, 7)和[10, 30)。 - 总长度是这两个独立区间长度之和:

(7 - 2) + (30 - 10) = 5 + 20 = 25。

- 我们有三个区间:

import java.util.ArrayList;

import java.util.Arrays;

import java.util.Comparator;

import java.util.List;

/**

* 解决“内存空间长度”问题的方案类。

*/

public class Solution {

/**

* 计算一系列内存初始化操作覆盖的总内存空间长度。

*

* @param cmdsOfMemInit 一个二维数组,每个内部数组 [start, end] 代表一个左闭右开的内存初始化区间。

* @return 最终初始化的内存空间的总长度。

*/

public long totalInitializedLength(int[][] cmdsOfMemInit) {

// --- 1. 处理边界情况 ---

// 如果输入为空或没有操作,则总长度为 0。

if (cmdsOfMemInit == null || cmdsOfMemInit.length == 0) {

return 0;

}

// --- 2. 按区间的起始地址(start)对所有操作进行升序排序 ---

// 这是合并区间的关键前提步骤。

// Comparator.comparingInt(a -> a[0]) 是一个简洁的写法,表示按内部数组a的第一个元素排序。

Arrays.sort(cmdsOfMemInit, Comparator.comparingInt(a -> a[0]));

// --- 3. 合并重叠和连续的区间 ---

// 使用一个 List 来存储合并后的、不重叠的区间。

List<int[]> mergedIntervals = new ArrayList<>();

// 首先将第一个区间(起始地址最小)加入合并列表作为基础。

mergedIntervals.add(cmdsOfMemInit[0]);

// 遍历排序后的其余区间

for (int i = 1; i < cmdsOfMemInit.length; i++) {

int[] currentInterval = cmdsOfMemInit[i];

// 获取合并列表中的最后一个区间,用于比较

int[] lastMerged = mergedIntervals.get(mergedIntervals.size() - 1);

// 检查当前区间是否与最后一个合并区间重叠或连续。

// 因为区间是 [start, end) 左闭右开,所以当 currentInterval 的 start <= lastMerged 的 end 时,

// 它们就需要合并。例如 [2,4) 和 [4,6) 应该合并为 [2,6)。

if (currentInterval[0] <= lastMerged[1]) {

// --- 合并区间 ---

// 如果有重叠/连续,则更新最后一个合并区间的结束地址。

// 新的结束地址是两个区间结束地址中的较大者。

// 例如,合并 [2,7) 和 [4,6) 时,新的 end 是 max(7, 6) = 7,结果为 [2,7)。

lastMerged[1] = Math.max(lastMerged[1], currentInterval[1]);

} else {

// --- 不重叠,添加新区间 ---

// 如果没有重叠,则将当前区间作为一个新的、独立的合并区间添加到列表中。

mergedIntervals.add(currentInterval);

}

}

// --- 4. 计算合并后区间的总长度 ---

// 使用 long 类型来存储总长度,防止因数值过大(坐标可达10^9)而溢出。

long totalLength = 0;

// 遍历所有不重叠的合并区间

for (int[] interval : mergedIntervals) {

// 累加每个区间的长度 (end - start)

totalLength += (long) interval[1] - interval[0];

}

// --- 5. 返回结果 ---

return totalLength;

}

public static void main(String[] args) {

Solution sol = new Solution();

// 样例1

int[][] cmds1 = {{2, 4}, {3, 7}, {4, 6}};

System.out.println("样例1 输入: [[2, 4], [3, 7], [4, 6]]");

System.out.println("样例1 输出: " + sol.totalInitializedLength(cmds1)); // 预期: 5

// 样例2

int[][] cmds2 = {{3, 7}, {2, 4}, {10, 30}};

System.out.println("\n样例2 输入: [[3, 7], [2, 4], [10, 30]]");

System.out.println("样例2 输出: " + sol.totalInitializedLength(cmds2)); // 预期: 25

// 边界测试

int[][] cmds3 = {{1, 5}, {6, 10}};

System.out.println("\n边界测试 输入: [[1, 5], [6, 10]]");

System.out.println("边界测试 输出: " + sol.totalInitializedLength(cmds3)); // 预期: 8 (4+4)

}

*/

}

来源:juejin.cn/post/7527154276223336488

JMeter 多台压力机分布式测试(Windows)

JMeter 多台压力机分布式测试(Windows)

1. 背景

- 在单台压力机运行时,出现了端口冲突问题,如

JMeter port already in use。 - 压力机机器权限限制,无法修改默认端口配置。

- 为避免端口冲突且提升压力机的压力能力,考虑使用多台机器(多台JMeter压力机)分布式压测。

2.环境说明

- Master IP:

192.20.10.7 - Slave1 IP:

192.20.10.8 - Slave2 IP:

192.20.10.9 - JMeter版本均为 5.5

- Java版本均为 1.8+

- 网络可互通,防火墙端口放通

- RMI 注册端口:1099

- RMI 远程对象端口:50000(默认,可配置)

3. Master 节点配置

3.1 修改 jmeter.properties (JMETER_HOME/bin/jmeter.properties)

properties复制# 远程主机列表,逗号分隔

remote_hosts=192.20.10.8,192.20.10.9

# 禁用RMI SSL,避免额外复杂度

server.rmi.ssl.disable=true

# Master的回调地址,设置为本机可达IP(用于Slave回调)

client.rmi.localhostname=192.20.10.7

# 关闭插件联网上报,提升启动速度

jmeter.pluginmanager.report_stats=false

2.2 启动 JMeter GUI

- 直接运行

jmeter.bat打开GUI - 加载测试脚本(

*.jmx) - 确认脚本和依赖文件已同步到所有Slave节点同路径

3. Slave 节点配置(192.20.10.8 和 192.20.10.9)

3.1 修改各自的 jmeter.properties (JMETER_HOME/bin/jmeter.properties)

Slave1(192.20.10.8):

# 远程RMI服务监听端口

server_port=1099

# RMI通信本地端口(避免冲突,Slave1用50000)

server.rmi.localport=50000

# 禁用RMI SSL

server.rmi.ssl.disable=true

# 远程机器回调绑定IP(本机IP)

java.rmi.server.hostname=192.20.10.8

# 关闭插件联网上报

jmeter.pluginmanager.report_stats=false

Slave2(192.20.10.9):

server_port=1099

server.rmi.localport=50001

server.rmi.ssl.disable=true

java.rmi.server.hostname=192.20.10.9

jmeter.pluginmanager.report_stats=false

3.2 启动Slave服务

在每台Slave机器的 bin 目录,执行:

set JVM_ARGS=-Djava.rmi.server.hostname=192.20.10.8 #可选配置

jmeter-server.bat

(Slave2替换IP为 192.20.10.9)

看到类似 Using local port: 50002 Created remote object: UnicastServerRef2 [liveRef:XXXX 表示启动成功。

如启动异常,可以打开jmeter-server.log查看日志。

3.2 验证监听端口

netstat -an | findstr 1099

TCP 0.0.0.0:1099 0.0.0.0:0 LISTENING

TCP [::]:1099 [::]:0 LISTENING

netstat -an | findstr 50002

TCP 0.0.0.0:50002 0.0.0.0:0 LISTENING

TCP [::]:50002 [::]:0 LISTENING

4. 测试执行流程

- 确保Master和所有Slave机器的JMeter和Java版本一致。

- 确保测试脚本和依赖文件(如CSV等)在所有Slave路径相同。

- 启动所有Slave的

jmeter-server.bat,确保端口监听正常。 - 在Master GUI加载脚本。

- 点击菜单

Run -> Remote Start 或 Remote Start All,Master向所有Slave发起远程测试。 11.JMeter GUI的日志样例如下:

INFO o.a.j.e.ClientJMeterEngine: Sending properties {}

o.a.j.e.ClientJMeterEngine: sent run command to

o.a.j.e.DistributedRunner: Remote engines have been started

o.a.j.g.u.JMeterMenuBar: setRunning

o.a.j.g.u.JMeterMenuBar: setRunning

jmeter-server.bat的日志如下,出现如下字段

Starting the test on host ...

Finished the test on host ...

- Master GUI的 Listener(Summary Report等)会显示所有Slave合并的结果。

5. 其他注意事项

- 防火墙放通Master和Slave的

server_port(1099)、server.rmi.localport端口。 - Master

client.rmi.localhostname必须是Slave可访问的Master IP。 - 禁用插件联网统计,避免卡顿。

- 避免使用重型监听器,使用轻量级监听器提升性能。

来源:juejin.cn/post/7530141922499149862

Spring高级开发:状态机/事件/插件

Spring 状态机与事件机制插件开发示例

我将为您演示一个完整的 Spring 状态机实现,包含状态机配置、事件机制和可扩展的插件体系。以下是一个订单处理系统的示例:

1. 添加依赖(pom.xml)

<dependencies>

<!-- Spring State Machine -->

<dependency>

<groupId>org.springframework.statemachine</groupId>

<artifactId>spring-statemachine-starter</artifactId>

<version>4.2.0</version>

</dependency>

<!-- Spring Event 相关 -->

<dependency>

<groupId>org.springframework</groupId>

<artifactId>spring-context-support</artifactId>

<version>6.0.9</version>

</dependency>

</dependencies>

2. 定义核心接口和类

2.1 状态和事件枚举

// 状态枚举

public enum OrderState {

NEW,

PAYMENT_PENDING,

PAID,

SHIPPED,

DELIVERED,

CANCELLED

}

// 事件枚举

public enum OrderEvent {

CREATE_ORDER,

INITIATE_PAYMENT,

PAYMENT_COMPLETED,

SHIP_ORDER,

DELIVERY_CONFIRMED,

CANCEL_ORDER

}

2.2 插件接口定义

// 状态变更监听器接口

public interface StateChangeListener {

void onStateChange(OrderState from, OrderState to, String orderId);

}

// 订单操作插件接口

public interface OrderOperationPlugin {

void execute(String orderId, OrderState currentState);

}

// 插件管理器接口

public interface PluginManager {

void registerStateChangeListener(StateChangeListener listener);

void notifyStateChange(OrderState from, OrderState to, String orderId);

void executePlugins(String orderId, OrderState currentState);

}

3. 实现状态机配置

@Configuration

@EnableStateMachine

public class OrderStateMachineConfig extends EnumStateMachineConfigurerAdapter<OrderState, OrderEvent> {

@Autowired

private List<OrderOperationPlugin> plugins;

@Override

public void configure(StateMachineStateConfigurer<OrderState, OrderEvent> states) throws Exception {

states

.withStates()

.initial(OrderState.NEW)

.state(OrderState.PAYMENT_PENDING)

.junction(OrderState.PAID)

.end(OrderState.DELIVERED)

.end(OrderState.CANCELLED)

.fork(OrderState.SHIPPED);

}

@Override

public void configure(StateMachineTransitionConfigurer<OrderState, OrderEvent> transitions) throws Exception {

transitions

.withExternal()

.source(OrderState.NEW).target(OrderState.PAYMENT_PENDING)

.event(OrderEvent.CREATE_ORDER)

.and().withExternal()

.source(OrderState.PAYMENT_PENDING).target(OrderState.PAID)

.event(OrderEvent.INITIATE_PAYMENT)

.and().withExternal()

.source(OrderState.PAID).target(OrderState.SHIPPED)

.event(OrderEvent.SHIP_ORDER)

.and().withExternal()

.source(OrderState.SHIPPED).target(OrderState.DELIVERED)

.event(OrderEvent.DELIVERY_CONFIRMED)

.and().withExternal()

.source(OrderState.NEW).target(OrderState.CANCELLED)

.event(OrderEvent.CANCEL_ORDER)

.and().withExternal()

.source(OrderState.PAYMENT_PENDING).target(OrderState.CANCELLED)

.event(OrderEvent.CANCEL_ORDER);

}

@Bean

public PluginManager pluginManager() {

return new DefaultPluginManager(plugins);

}

}

4. 插件实现

4.1 默认插件管理器

@Component

public class DefaultPluginManager implements PluginManager {

private final List<StateChangeListener> stateChangeListeners = new ArrayList<>();

private final List<OrderOperationPlugin> operationPlugins;

public DefaultPluginManager(List<OrderOperationPlugin> plugins) {

this.operationPlugins = plugins;

}

@Override

public void registerStateChangeListener(StateChangeListener listener) {

stateChangeListeners.add(listener);

}

@Override

public void notifyStateChange(OrderState from, OrderState to, String orderId) {

stateChangeListeners.forEach(listener -> listener.onStateChange(from, to, orderId));

}

@Override

public void executePlugins(String orderId, OrderState currentState) {

operationPlugins.forEach(plugin -> plugin.execute(orderId, currentState));

}

}

4.2 示例插件实现

// 日志记录插件

@Component

public class LoggingPlugin implements OrderOperationPlugin {

@Override

public void execute(String orderId, OrderState currentState) {

System.out.println("订单 " + orderId + " 当前状态: " + currentState + " - 正在记录日志");

}

}

// 邮件通知插件

@Component

public class EmailNotificationPlugin implements OrderOperationPlugin {

@Override

public void execute(String orderId, OrderState currentState) {

System.out.println("订单 " + orderId + " 当前状态: " + currentState + " - 发送邮件通知");

}

}

// 库存管理插件

@Component

public class InventoryUpdatePlugin implements OrderOperationPlugin {

@Override

public void execute(String orderId, OrderState currentState) {

if (currentState == OrderState.PAID) {

System.out.println("订单 " + orderId + " 已支付,正在更新库存");

}

}

}

5. 状态监听器实现

@Component

public class AuditStateChangeListener implements StateChangeListener {

@Override

public void onStateChange(OrderState from, OrderState to, String orderId) {

System.out.println("订单状态变更: " + orderId + " 从 " + from + " 到 " + to + " - 审计记录已创建");

}

}

6. 服务层实现

@Service

public class OrderService {

@Autowired

private StateMachine<OrderState, OrderEvent> stateMachine;

@Autowired

private PluginManager pluginManager;

public OrderService() {

// 注册监听器

pluginManager.registerStateChangeListener(new AuditStateChangeListener());

}

public void handleOrderEvent(String orderId, OrderEvent event) {

try {

stateMachine.start();

OrderState currentState = stateMachine.getState().getId();

// 发送事件

stateMachine.sendEvent(event);

OrderState newState = stateMachine.getState().getId();

// 触发状态变更监听器

if (currentState != newState) {

pluginManager.notifyStateChange(currentState, newState, orderId);

}

// 执行操作插件

pluginManager.executePlugins(orderId, newState);

} catch (Exception e) {

System.err.println("处理订单事件失败: " + e.getMessage());

} finally {

stateMachine.stop();

}

}

}

7. 控制器示例

@RestController

@RequestMapping("/orders")

public class OrderController {

@Autowired

private OrderService orderService;

@PostMapping("/{orderId}/events")

public ResponseEntity<String> sendEvent(@PathVariable String orderId, @RequestParam String event) {

try {

OrderEvent orderEvent = OrderEvent.valueOf(event.toUpperCase());

orderService.handleOrderEvent(orderId, orderEvent);

return ResponseEntity.ok("事件已处理: " + event);

} catch (IllegalArgumentException e) {

return ResponseEntity.badRequest().body("无效的事件类型: " + event);

}

}

@GetMapping("/{orderId}/status")

public ResponseEntity<String> checkStatus(@PathVariable String orderId) {

// 这里应该从存储中获取当前状态,为简化示例返回固定值

return ResponseEntity.ok("订单 " + orderId + " 当前状态: 示例状态");

}

}

8. 可扩展性说明

如何添加新插件:

@Component

public class NewFeaturePlugin implements OrderOperationPlugin {

@Override

public void execute(String orderId, OrderState currentState) {

// 新功能逻辑

}

}

如何添加新状态监听器:

@Component

public class NewStateChangeListener implements StateChangeListener {

@Override

public void onStateChange(OrderState from, OrderState to, String orderId) {

// 新监听器逻辑

}