纯C文件推理Llama 2

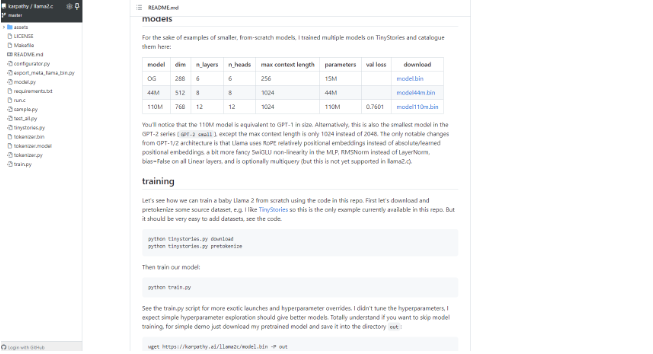

这段项目可以让你通过PyTorch从头开始训练Llama 2 LLM架构模型,然后将权重保存到一个原始二进制文件中,再将其加载到一个仅有500行的简单C文件(run.c)中,该文件推断模型,目前仅支持fp32。在作者的云Linux开发平台上,一个维度为288的6层6头模型(约15M个参数)推断速度约为每秒100个令牌;在M1 MacBook Air上推断速度也差不多。作者有些惊喜地发现,采用这种简单方法,可以以高度交互的速度运行相当大的模型(几千万个参数)。

参考文献:

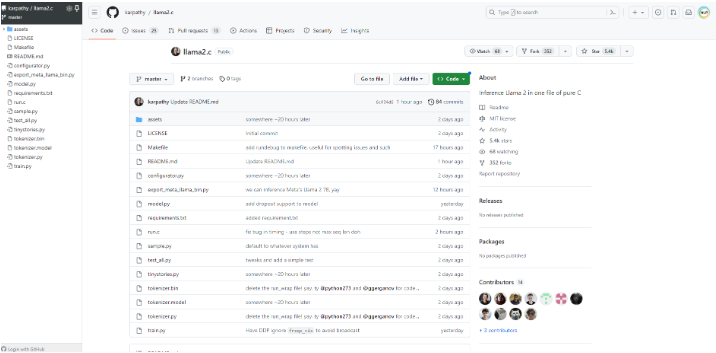

https://github.com/karpathy/llama2.c

作者:阿升

来源:mdnice.com/writing/6f98f171b14e4050bf627afe59ccb82a

来源:mdnice.com/writing/6f98f171b14e4050bf627afe59ccb82a