实战指导:Ceph存储性能优化总结

最近一直在忙着搞Ceph存储的优化和测试,看了各种资料,但是好像没有一篇文章把其中的方法论交代清楚,所以下文只是一个经验总结,拿出来与大家分享下。

一:优化方法论

做任何事情还是要有个方法论的,“授人以鱼不如授人以渔”的道理吧,方法通了,所有的问题就有了解决的途径。通过对公开资料的分析进行总结,对分布式存储系统的优化离不开以下几点:

1. 硬件层面

这一点具体实现待补充!!!

2. Ceph Configurations

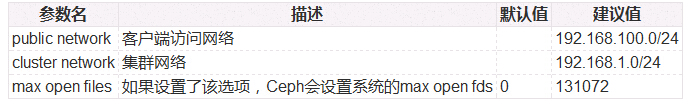

[global]

查看系统最大文件打开数可以使用命令

调整omap的原因主要是EXT4文件系统默认仅有4K

filestore queue相关的参数对于性能影响很小,参数调整不会对性能优化有本质上提升

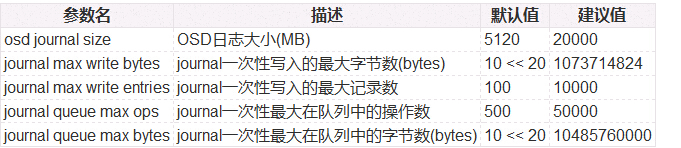

[osd] - journal

[osd] - journal

Ceph OSD Daemon stops writes and synchronizes the journal with the filesystem, allowing Ceph OSD Daemons to trim operations from the journal and reuse the space.

上面这段话的意思就是,Ceph OSD进程在往数据盘上刷数据的过程中,是停止写操作的。

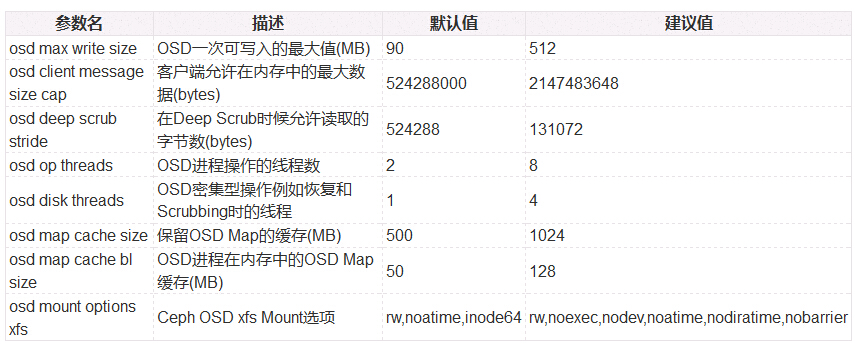

[osd] - osd config tuning

增加osd op threads和disk threads会带来额外的CPU开销

[osd] - recovery tuning

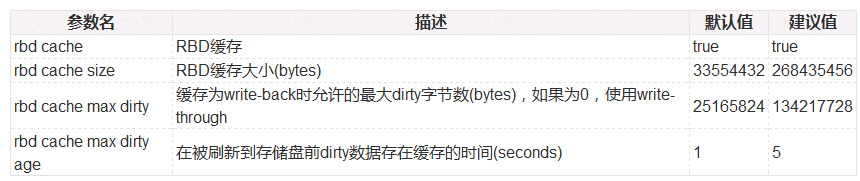

[osd] - client tuning

关闭Debug

三: PG Number

PG和PGP数量一定要根据OSD的数量进行调整,计算公式如下,但是最后算出的结果一定要接近或者等于一个2的指数。

CRUSH是一个非常灵活的方式,CRUSH MAP的调整取决于部署的具体环境,这个可能需要根据具体情况进行分析,这里面就不再赘述了。

5. 其他因素的影响

在今年的(2015年)的Ceph Day上,海云捷迅在调优过程中分享过一个由于在集群中存在一个性能不好的磁盘,导致整个集群性能下降的case。通过osd perf可以提供磁盘latency的状况,同时在运维过程中也可以作为监控的一个重要指标,很明显在下面的例子中,OSD 8的磁盘延时较长,所以需要考虑将该OSD剔除出集群:

优化是一个长期迭代的过程,所有的方法都是别人的,只有在实践过程中才能发现自己的,本篇文章仅仅是一个开始,欢迎各位积极补充,共同完成一篇具有指导性的文章。

作者:xiaoquqi

一:优化方法论

做任何事情还是要有个方法论的,“授人以鱼不如授人以渔”的道理吧,方法通了,所有的问题就有了解决的途径。通过对公开资料的分析进行总结,对分布式存储系统的优化离不开以下几点:

1. 硬件层面

- 硬件规划

- SSD选择

- BIOS设置

- Linux OS

- Ceph Configurations

- PG Number调整

- CRUSH Map

- 其他因素

- Processor

- 内存

- 网络规划

- Hyper-Threading(HT)

- 关闭节能

for CPUFREQ in /sys/devices/system/cpu/cpu*/cpufreq/scaling_governor; do [ -f $CPUFREQ ] || continue; echo -n performance > $CPUFREQ; done - NUMA

kernel /vmlinuz-2.6.32-504.12.2.el6.x86_64 ro root=UUID=870d47f8-0357-4a32-909f-74173a9f0633 rd_NO_LUKS rd_NO_LVM LANG=en_US.UTF-8 rd_NO_MD SYSFONT=latarcyrheb-sun16 crashkernel=auto KEYBOARDTYPE=pc KEYTABLE=us rd_NO_DM biosdevname=0 numa=off二:软件优化 1. Linux OS

- Kernel pid max

echo 4194303 > /proc/sys/kernel/pid_maxJumbo frames, 交换机端需要支持该功能,系统网卡设置才有效果

ifconfig eth0 mtu 9000永久设置

echo "MTU=9000" | tee -a /etc/sysconfig/network-script/ifcfg-eth0 2./etc/init.d/networking restartread_ahead, 通过数据预读并且记载到随机访问内存方式提高磁盘读操作,查看默认值

cat /sys/block/sda/queue/read_ahead_kb根据一些Ceph的公开分享,8192是比较理想的值

echo "8192" > /sys/block/sda/queue/read_ahead_kbswappiness, 主要控制系统对swap的使用,这个参数的调整最先见于UnitedStack公开的文档中,猜测调整的原因主要是使用swap会影响系统的性能。

echo "vm.swappiness = 0" | tee -a /etc/sysctl.confI/O Scheduler,关于I/O Scheculder的调整网上已经有很多资料,这里不再赘述,简单说SSD要用noop,SATA/SAS使用deadline。

echo "deadline" > /sys/block/sd[x]/queue/scheduler 2.echo "noop" > /sys/block/sd[x]/queue/schedulercgroup这方面的文章好像比较少,昨天在和Ceph社区交流过程中,Jan Schermer说准备把生产环境中的一些脚本贡献出来,但是暂时还没有,他同时也列举了一些使用cgroup进行隔离的原因。

- 不在process和thread在不同的core上移动(更好的缓存利用)

- 减少NUMA的影响

- 网络和存储控制器影响 - 较小

- 通过限制cpuset来限制Linux调度域(不确定是不是重要但是是最佳实践)

- 如果开启了HT,可能会造成OSD在thread1上,KVM在thread2上,并且是同一个core。Core的延迟和性能取决于其他一个线程做什么。

这一点具体实现待补充!!!

2. Ceph Configurations

[global]

查看系统最大文件打开数可以使用命令

调整omap的原因主要是EXT4文件系统默认仅有4K

filestore queue相关的参数对于性能影响很小,参数调整不会对性能优化有本质上提升

[osd] - journal

[osd] - journal

Ceph OSD Daemon stops writes and synchronizes the journal with the filesystem, allowing Ceph OSD Daemons to trim operations from the journal and reuse the space.

上面这段话的意思就是,Ceph OSD进程在往数据盘上刷数据的过程中,是停止写操作的。

[osd] - osd config tuning

增加osd op threads和disk threads会带来额外的CPU开销

[osd] - recovery tuning

[osd] - client tuning

关闭Debug

三: PG Number

PG和PGP数量一定要根据OSD的数量进行调整,计算公式如下,但是最后算出的结果一定要接近或者等于一个2的指数。

Total PGs = (Total_number_of_OSD * 100) / max_replication_count例如15个OSD,副本数为3的情况下,根据公式计算的结果应该为500,最接近512,所以需要设定该pool(volumes)的pg_num和pgp_num都为512.

ceph osd pool set volumes pg_num 5124. CRUSH Map

2.ceph osd pool set volumes pgp_num 512

CRUSH是一个非常灵活的方式,CRUSH MAP的调整取决于部署的具体环境,这个可能需要根据具体情况进行分析,这里面就不再赘述了。

5. 其他因素的影响

在今年的(2015年)的Ceph Day上,海云捷迅在调优过程中分享过一个由于在集群中存在一个性能不好的磁盘,导致整个集群性能下降的case。通过osd perf可以提供磁盘latency的状况,同时在运维过程中也可以作为监控的一个重要指标,很明显在下面的例子中,OSD 8的磁盘延时较长,所以需要考虑将该OSD剔除出集群:

ceph osd perfosd fs_commit_latency(ms) fs_apply_latency(ms)

osd fs_commit_latency(ms) fs_apply_latency(ms)ceph.conf

2. 0 14 17

3. 1 14 16

4. 2 10 11

5. 3 4 5

6. 4 13 15

7. 5 17 20

8. 6 15 18

9. 7 14 16

10. 8 299 329

1.[global]总结

2.fsid = 059f27e8-a23f-4587-9033-3e3679d03b31

3.mon_host = 10.10.20.102, 10.10.20.101, 10.10.20.100

4.auth cluster required = cephx

5.auth service required = cephx

6.auth client required = cephx

7.osd pool default size = 3

8.osd pool default min size = 1

9.

10.public network = 10.10.20.0/24

11.cluster network = 10.10.20.0/24

12.

13.max open files = 131072

14.

15.[mon]

16.mon data = /var/lib/ceph/mon/ceph-$id

17.

18.[osd]

19.osd data = /var/lib/ceph/osd/ceph-$id

20.osd journal size = 20000

21.osd mkfs type = xfs

22.osd mkfs options xfs = -f

23.

24.filestore xattr use omap = true

25.filestore min sync interval = 10

26.filestore max sync interval = 15

27.filestore queue max ops = 25000

28.filestore queue max bytes = 10485760

29.filestore queue committing max ops = 5000

30.filestore queue committing max bytes = 10485760000

31.

32.journal max write bytes = 1073714824

33.journal max write entries = 10000

34.journal queue max ops = 50000

35.journal queue max bytes = 10485760000

36.

37.osd max write size = 512

38.osd client message size cap = 2147483648

39.osd deep scrub stride = 131072

40.osd op threads = 8

41.osd disk threads = 4

42.osd map cache size = 1024

43.osd map cache bl size = 128

44.osd mount options xfs = "rw,noexec,nodev,noatime,nodiratime,nobarrier"

45.osd recovery op priority = 4

46.osd recovery max active = 10

47.osd max backfills = 4

48.

49.[client]

50.rbd cache = true

51.rbd cache size = 268435456

52.rbd cache max dirty = 134217728

53.rbd cache max dirty age = 5

优化是一个长期迭代的过程,所有的方法都是别人的,只有在实践过程中才能发现自己的,本篇文章仅仅是一个开始,欢迎各位积极补充,共同完成一篇具有指导性的文章。

作者:xiaoquqi